最終更新日:

目次

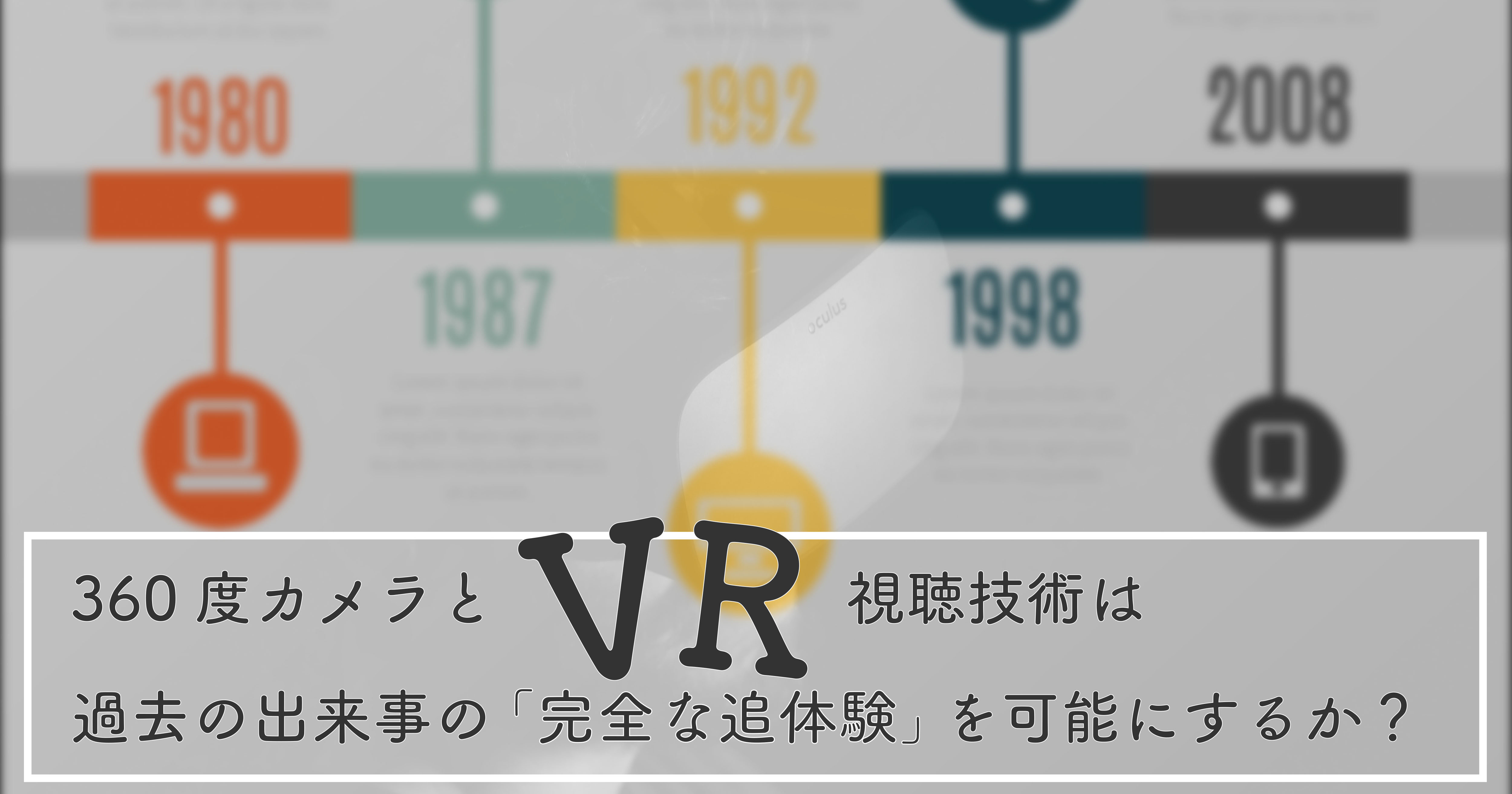

視線を360度動かせるVR動画を、「任意の地点」に「移動」して見られる時代はくるか?

360度撮影ビデオカメラを複数台、設置して、『あるとき』・『ある場所』で現実に起きたイベントを撮影して記録に残したとしよう。

そしてその結果、後の時代の人々が、「すきな地点に立って」・「すきなアングル(角度)から」その「過去の出来事」を「追体験」できるようになる。

そんな時代は、やってくるだろうか?

『(360度カメラで記録を撮っていた)過去の「ある出来事」を、後世の人々が、(カメラで撮影されていた地理範囲と時間帯に限定されるものの)「すきな地点に立って」・「すきなアングル(角度)から」その「過去の出来事」を「追体験」できるようになる』ことを、本稿では、過去の出来事の「完全な追体験」と暫定的に呼ぶことにする。

2018年9月現在、すでに可能になっているのは、FIFA世界大会のサッカーの試合や、プロ野球の試合のうち、「ある特定時点のシーン」だけを切り出して、「そのシーン」についてのみ、好きな角度から、かがみこんだ低姿勢の位置から見上げたり、上空を旋回するドローンの高さから見下ろした視点から眺めたり、バットとおなじ高さから360度ぐるりと見渡したりすることはできる。

しかし、「すべてのシーン」について、バッターの真横の位置まで移動して、バッターの隣にたった人の視点からバッターの肩の動きをみたり、バットが空気を「ブン!」と切りさく音をきいたり、投球を受け取ろうとするキャッチャーのすぐそばにかけよって、飛んでくる球をみたりすることはできない。

自由なアングルから眺めることができるのは、映像を提供している供給元が決めた、「特定の」シーンだけを対象としてものである。それも、映像の提供元が事前に設定した「特定の円周軌道」に沿った視点からしか、グルっと見回すことができないという状況だ。(たとえば、マイケル・ジョーダンのようなプロ・バスケットボール選手がスラム・ダンク・シュートを決めたときに、画像提供者が設定した「シュートした瞬間」(特定の時点)を、その選手の身体を「起点」とした「平面円周軌道」に沿って(しかも「起点」から特定の「半径」距離にある「円周軌道」上のみ)しか、視点の「360度アングル移動」が許されていないといったように、自由度は限られてしまうのが、現状である。

これが、「実写」を記録した動画についてできることの現時点での限界である。

しかし、「実写」ではなく3Dグラフィックスとなると、話は様変わりする。

3Dグラフィックスで描かれた仮想の世界を楽しませてくれるVR作品を体験しているときは、「いつでも」、「自由な場所(座標地点)に移動して」、そこから「自由な目線の高さ・自由なアングル」で、仮想現実の空間をみわたすことができる。

これは、3Dグラフィックスの世界は、「クオータニオン」(Quaternion。「4元数」。虚数単位が3つある複素数)による数学演算を、WebGLやThree.jsなどのプログラミング言語環境をつかうことで、『任意の座標地点から、任意のアングルで空間をみつめる視界に、どのような絵(画像)が映るのか』を、計算することができるからだ。

しかし、これを3Dグラフィックスではない、現実世界のなかで、過去に実際に行われたFIFAのサッカーの試合を撮影したVR録画を視聴するという話しになると、VR動画を視聴している視聴者は、試合開始のホイッスルが吹かれてから、試合終了のホイッスルが鳴るまでの全試合時間中の「任意の」時点に、任意の立ち位置から(たとえば「サッカーボールの目線」から)、試合会場の光景が刻一刻とどう変化していくのかを、見るといったことはできなくなる。

3Dグラフィックスの世界では、「任意の時点」に、「任意の座標地点」から「任意のアングル」から捉えた光景がどのような景色であるのかは、クオータニオンの数学演算で、計算機上で演算することで生成することができる。

つまり、3Dグラフィックスの場合は、『「任意の時点」に、「任意の座標地点」から「任意のアングル」から捉えた光景』を「データ」として「撮影」し「保存」していなくても、よいのだ。

しかし、現実の世界で起きた出来事を「記録」として保存するには、この<<『「任意の時点」に、「任意の座標地点」から「任意のアングル」から捉えた光景』を「データ」として「撮影」し「保存」すること>>が、どうしても必要になる。

そうなると、あの広いサッカースタジアムのあちこち(グラウンドの地中のいろいろな場所)に、360度カメラを埋め込まなければならなくなる。

「ある時点で」・「ある地点で」・「あるアングルで」捉えた画像ショットが複数そろえば、あいだの「時点」・あいだの「地点」・あいだの「アングル」から撮影した画像ショットが欠落していたとしても、「線形補完」などの欠損データの補完技術によって、欠落データを補うことができれば、設置しなければならない360度カメラの数を、ある程度は、減らすことはできるかもしれない。しかし、それでも、コストは高くつくだろう。

このあたりで、技術のブレーク・スルーが生まれるかどうか。多いに興味があるところである。

「(視線の)起点」を固定して「視線の方角」を360度動かすVR体験と、「対象」を固定して、対象を見る「視線」を動かすVR体験

景色を360度、見渡すことのできるVR動画にも、2つの種類がある。

1つ目は、「(視線の)起点」を固定した上で、固定された座標地点から、周囲を360度、プラネタリウム(+足元)を見渡す自由度を味わうことのできるVR体験がある。これが1つ目だ。これは、「起点」を固定して「視線の方角」を360度動かすVR体験だ。

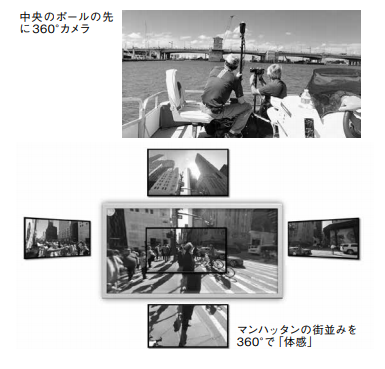

1つ目の例に取り組んでいる論文としては、和田 和美(静岡大学)『360度全方位動画コンテンツ作成と再生配信及びアプリケーションの模索』がある。

以下は、上記の論文から、「図 13 Ladybug 撮影の1シーン6画面 ( 上 )」を転載したものである。

また他に、山口 勝(NHKメディア研究部)「調査研究ノート 公共放送による360°映像のVR配信の意義 ~2020年とその先に向けて~』がある。

それとは異なり、みつめる「対象」としての客体(オブジェ)を固定した上で、その固定された「対象」を「見つめる視点の位置とベクトル方向」の方を、オブジェを中心においた球体の球面上の任意の位置に、360度、ぐるっと動かすことができるVR体験である。これが2つ目だ。これは、「対象」を固定して、「視線」を動かすVR体験だ。

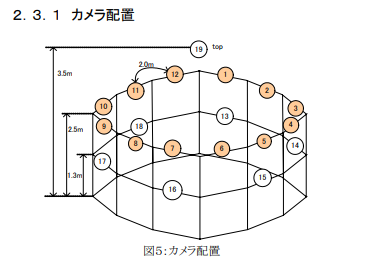

この「2つ目」の例としては、冨山 仁博ほか(NHK放送技術研究所・NHKエンジニアリングサービス)『多視点画像を用いた3次元映像の高精細生成システム』(2003年度 情報処理学会研究報告)がある。

この「2つ目」の技術を商用展開しているビジネス事例としては、NBAプロ・バスケットボールの試合中、360度動画が提供されている特定のあらかじめ定められた時点のみ、(映像提供者が事前に定めた円周軌道上で、という自由度の制約はつきながらも)360度、視点を移動して選手のプレイシーンを見ることができる事例がある。

下、このサービスを報じたオンライン情報誌 THE BRIDGE誌の2016年3月10日付け電子版記事 「Intel がスポーツ中の360度リプレイ映像を提供する「Replay Technologies」を買収」より、画像を転載する。

(以上、前掲記事内の埋め込み動画から、1部のフレーム画像を切り出して転載)

なお、同記事によると、半導体大手のIntel社は、「スポーツの試合中の決定的な瞬間を捉えて、360度の角度から瞬時にリプレイできる技術を開発」したイスラエルのベンチャー企業であるReplay Technologies社を買収したという。

(その他の記事としては、PRONEWS(2016年5月25日付け記事)「Intel買収FreeD技術、NBAプレーオフ中継に3D全周360度インsタント・リプレイ」がある)

以上みてきた、「1つ目」のアプローチと、「2つ目」のアプローチを融合した360度動画は実現可能だろうか、というのが本稿が冒頭で掲げた問いである。

それは、「視点」も「視線」も、その「両方」を自由に動かすことができるVR動画だ。

それも、録画動画中の任意のフレーム時点で、というのが、冒頭触れた、『「任意の時点」に、「任意の座標地点」から「任意のアングル」から捉えた光景』を体験することのできる(未来の)VR体験だ。

( 追記 )複数の2次元画像から、3次元立体画像を生成できる技術を使うと、推定した3次元画像を「任意の角度」・「任意の距離」から眺めた描像を推定できる?

ここまで、任意の座標地点から、任意のベクトル方向に向いた視点から、任意の時点で、どのような光景が見えていたのかを完全な自由度で再現することは、現実の空間で起きたことを記録する録画技術では不可能なのではないか? という問題提起をしました。

現実の世界をデータとして記録する際に、任意の座標地点から、任意のベクトル方向に向いた視点から、任意の時点で、どのような光景が見えていたのかをデータとして取得するためには、現実の3次元空間のあらゆる座標位置に、無数の360度カメラを稠密に配置して録画をしなくてはならないからです。

しかし、3Dの仮想空間であれば、クオータニオンの数学演算によって、それが可能である。仮想空間では、任意の座標地点から、任意のベクトル方向に向いた視点から、任意の時点で、どのような光景が見えていたのかをデータとして取得していなくても、数学演算によって、それを推定することができるから、と述べました。

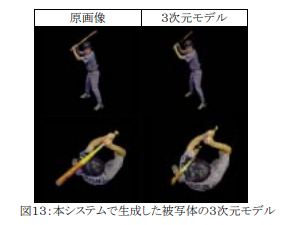

しかし、その後調べてみたところ、コンピュータ・ビジョン(CV: Computer Vision)の研究領域では、古くから、対象となる物体(or 対象となる空間)を複数の異なる角度と距離から捉えた2次元の静止画像を、角度などを補正しながら付き合わせることで、対象となる物体の3次元画像を推定する技術が、研究されてきたことを知りました。 複数の2次元画像を元にして3次元立体描像を計算機上で得る(推定する)ことができれば、計算機上で構築された3次元立体データを、「任意の距離」・「任意の角度」から、「任意の方向」で見つめる視点から捉えた時、どのように(視界に)映るのかを、計算機上で推定することもできるのではないかと考えるようになりました。

次回の記事では、この「複数の2次元画像を元にして3次元立体描像を計算機上で得る(推定する)技術」について、取り上げてみたいと思います。

「時代思潮」の主観的感覚を含めた「完全な」歴史の追体験へ向けて

ところで、本当の意味で、過去を「完全に追体験」するためには、当時のその地域を生きていた人々の思想信条や価値観や認識枠組みなど、「当時の人々の視線」なり「時代思潮」までを、再現しなくてはならない。

「時代思潮」を計算機上で保存可能な「情報量」として取り出して、後世の人々の意識に入力することも、将来可能となるかもしれない。

すでに人間の脳内において処理される「視覚情報」については、「ディープ・ラーニング」の代表格として、すでに広く世に知られることとなった「畳み込みニューラルネットワーク」モデルや「オート・エンコーダー(自己符号化器)」モデルによって、「猫の目」や「自動車のタイヤ」など、個々の「物体パーツ」などが、人間の脳内でどのような「情報表現」に置き換えられているのかを考えるヒントが得られつつある。

ここで「ヒント」といったのは、「ディープ・ラーニング」をはじめとした「人工知能」モデルは、あくまでも「人工」知能のモデルであって、人間の視覚野の構造を(簡略化して)模式化するところから出発したとはいえ、あくまでも人間の脳内の情報処理「そのもの」を忠実に(情報論的に)再現した「数理的な情報表現」ではないからだ。

しかし、「本物の」人間の脳が、ある物体を目の前に見せられたり、あるいは、目のまえにない物体を想起したりするとき、人間の大脳新皮質のどの部位がどのように電磁的に活動しているのかを、「ディープ・ラーニング・モデル」によって計算機上で「パターン」推定した上で、いまMRI計測装置に上半身を納めている「被験者」が何を見て、何を思い描いている(「想起」)のかを言い当てる研究も、すでに相当進んでいる。

ATR(国際電気通信基礎技術研究所)の計算脳イメージング研究室が取り組んでいる「脳から知覚映像を読み出す」「脳情報解読アルゴリズム」の研究がある。

なお、この分野では、前掲のATRと、NICT(情報通信研究機構)から多くの研究が出ています。

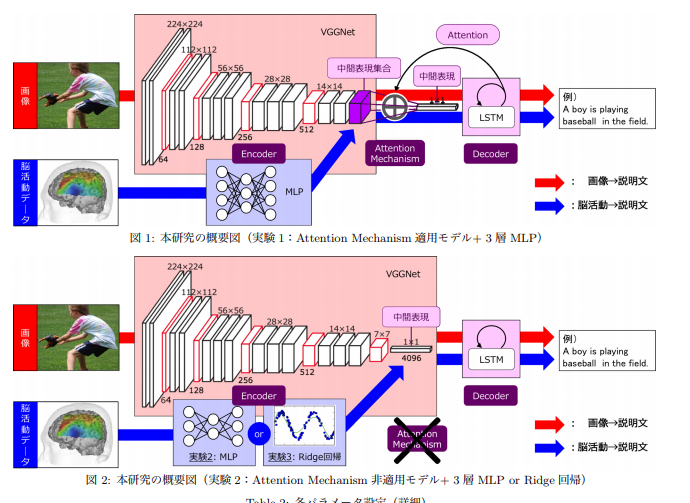

- 【 論文 】松尾 映里ほか 「深層学習を用いた画像刺激による脳活動データからの説明文生成」(人工知能学会 2016年度全国大会)

- 【 論文 】川瀬 千晶ほか『脳活動データからのスパースコーディングによる意味表象推定と基底の分析』(言語処理学会第24回年次大会、2018年3月 )

- 【 論文 】川瀬 千晶ほか「スパースコーディングを用いた脳活動の分散意味表現による言語表象推定への取り組み」(言語処理学会 第22回年次大会 URL:)

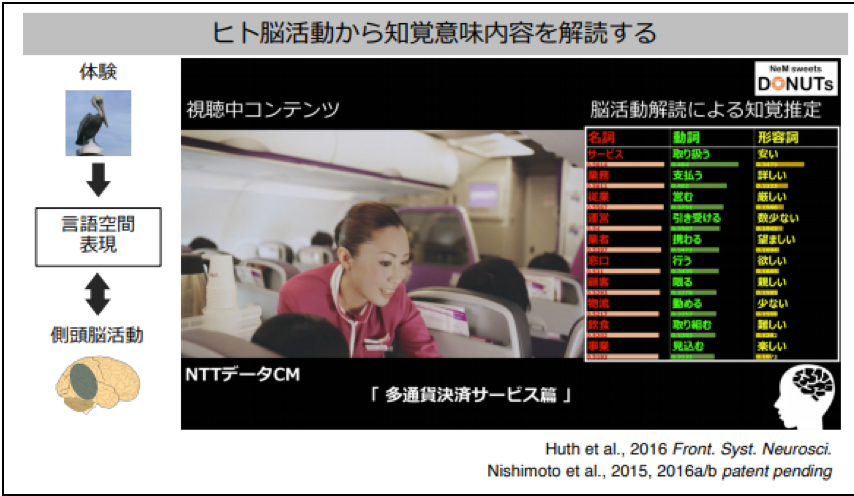

- 【 スライド 】西本 伸志(情報通信研究機構・脳情報通信融合研究センター)『脳情報解析と⼈⼯知能の接点:シーズ・社会実装・課題』

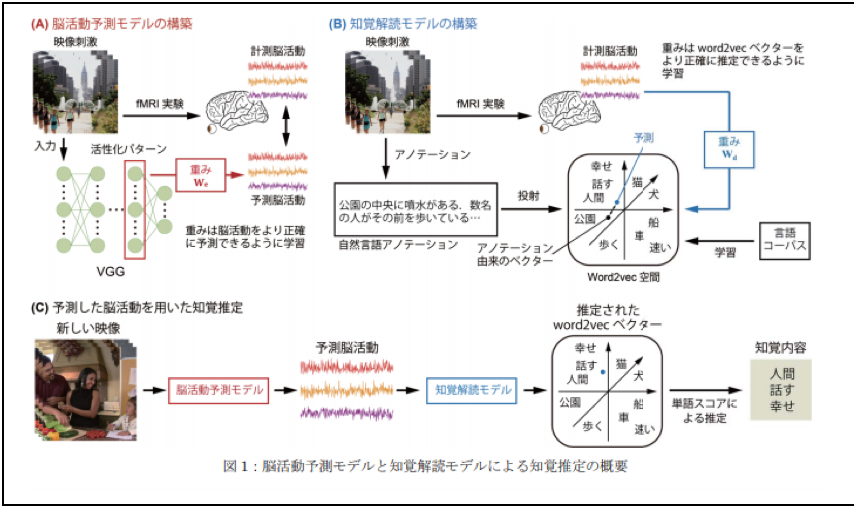

- 【 論文 】西田 知史・西本 伸志「脳表象モデルを用いた任意の視覚入力に対する知覚内容推定システム」(人工知能学会 2018年度全国大会)

- 【 論文 】西本 伸志(情報通信研究機構・脳情報通信融合研究センター)「特集:MRIによる視覚研究 fMRIによる視覚体験の可視化」(「視覚の科学」第36巻第3号 )

- 【 NICT News 】「脳をリバースエンジニアリングする -モデリングアプローチを用いた定量的脳機能理解」

(以下、【 論文 】西田 知史・西本 伸志「脳表象モデルを用いた任意の視覚入力に対する知覚内容推定システム」より転載)

(以下、 【 論文 】西田 知史・西本 伸志「脳表象モデルを用いた任意の視覚入力に対する知覚内容推定システム」より転載)

(以下、【 スライド 】西本 伸志(情報通信研究機構・脳情報通信融合研究センター)『脳情報解析と⼈⼯知能の接点:シーズ・社会実装・課題』より転載)

また、(本物の人間の脳のなかで行われている脳内情報処理の忠実な再現を必ずしも目指さない)「人工」知能の研究では、視覚だけでなく、視覚と触覚、聴覚、嗅覚、さらには運動感覚(「体性感覚」)を全体として体感する際の「総体」としての感覚を統合する手法の研究も進んでいる。

「マルチ・モーダル」と呼ばれるこの研究領域は、視覚センサーから捉えた信号を処理した「視覚特徴空間ベクトル」や、触覚センサー由来の「聴覚特徴空間ベクトル」など、個々のセンサー由来の「○○特徴空間ベクトル」を、数学的に統合することで、より高次の感覚の数理情報表現を生成するものである。

フランスの歴史学派「アナール学派」(「歴史年報」。仏: L’école des Annales、英: Annales School。学会誌の名称に「年報」(Annales)の文字があったことから名づけられた学派名で)がある。

この学派は、たとえば中世ヨーロッパの人々の身体に使い方にあっては、視覚よりも(教会の鐘の音を捉える)聴覚が優位であった(近代に入り、「視覚」優位になった)という仮説を提示している。

この仮説が正しいとするならば、時代ごと・地域ごとに、身体の五感の使い方(どの感覚情報が「全身感覚」・「統合感覚」の意識空間のなかで、より前景に出てくるか)が異なることになる。

今後は、各時代と各地域に活動する人々の五感の使い方を、センサーによって計測し、その計測した情報をサーバにデータとして保存し、後世の人々に、ある時代の人々のものの「感じ方」までをも、正確に「追体験」させる道が、今後、開けてくるかもしれない。