おざけんです。今回はオムロンの自動運転の実現に向けた画像認識技術をご紹介したいと思います。

歯ブラシやヘルスケアの分野で多くの商品を出していて、そのイメージが強い方も多いかもしれません。私はオムロンの電動歯ブラシをとても愛用していました。

ヘルスケア分野で名高いオムロンですが、AI領域でも活発に研究開発されていることをご存知でしょうか。

特にAI系の展示会では、卓球ロボット「フォルフェウス(FORPHEUS)」や自動運転のデモが展示されていたりして、オムロンのブースには人だかりができていることが印象的です。

オムロンの戦略

オムロンは2020年度に売上高1兆円を目指す中期経営計画VG2.0を発表しています。

「技術の進化を起点に、イノベーションを創造し、自走的成長を実現」というオムロンの方針のもと、「社会課題の解決」を目指しながら会社としての成長を目指す方針です。

先日、設立が発表されたオムロン サイニックエックス株式会社も「技術を用いた社会課題の解決」を目指すことが強調されていました。

中期経営戦略では具体的には以下のような基本戦略を策定しています。

今回はこの中でも「モビリティ」に焦点を当ててみましょう。

自動運転にも取り組んでいるオムロン

オムロンは社会課題を解決するための一つの領域としてモビリティを定めています。

モビリティの技術革新によって、世界中の人々がより安全、安全に生活できる社会を想像できると考えているからです。

視野が世界に向いていることも特徴的です。交通事故での死亡者数は世界で毎日3400人以上、交通事故の原因の8割はドライバーの不注意など人的要因によるものでまさに社会課題の一つといえます。

そのため、より安全な走行システムを自動運転で実現する必要があります。今回紹介する技術は自動運転の実現に向けて車内の人間の状態の認識に目を向けたものです。

完全なる自動運転が実現するまで、運転手は必ず運転席に座っていなければなりません。しかし、運転への関与度がどんどん下がっていくこれからの時代、運転手が注意散漫になり緊急事態に対応できない事態が発生しかねません。

そこでオムロンの画像認識技術が活用されます。もともとオムロンの画像認識技術はコア技術の一つで、30年以上の事業実績があります。

特徴的なのは、オムロンの画像認識はエッジ型だということです。画像認識を車載するためにはエッジでパフォーマンスを発揮することが大切です。

しかし、エッジ型の画像認識といっても、課題は山積しています。限られたハードウェアリソースの中で運転に活用できるレベルのリアルタイム性を追求し、相応の結果が得られなければならないからです。

赤外線を用いた画像認識でドライバの状態を理解

オムロンが開発している技術の一つがドライバの状態認識です。

コックピッドにセンシング用の近赤外カメラと照明を設置し、ドライバの状態を把握します。

この技術の背後に使われているのがディープラーニングです。

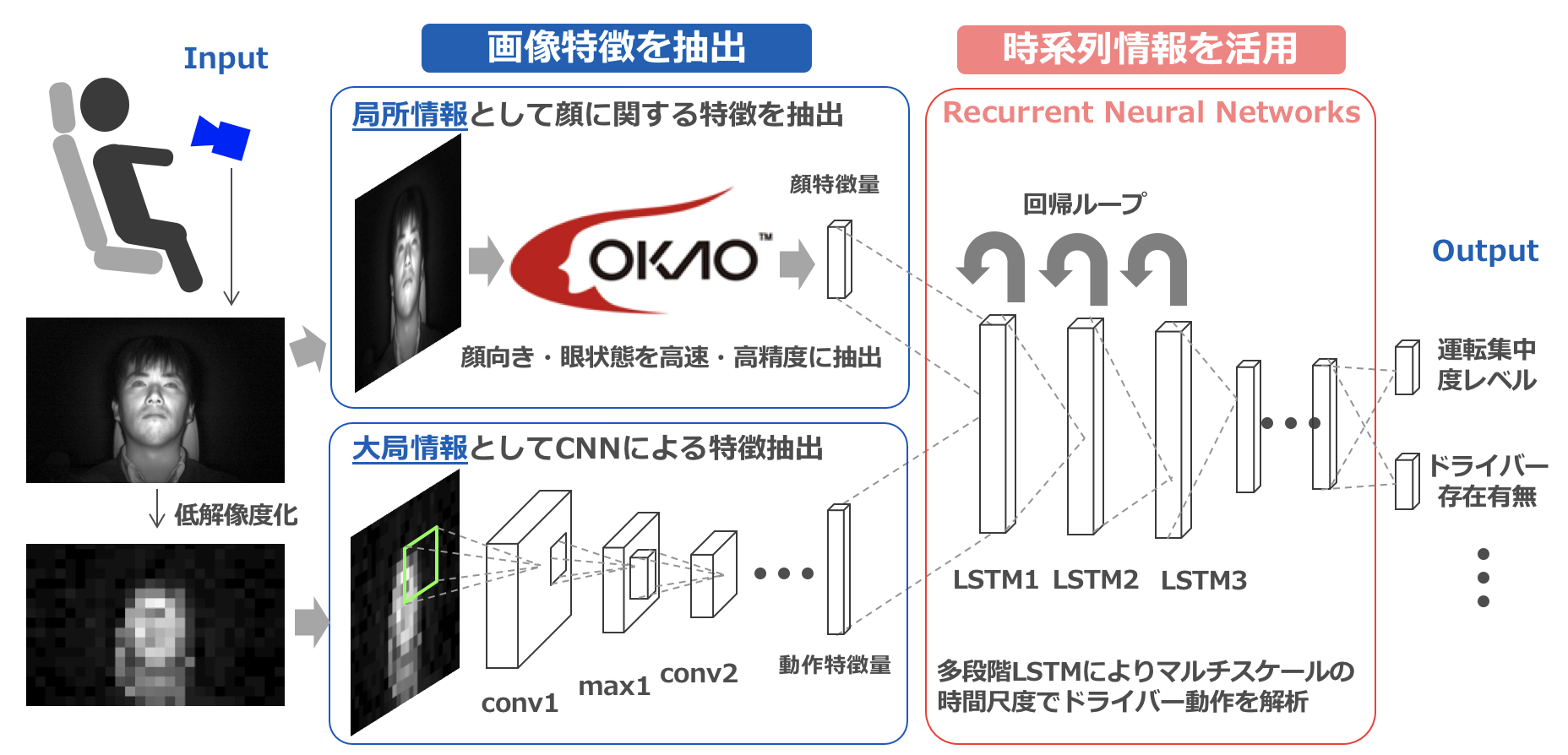

解像度を下げた大局的な情報と、部分的な局所情報をそれぞれ違うネットワークで処理した上で融合することで小型化、高速化を実現したといいます。

眼底のトラッキングで眠気の予兆を察知

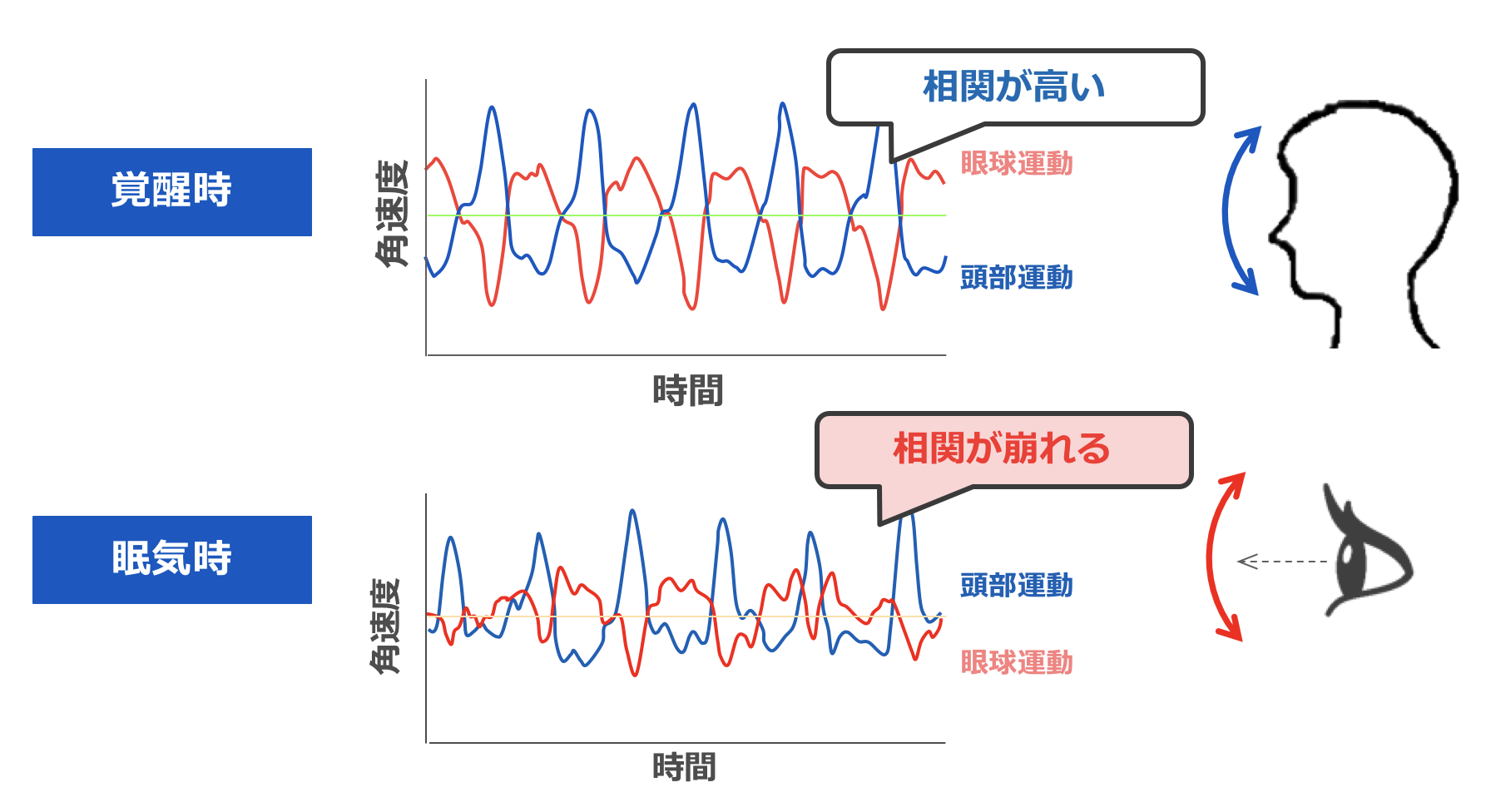

この技術の大きな特徴が「予兆」を察知できる点です。

ドライバの状態をリアルタイムでセンシングしても、対応が間に合わず事故が起きてしまう可能性があります。

そこでオムロンは時系列の情報から、「眠気」の予兆を察知して事前にアラートを出す仕組みを取り入れています。

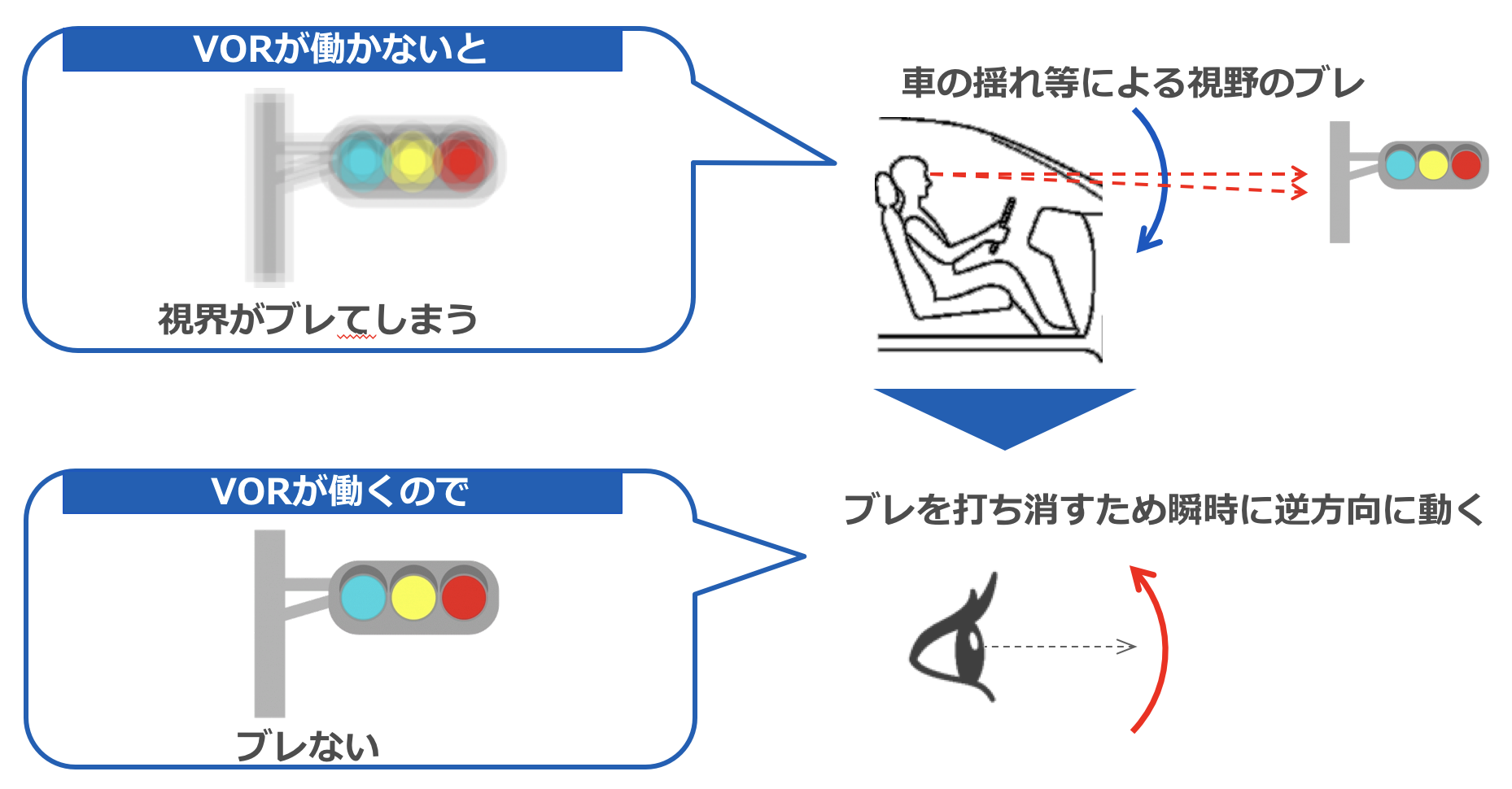

人間は、手ぶれ補正のように無意識に視野のブレを補正するVORという生体現象が生じます。

このVORの機能の働きは眠くなると低下してくることが生理学の分野で明らかになっており、オムロンはそこに注目しました。眠い時と眠くないときの眼球の動きをトラッキングすることで眠気がくることを予測するということです。

眼球の運動と頭部運動をリアルタイムにトラッキングして眠気予兆を察知するアルゴリズムはオムロン独自の技術です。

今後はこの技術の実用化を目指して、研究開発を進め、より安全なモビリティの実現に向かって進化を続けていきます。

まとめ

- オムロンが目指す社会課題解決分野の一つがモビリティ

- 自動運転が実現する将来に向けてドライバの認識も必須に!

- 眼底のトラッキングにより、眠気の予兆を察知する技術を独自開発

自動運転というと車外の環境認識が意識されがちですが、それと同時に車内の環境認識、ドライバの状態認識が必須になってきます。

日本国内では当面の間は自動運転は高速道路など限定した環境下でしか許可されません。また、ハンドルから手を離していい時間も決められていて、ドライバは運転から完全に注意をそらせる時代はもう少し先になりそうなのが実情です。

そのため、今回のドライバ認識技術は、今後重要性が増してくると期待しています。

→ディープラーニングを使っている

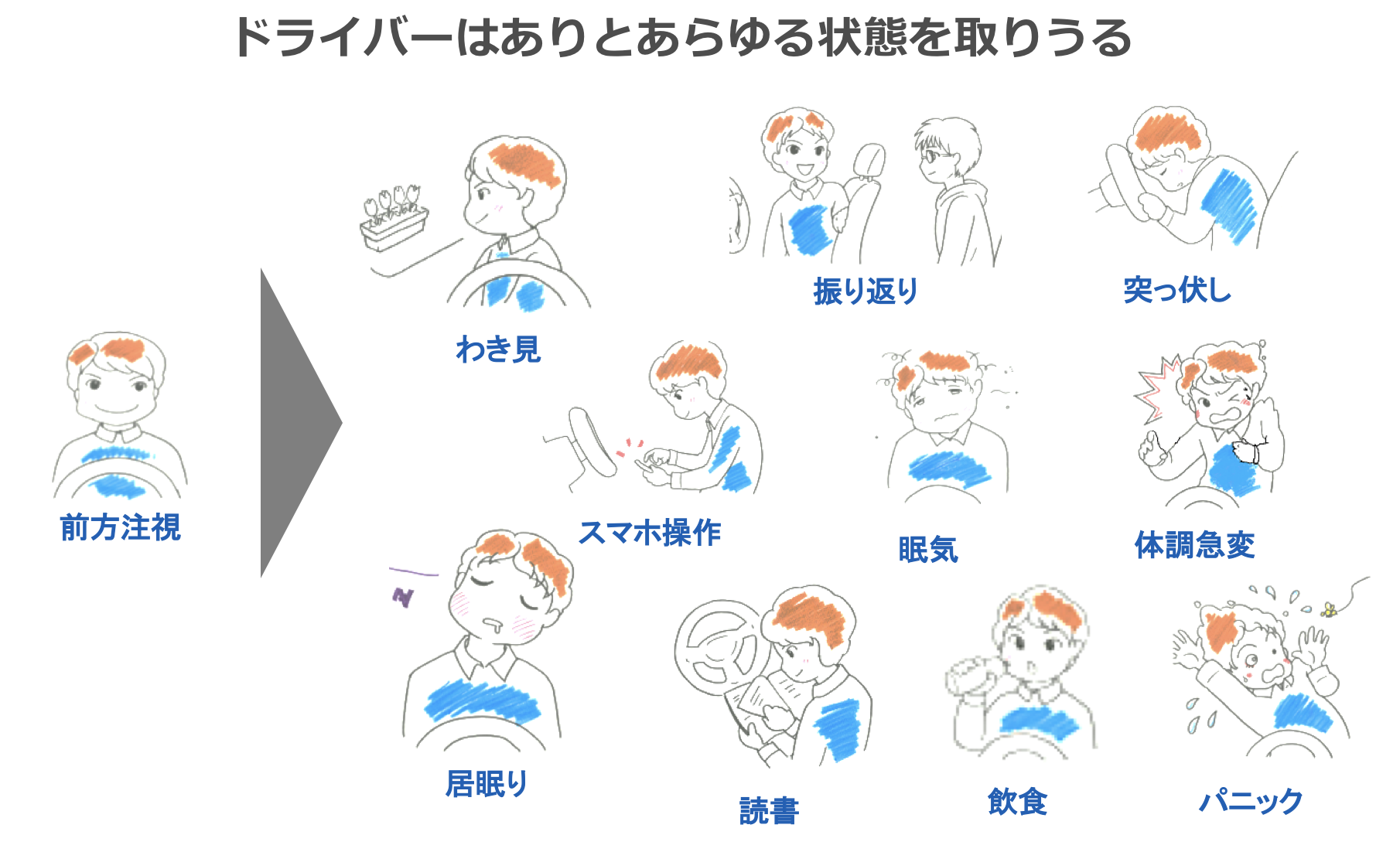

自動運転が実現すると人は運転に集中しなくなる。いろいろな状態をとるようになる。スマホや寝るなど。

すべてのシーンで実用化されれば問題はないが当面は限定的。

例えば高速道路から。高速道路から市街地に行く時には切り替えが必用。ドライバが運転できる状態にあるかを監視する必用がある。

ドライバが運転できない場合は、アラートを流したり、路肩に車を停めるなどの対策が考えられる。

手動運転でも大事な技術。交通事故は社会課題の一つ。ドライバが運転に集中できるかを見ることで事故を低減できると考えている。

そこで画像認識技術を使ってドライバー状態を理解。近赤外光を使うことで、夜間でも高精度に認識ができる。

概要

ドライバーが眠たそうにしているとき、その状態を認識する。自動運転から手動運転に戻れそうなレベルを検知する。

値落ちするとDifficultになる。

あらゆる動作に対して認識をしている。スマートフォンを操作する

どうやっているのか!?

ディープラーニングを使って実現している。入力画像をCNNに打ち込むことが考えられるが、車載のハードでは計算時間がかかりすぎる。

そこで、やり方を工夫して局所情報と大局情報を出してリアルタイム性を実現している。

局所では顔に関する特徴を抽出、身体の動きを大局的な情報として抽出。組み合わせることでドライバの挙動を高精度に認識することが可能。また、時系列情報も活用。RNNを使って、最終的にドライバの運転集中度レベルを出力する。

ディープラーニングなので、学習量が、ものを言うが、何百人もの被験者を読んで試験して、アノテーションして、正解データを増やして学習を増やしている。

ここまでが今の状態のセンシング。

状況によっては予測が必要。眠たくなる予兆のセンシング。

予兆のセンシングにも取り組んでいる。

無理ゲーっていう難しさ、ほとんど違いがわからない。

どうやっているのか?

生体現象を見ることで実現する。オフロードで運転するとガタガタ揺れるが人は鮮明に見ることができる、視野のブレを補正するから。これが無自覚に起きる。振動方向と逆に目が動く。このVORは眠くなると働かなくなる。なので、頭部の運動と眼球の動きを観測して眠気を予測する。

眼球運動と頭部運動を同時に観測するアルゴリズムで眠気予兆の出力の予兆を進めていく。

■AI専門メディア AINOW編集長 ■カメラマン ■Twitterでも発信しています。@ozaken_AI ■AINOWのTwitterもぜひ! @ainow_AI ┃

AIが人間と共存していく社会を作りたい。活用の視点でAIの情報を発信します。