近年急速に台頭しているMidjourneyをはじめとするテキスト画像生成モデルはアーティストの仕事を奪うのではないか、と懸念する声が聞かれます。Sainsily氏はこのようには考えておらず、むしろAIモデルを活用することでより迅速かつ大量にデザイン等のアイデア出しが可能となることで、アーティストを大いに助けてくれるととらえています。こうした同氏の考えは、テキスト画像生成モデルによって「アーティストはアートディレクターになる」とも表現されます。

記事の後半では、Sainsily氏が実際にMidjourneyを使って「(生物を模倣した)バイオミメティック・シューズ」のデザインを考案するプロセスが解説されています。そのプロセスの手順を簡潔に書き出すと、以下のようになります。

Midjourneyを使ったデザイン共創プロセス

|

以上のようなデザイン手法は「プロンプトエンジニアリング」と呼ばれ、最近ではさまざまなアーティストがこの手法を研究しています。同手法の登場によって、コンセプトアートはもはや永久に従来とは変わってしまった、とSainsily氏は述べています。

なお、以下の記事におけるMidjoueneyへのプロンプト入力文の翻訳にあたっては、訳文とともに英語原文も併記しました。本記事の解説事例を試行する場合は、英語原文をプロンプト入力するとよいでしょう。

なお、以下の記事本文はManuel Sainsily氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

「さまざまな色味のある(multi-colour)銀河の爆発」

Manuel Sainsilyによる研究 – www.manu.vision

#インスピレーション #コ・クリエイション #会話 #人工知能 #AI #アートディレクション

・・・

すべての子どもはアーティストである。

問題は、大人になってからどうやってアーティストであり続けるかだ。

パブロ・ピカソ

・・・

Read_me.txt

この記事を以下のようなYouTube動画にしましたので、読むより視聴したい方はご覧ください。

・・・

はじめに

2週間前、他の多くの人たちと同じように、何ヶ月も待っていたMidjourneyのベータ版にようやくアクセスすることができた。開発者がどんどん新しい招待状を送っているので、おそらくあなたもそれを聞いたり、ショーシャルメディアでシェアされているのを見たりしたことだろう。私はすでに2018年から生成系アートコミュニティで楽しんでいて、機械学習の力を活用したツールもそれなりに体験してきた。最近では人工知能の波が押し寄せ、A.Iが生成する魅力的なアートが急増していた。Midjourneyが他(の生成系AIモデル)と異なるのは、その動作の速さだ。これまで数分、あるいは数時間かかっていたものが、数秒で結果を生成できる。同じようなスピードのツールは、WOMBOのiPhoneアプリ「Dream」(※訳註1)くらいしか思いつかないが、結果は全く比較にならないほどMidjourneyの方が素晴らしい。もちろん、GoogleのImagen、Disco Diffusion、あるいはOpen AIの名うてのDall-Eといった他の代替ツールについても言及しなければならない(ところで、これを読んでいる方でDall-E 2を試すための招待状を受け取った方は、共有していただけると非常にありがたいのですが…(※訳註2))。

画像生成アプリDreamが生成する画像例

DreamのApp Storeページから引用

A.I駆動型アートは、筆跡の代わりに言葉によってアート作品を生み出す新しい分野と言えるかも知れない。この分野におけるアーティストの才能は作画やデッサンのスキルではなく、プロンプトを通してどれだけ自分のビジョンを伝えられるかで評価される。A.I駆動型アートの使い手のツールセットはもはや筆や鉛筆ではなく、語彙と用語集が占めるフィールドから成り立っている。アーティストが複雑なアイデアをどのように表現するかによって、プログラムがどれだけ正確にその意図を解釈できるかが変わってくるのだ。

A.I駆動型アートは、アーティストの未来と、クリエイティブなプロセスにおける彼らの位置づけについて、非常に重要な問いを投げかけている。コンセプト・アーティストやイラストレーター、画家は絶望的で、A.Iが(LaMDAのように(※訳註3))すぐに意識を発達させて彼らの仕事を奪うと考える人もいるが、私はアートの未来について非常に異なったビジョンを持っている。A.I駆動型アートとは人とコンピュータのコラボレーションによって推進されるものであり、この形態のアートにおいてはアーティストがアートディレクターになる、というのが私の考えだ。写真家、グラフィックデザイナー、あるいはCGアーティストであれば、プロジェクトの初期段階、あるいはアイデア出しの段階でどれだけの日数がかかるか知っているはずである。

実験には通常、コストがかかる。制作段階に入る前に、もっと練習やアイデア出しの時間があったらと、アーティストであれば何度も夢見たのではなかろうか。最終製品の背後にある研究や参考資料、影響を受けたものが、クライアントやエンドユーザの目に触れないままであることはよくあることだろう。関係者が満足せず、白紙に戻すことを余儀なくされた時、どれほどの衝撃を受けたことだろう。そんな場合はしばしば、自分の居心地の良い領域から飛び出して、斬新なアイデアを練るのに十分な時間がないのに、会議に出るように強いられたのではなかろうか。(Midjourneyのような)この種のツールは、数週間ではなく数時間で何千もの選択肢を提供することで、こうしたアイデア出しの時間枠を大幅に短縮できる。また、カラーパレット、ライティングシナリオ、マテリアル、テクスチャ、コンポジション設定など、さまざまな出力でA/Bテストもうまくできる。アーティストが世界観の構築やキャラクターの探索に費やす時間は大幅に削減され、制作プロセスであまり注目されないことが多い部分に投資できるようになるのだ。

A.Iを使った作業は、人間にとって何も新しいことではない。例えば、メッセージやメール、ワープロソフトのオートコンプリート機能や、画像・動画編集ソフトの高度な機能を通じて、私たちはすでにA.I.に慣れ親しんでいる。携帯電話では音声アシスタントとして、ビデオゲームでは敵やNPCとしてAIは活躍しており、私たちの日常生活の一部になっている(※訳註4)。AIは数年後にはあらゆる産業で活用されるようになると私は確信しており、それゆえ早くからそれとのコラボレーションを学ぶことが得策である。

・・・

人と機械が共創する時代の始まり

さて、Midjourneyの話に戻ろう。このA.Iを使ううえで重要な点はDiscordのチャットボットを通して相互作用するということで、そのプロンプトシステムはかなり強力だ。(2022年6月時点では)まだクローズドベータなので、ユーザーインターフェースは見せられないが…いや、冗談だ、もちろんお見せする。その前に、いくつかの簡単な概念を定義しておこう。プロンプトに単語や形容詞、アーティスト名やアートスタイルなどのような変数、あるいはアスペクト比やカメラレンズなどのパラメータを追加でき、それぞれの追加単語によって最終的な出力を劇的に変化させられる。例えば、以下の画像はMidjourneyのA.Iだけで生成されたものである。

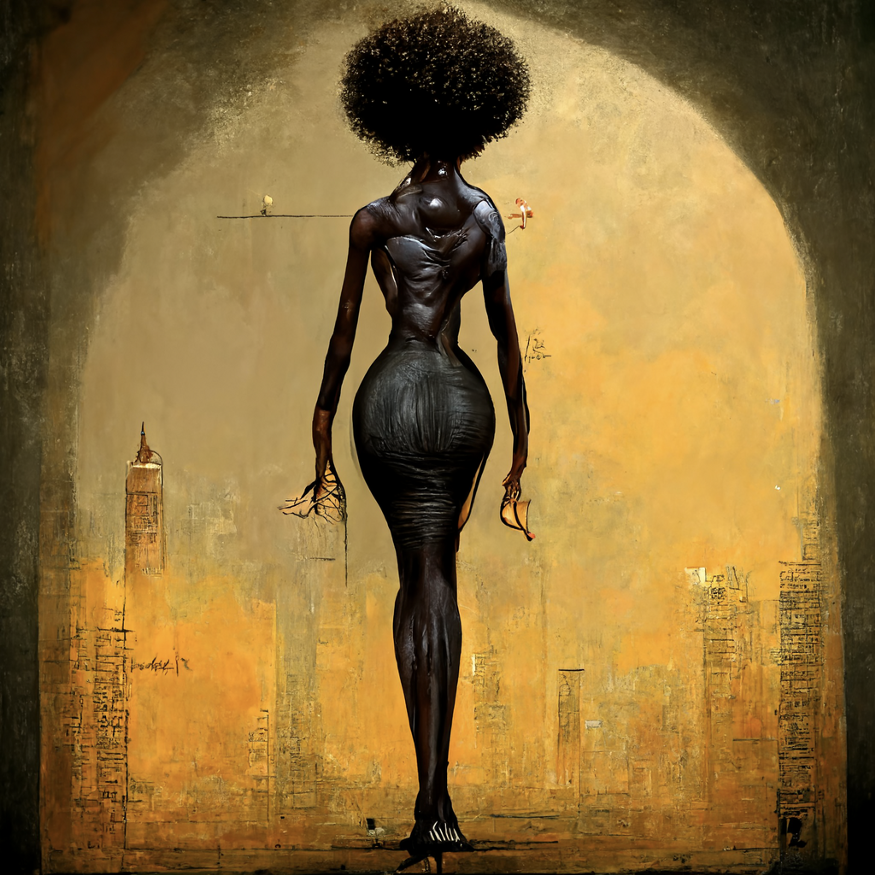

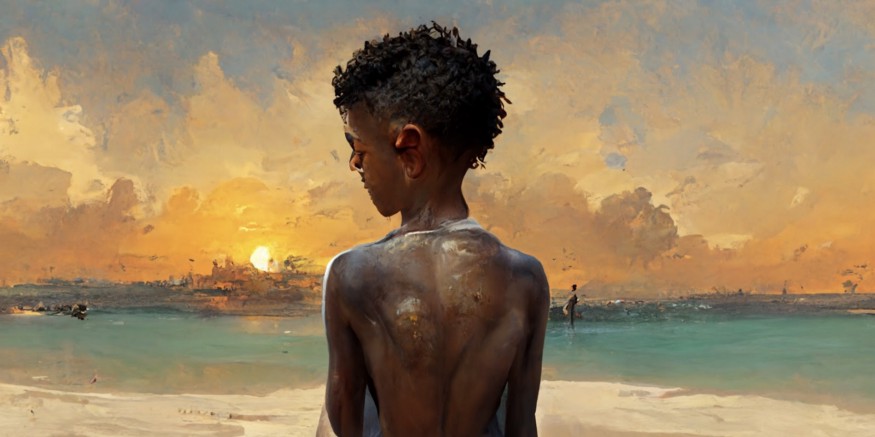

以上の画像を生成するために使用したプロンプトを分解して解説しよう。単純なプロンプトは、例えば「女性(Woman)」のような1つの単語で構成できる。

しかし、「黒人女性(Black Woman)」と言えば、結果はまったく違うものになるだろう。とりわけほとんどのA.Iは偏見に満ちたモデルで訓練されており、必ずしもインクルーシブ(※訳註5)ではない。

DALL-E 2に代表されるテキスト画像生成モデルは、白人男性を中心とした文化観を反映した学習データで訓練されていることが多い。実際、同モデルが公開された当初のシステムカードには人種的・ジェンダー的バイアスがあることが明記されていたが、2022年7月18日公開のOpenAIブログ記事では、こうしたバイアスを緩和したことを発表した。

そして、「背の高い黒人女性(A Tall Black Woman)」のように形容詞を加えてより説明的に表現できる。

さらに、「火でできた赤いドレスを着ている背の高い黒人の女性(A tall black woman wearing a red dress made of fire)」というような、ばかげた詳細も付け加えられる。

また、有名なアーティストや特定のアートスタイル、あるいは(油絵や水彩といった描画)手段からインスピレーションを得ることで、結果に影響を与えられる。例えば「レオナルド・ダ・ヴィンチのような様式をした炎でできた赤いドレスを着た背の高い黒人の女性(a tall black woman wearing a red dress made of fire in the style of leonardo da vinci)」と入力して生成した画像は以下。

次のように文章を組み合わせることも可能だ。「レオナルド・ダ・ヴィンチ風の火でできた赤いドレスを着た背の高い黒人女性を描いた子供の絵(a kid drawing of a tall black woman wearing a red dress made of fire in the style of leonardo da vinci)」

パラメータの追加もできる。例えばプロンプトの最後に「- ar 16:9」を追加することで、横長画像のアスペクト比を指定できる。このほかにもいろいろなパラメータがあるが、今日はすべてを説明しないでおく。

それでは、すべての可能性を想像してみよう。それは言い過ぎで、本当にちょっとだけ考えてみよう。私が実現したいアイデアのひとつに、従来の額縁をWeb 3.0に置き換えたものがある。もし、壁に1点のアート作品を飾る代わりに、Midjourneyと同じようなツールを使った空のデジタルスクリーンに置き換えられると想像してみよう。もっとも文字で指示する代わりに、システムを音声AIに接続する(現在、人々がGoogle homeやSiri、Alexaに話しかけてアパートの電気をつけるのと同じ方法だ)。毎日起きてからこのスクリーンに話しかけると、自分のフレームに毎回違うアイデアをビジュアル化するようお願いできる。このようなインスタレーションを美術館に作り、来場者が気に入った結果をプリントアウトして、彼ら自身が展示の一部になれるようにしたい、と私は思っている。そして、来場者たちの集合知が何を生み出すのかについて、興味を抱いていてもいる。

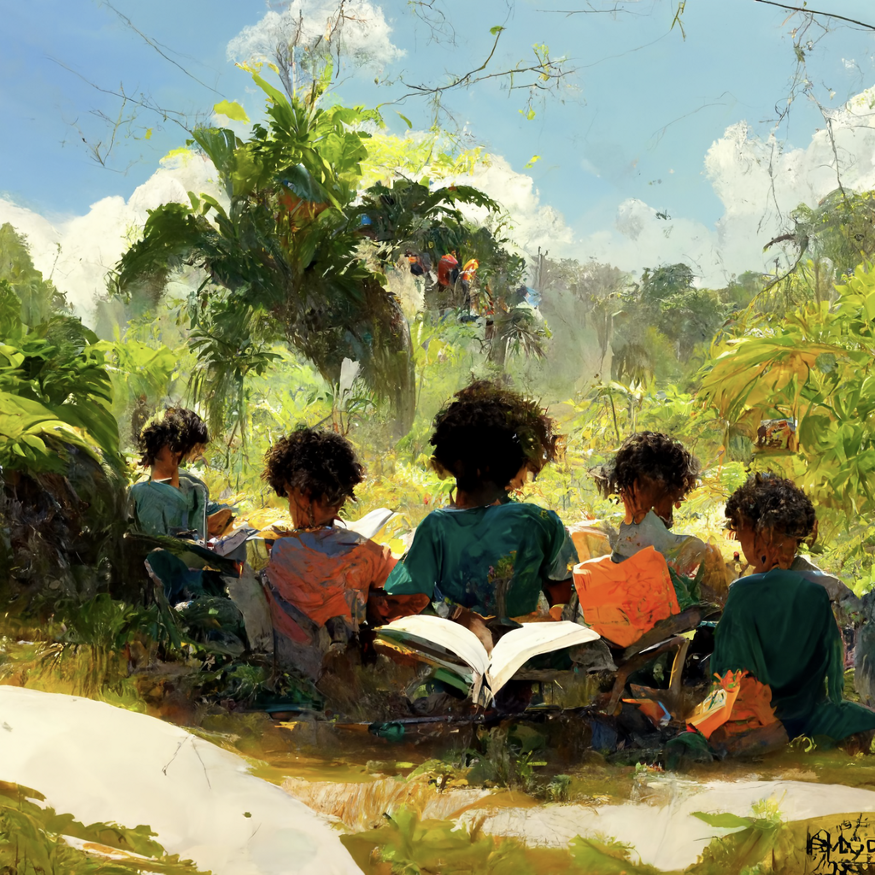

以上の私のアイデアのほかにもさまざまなものを組み合わせたものがあり、(NFT界隈以外でも)生成系コミュニティが現在取り組んでいる素晴らしいプロジェクトに目を向けてみてほしい。そのほかの興味深いコンセプトには、作家、著者、あるいは詩人が、自作の各ページや各段落にビジュアルを生成させることがある。映画監督が脚本に関するインスピレーションを得たり、子供が好きな小説を読んでいるときに没頭したりするのにA.I駆動型アートが役立つことも想像してみよう。

よし…ここで深呼吸しよう。まだついてこれるだろうか。A.I駆動型アートのさらに奥深くまで進んでみたい。しっかりつかまって欲しい。私がMidjourneyというA.Iと共創する際の通常のプロセスをお見せしよう。

・・・

共創プロセスの解説

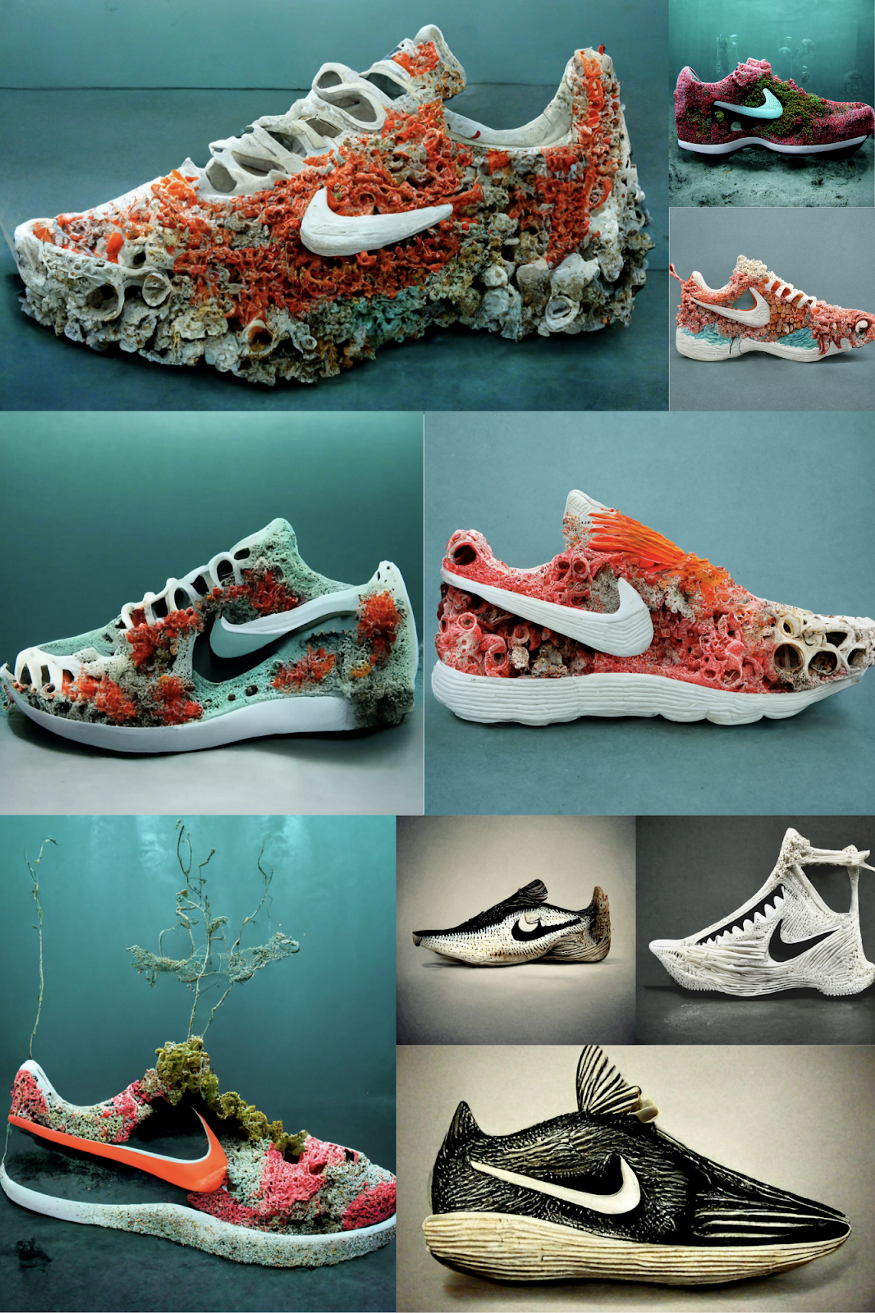

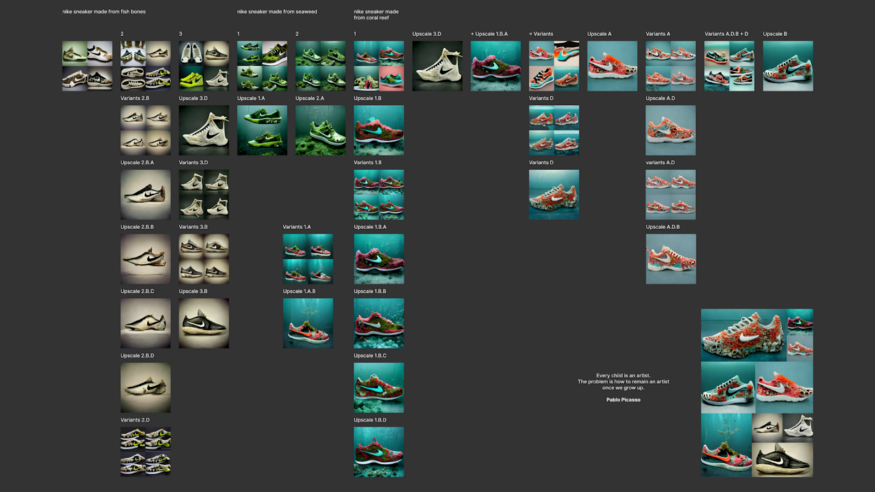

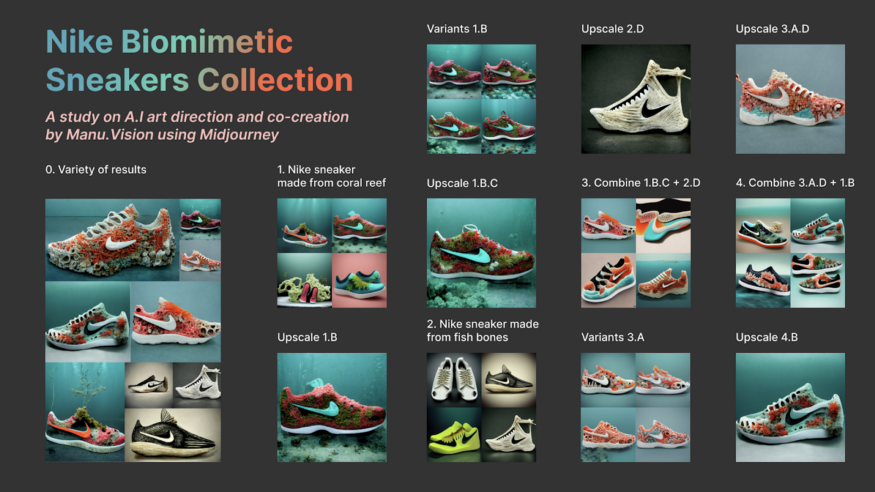

Midjourneyとの共創がいかに複雑かを理解してもらうために、私が共創を通してたどった探検をマップとして用意した。というのも、チャットボットとの会話は非常に直線的であるため、そのインターフェースで迷子になりやすいからだ。私の好みはFigma(※訳註6)などのデザイン・ツールに出力をエクスポートして、このより大規模なcanvaを利用して、私の選択肢をマップ化し、面白いと思うものを一緒に組み合わせて、さらに詳細な結果を生成することである。スニーカー・ファンである私は、Nikeの(生物を模倣した)バイオミメティック・シューズ・コレクションを想像したいと思った。以下がそうしたアイデアにもとづいた最終的な結果である。

すべては、次のようなシンプルなプロンプトから始まった。「サンゴ礁から作られたNikeのスニーカー(Nike sneaker made from coral reef)」。

Midjourneyは、あなたのオリジナルのプロンプトから常に4つの異なるイメージを生成する。

この結果から、2枚目の画像をアップスケーリング(高解像度を保ったままの拡大表示)することにした。

そして、以上の新しい画像の2枚目からバリアント(異なるバージョン)を作成した。

今回の生成結果では、3枚目の画像をアップスケーリングすることにした。

このとき、私はこの生成結果がとても気に入ったので、「魚の骨で作ったナイキのスニーカー(Nike sneakers made from fish bones)」というプロンプトに少し修正することにした。私の親友で、マルティニーク(カリブ海に浮かぶフランスの島)出身のアーティストであるBahbou Floroの作品からインスピレーションを得た。彼の魚の骨から作った作品はアーティスティックなユニバース(世界)となっており、彼はスニーカー好きでもある。

(修正したプロンプトを入力して)4番目の結果をアップスケーリング。

この結果も非常に興味深かったので、最初の結果とこの結果を組み合わせて、2つの異なるプロンプトに影響された新しいバリエーションセットを作った。

さらに最初の結果からバリアントを作成した。

そして、最後の画像をアップスケーリングした。

この最後の結果と、最初のプロンプトから生成された結果の1つを最終的に組み合わせてみたところ、その新しい結果がさらに興味深いものになった。

2つ目の結果を最後にもう一度アップスケーリングしてみると、どうだ!

私は、得られたすべての結果に本当に満足している。以下の一覧画像は、結局使わなかったものも含めて、私が生成したすべての画像に関するマップである。

それでは実際に歩んだ道のりを振り返ってみよう。

もし興味があれば、過去2週間に私が毎日探索した結果を共有している。自然、カリブ海の文化、SFとファンタジーのミックスに触発された私が構築している世界に関連するアイデアを視覚化しようとしたのだ。以下は、そのアイデア集を掲載したTwitterのスレッドへのリンクである。

I trained an Artificial Intelligence with Caribbean petroglyphs to generate visual ideas for my character concept.

Here are the results:#midjourney #midjourneyart #midjourneyai #artificialintelligence #generativeart #aiart #petroglyphs #caribbean @midjourney pic.twitter.com/KRFalILx4W— Manuel Sainsily ᯅ Futurist (GDC) (@ManuVision) May 28, 2022

私はカリブ海のペトログリフを使って人工知能を訓練して、キャラクターコンセプトに関するビジュアル的なアイデアを生成しました。

結果は以下のとおりです。

なお、ペトログリフとは岩石や洞窟内部の壁面に意匠や文字を刻んだ彫刻のこと。

ところで、アーティストの実際の仕事は以上のような共創で終わるべきではない、と私は考えている。以上はあくまでキュレーションの段階なのだ。もちろん、それだけでも面白いし、私はMidjourneyのウェブサイトやDiscordで、他のコミュニティが行った仕事を調べてインスピレーションを得るために多くの時間を費やしている。しかし、もっと面白いのは最終的に選んだ画像をProcreateやBlenderなどのツールに取り込んで、A.Iアートにインスパイアされた新しいスニーカーのペイントや3Dモデリングに挑戦することなのだ。このようなツールが存在するようになった以上、コンセプトアートはもはや過去と同じものでは永久になくなった。繰り返すが、私はこのツールが人々の仕事を奪うとは思っていない…むしろ拡張すると確信している。私自身、すでに中毒になっているし、これからも自分のアートを新たな高みへと導くために日々のプロセスの中でA.Iを使い続けていくつもりだ。

私の旅にお付き合いいただき、ありがとうございます。今日は何かインスピレーションを得たり、新しいことを学んだりできたでしょうか。何か質問がある場合、または単に私の仕事をフォローし続けたい場合は、ソーシャルメディア@manuvisionまたは私のウェブサイト (www.manu.vision)を介して、どうかご自由に私に連絡してください。私は必ず自分が歩んだ道をアイデアやヒントとして共有し続けるでしょう。

- Manuel Sainsily

・・・

参考文献:

この研究を行うきっかけとなった何人かの人々に感謝したい。

- Google Design Outreach ディレクターのNando Costa氏と彼のLinkedinの記事

- 現代版画家のDan Catt氏と彼のYouTube動画

- CGアーティスト Gleb Aleksandrov氏と彼のYouTube動画

- iMesh制作のYouTube動画

私の作品を応援してくださる方は、私がデザインしたグッツを取り扱うショップhttps://manu.vision/shopにアクセスしてください。

原文

『How YOU can co-create art with an AI using Midjourney』

著者

Manuel Sainsily

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん