画像出典:OpenAI記事

目次

はじめに

2023年3月14日、OpenAIは高度大規模言語モデルGPT-4を発表しました。この記事では同AIの性能、応用事例、安全対策、そしてリスク評価を解説することで同AIの全容を眺望します。

新時代のマルチモーダルモデル「GPT-4」の実力

GPT-4と(ChatGPTのベースモデルである)GPT-3.5の決定的な違いは、GPT-4には画像認識機能が実装されていることです。画像認識が可能になったことにより、例えば「食材が写った画像を認識して可能なレシピを提案する」のような画像からの推論に対応しました。

言語能力や推論能力に関しても、GPT-4はGPT-3.5と比較して向上しています。

各種テストから見るGPT-4の能力

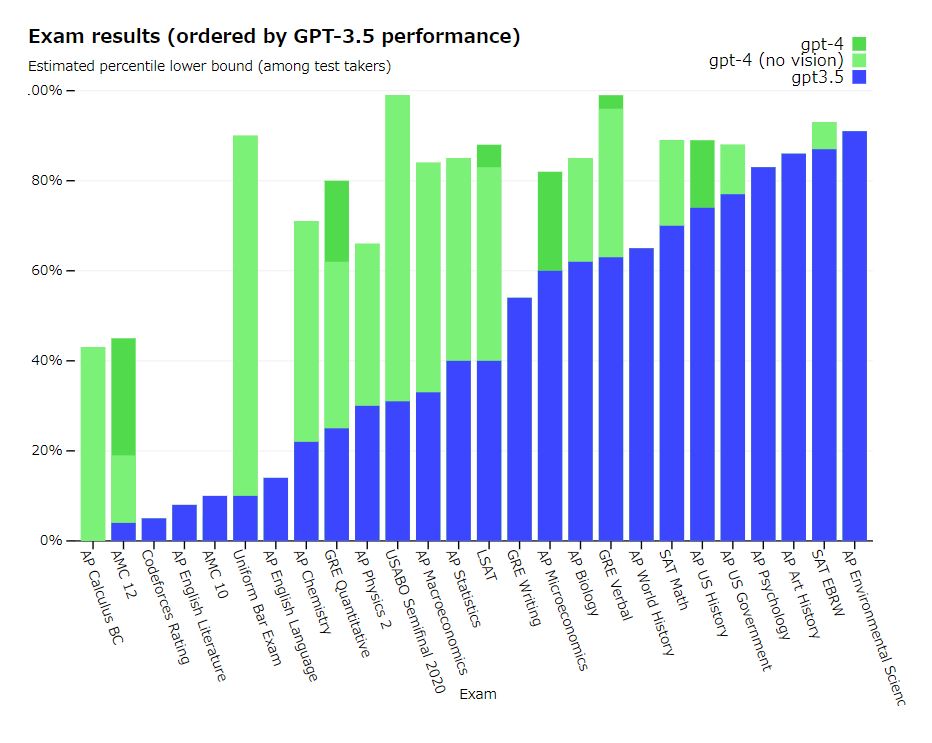

GPT-4解説記事にはGPT-4とGPT-3.5を比較するために実施した各種テストの結果がまとめられています。アメリカの司法試験をはじめとする人間が受験するテストをこれらのモデルに回答させた結果をまとめたのが、以下のグラフです。

GPT-4とGPT3.5のあいだで大きく性能差が認められたアメリカ司法試験では、前者は受験者の上位10%となりました。

各種テストの正解率からみるGPT-4とGPT-3.5の性能比較。画像出典:GPT-4解説記事

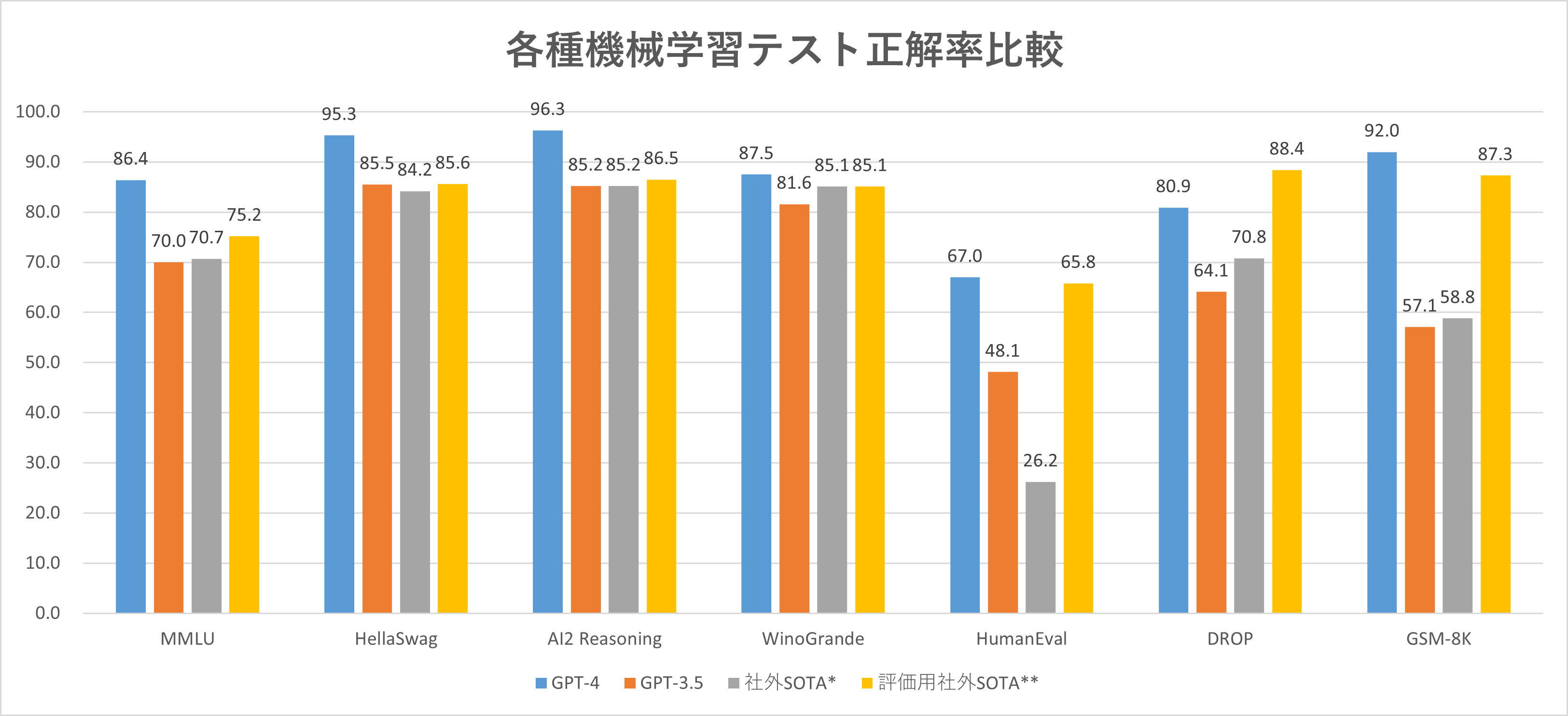

機械学習モデル用に設計されたベンチマークも実施した結果、以下のグラフに示すようにGPT-4はほとんどのベンチマークにおいてGPT-3.5およびOpenAI以外が開発したモデルの最高性能値を凌駕しました。

各種機械学習ベンチマークからみるGPT-4と既存モデルの性能比較。GPT-4解説記事をもとに著者がグラフ作成

「社外SOTA」とは、テスト用のファインチューニング未実施の既存モデルの最高性能値

「評価用社外SOTA**」とは、テスト用のファインチューニングを実施した既存モデルの最高性能値

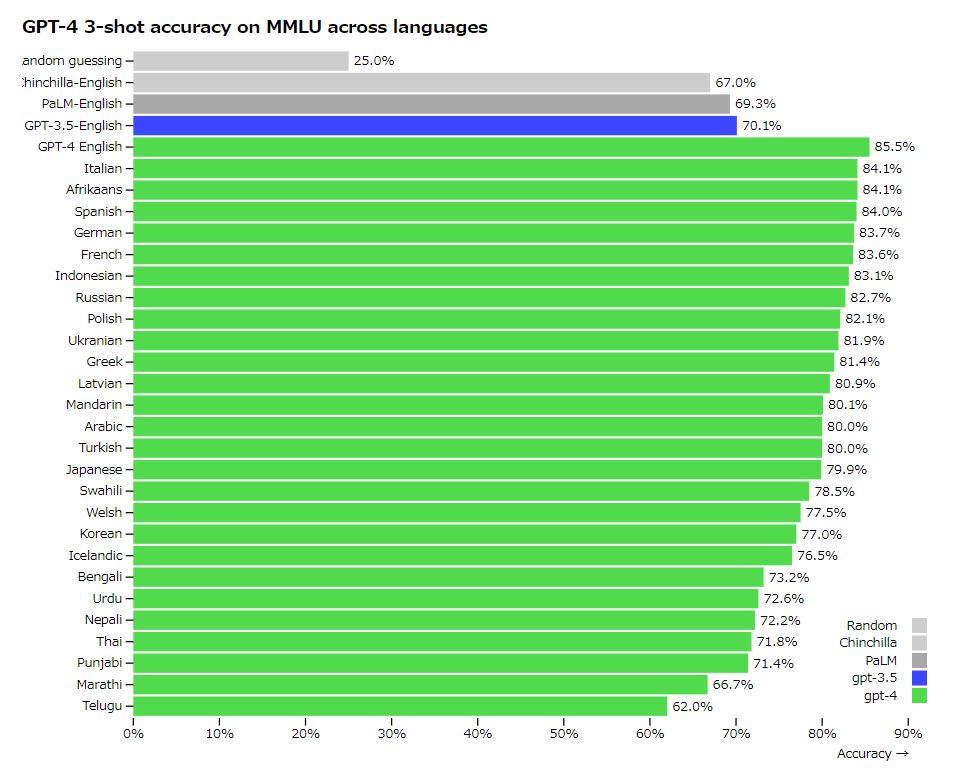

また、各国言語能力をテストするMMLUベンチマークを実施したところ、以下のグラフのように26ヶ国語中24ヶ国語においてGPT-4はGPT-3.5の英語能力を上回りました。例えば、GPT-3.5の英語能力は精度70.1%なのに対して、GPT-4の日本語能力は精度79.9%でした。

MMLUベンチマークにみるGPT-4と既存モデルの言語能力比較。画像出典:GPT-4解説記事

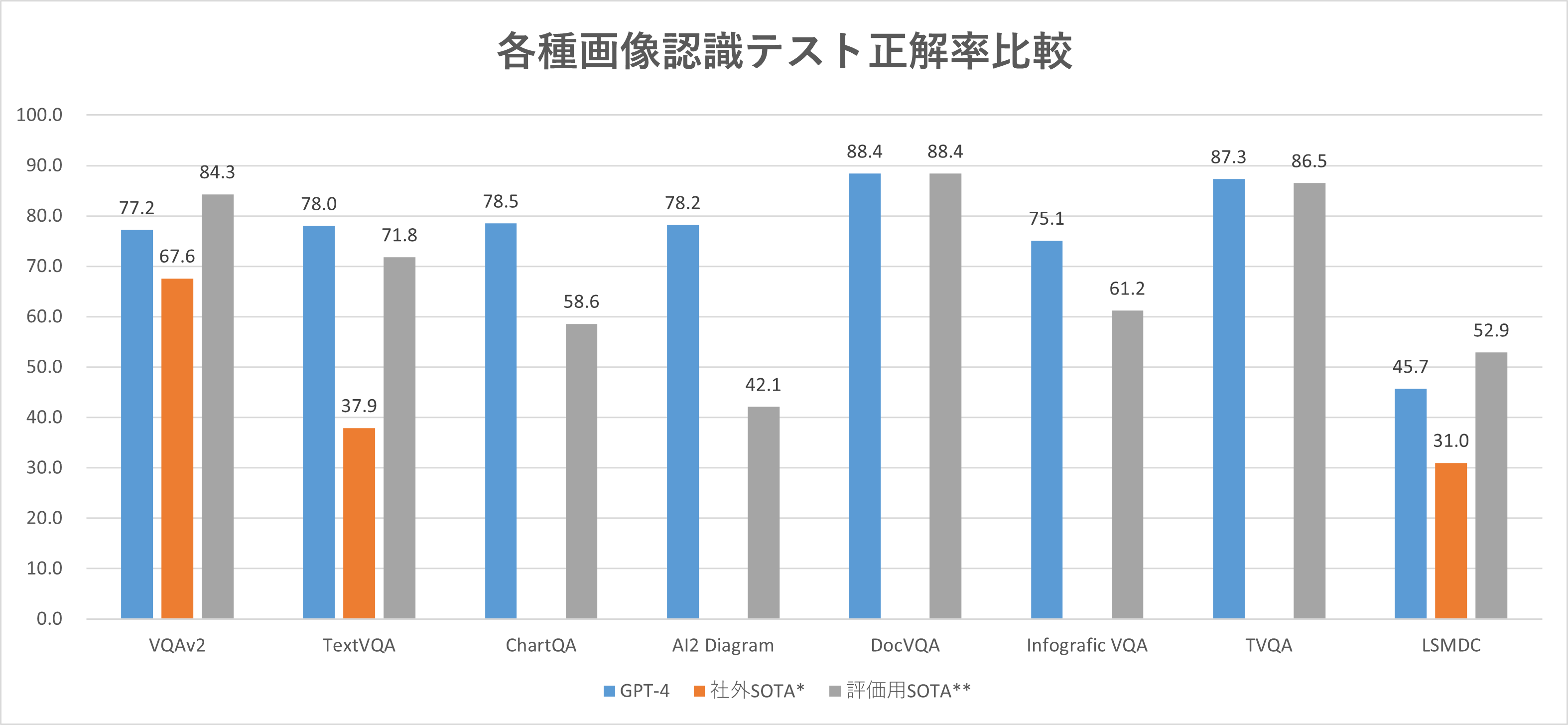

画像認識に関しても既存の学術的ベンチマークを実施したところ、以下のグラフに示すように、ほとんどのベンチマークで既存モデルを凌駕しました。

各種画像認識ベンチマークからみるGPT-4と既存モデルの性能比較。GPT-4解説記事をもとに著者がグラフ作成

「社外SOTA」とは、テスト用のファインチューニング未実施の既存モデルの最高性能値

「評価用社外SOTA**」とは、テスト用のファインチューニングを実施した既存モデルの最高性能値

画像認識によって可能となったこと

GPT-4は画像から認識した情報にもとづいて各種推論やテキスト生成を実行できるため、ChatGPTでは不可能だったタスクが可能となります。実行可能となったタスクに関して、GPT-4解説記事では以下のようなものを紹介しています。

「以下の画像で面白いところはどこか」という質問に対して、「旧世代の接続デバイスであるVGAコネクターを模したLightningケーブルであるところ」と回答します。こうした回答を生成するには、VGAコネクターが旧世代のコネクターであることなどの技術的知識とあえて旧世代の技術を使うのが一種のユーモアであることを理解している必要があります。

「コネクターのユーモア」をGPT-4に問う画像。画像出典:GPT-4解説記事

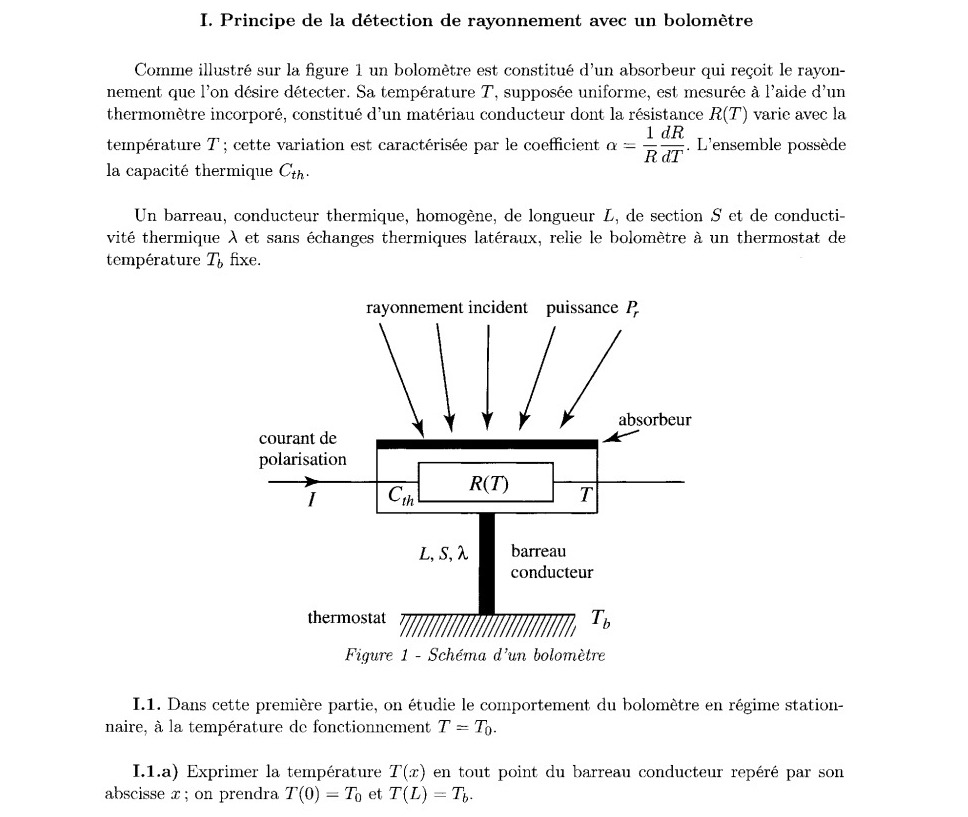

また、フランスの理工系高等教育機関エコール・ポリテクニークの試験問題を撮影した画像を入力として与えると、その問題に回答します。

エコール・ポリテクニークの試験問題を撮影した画像。画像出典:GPT-4解説記事

操作性のカスタマイズ

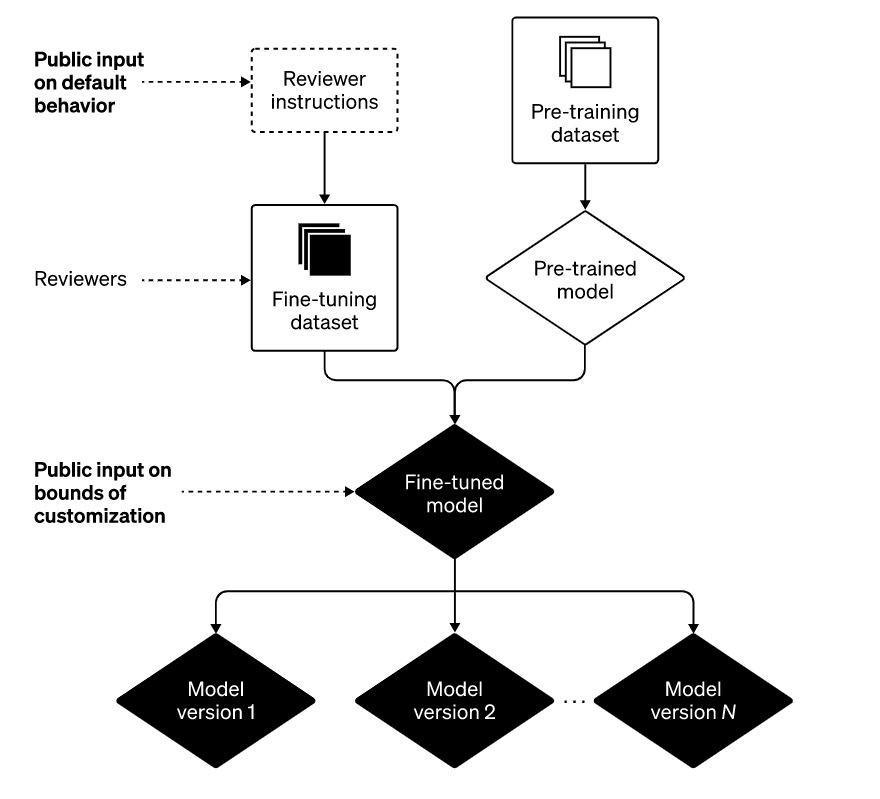

GPT-4は、AIの口調をカスタマイズ可能となっています。口調のカスタマイズについては、OpenAI公式ブログ記事『AIシステムはどのように振る舞うべきか、誰が決めるべきなのか?』で詳しく論じられているのですが、簡単に言えばユーザに合わせてAIを口調を変えたほうがUXが向上するというアイデアをGPT-4で実現しています。

GPT-4には基本となる口調がありますが、ユーザに合わせて(古代ギリシアの哲人)ソクラテス風に数学を教えたり、シェイクスピア調に税務処理を行うことが可能なのです。

GPT-4の口調のカスタマイズに関する概念図:画像出典:OpenAI公式ブログ記事

利用方法

GPT-4の利用方法は、2023年3月時点ではChatGPT Plusからの利用とAPIによる利用の2通りあります。

ChatGPT Plusとは有料版ChatGPTのことであり、月額20米ドルを支払うことでアクセス優先権の取得や新機能の試用が可能となります。もっとも、GPT-4に関してはアクセスに上限が設定されており、今後数か月のあいだに次第に上限を引き上げていく予定です。

GPT-4のAPIにアクセスするには、ウェイティングリストに登録する必要があります。アクセス可能となると、プロンプトトークン1kあたり0.03米ドルで利用できるようになります。ただし、1分間に40kトークン、200リクエストまでというレート制限があります。

GPT-4 APIアクセスプランには通常より大きなモデルとなるGPT-4-32kも用意され、こちらはプロンプトトークン1kあたり0.06米ドルです。

なお、GPT-4の画像認識機能は2023年3月時点では上記利用方法ではまだ利用できず、後述するOpenAIとアプリを共同開発したBe My Eyes社のみ同機能を活用しています。同機能の提供は、順次拡大していく予定です。

学習データとアーキテクチャは非公開

ところで新しい言語モデルが発表されると、モデルサイズが気になるところです。しかしながら、GPT-4に関してはモデルサイズ、学習データ、アーキテクチャ、学習環境といった主要なスペック情報は非公開としています。この事情に関して、GPT-4テクニカルレポートの「2 本テクニカルレポートの範囲と限界」では、以下のように説明されています。

本レポートではGPT-4 のような大規模モデル の競争環境と安全性を考慮し、アーキテクチャ(モデルサイズを含む)、ハードウェア、トレ ーニング計算機、データセット構築、トレーニング方法などに関する詳細な情報は記載して いない。

主要スペックを非公開としたことに関して、OpenAIチーフサイエンティストのIlya Sutskever氏はテック系メディア『The Verge』の2023年3月16日公開のインタビュー記事において、以下のような2つの理由を挙げています。

|

もっとも、AIを安全に開発するためにこそ「AI開発はオープンソースにするべき」というスタンスも主張可能です。このようなAI開発をめぐる情報公開の在りかたは、今後ますます議論されると予想されます。

GPT-4の応用事例

OpenAIはGPT-4の発表に先行して、一部の企業と同AIを活用したアプリを開発していました。そうしたアプリはGPT-4紹介記事で言及されており、以下ではその一部を紹介します。

視覚障がい者に代わって世界を見てくれる「Be My eyes」

2012年創業のAIスタートアップBe My eyesは、視覚障がい者をサポートする画像認識モバイルアプリBe My Eyesを開発・提供しています。同アプリは、GPT-4の導入によってより実践的なサポートが可能となりました。例えば食材を画像認識すると、その食材が何であるかをユーザに伝えるのに加えて、その食材から調理できるメニューの情報も提供するようになったのです。

Be My Eyesを使っている様子。画像出典:GPT-4活用事例記事

視覚障がい者にとってディスプレイの情報を知るのは、困難な作業です。現在ではディスプレイに表示されたテキストを読み上げる機能がありますが、ショッピングサイトのような類似した情報が羅列されているウェブページをテキスト読み上げから理解するのは難しい場合があります。こうした課題に対して、Be My EyesはGPT-4を活用して情報を要約して重要な箇所だけ読み上げるというソリューションを実現しました。

生徒に問いかけるKhan Academyの「Khanmigo」

オンライン学習講座を提供するKhan Academyは、GPT-4を活用した教育用AIアシスタント「Khanmigo」を発表しました。同AIは、生徒に問題に関する問いかけをすることで生徒に問題に対するより深い理解を促します。例えば「なぜそのように答えたのか」「もしそのような答えならば、どうなるのか」と問いかけることで、問題の背景にある概念に注意を向けさせるのです。

Khan Academyは、教師がGPT-4を活用できるにすることにも取り組んでいます。例えば教材をプロンプトを入力するだけで作成できるようになれば、教師の負担は軽減されるでしょう(注釈1)。

YouTubeで公開されているKhan AcademyのGPT-4活用を解説する動画では、同AI活用のさまざまなアイデアが語られています。そのなかには、生徒が歴史上の人物との会話を通して歴史を学ぶ、教師と生徒が一緒に学習計画を立案するといったことがあります。

言語能力と検索が融合した「Bing AI」

GPT-4発表と同日の2023年3月14日、MicrosoftはBingの会話機能にGPT-4を活用したことを明らかにした記事を公開しました。この記事によりBing AIは検索とGPT-4が融合したアプリであることが判明しました。

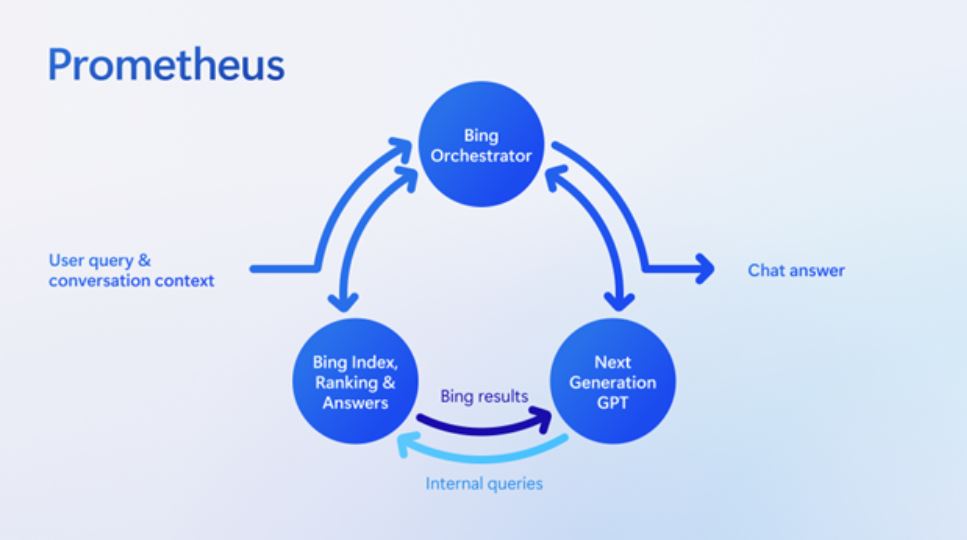

Bing AIにおける言語能力と検索の連携については、Microsoftが2023年2月28日に公開した記事『新しいBing の構築にあたって』で解説されています。この記事によると、Bing AIは検索エンジンとしてのBingが取得した情報をGPT-4に渡した後、同AIがチャット形式の回答を生成します。こうした検索と回答生成の連携技術は、Prometheus(人類に火を与えたギリシア神話の神にちなんで命名と推測)と呼ばれます。

Prometheusテクノロジーの模式図。画像出典:Microsoftニュース記事

Bing AIのような検索と回答生成が連携するアプリは、今後さまざまなものが開発されると考えられます。ChatGPTが発表された当初、Googleが覇権を握る検索ビジネスは終焉するのではないかという予想が語られましたが、GPT-4のような高度な会話AIの登場によって検索は新次元に進化するのかも知れません。

GPT-4の制限事項と安全対策

大規模言語モデルは、事実とは異なる情報を事実のように語る「幻覚(hallucination)」や差別的な内容を含む回答を生成するバイアスといった欠点を抱えています。こうした欠点に関して、GPT-4の開発では以下のような取り組みがありました。

幻覚

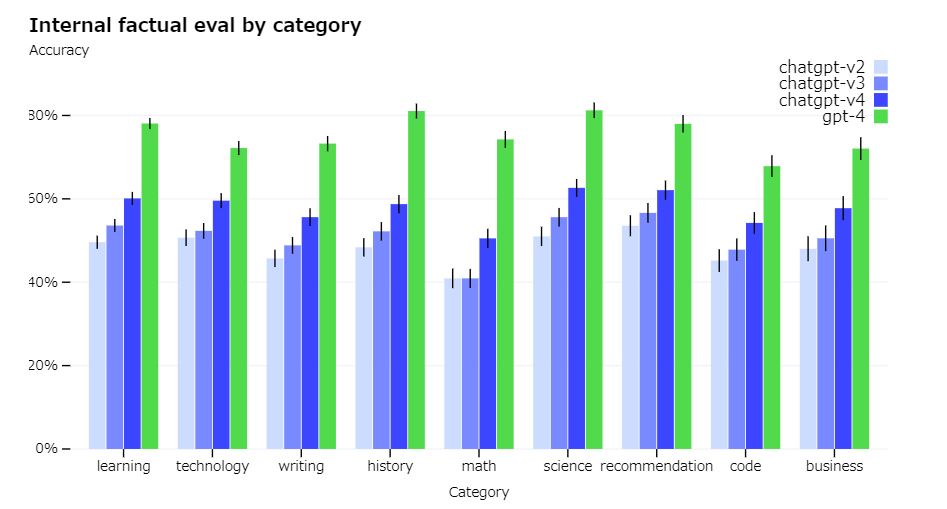

幻覚に関して「学習」や「技術」を含む9つのカテゴリーにおいて、ChatGPTV2~V4とGPT-4が生成する回答のファクトチェックをOpenAIで実施したところ、GPT-4がもっとも事実と合致する回答を生成していることが判明しました。

GPT-4とChatGPTを対象としたファクトチェック結果をまとめたグラフ。画像出典:GPT-4解説記事

もっとも、GPT-4が幻覚を含む回答を生成する可能性は依然として存在するので、重要な判断において同AIの回答を活用する場合、人間の専門家によるファクトチェックを行う等の対策が不可欠となります。

敵対的な質問

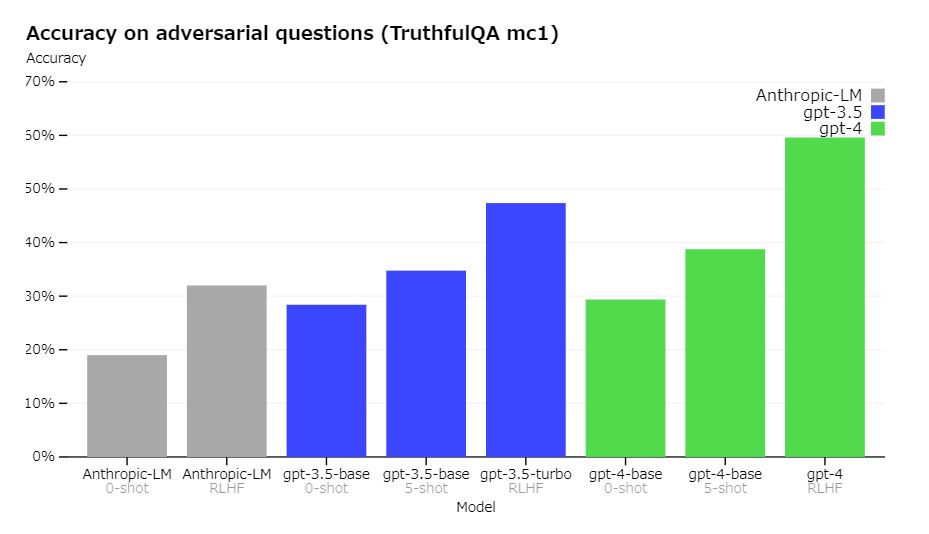

言語AIの倫理的性能を測定するベンチマークにはTruthfulQAがあります。このベンチマークは、誤った信念や誤解を抱いていると誤答するような質問集です。それゆえ、このベンチマークで正解するためには人間の文章をまねて回答を生成するのではなく、正しい信念を論拠とする必要があります。

GPT-4とGPT-3.5をはじめとする既存モデルに対してTruthfulQAを実施したところ、GPT-4がもっとも高いスコアを記録しました。この結果は、GPT-4がもっとも偏見の少ない回答を生成できることを意味しています。

GPT-4と既存モデルにTruthfulQAを実施した結果をまとめたグラフ。画像出典:GPT-4解説記事

より高度なリスク評価

GPT-4の発表にあたっては、幻覚やバイアスのような既知のリスクに加えて一見すると荒唐無稽なように思われるリスクについても検討しています。こうした杞憂に終わるかも知れない慎重なリスク評価を行う背景には、OpenAIが考えるAGI開発ポリシーがあります。以下ではこうしたポリシーを確認したうえで、より高度な安全対策に言及します。

「時間をかけて着実に進める」AGI開発ポリシー

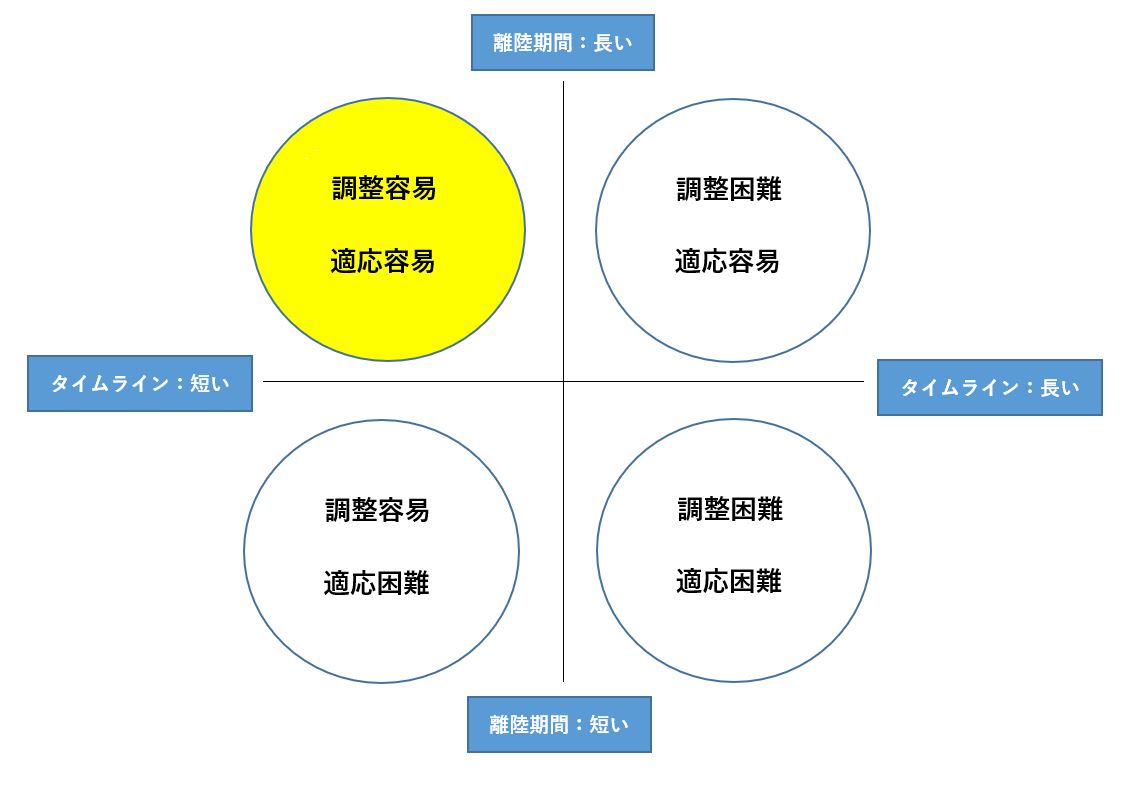

OpenAIのAGI開発ポリシーは、同機関のCEOであるSam Altman氏が執筆した2023年2月24日公開の公式ブログ記事『AGIとそれ以降のプランニング』で論じられています。AGIの実現を標榜する同機関は、その目標を達成するにあたりプロジェクトを「タイムライン」と「離陸期間」という2つの評価軸から考察します。

AGI開発プロジェクトにおけるタイムラインとは、AGIを実現するまでに行うアップデート等の改良作業全般の履歴とその頻度を意味します。タイムラインが短い場合、アップデートは頻繁に繰り返されるのでプロジェクトの軌道修正が容易となります。対してタイムラインが長いとアップデートが少なくなるので、軌道修正が難しくなります。

AGI開発における離陸期間とは、AGIを実現するまでに費やす時間を意味します。離陸期間が短いと、人類はAGIの影響力を十分に理解できないままにAGIを使わざるを得なくなります。反対に離陸期間が長いと、AGIを十分に理解したうえでの実用化が可能となります。

AGI開発プロジェクトの在りかたを考えるに当たっては、タイムラインの長短と離陸期間の長短の組み合わせにより4つのタイプが想定されます。Altman氏によれば、望ましいAGI開発プロジェクトとは「タイムラインが短く離陸期間が長い」ものとなります。このタイプのプロジェクトは、軌道修正が容易であると同時にAGIを理解する時間的猶予が十分に確保できるものとなります。この開発方針をふまえれば、GPT-4はAGI実現までの長い道のりの一歩に過ぎず、今後もアップデートを繰り返すことがわかります。

OpenAIのAGI開発ポリシーの特徴を示した2軸マトリクス。画像出典:OpenAI公式ブログ記事にもとづいて著者が作成

以上のようなAGI開発ポリシーを遵守したうえで、OpenAIは以下のような事項に留意することを約束しています。

|

GPT-4はGPT-3と比較して、着実にAGI実現に近づいたAIと言えます。それゆえ、GPT-4のリスク評価に関しては、GPT-3では想定されていなかったリスクについても考慮すべきなのです。

SF的なリスク評価

GPT-4のテクニカルレポートに結合しているGPT-4のシステムカードでは、現実に生じているわけではないが生じる可能性のあるリスクが考察されています。こうした言わば「SF的(Science FictionあるいはSpeculative Fiction)」なリスクとして、以下では5項目を紹介します。

|

以上に挙げた高度なリスクは、GPT-4が社会に普及するにつれて顕在化する可能性が高いものです。これらのリスクによる悪影響を最小限に抑制するためにも、GPT-4を活用する開発者およびユーザはリスクの存在を認識することが重要でしょう。

まとめ

GPT-4は言語能力と画像認識が高度に連携する初めての高度マルチモーダルモデルであり、同AIの普及が進めば、多くの産業や労働者がその恩恵を受けることでしょう。しかしながら同AIは万能ではなく、時として間違いを犯し、さらには新たな社会問題を引き起こすとも考えられます。

GPT-4を活用する開発者およびユーザにとって大切なことは、同AIの正負両面の特徴と影響を理解することではないしょうか。同AIに対する正しい理解があれば、誤用を回避し、新たな社会問題を直視して解決に取り組めるようになるはずです。

そして(AINOWを含めた)メディアは、GPT-4の正負両面を正しく伝える責務が課されています。AINOWは、今後もGPT-4およびAI全般に関して批判的に報道していきます。

記事執筆:吉本 幸記(AINOW翻訳記事担当)

編集:おざけん