株式会社ChillStackと三井物産セキュアディレクション株式会社は、AIを安全に開発・提供・利用できる社会を実現するため、AIを守る技術に関する共同研究を開始しました。

近年、AI技術の発展に伴い、日本国内においても顔認証システムや防犯システム、自動運転技術など、さまざまな分野でAIの社会実装が進んでいます。その一方で、AIに対する攻撃手法も数多く生まれ、防御技術の確立が急務となっています。しかし、AIに対する攻撃手法は既存システムに対する攻撃手法とは根本的に原理が異なるものが多く、従来のセキュリティ技術で対策することは非常に困難です。

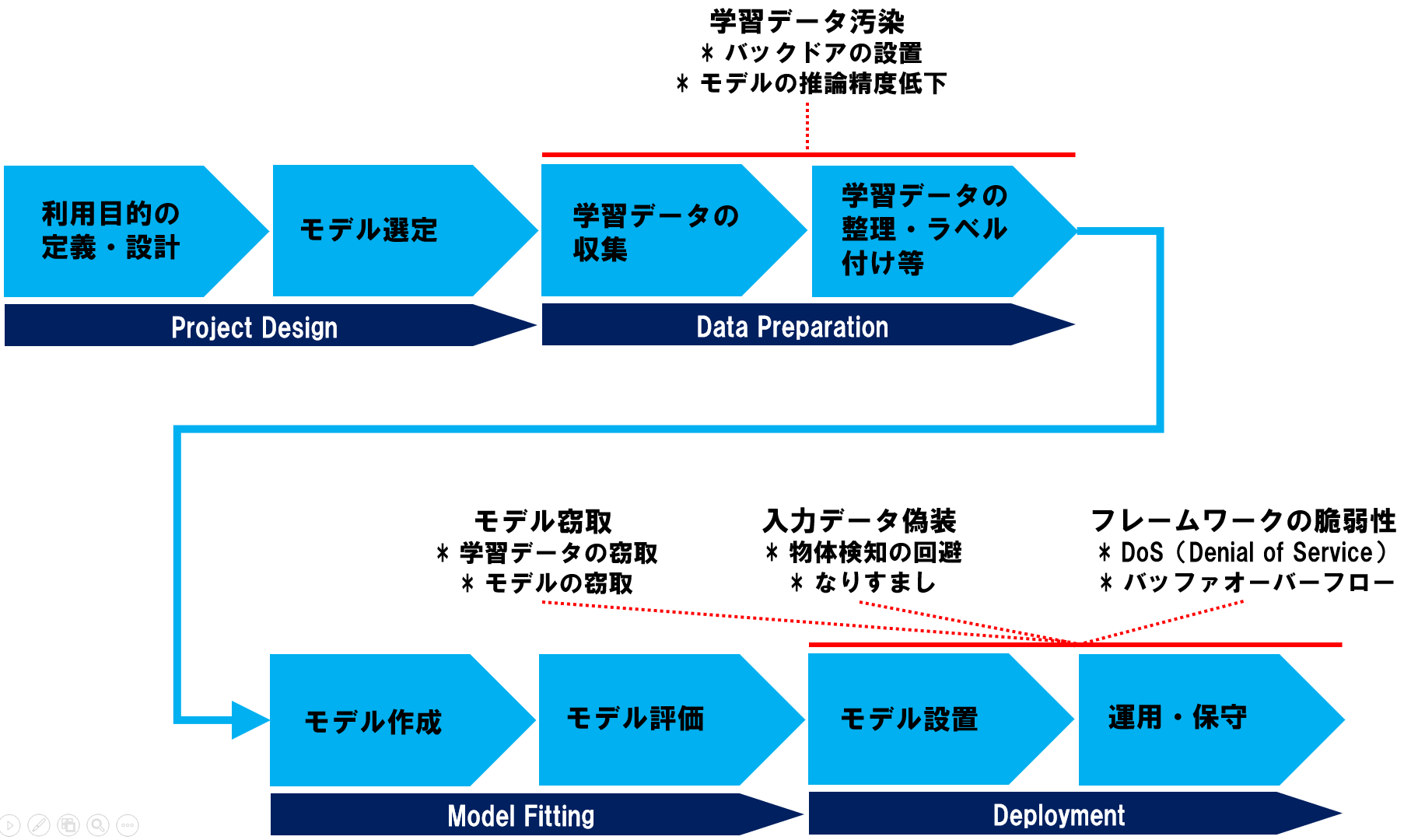

下図は、AI開発の工程と、各工程で想定される脅威の一例を示しています。

各開発工程でセキュリティを考慮していない場合、攻撃者が細工したデータが学習データに注入されることで、AIにバックドアが設置されてしまう問題や、AIの入力データが偽装されることで、AIの判断に誤りが生じる問題等が顕在化するおそれがあります。

そこで、この共同研究では既知の攻撃手法の検証と体系化を行いながら、新規の攻撃手法と防御技術の研究も同時に進めていきます。

また、実証実験の結果等を元に、AIの安全を確保する技術を普及する活動の1つとして、「一からAIの安全確保技術を習得」できるハンズオン・トレーニングを開発・提供します。

2020年5月頃から、下記内容のハンズオン・トレーニングを提供開始する予定です。

- AIを騙す攻撃

人間には識別できない小さな変化を加えたデータを使用し、AIを意図的に騙す攻撃手法と対策を学びます。 - AIを乗っ取る攻撃

AIが学習するデータセットを汚染し、AIにバックドアを仕込むことでAIに意図した挙動をさせる攻撃手法と対策を学びます。 - AIシステムへの侵入

機械学習フレームワークの仕様を悪用し、システムへ侵入する攻撃手法と対策を学びます。

なお、ハンズオン・トレーニングの内容を随時アップデートしながら、機械学習未経験者向けやAIセキュリティ上級者向けのトレーニング教材も今後提供していく予定です。

ChillStackと三井物産セキュアディレクションは、セキュアなAIを構築する支援を通じて、AI技術の発展に寄与していくとしています。

慶應義塾大学商学部に在籍中

AINOWのWEBライターをやってます。

人工知能(AI)に関するまとめ記事やコラムを掲載します。

趣味はクラシック音楽鑑賞、旅行、お酒です。