2022年になってテキストから画像を生成するAIが大流行するなか、Lanham氏もStable Diffusionを導入しました。同AIの導入方法はいくつかあるのですが、同氏が行ったのはHugging Faceを経由する方法でした(導入方法の詳細は以下の本文を参照)。

実際にStable Diffusionを使って画像を生成した経験をふまえて、Lanham氏は入力プロンプトを作成する秘訣として以下のような4項目を挙げています。

Stable diffusionのプロンプトを作成する4つの秘訣

|

以上のように秘訣を述べた後、Stable diffusionをはじめとしたテキスト画像生成AIは商業アーティストの仕事を支援し、革新的なアートを創造する助けとなるかもしれない、とLanham氏はこれらのAIを肯定的に評価して記事をまとめています。

以下の記事本文におけるプロンプト入力文には、翻訳文に加えて英語原文も併記しています。英語原文をStable Diffusionの入力プロンプトとして渡して、生成画像を確かめることもできるでしょう。

なお、以下の記事本文はMicheal Lanham氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

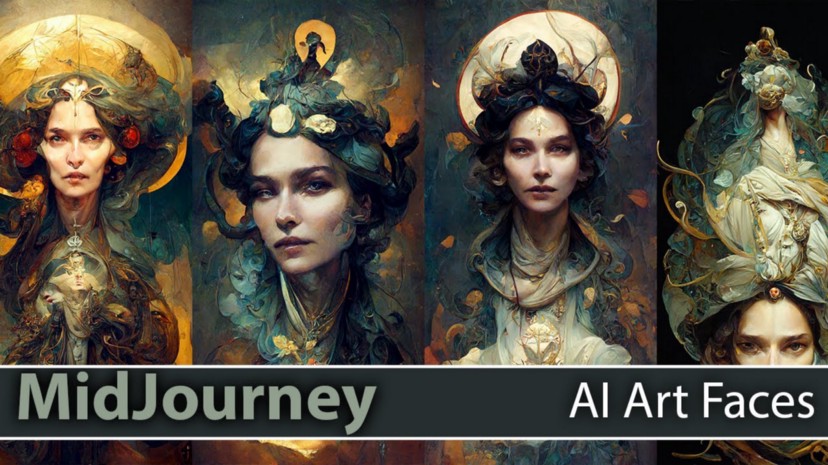

MidJourneyで生成したシュールかつアーティスティックな顔の画像事例

前書き

テキスト画像生成は、急速にAIの次の大きな流れになりつつある。Dall-E、Dall-E 2、Imagen、Parti、MidJourenyなど、すでに耳にしたことがある読者も多いのではないだろうか。

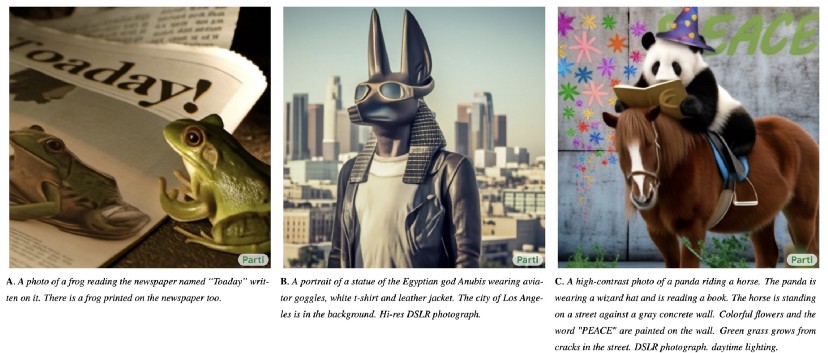

Pathways採用の自己回帰型テキスト画像生成モデルであるGoogle Partiは、この新しい AI の展望における現在のリーダーである(※訳註1)。しかし、このモデルは厳重にクローズされたベータ版製品であるため、アクセスはかなり限られている。そうは言ってもこの比較的新しいAIコンテンツ生成の分野は、急速かつ高度に商業化されつつある。より優れた性能のモデルの多くは、有償のサービスを通じてのみアクセス可能だ。

Google Partiで生成した画像事例と(生成に使われた)プロンプト事例

なお、PathwaysについてはAINOW特集記事『Google I/O 2022で発表された最新自然言語処理技術まとめ』の「新たなAI設計思想「Pathways」とは」も参照のこと。

Stable Diffusionに参加する

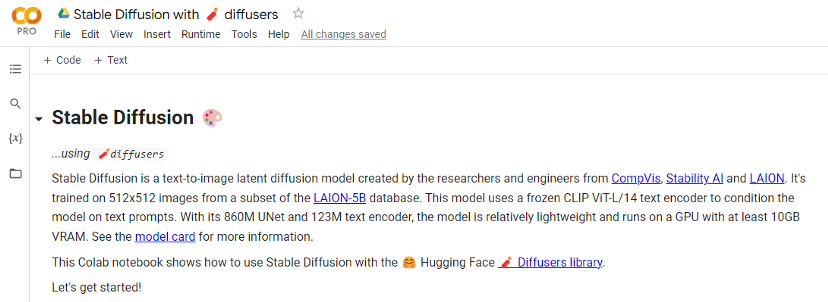

ところで最近になってStable Diffusionという新しいテキスト画像生成器が、個人でも商用でも使えるオープンソースとしてリリースされた。この新しい技術は、現存する同種の最高のモデルに匹敵するだけでなく、完全に無料で、Google Colabのようなプラットフォームで簡単に実行できる。

Hugging Faceは、同社のGitHub上のDiffusersプロジェクトに組み込むことで、Stable Diffusionでの作業と理解を非常に簡単にしている。このリポジトリには、DiffusionモデルやStable Diffusionを使ったデモを行うGoogle Colab Pythonノートブックが大量にある。

Stable Diffusionを用いた画像生成

Stable Diffusionを使い始めるには、Diffusersリポジトリに行き、サンプルのColabノートブックを1つ開くだけと簡単だ。

Stable Diffusion を使ってテキストから画像を生成してみたいという読者は、以下のURLのノートブックから始めるとよいだろう。

https://colab.research.google.com/github/huggingface/notebooks/blob/main/diffusers/stable_diffusion.ipynb

Google Colab上で動作するStable Diffusionノートブック

ノートブック内の各セルを実行するための手順は、しっかりと文書化されている。Hugging Face Hubに認証されてスケジューラーとモデルをダウンロードしインストールするには、ノートブックにあるいくつかのセットアップセルを実行するだけだ。

Hugging Face Hubでアカウントを作成し、認証のためのトークンを生成する必要があるが、このプロセスは導入文書でよく説明されている。

ノートブック内のHugging Face Hubへの認証

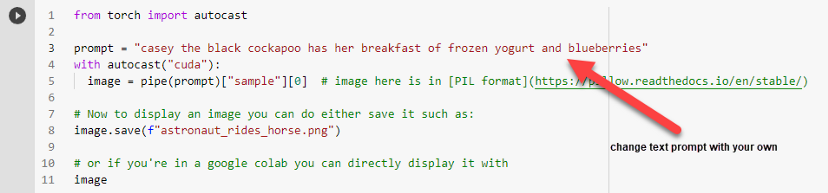

モデルをダウンロードし、パイプラインを作成した後、コードセルのテキストプロンプトを変更することで、画像を生成するためのテキスト入力を開始できる。後は文字列変数プロンプトのテキストを入れ替えて、セルを実行するだけだ。

ノートブックのコードセル、プロンプト文字列を変更するだけ

以下では、「フローズンヨーグルトとブルーベリーの朝食をとる黒いコッカープー(※訳註2)のcasey(casey the black cockapoo has her breakfast of frozen yogurt and blueberries)」という文章から生成された画像事例を紹介する。

テキストプロンプトから生成された画像 - 「フローズンヨーグルトとブルーベリーの朝食をとる黒いコッカープーのcasey(casey the black cockapoo has her breakfast of frozen yogurt and blueberries)」

画像にはヨーグルトがないが、それ以外はテキストの内容を首尾よく複製している。もちろん、このモデルは同じプロンプトを使用した以下の例のように、まとまりのない画像を生成して失敗することがある。

「フローズンヨーグルトとブルーベリーの朝食をとる黒いコッカープーのcasey(casey the black cockapoo has her breakfast of frozen yogurt and blueberries)」画像 - Stable Diffusionによって生成

実際、ほとんどの場合、同じプロンプトから複数の画像事例を生成することが最善だ。前述したノートブックのさらに下に、同じプロンプトに対して複数の出力を生成するためのコードを見つけられる。

すべてはプロンプトにあり

一夜にして、テキスト画像生成に関する熱狂的なコミュニティが生まれた。コミュニティフォーラム、YouTubeチャンネル、商業プラットフォームが、あるモデルが持つそれとは別のモデルに対するメリットを議論している。これらの比較の多くは、同じテキストプロンプトに対する出力を比較することによって行われている。

これらの新しいAIモデルを効果的に使用するための秘訣は、結論から述べればキーフレーズを含む説明的なテキストプロンプトを作成することにある。一般的に、プロンプトは説明的であればあるほど良い結果をもたらすが、(Stable Diffusionに関しては)以下の基本的なルールに従うこともできる。

- 詳細で長い説明を提供する - 概して良い説明ほど良い出力になる。説明には可能限り多くのディテールが含まれるようにしよう。

- たくさんの画像事例を作成する - 必ず同じプロンプトで複数の画像を作成しよう。また、既知のシードを使用して入力済みプロンプトの画像を生成するのも役立つ。シードの扱い方を示した素晴らしいノートブックは以下: https://colab.research.google.com/github/pcuenca/diffusers-examples/blob/main/notebooks/stable-diffusion-seeds.ipynb

- スタイルを必ず含める - Stable Diffusionは、ビンテージ写真、3Dレンダリング、木炭スケッチなどさまざまなスタイルの画像を生成できる。テキスト入力には、必ず画像のスタイルを含めよう。

- 他のプロンプトを利用する - Stable Diffusionは、テキストと一緒にベース画像やシードをプロンプトとして入力する機能を備えている。この機能により、出力に焦点を当てて一貫性のある画像を作成できる。以下の画像は、テキストプロンプトとこのノートブック(https://colab.research.google.com/github/patil-suraj/Notebooks/blob/master/image_2_image_using_diffusers.ipynb)の黒いコッカプーの画像を入力して生成された事例である。

プロンプトから生成されたStable Diffusion画像の事例 - 「白い髭と胸を持つ黒いコッカープーのcasey、木炭画のスタイルで(Casey the black cockapoo with a white beard and chest in the style of a charcoal sketch)」

テキストプロンプトの使い方については、YouTubeやさまざまなコミュニティフォーラムで、もっとたくさんのアドバイスやヒント、トリックを見つけられる。以下の動画にあるように、プロンプトを書くための新しいAIが開発されることさえあるのだ。

アート作品やその他の応用事例を作成する

つい最近、コロラド州の品評会で、テキスト画像生成モデルがファインアートのコンペティションで1位を獲得したという報道があった(※訳註4)。この受賞はもちろん、著作権侵害や芸術的才能の切り捨てなどさまざまな理由から不当であるとして、多くのアート関係者の怒りを買っている。

Allen氏は受賞した作品『空間的オペラ劇場(Théâtre D’opéra Spatial)』を含めて3点の画像を出品したが、受賞作の生成に使ったプロンプトを公表していない。また、各出品作品の販売価格は750ドルに設定されているが、この価格は80時間という制作時間に見合ったもの、と同氏は語っている。

(AIによってテキストから生成された画像はアートなのかという)この議論は今後数年間続くだろうが、なぜ議論すべきなのかという問いかけも投げかけている。なぜテキストプロンプトから画像やアートを作成する必要があるのだろうか。

もちろん、この技術を使って開発できる応用事例としてロゴ、コンセプトアート、絵コンテなどさまざまある。このような技術の急速な進歩を目の当たりにして、商業アーティストは神経質になっているだろうが、そんな彼らにも新たなチャンスがあるかもしれない。

「油彩風のフローズンヨーグルトとブルーベリーの朝食をとる黒いコッカープーのcasey(a oil painting of casey the black cockapoo eating blueberries and yogurt for breakfast)」

将来的には商業アーティストが、テキスト画像生成AIを日々の仕事を使えるように訓練されるかもしれない。さらに革新的なアートの創造を支援することも可能になるかもしれない。すでにこうしたAIを活用するPhotoshopやその他のアプリに関するプラグインが開発されている。

いずれにせよ、AIや商業アートに興味のある読者は、テキストから画像への変換の仕組みを理解することが、今後の活躍に欠かせないかもしれないだろう。

原文

『Creating Fine Art with Stable Diffusion』

著者

Micheal Lanham

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん