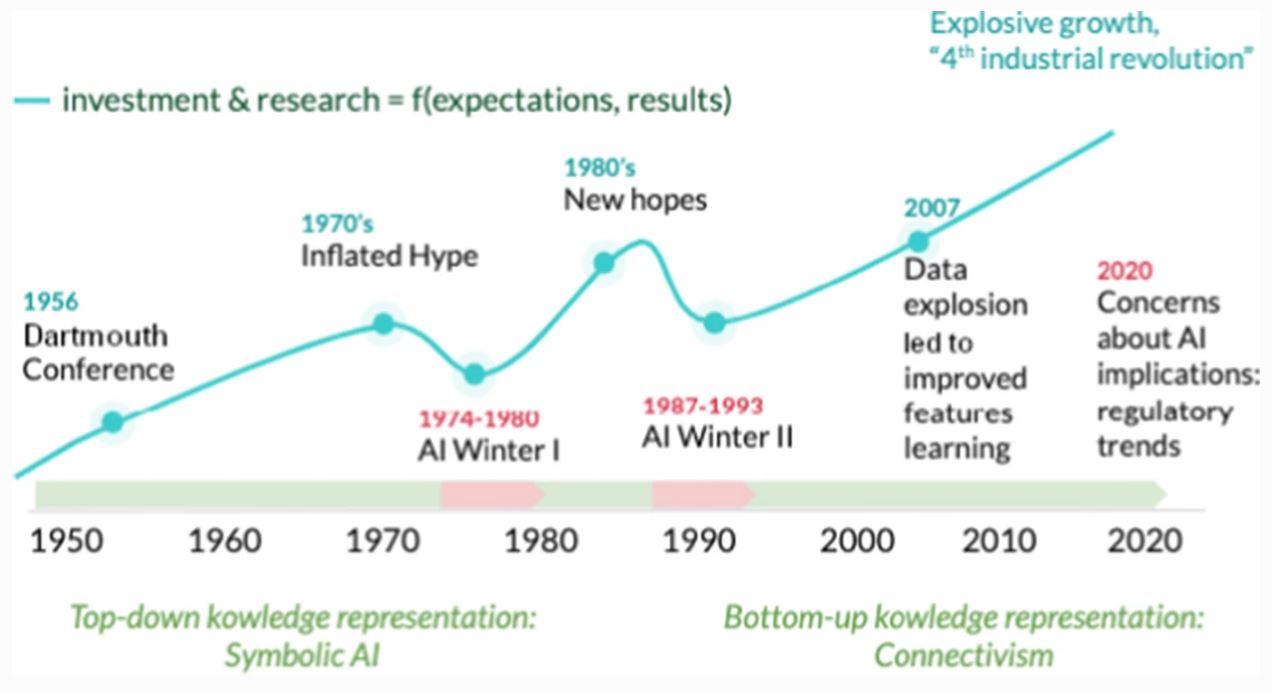

周知のようにAIの歴史においては、過度に期待されたがゆえに大きな幻滅を招いた「AIの冬」が2回ありました。その後、2010年代になってディープラーニングが実用化されたことで、AIは3度目のブームを迎え現在に至っています。

依然として夏の最中にいるように思われるAIに関して、Thompson氏はあえてこのブームが終わる可能性を検討してみました。ChatGPTに象徴されるような大規模言語モデルは、時として誤答してしまうことが問題視されています。また自動運転車はいまだに実用化されていないこともからわかるように、現在のAIにも欠陥や過大評価があります。

しかしながら、以上のような問題があったとしても、現在のAIは画像認識や分類において比類ない能力を発揮することには変わりません。このように特定の分野で社会に大きく貢献できることが実証されているので新たな冬を迎える可能性は低い、とThompson氏は述べています。もっとも、ディープラーニングが修正されたり、新たな基礎技術が誕生したりする余地はある、とも語っています。

ちなみに日本では第3次AIブームをけん引してきた松尾豊教授が、ChatGPTの普及が始まった2023年をもって「第4次AIブーム」が到来したと発言しました。このブームは当分のあいだ続くと予想されると同時に、今までのAIブーム以上に世界を変革するかも知れません。

以下の翻訳記事本文では、読み易さを考慮して、便宜的に見出しをつけました。英語原文では見出しはなく、3点リーダー「・・・」で区切られているのみです。

なお、以下の記事本文はClive Thompson氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

画像出典:UnsplashのRodion Kutsaievより

過大な約束と過小な成果を出すAIパイオニアに歴史は優しくない

冬は近づいているのだろうか。

私が語るのは、もちろん「AIの冬」のことだ。

「AIの冬」とは、AIの歴史に見られるバブルとその破裂のサイクルの一部である。AIブームのあいだは、コンピュータ科学者や企業がエキサイティングでパワフルな新しい技術を発明する。テック企業はその技術を使って、人々の生活をより簡単に(あるいはより生産的に)することを約束する製品を作り、投資家は資金を湯水のように放出する。夢見がちなジャーナリストも含め、誰もがAIに過剰な期待を抱き、発明されるであろう人工的なスマートさを喧伝し始める。このAIは人間のようだ!いや神のようだ!全知全能だ!

しかし、そのような誇大な宣伝が続くわけもなく、ある時点からAI業界は過小評価されるになる。AIは驚くほど失敗が多いことが判明するのだ。日常的な問題を解決するためにAIを使おうとする企業や人々は、AIがエラーを起こしやすいことに気づくが、そんなエラーはしばしばごくありふれたものなのである。

そして、「AIの冬」が始まる。顧客はAI製品に大枚をはたくのをやめ、投資家は財布の紐を締める。ジャーナリストはより批判的にAIを評価し始める。そして、誰もが火傷を負った(あるいは恥をかいた)と感じるため、事態は過度にネガティブなサイクルに突入してしまう。AIの新しい道を切り開こうとするコンピュータ科学者や発明家でさえ、それを追求するための資金を簡単に得られない。この状態が何年も続く。

これまでAIの大きな冬は2回あった。以下は、そんな冬を図示したグラフだ…

画像出典:Enrico Francesconi著「法律における人工知能の冬、夏、そして夏の夢」より

1956年、ダートマス大学で開催されたワークショップで、AIの著名人たちが「学習や知能のあらゆる側面は、機械でシミュレーションできるほど正確に記述できる」と予言したのがAIの歴史の始まりである。その後、20年近くにわたる研究が行われたが、その過程で目まぐるしい変化があった。 ニューヨーク・タイムズ紙が海軍の研究するニューラルネットを初めて報じたとき、記者は「海軍が期待する電子コンピュータの胎動は、歩く、話す、見る、書く、自己複製する、自分の存在を意識できるようになるだろう」と表現した。この初期の好況の中で企業やコンピュータ科学者は、テキストの自動翻訳というアイデアに特に心を奪われていた。もしそれが実現できれば、何十億ドルもの価値があるだろう。

しかし、コンピュータ科学者はそれを実現できなかった。さらに70年代初頭には、それらの原型となる初期段階のAI技術を使ってでは約束されたことを実現できないことも明らかになった 。当時の機械翻訳は手書きの規則で構成された不便なもので、中程度の複雑さの文法にさえ対応できなかった。自己学習する機械?まだSFに過ぎない。こうしてAIの冬が到来し、投資家は逃げ出し、研究費は枯渇した。

春が来たのは80年代に入ってからである。その頃にはほとんどのテック企業が「自己学習」マシンを作るようなうたかたな夢をあきらめ、代わりに「エキスパートシステム」を作っていた。これは、以前のAIほど野心的なものではなかった。それはある特定の問題に対する(そしてその問題だけに通用する)意思決定を自動化しようとする複雑な「if-then」型の計算機であった。例えば、VISAはクレジットカードの申請を自動で承認するシステムを、航空会社は飛行機のルートを自動で決めるシステムを作った。

エキスパートシステムには実際に動くという利点があった。しかし、その構築には途方もなくコストがかかり、しかもそれぞれが一点ものだった。さらに悪いことに予期せぬエッジケースにぶつかると、壊滅的な失敗をした。以前、クレジットカードの申請システムで申請書に(明らかにすべて嘘であるが)20年分の職歴が記載されていたため、9歳の子供に誤ってクレジットカードを発行してしまったという話を聞いたことがある。プログラマーは、「職歴」が「顧客の年齢」よりも長いかどうかを確認するルールを作るのを忘れていたのだ。これが手作りルールの問題点である。現実の世界はあまりにも複雑で、すべてをカバーできない。「エキスパートシステム」の失敗が明らかになるにつれ、もう1つのAIの冬が到来した。

・・・

第3次AIブームの勃興と隆盛

私たちは今、3回目のビッグブームの中にいる。「AIの夏」の中にいるのだ。

その始まりは、「ディープラーニング」が勃興した2010年代にさかのぼる。ニューラルネットは何十年も前から存在していたが、90年代から00年代初頭にかけては学習させるためのデータが十分でない、学習には計算量が多すぎるなどの理由で実用的でないと考えられていた。ディープラーニングのパイオニアであるジェフ・ヒントンは「90年代には、こんなものうまくいくわけがないと笑われていた」と昨年私に語ったものだった。

しかし、彼と世界中の何人かの同僚がこの問題に取り組み、00年代には状況が改善した。学習データの量は爆発的に増えた(人々が写真を無限にオンラインに投稿し、散文も無限に投稿したため)。処理も安価で高速になった。さらに、ヒントンや他の先駆者たちによる巧妙なニューラルネット工学のアイデアも加わり、2010年代のディープラーニングはパターン認識において実際に優れた能力を発揮するようになった。大量の写真でニューラルネットを訓練すれば、AIはオブジェクトを認識する魔法使いのようになった。翻訳された文のペアで訓練すれば、言語の翻訳を学習してついに機械翻訳ができるようになったのだ!

膨大な文章コーパスで学習させたら、AIはどうなるだろうか。GPT-3は、文中の次に来るであろう単語をきちんと予測するだけで、人間のような文章を作成したり、質問に答えたり、文書を要約できるロボットとなった。大量のアート作品でニューラルネットを学習させたらどうなるか。Midjourneyができあがった。コンピュータのコードで学習させれば、Copilotができあがった。

こうしてAIに資金が集まり、スタートアップがテキスト生成やコード補完、画像生成を組み込んだ製品を大量に発表するようになった。先ほどProduct Huntを確認したところ、そのような製品でごった返していた。以下では、3つの製品を紹介する(※訳註1)…。

- Read Easy.ai:AIによって選択した文章を要約してわかりやすくする。

- Travelmoji:AIが旅行プランを提案する。

- Copilotly:AIがブログやEメールの文章を生成してくれる。

・・・

第3次AIブームで生じた問題

しかし、果たして新たなAIの冬が到来する可能性はあるだろうか。

歴史的なパターンが繰り返されているような気がして、新たな冬が来るのではないかと訝しくなってきたのだ。

はじめに、大手チャットアプリによる顕著な不手際を目にするようになった。Googleは最近、OpenAIに追いつこうと必死でチャットAIを披露したが、そのチャットボットは事実に反する大きな間違いを犯した(※訳註2)。すると株式市場は、すぐに(株価が7.8%急降下して)Googleの価値から1,000億ドルを削り取ることになった。一方MicrosoftはChatGPTで強化された新しいBing製品を発表した。ChatGPTは(実際にはまだ2022年だと主張するような奇妙なものを含め(※訳註3))数え切れないほどの事実誤認を犯しただけでなく、その誤りを突きつけられると超不気味かつ反抗的になってしまった。もっとも巨大な言語モデルが膨大な事実誤認をすることは、私を含めた多くの人にとって驚くべきことではなかった。単語予測は強力な技術だが、コンピュータ科学者や認知科学者の中には、それが人間の真の推論能力のほんの一部でしかないのではないかと考える人もいる。

しかし、以上の回答に対してスミソニアン天体物理学センターの天体物理学のGrant Tremblay博士は、2004年に大型望遠鏡VLTが画像化した褐色矮2M1207の画像に「Bardはすごいものになると確信しているが、念のために指摘すると、太陽系外の惑星を画像化したのはJWSTが最初ではない」とメッセージを添えてツイートして、同AIの間違いを指摘した。

Not to be a ~well, actually~ jerk, and I'm sure Bard will be impressive, but for the record: JWST did not take "the very first image of a planet outside our solar system".

the first image was instead done by Chauvin et al. (2004) with the VLT/NACO using adaptive optics. https://t.co/bSBb5TOeUW pic.twitter.com/KnrZ1SSz7h

— Grant Tremblay (@astrogrant) February 7, 2023

RedditユーザCurious_Evolverは「アバターはどこで上映されているか」とBing AIに質問すると、Bing AIは「『アバター:ザ・ウェイ・オブ・ウォーター』は、未公開のため本日の上映はありません。2022年12月16日に公開予定です。」と回答した。その後、同AIに「今日の日付」を尋ねると「2023年2月12日」と答えた。この回答が正しければアバターはすでに公開済みであり、回答の整合性がとれなくなる。

Curious_Evolverは「今日が2023年ならば2022年は未来ではないのでは」と問い質すと、Bing AIは「現在は2022年です」と誤った認識を主張したのだった。

こうした言語モデルの不具合に加え、自動運転車のトラブルが増えている。アメリカ道路交通安全局は、運転を自動化するためのソフトウェア「完全自動運転Beta」を搭載したテスラ自動車のリコールを発表した。テスラのソフトウェアは、「交通安全法の不十分な遵守にもとづいて、自動車の安全性に不合理なリスクをもたらす」、つまり、予測できないほど乱暴で危険な動きをする傾向があると政府は指摘した。

以上のようにAIの冬の到来を予感させる「過小な成果」の部分が見受けられるのだ。

また「過剰な約束」もあった。自動運転車について考えてみると、発明家たちは10年前から、今にも到着すると主張し(「これは1兆ドル規模の産業だ」と、2017年にあるコンピュータ科学者が私に言った)、(私も含めて)記者たちはその潜在的な影響について興奮気味に熟考していた(※訳註4)。一方、大規模言語モデルの先駆者たちはモデルを大きくし、より多くのデータを与え続ければ、モデルは純粋な推論マシンに変貌すると主張してきた。(OpenAIの創設者の一人は、GPT-3はすでに「多少の意識がある」とまで言っている(※訳註5))。

it may be that today's large neural networks are slightly conscious

— Ilya Sutskever (@ilyasut) February 9, 2022

このような過剰な約束は、今が何年なのかわかっていない(そして、それを訂正すると怒るChatGPTのような)機械がある現実と、著しい不一致を示す。その不一致は滑稽でさえある。社会は、無慈悲で全知全能のスカイネットが人類を滅ぼすと心配していたが、実際に手に入れたのは些細な事実を正しく理解することに悩まずに、嬉々としてデタラメなことを言うアーティストたちだった。

・・・

AIは死なず、ただ修正されるのみ

難しい話は脇に置いておこう。実際のところ、AIの冬が来るかどうか、私には全く分からない。

結局、今日のチャットボットがバブルであったとしても、産業技術として考えられているところのディープラーニングは、狭い領域では非常に価値のあるものであることに変わりはない。それは、自動認識装置や分類器を作るのにはすばらしいものだ。それだけで数十億ドルの価値がある。たとえOpenAIがChatGPTに中学校の数学を確実に解かせることに成功しなかったとしても、数十億ドルの価値であり続けるだろう。それゆえ、(ChatGPTブームが終焉したとしても)AI産業が完全に萎縮してしまうという考えはあり得そうもない。

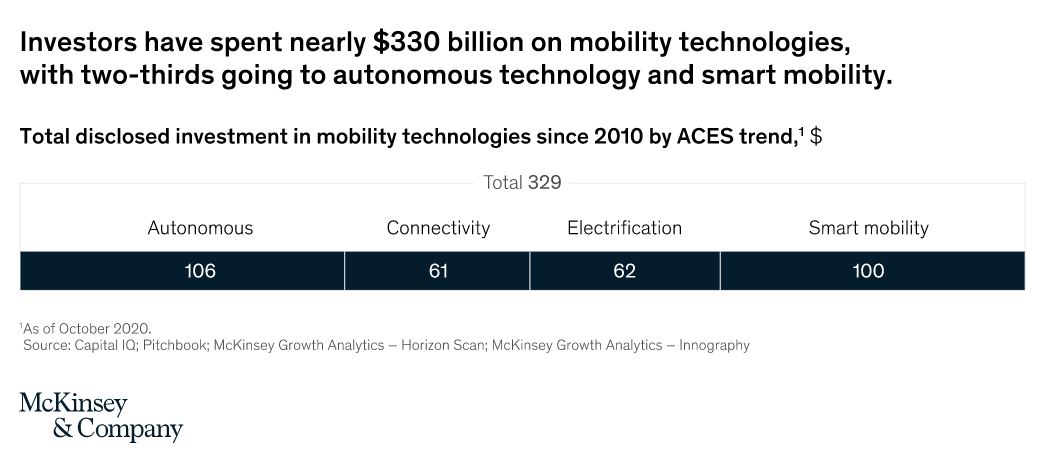

しかし、重大な修正が行われる可能性はある。大規模言語モデルは(「平地理論についてシェークスピア風のソネットを書いてくれ!」のように)遊ぶには楽しいが、ビジネスを進める手助けとするには危険なほど信頼できない、と多くの人が判断するかも知れない。あるいは、SEOに最適化されたデタラメがネット上に氾濫し、さながら知的な菌のように繁殖して、AIが世間一般に悪者扱いされるかも知れない。そうなれば、(AIに対する)多くの資本や投資が一掃されてしまうかも知れない。自動運転車は、教訓的な一例である。投資家がこの分野に何百億ドルも注ぎ込んだにもかかわらず(※訳註6)、完全な自動運転車はほとんど走っておらず、過去2年間にIPOした自動運転業界のスタートアップは、その価値の81%を失っている(※訳註7)(また、アート作品を生み出すAIや コードを生成するAIの中核的なプロセスを標的とした訴訟が起きていることも注目に値する(※訳註8)。これらの訴訟は、こうしたAIの開発者には訓練目的でオンラインの芸術やコードを大量に収集する権利がないことを主張している)。

アメリカにおける2010年以降の自動運転関連技術への投資を図示したグラフ。画像出典:マッキンゼー作成レポート

以上の記事は、自動運転技術系スタートアップのなかでも評価を大きく落とした企業の共通点として、(レーザー照射による物体認識技術である)LiDAR技術を研究開発していたことを指摘している。なおテスラ社は、LiDARからカメラによる画像認識技術に切り替えたことを発表している。

またThe Vergeは2022年11月9日、Microsoft、同社傘下のGitHub、そしてOpenAIがGitHub Copilotをめぐる集団訴訟を受けたことを報じた。この訴訟では、同アプリの開発にあたってコード制作者の許可なしにコードを収集したことが著作権の侵害に当たると主張されている。

しかし、(ここで再び議論がジグザグになるが)たとえ深刻なクラッシュがあっても、決してAIの終わりを告げるものではないだろう。この分野は2度回復している。また回復するだろう。もし現在作られているような大規模言語モデルがエラーや理不尽に見舞われる運命にあることがわかれば、優れたコンピュータ科学者はいずれ他の技術に注目するようになるだろう。その中にはGary Marcusのようなディープラーニング批判者が示唆するように、抽象化のための記号的な技術も含まれるかも知れない(※訳註9)。あるいは、ジェフリー・ヒントンが最近推察したように、個々のニューラルネットのために、目の前のタスクにもとづいて特注で作られる特殊なハードウェアかも知れない(※訳註10)。

モータルコンピュテーションが実現すれば、GPT-3のような大規模なAIモデルであっても数ワットという低電力で駆動できる、ともヒントン氏は述べている。

ことAIに関して「絶対」と言ってはいけない。AIはこれからも進化し続ける。しかし、もし冬が来て道に雪が積もったら、前進するためにも進路を変えるかも知れない。

・・・

(この記事をお楽しみ頂けましたか?もしそうなら、あなたの完全に人間的な知性によって「拍手」ボタンを探してみてください、そして、ボタンを押して拍手してください。50拍手まで可能です!)(※訳註11)

私は週に2回、Mediumで記事を発表しています。こちらをフォローすると、各投稿をメールで受け取れます。Mediumのメンバーでない方は、私のリンクから参加できます。月額料金の約半分は、Mediumでの私の執筆をサポートするために直接使われ、同時に私のMediumサイトの他のすべての記事にアクセスできるようになります。

また、私の有料週刊ニュースレター「The Linkfest」は、私がオンラインで見つけた最高のものをキュレーションしたものでこちらもお楽しみいただけます。このニュースレターは「ドゥームスクローリング(※訳註12)とは反対」のものです。

私はNew York Times誌の寄稿者であり、WiredとSmithsonian誌のコラムニスト 、Mother Jonesの常連寄稿者でもあります。『Coders: The Making of a New Tribe and the Remaking of the World(邦訳書『Coders(コーダーズ)凄腕ソフトウェア開発者が新しい世界をビルドする』)』と『Smarter Than You Think: How Technology is Changing our Minds for the Better(『あなたが思うより賢い:テクノロジーが私たちの心をより良く変える』未邦訳)』の著者でもあります。 Twitterアカウントは@pomeranian99、Instagramはこちら、Mastdonは@clive@saturation.socialです。

原文

『The Risk of a New AI Winter』

著者

Clive Thompson

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん