新しいユーザ・インタフェースとして2016年頃から流行しはじめたチャットボットは、多くの誤解と誤用にさらされた結果、当初期待されていたいたほどの成果をあげられませんでした。こうした失望は、新しいテクノロジーの誕生当初には過度に期待されがちであることに起因しており、チャットボットもその例外ではありません。しかし、チャットボットの根幹を成す会話AIの進化は続いており、長期的予測ではチャットボットは間違いなく社会に良い変化をもたらすはずなのです。

ボットのためのボット

わたしの作っている製品にはボットが必要なのだろうか。ボットにやらせようとしている機能はすでにプラットフォーム上にあるのではないだろうか。わたしは、自分がやって欲しいと思っていることを実行できるボットを開発できるような忍耐力を持っているのだろうか。

(新テクノロジーを過度に期待するという)ハイプの本質を見抜くもうひとつの問題点は、以上に挙げたような不可欠な問いかけを避けてしまうことにある。

多くの企業にとって、ボットは正しいソリューションとはなっていない。ボットが流行してから今までの2年間において、ボットが必要ではない問題に対して闇雲にボットが応用されたケースが散乱している。

ボットのためにボットを開発するのは、結局は失敗をもたらし、最良のボットを開発するという望みを絶ってしまうのだ。

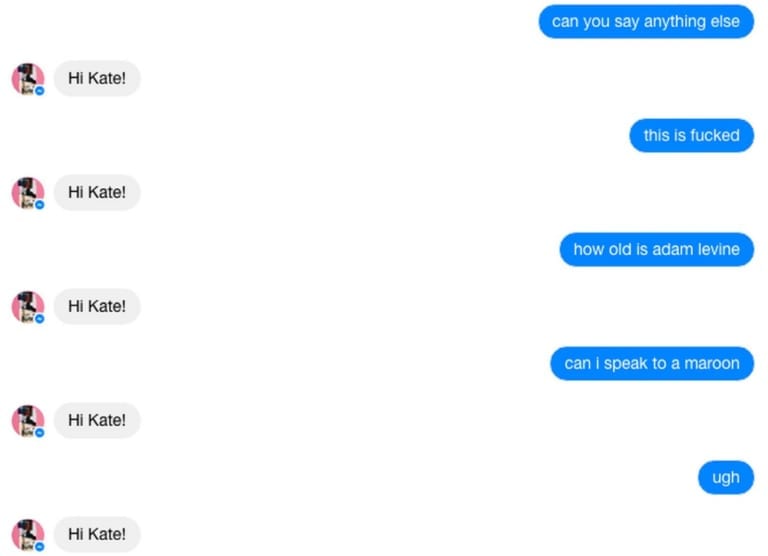

Maroon 5(アメリカのバンド)のチャットボットが」動作するのに必要なたったひとつの返事

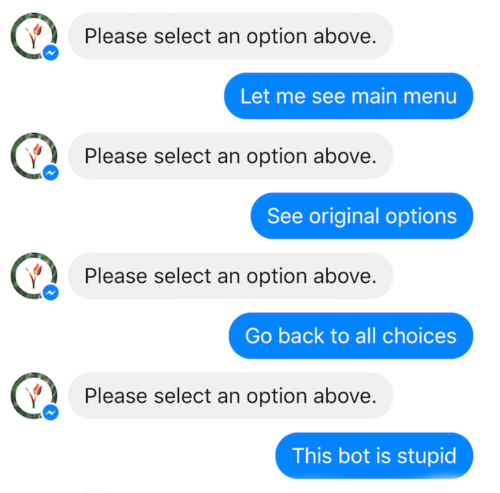

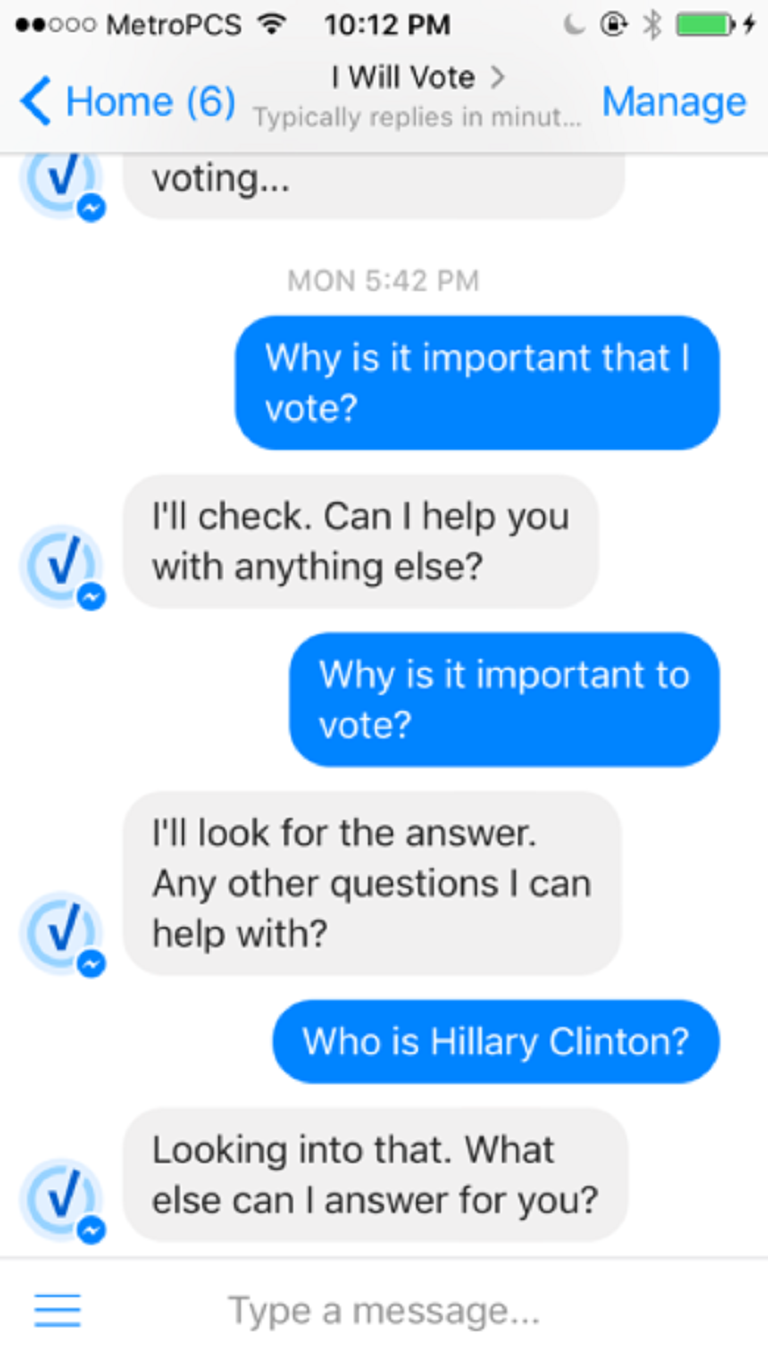

大多数のボットは、決定木ロジックを使って開発されている。決定木ロジックを使ったボットは、ユーザが入力した特定のキーワードに対してのみ返答できる。

こうした決定木ロジックを活用したアプローチの利点は、ボットが網羅すべき返答のケースを極めて簡単にリストアップできることだ。だが、この利点がまさに欠点にもなっている。

決定木ロジックに欠点があるというのは、ボット開発に際して返答を考案するヒトがどれだけ忍耐強くかつ潔癖に返答を考えるか、ということにボットが純粋に左右されてしまうからである。そして、ボットに対するユーザのニーズとユーザが入力する内容に関して、開発者はいったいどれ程想定できるであろうか。

決定木ロジックが引き起こす問題は、ユーザはこのロジックが想定している範囲に収まることを拒否することから発生する。

最近のレポートでは、Facebook Messengerを活用した10万以上のボットの70%が、ユーザの簡単な要求に答えることに失敗しているのだ。この調査結果は、ボット開発者がボットの応答動作をボットが得意とする分野に焦点を合わせ限定することに失敗していることに起因している。

わわわれがGrowthBotを開発した時は、ボットで実行できることのポテンシャルに過度に興奮して「オールラウンド」なものを作ろうとする誘惑はあったのだが、セールスとマーケティングに限定して開発したのだった。

「ひとつのこと」をうまく実行するボットは、多数のことを下手に実行するボットよりはるかに役立つ、ということを忘れないで欲しい。

非アクセシビリティ

優秀な開発者は、ほんの数分で基本的なボットを作るだろう。だが、同じ開発者がボットが実行する会話まで作りこめるだろうか。残念ながら、それはまた違う話だ。AIに関しては過度に期待されている状況が続いているのだが、われわれはヒトのように振る舞うAIからは一向に程遠いままなのだ。

理想的な世界においては、NLP(natural language processing:自然言語処理)として知られている技術が、チャットボットが受け取ったメッセージを理解することを可能とするはずだった。しかし、NLPは研究室から世に出たばかりであり、まだ幼児の段階にいる。

いくつかのプラットフォームはちょっとしたNLPを提供しているが、そんなNLPの最良のものでもよちよち歩きのレベルの能力しかない(例えば、Siriがユーザの言葉を理解しているか考えてみるとよい。とてもそうは思えない)。

また、Matt Asay氏が概説しているように、AIの水準に関してほかの問題も引き起こされる。その問題とは、AI開発者の関心と創造性をつかみ損なうことだ。同氏は以下のように述べている。

「消費者の関心は、機械の知性がヒトの知性に近い何ものかになるまで実現しないようなものでは決してない。

ユーザの関心は、自分たちと有意義な会話をするボットを可能とするようなAIにあるのだ」

とは言うものも、会話というのは複雑なものである。会話は線形的ではない。会話の話題は会話者のあいだで急展開し、ランダムに変わり、再開したり突然に終わったりする。

今日のルールベースの会話システムは予測不可能な事柄を処理するにはあまりにも脆弱であり、機械学習に使われている統計学的アプローチはこうした予測不可能なことに対して制約の多いものなのである。ヒトのように会話するAIに求められる水準の技術は、まだ利用可能ではないのだ。

こうしているあいだにも、業界をリードするような先駆的なボットの高品質な事例が現れている。この動向に関して、Dave Feldman氏は以下のように述べている。

「Slack、Facebook、Google、Microsoft、Kik、そしてその他の企業は業界をリードするような組み込み型ボットを自社で開発すべきだろうか。

こうしたテック系企業は開発しているボットに対してより積極的に投資家やインキュベーターを募り、ボットの活用方法に関して市場関係者を教育するようなメンターを雇い、あるいはボットの開発と製品デザインに関する人材をもっと供給すべきか。著名なビジネスパートナーに対して、戦略的なボット・ファンドに関するイニシアティブを提案すべきか。

わたしの考えでは、件の疑問に対してすべてYes、Yes、Yesである。ボットがプラットフォームになった時には、開発者がユーザとなる。そして、ユーザがボット製品を使う理由や方法を理解する必要なんてない。ただ、ボット製品をユーザに見せるだけでよい」

GUIは放棄されるべきではない

かつては、コンピュータと相互作用する唯一の方法は端末に対して難解なコマンドを入力するというものだった。ウィンドウやアイコン、あるいはマウスを使った視覚的なインタフェースの登場は情報を操作する方法に関する革命だったのだ。

コンピュータの操作方法がテキストベースからグラフィカル・ユーザ・インタフェース(GUI)に移行したのには理由がある。入力から見れば、タイプするよりクリックするほうが簡単で早いからだ。

何かをタップしたり選択したりするほうが、たとえ入力文の候補が現れたとしても(しかもその候補がしばしば間違っているのだが)全文を入力するより明らかに望ましい。出力から見ても、「百聞は一見に如かず」はいつも正しい金言である。

われわれは視覚的に情報が表示されることを好んでいるのだ。というのも、ヒトというのは視覚的な生き物だからだ。子供がタッチスクリーンを好むのは偶然ではない。グラフィカル・インタフェースを夢見ていた先駆者たちは認知心理学にインスパイアされていた。この学問では脳がどのようにしてコミュニケーションを処理するか研究していた。

(チャットボットに見られる)会話的UIは会話というヒトが好んでいるコミュニケーション方法を複製するように意図されたものなのだが、会話的UIをもってコンピューティングにおける格別な認知的努力に対する要求が終わるわけではない。本質的にヒトは、複雑なものを単純なものに置き換えるものなのだ。

もちろん、言語を使うことによってのみ表現できる概念というものはある(例えば「美術館に2000歩で行けて、なおかつ35分以上かからないすべての移動方法を教えて」という表現を視覚的に表現できるか?)。しかしながら、ほとんどのタスクにおいて会話的UIよりGUIを使う方が効率的かつ直観的に実行できる。

ヒトはほかのヒトと話したがる

ビジネスにおける相互作用において人間的な次元に焦点を合わせることには意味がある。

もし販売やマーケティングに関して失敗してしまう原因があるとするならば、その原因とは人間味の欠如である。そうした失敗事例では、ブランドはチケット販売、フォームのフィードバック、返信不可のEメール、自動応答、そして「お問い合わせ」という門のようなフォームの後ろに埋没してしまっているのだ。

Facebookのゴールは、同社のボットがいわゆるチューリングテストに合格することである。つまり、ユーザが話している相手が同社のボットかヒトかを区別できない、ということを目指しているのだ。もっともボットはヒトとは違う。このゴールには決して到達しないだろう。

会話というものは、文字で書かれる意味以上のものを含んでいるのだ。

ヒトは行間を読むことができ、文脈から得られる情報を活用し、皮肉に見られるように二重の意味の層を理解する。対してボットは話していたことをすぐに忘れてしまう。この忘れる様子は、まるで短期記憶が全くないか少ししかないヒトと話しているかのようだ。

ボットの欠点に関して、HubSpotチームは以下のように指摘している。

ボットはバイヤーとの一対一の拡張性のある相互作用を提供します。しかし、ヒトが他人とメッセージングアプリで行っているような複雑で重層的なコミュニケーション体験を、ボットは効率的かつ快適にユーザに届けることがまだできていません

ヒトは簡単には騙されないのだ。いかにもボットであるかのようなボットの振舞いは、コミュニケーションの見返りが減るとヒトに約束してしまうことになる(このことは、ボット開発者がユーザにウソをつくべきだと言っているわけではない)。

そして最先端のNLPを活用し、言語処理とコンテンツの生成に優れている希少なボットでさえ、ヒトとは比較にならないのだ。

さらにほかの問題もある。会話的UIはヒトが好むコミュニケーションの仕方を複製するように作られている。しかし、ヒトがコミュニケーションに好む相手は、他のヒトなのだ。

それではいったい、どうやったらヒトは機械との相互作用することを好むようになるのか。

そんなことは起こりそうもない。

結局のところ、どんなにウィットに富んだ皮肉やヒトのような口ぶりを並べてみても、ボットを会話の失敗から救うことはできそうにないのだ。

ここからわれわれはどこに行く?

ある意味では、チャットボットのアーリーアダプターは完全に間違っていたわけではない。

ユーザはGoogle Homeに向かって好きな歌を再生するように叫んでいるし、ドミノピザのボットからピザを注文しているし、Sephora※からメイクアップのヒントを得ている。しかし消費者の反応と開発者の参加という観点から見る限りでは、2015年あるいは2016年ころから始まった過度な期待が寄せられていたチャットボットのハイプの段階はもう続いていない。

しかし、すべてが終わったわけではない。

コンピュータはコンピュータである限りにおいて良いものなのだ。データを検索したり、数字を加工したり、意見を分析したり、そして情報を要約することにかけてはコンピュータは優れている。

と同時にコンピュータはヒトの感情を理解するのが苦手だ。NLPの現状からは、コンピュータはわれわれ人間がコンピュータに尋ねたことを理解していないし、われわれがどのように感じているか気にもしていない、ということがわかる。

以上のことが、本質的なヒトの関与なしでコンピュータが効率的なカスタマーサポート、セールス、そしてマーケティングを実行することなど想像できない理由なのだ。コンピュータを使ってうまく仕事をするためには、ヒトの共感、感情、そして知性が不可欠なのだ。

現状ではボットは、反復的で低レベルのタスクや応答を自動化することによってわれわれを助け続けている。より大きく複雑なシステム内では、ボットはまるで歯車のように動作する。こうしたボットが自動化した単純労働をわれわれはかつて自分たち自身で実行し、そうした仕事をとても厄介なものと思ってもいたのだ。

しかし、チャットボットに関する物語は以上ですべてではない。

結局、われわれの産業はチャットボットがもたらす初期のインパクトを非常に過大評価していたのだ。繰り返すが、初期においては過大評価してしまった。

このことに関して、ビル・ゲイツはかつて以下のように言った。

チャットボットのひとつのハイプは終わった。そして、それはいいことなのだ。これからは期待か失望かと白黒はっきりしていて狂乱に満ちたバブルのようなハイプの代わりに、中間色である灰色に塗られた領域を調べ始める時なのだ。

われわれはチャットボットの指数関数的成長のまさに始まりに立っている、とわたしは信じている。まだクライマックスが訪れていないというのは、革新的技術の成長における常なのだ。

メッセージングアプリはチャットボットのけん引役であり続けるだろう。チャットボットは消えることはないだろう。NLPとAIは毎日より洗練されたものとなっている。

開発者、アプリ、そしてプラットフォームは協力しあって実験を続け、何より会話的マーケティングには多大な投資がなされている。

わたしは、次に何が起こるか見たくて待ち遠しいのだ。

・・・

読んでくれてありがとう。もしこの記事を読んで楽しんだのなら、どうぞお気軽にHubSpotのChatbot Builderツールをチェックしてください。

原文

『Chatbots were the next big thing: what happened?』

著者

Justin Lee

翻訳

吉本幸記

編集

おざけん