「共感」や「感情」について考える時、人はそれらを「知性」や「知能」と対立するものと捉えがちです。しかし、同氏によると、最近の認知科学や心理学の研究は、感情や共感は知性や知能に対立するものではなく、むしろ感情と知性が協働することによって認知活動や意思決定が可能となることを明らかにしています。そのため、人間の知性全般の再現を目指す「人工一般知能」(Artificial General Intelligence:AGI)の実現には、人間の感情や共感に相当する機能をAIに実装する必要があるのです。とくに共感に相当する機能は、倫理の根幹を成すものと考えられています。

共感的なAIは、ビジネス活用される可能性が大いにあります。実際、感情を模倣することを通して自閉症児が感情を読み取れるように支援するロボットや、人間の複雑な感情を表現できるAIの研究開発が進んでいます。こうした共感的なAIは、カスタマーセンターのチャットボットのような接客において大きな効果を発揮すると期待されています。

共感的なAIは、現在のAIシステムが克服するべき課題のひとつである「説明可能性」の解決にも役立つと考えられています。というのも、AIが何らかの意思決定をした場合、そのAIが感情や共感を持ち合わせていれば、「○○という感情にもとづいて選択した」という説明が可能になるからです。

以上のような共感的AIは、「ビッグデータを踏まえたAIやロボットが今まで人間が行っていた作業や調整を代行・支援」するとされる内閣府が提唱する日本の未来像「Society 5.0」の実現には不可欠なものなのではないでしょうか。

前編にあたる以下の記事本文では、現在の認知科学における感情と共感の位置づけを確認したうえで、AIに共感を実装する意義を論じていきます。

なお、以下の記事本文はJun Wu氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。

Tumisu @pixabay.com

誰かに共感について聞かれたとき、あなたは何を考えるだろうか。その意味を見つけるのに苦労するのか、それとも自然と思い浮かぶだろうか。人工知能の時代に、私たちのAIシステムは共感を必要としているのだろうか?もしそうだとしたら、AIシステムにおいて共感が最も役立つユースケースとは何であろうか。

人間は社会的な生き物である。私たちは共感によって繁栄している。子供に本を読み聞かせると、子供はその文章に込められた感情を聞くことができる。本を読み聞かす時のトーンと抑揚によって、子供たちはお気に入りの本に私たちが込める愛を思い起こすだろう。就寝時の本の読み聞かせは特別な瞬間として、子供たちは記憶するだろう。そして、私たちが読んだ本の甘い思い出を持つに至るだろう。

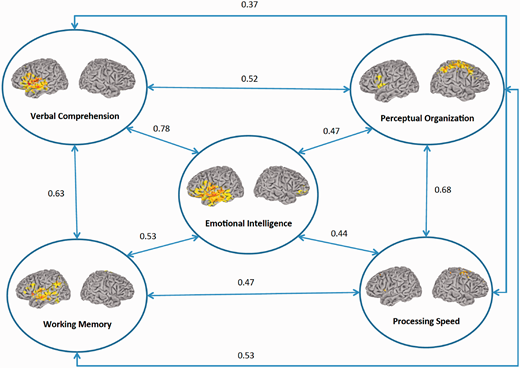

私たちは、人間とは論理的な生き物であることを考えるのを好きだ。実際には、感情は私たちの知性の大部分を支配している。Aron K. Barbeyらが発表した2012年の研究によると、神経科学者たちは感情的な知性と認知的な知性が、認知的、社会的、感情的なプロセスを統合するために、多くの神経システムを共有していることを確認した。この研究は、心理学者が何十年も前から気づいていたことを確認したのだった。すななち、感情的知性と一般的知性の間には相互依存性があるのだ。(※訳註1)。

“人格や感情なしでは、「人間のような」知能(AGI)は持てません。人は情報にもとづいて行動を変えるのではなく、感情、感情的知性、そして共感にもとづいて行動を変えるのです。” ― Steve Ardire、AIスタートアップの「Force Muliplier」と「Merchant of Light」の顧問

同氏らは、ベトナム戦争で脳を損傷した退役軍人の協力を得て、脳をCTスキャンしながら彼らに心理テストを実施した。その結果、感情的知性は言語機能等と関係があることが実証された(下の図を参照)。同論文の結論では、「歴史的には、認知的および感情的なプロセスは、別個の構成要素と見なされてきた。しかし、過去20年間の研究が示していることは、認知と感情が異なるプロセスとする見方が制限されている可能性があり、脳で複雑な行動がどのように実行されているかを理解するには、その相互作用の理解が不可欠、ということだ」と述べられている。

画像出典:Social Cognitive and Affective Neuroscience ‘Distributed neural system for emotional intelligence revealed by lesion mapping‘ 。画像中の数値は、各脳機能間の働きにおける相関を表す。数値が高いほど協働している。[/caption]

画像出典:Social Cognitive and Affective Neuroscience ‘Distributed neural system for emotional intelligence revealed by lesion mapping‘ 。画像中の数値は、各脳機能間の働きにおける相関を表す。数値が高いほど協働している。[/caption]

共感とは感情的知性の中心

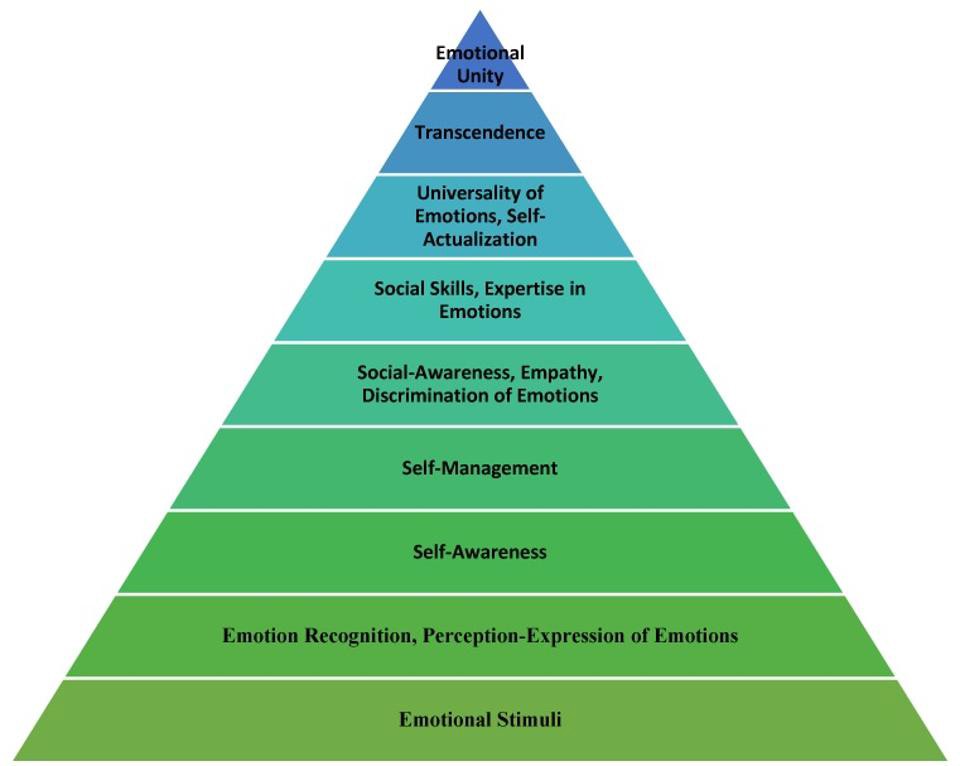

共感は感情的知性の一部である。共感とは、他人が自身の世界と向き合う枠組みで経験していることを理解したり、感じたりする能力を意味する。感情的知性の一般的な範囲においては、共感は自己認識、社会的認識、自己実現、そして超越のなかにある(※訳註2)。

画像出典:https://www.ncbi.nlm.nih.gov/pmc/articles/PMC5981239/からbehavsci-08–00045-g001–1

上記の感情的知性のピラミッドによると、共感は感情認識より上にあるピラミッドの全層にある。自己実現に向かう途上で、感情の統一に向けて働くのを助けるものこそ、私たちの共感なのだ。

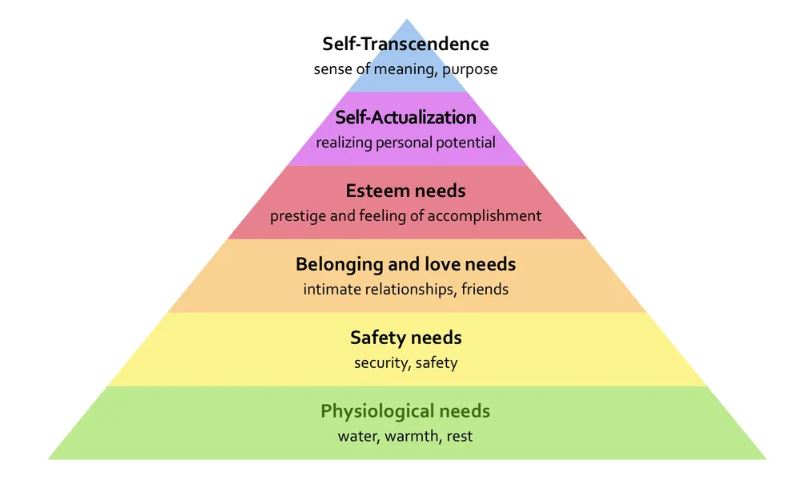

この感情的知性ピラミッドは、マズローの自己実現のヒエラルキーの頂点に欠けているものに対応しており、マズローのヒエラルキーの頂点の後には、自己超越と感情的統一が必要なのである(※訳註3)。

同論文によると、感情には単なる外界の刺激受容に伴う知覚から深い感情的統一にまで至る段階があり、人間は下層の感情から上層のそれに向かって実現することを希求する。共感が生まれるのは、自己の感情を制御できるようになったうえで他人の感情を理解する第5段階の「社会的認識、共感、感情の識別」においてである。

しかしマズローは、晩年、自己実現よりもさらに高次な「自己超越」の段階を追加していた(下の画像参照)。この自己超越の欲求とは、「自己」という閉鎖的な存在を超えていく欲求である。こうした自己超越は、前述した感情的知性の階層モデルの第8段階にも存在する。感情的知性の階層モデルにおける超越は、「人が他人の自己実現、自己充足、そして他人のポテンシャルの実現を助ける」と定義されている。そして、「超越」のさらに上に位置づけられる最上層には、自他の感情を理解したうえで、自分の存在意義を了解し、万事において満たされた状態を意味する「感情的統一」があるのだ。

画像出典:BIG THING ‘The Missing Apex of Maslow’s Hierarchy Could Save Us All‘[/caption]

画像出典:BIG THING ‘The Missing Apex of Maslow’s Hierarchy Could Save Us All‘[/caption]

共感のプロセス

共感について語られる時、私たちがどのように感じ、反応し、感情的刺激を内面化しているかという点で語られることが多い。こうした共感を表現するにあたっては、以下のような3つの部分がある。

- 認知的共感 ― 他人が世界と向き合う枠組みを理解する。

- 感情的共感 ― 適切な感情で反応する能力。

- 身体的共感 ― 共感のプロセスに関連した身体的反応。

私たちが誰かの愛を感じるとき、はじめに認知的共感性を使って、相手が自分たちに対して持っている愛を感じる。次に感情的共感力を使って、愛してくれる相手に対して感じる愛に反応する。最後に、私たちが感じる愛は、心臓の鼓動が速くなるなどの身体的な反応につながることがある。こうした反応が身体的共感である。

共感 vs. 人工的共感

人工知能システムに関して、もし人工的な一般知能に向かっていこうとするならば、共感は必須となるだろう。もっとも人間の知能と人工知能が異なるように、人工共感も人間の共感とは異なる。

Minter Dialは、著書『Heartificial Empathy』の中で、人工共感を機械への共感のコーディングと表現している。彼は、人工的な共感あるいは心的な共感を、人格的かつ状況的、そして適切な意図に基づくものと説明する。

“共感とは、辛抱強く誠実に相手の目を通して世界を見ることである。それは学校で習うものではなく、生涯にわたって培われるものである。” ― Minter Dial『Heartificial Empathy』より

共感は学習することができるので、人工知能は今後数年で、確実に人工共感を搭載できるようになるだろう。

“課題は、機械がより共感的かつ効率的なサービスの提供を通して支援する(人の)エージェントのために、適切な(共感に関する)混合物と化学反応を見つけることにある” ― Minter Dial『Heartificial Empathy』より

とは言うものも、企業は自社のビジネスに付加価値をもたらす効果的な人工知能システムを開発するために、共感の適切なユースケースを決定しなければならない。

人工共感の適切なユースケースを特定することで、企業は顧客に提供しているビジネスとサービスにより多くの共感を注入することができる。

共感と倫理

近年、AIシステムが企業や家庭に組み込まれていく中で、AIの倫理についての懸念が高まっている。私たちは、人間性を最大限に引き出すように人工知能を正しい目的のために使用しているだろうか。機械の相手と肩を並べて生きて、人間の生活を向上させるためにAIを使うにはどのようなことができるのだろうか。

AIシステムに共感を持ち込むべきか否かをめぐって、倫理に関する議論がある。AI推進派の中には、人間の感情をAIに入れると人間を滑りやすい傾斜に立たすことになる、と指摘する人もいる。AIが共感できるようになると、いつか人間を置き換えることを可能にするだろう、というわけなのだ。こうしたシンギュラリティ到来に関する恐怖は理解できるものだ。もっとも、人類史上まだこのシナリオには遭遇していない。

しかしながら、共感するAIについて確かなことがないからこそ、私たちのAIシステムに共感についてのビジネスケースが必要だ、ということも言えるのだ。

倫理的な生活を送る人間の話をするとき、私たちは多くの場合、共感を豊かに使える生活の話をする。私たちは世界と対話し、共感を使って相互理解に至ることができるというわけなのだ。

人間と同様に、AIの共感を具体的なビジネスケースに活用してビジネスを強化しようという意図は、倫理的なビジネスを実践する可能性を飛躍的に高めることができる。ひいては、組織全体での共感の向上につながる可能性があるのだ。

共感的な組織で働く人は、倫理的な人生を歩む可能性が高くなることが多い。

AIが人を助けるために共感を活用するベストな事例のひとつとして、ヘルスケアの分野が挙げられる(※訳註4)。認知症患者の介護は、看護師や医師にとって感情的に辛いものだ。医師や看護師からは、ケアの質を低下させる「バーンアウト(燃え尽き)」が報告されている。AIロボットは「燃え尽きた」と感じることなく、共感を使って認知症患者をケアすることができる。さらに医師や看護師と患者のあいだの仲介役となることができる。医師と密接に連携して情報を収集し、治療計画を練ることもできる。看護師と協力して患者を監視し、日々のケアを行うこともできる。同時に、一貫した共感的ケアを受けている認知症患者からは、より良い結果が報告されている。

同氏によると、入院中の子供に自然言語で相互作用できるソーシャルロボットを与えると、デジタルアバターやクマのぷーさんのぬいぐるみを与えられた子供よりおしゃべりになったのだ。こうした子供を対象とした結果は、高齢者のケアにもソーシャルロボットを有効活用できることを示唆している。

AIの倫理観が人間を凌駕できるとしたら?

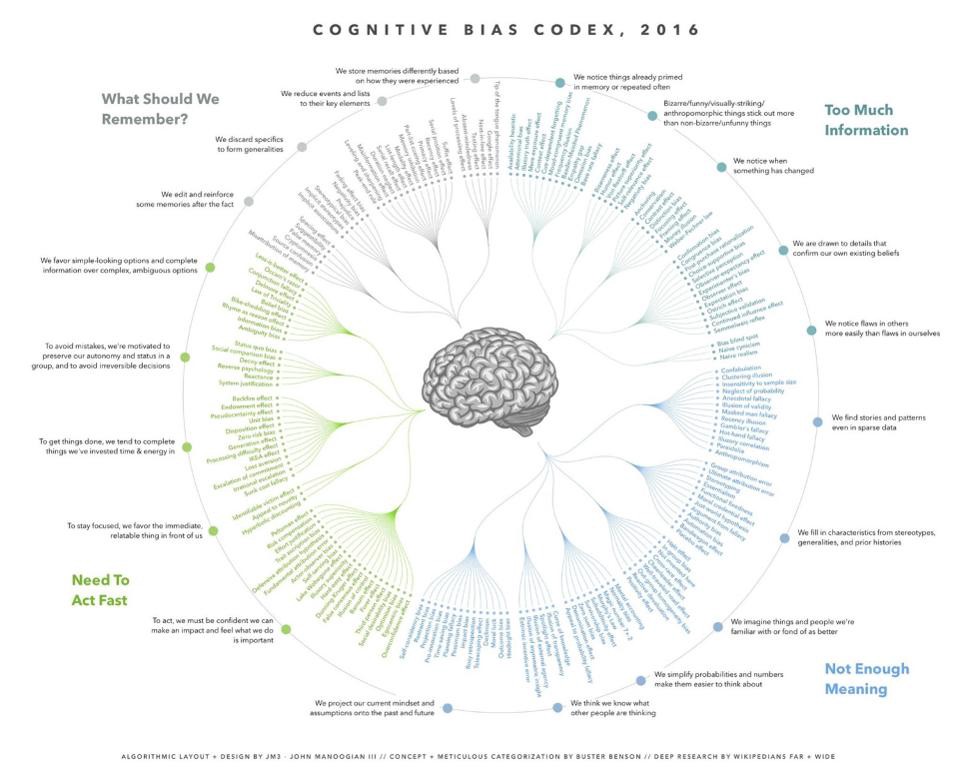

結局のところ、人間は多くの認知バイアスを持っている。現実世界でのユースケースとアプリケーションが正しく定義されていれば、感情的に知的なAIは、人間にありがちな認知バイアスを排除するように働くことができるだろう(※訳註5)。

一部の認知バイアスが生じるのは、早く意思決定するための「心的なショートカット」や正確ではないものも実用的な意思決定を導く「ヒューリスティクス」が原因と考えられている。人間より計算資源を容易に拡張可能で知覚に惑わされる可能性を少なくできるAIは、認知バイアスを回避することができると考えられる。

(後編に続く…)

原文

『Empathy in Artificial Intelligence』

著者

Jun Wu

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん