「共感」や「感情」について考える時、人はそれらを「知性」や「知能」と対立するものと捉えがちです。しかし、同氏によると、最近の認知科学や心理学の研究は、感情や共感は知性や知能に対立するものではなく、むしろ感情と知性が協働することによって認知活動や意思決定が可能となることを明らかにしています。そのため、人間の知性全般の再現を目指す「人工一般知能」(Artificial General Intelligence:AGI)の実現には、人間の感情や共感に相当する機能をAIに実装する必要があるのです。とくに共感に相当する機能は、倫理の根幹を成すものと考えられています。

共感的なAIは、ビジネス活用される可能性が大いにあります。実際、感情を模倣することを通して自閉症児が感情を読み取れるように支援するロボットや、人間の複雑な感情を表現できるAIの研究開発が進んでいます。こうした共感的なAIは、カスタマーセンターのチャットボットのような接客において大きな効果を発揮すると期待されています。

共感的なAIは、現在のAIシステムが克服するべき課題のひとつである「説明可能性」の解決にも役立つと考えられています。というのも、AIが何らかの意思決定をした場合、そのAIが感情や共感を持ち合わせていれば、「○○という感情にもとづいて選択した」という説明が可能になるからです。

以上のような共感的AIは、「ビッグデータを踏まえたAIやロボットが今まで人間が行っていた作業や調整を代行・支援」するとされる内閣府が提唱する日本の未来像「Society 5.0」の実現には不可欠なものなのではないでしょうか。

後編にあたる以下の記事本文では、共感的AIのビジネス活用と「説明可能性」を解決する可能性について論じていきます。

なお、以下の記事本文はJun Wu氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。

AIにおける共感はどのように見えるのか?

最近まで、AIの研究者は感情を識別することに焦点を当ててきた。自閉症の子供に感情的知性を教えるために使用されるようなロボットは、さまざまなタイプの感情を識別することに焦点を当てている。こうしたロボットは、感情を認識して識別することができるのだ。一度感情を識別すると、彼らは子供たちに教えるためにこの感情を明瞭化することができる(※訳註1)。

人工知能が人間の感情に共感するためには、人工知能が人間の経験する感情の範囲を学習する方法が必要となる。

しかし、感情は平面的な構造物ではないことが多い。私たちが恐怖を経験するとき、しばしば無気力でもあり、怒り、そして他の多くの感情の担い手にもなっている。

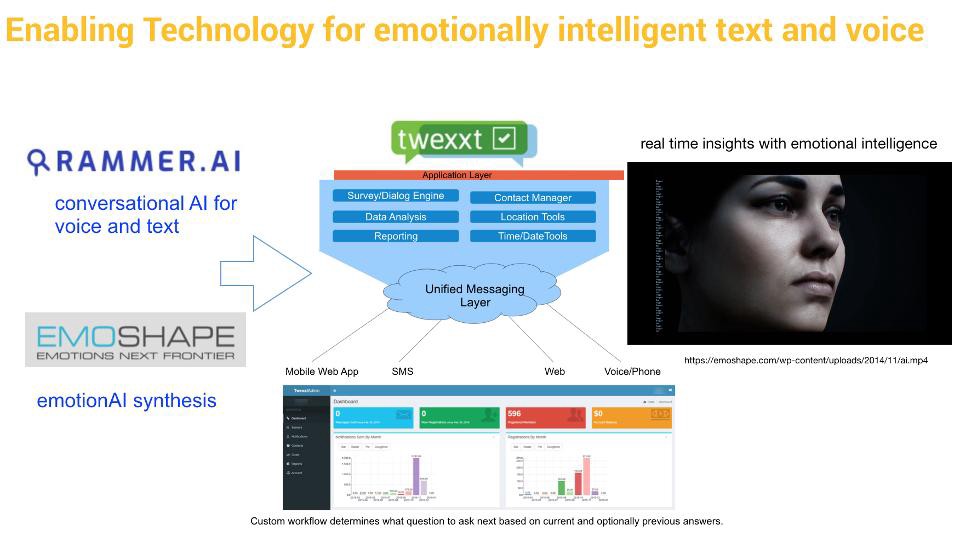

Emoshapeは、感情合成の特許技術を保有する最初の企業だ。Emoshapeが開発した感情チップまたはEPU(「Emotion Processing Unit」の略称)は、人間が経験する感情の範囲をあらゆるAIシステムが理解することを可能とする。どんな瞬間においても、EPUは1/10秒ごとに64兆もの可能性のある感情の状態を理解することができる。感情の範囲は、それぞれの感情の程度を観察できるグラデーションにマッピングされる(※訳註2)。

SignalactionAIは、ユーザがポジティブな結果につながるように賢明に選択するのを後押しするために、感情的知性を使って音声と文字によるコミュニケーションからリアルタイムの洞察を生成することによって、次の行動をうながす状況的認知をEmoshapeを使って生み出すのだ(※訳註3)。

画像出典: https://emoshape.com

この動画では、ロボットのレイチェルが経験している感情に応じて表情を変えている。様々な感情を経験しているからこそ、表情のニュアンスが変化していることに注目しよう。

話を前の事例に戻すと、EmoshapeのEPUを使えば、就寝時に子供の本を読み聞かせするための音声を生成できるAIシステムが可能となる。このAIリーダーは、あなたが子供に本を読み聞かせるのと同じように、トーンと抑揚をつけて本を読むことができる。あなたが出張で留守にしていても、子供たちは共感できるAIリーダーの助けを借りて、思い出に残る物語の時間を楽しむことができるだろう。

自閉症の子供は、他人の表情を理解することが困難な場合がある。自閉症児が他人の感情を読み取る訓練をするために、表情があるロボットを活用する研究が行われた。この研究には、SoftBank Roboticsが開発したロボット「NAO」が使われた。訓練は、まず療法士が特定の感情を示している顔写真を自閉症児に見せて、見せた感情が何であるかを教える。その後、教えられた感情を再現したNAOと相互作用することを通して、自閉症児が他人の感情を読み取ることを学習するのだ(下の動画参照)。

なお、NAOが示す感情は、ディープラーニングによって特徴抽出された感情データにもとづいて再現されている。

共感を持ったAIがより良い意思決定を行うには?

人工的な一般知能を実現するためには、AIは意思決定を行うために共感を利用しなければならない。つまり、AIシステムは認知プロセスだけでなく感情プロセスにも影響を与えることができる「人工脳」に埋め込まれる必要があるのだ。

ビジネスの現場では、少なくとも何らかの共感の発揮が必要なユースケースはたくさんある。

例えば、カスタマーサービスのチャットボットは、人と同じように顧客に話しかけることができる。このチャットボットは、スクリプト化された質問をトーンと抑揚をつけて話すことができるようになるだろう。そして、顧客の反応に基づいて共感できるチャットボットは、フラストレーションなどの複雑な感情を感じ取ることができるようになるだろう。

顧客が経験している感情の質にもとづいて、チャットボットは、顧客が異常にイライラしているときに、そうした顧客をライブサービスのエージェント(つまり人)に転送することを決定できる。そうでなければ、会話を続けることができる。共感型チャットボットが顧客からの幸福感と満足感を検出すると、顧客が真に満足していることを確認できる。

以上のことを別の言葉で言えば、共感型ロボットと話す経験は、ロボットと話しているように感じるのではなく、人間と話しているようにより強く感じるのだ(※訳註4)。

同氏によると、共感的なチャットボットを開発するためにはテキスト、声、表情のそれぞれから感情に関する情報を読み取って、それらを統合するマルチモーダルなアプローチが必要となる。それぞれのモードから感情情報を読み取る技術は、以下のような企業が開発している。

モードごとの感情読み取り技術を開発している企業

| テキスト | IBM(Waton Tone analyzer)、Perceive、Bitext |

|---|---|

| 声 | Beyond Verbal、Vokaturi |

| 顔 | Affectiva、Kairos、Microsoft(Microsoft Azure Face) |

共感型AIシステムはAIの意思決定における透明性を高める

人工知能システムの最大の批判のひとつには、どのようにして意思決定にたどり着いたのかを「表現」できないことがある。ディープラーニングシステムによる意思決定にいたっては、「ブラックボックス」論がよく引き合いに出される。

EPUや感情チップをAIシステムに統合すると、そうしたシステムは共感的な意思決定をするために使われた感情を表現することができるようになる。トレーニングセットによって「ブラックボックス」化したり、異なる種類のデータを横断して一般化したりするのではなく、それぞれの顧客がもつ固有の感情的ニーズに合わせたAIシステムになるのだ。

以上を別の言葉で言えば、共感的AIシステムにおける決定の原動力となる顧客の感情的状態を特定することによって、AIシステムの決定は顧客だけではなく企業をも活性化されることができる。そして、こうした活性化がよりよい意思決定を可能とするような理解にもつながるのだ。

AIシステムの意思決定プロセスに透明性を持たせることで、共感型AIシステムはより幅広い人に受け入れられる可能性があるのだ。

おわりに

私たちのAIシステムが人工的な一般知能に向かっていく中で、このシステムに関して共感が役立つユースケースを特定することは、より倫理的なAIの実装を可能とする。

AIシステムにおける共感の助けを借りれば、人工感情知能は、人類に力を与える機能的な人工一般知能への第一歩を踏み出すことができるになる。

共感的AIシステムを採用している企業は、自社のビジネスの進め方により多くの共感を注入することができるようになる。その結果、コアバリューが人間的で倫理的なビジネスを構築することからもたらされる利益を得ることができるのだ。

・・・

原文記事は https://www.forbes.comに掲載されました。

原文

『Empathy in Artificial Intelligence』

著者

Jun Wu

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん