人工知能学会が刊行する学会誌『人工知能』2021年3月号が、3月1日に発刊されました。

『人工知能』は編集委員がテーマを決め、AIに関連する有識者が記事を持ち寄って掲載している学会誌で、2ヶ月に1回発行されます。私たちに身近な分野や話題のAI研究などが扱われていて、AIの現状の課題や最新のAI情報を得ることができる、30年以上の歴史がある学会誌です。AINOWでは各号の特集内容を、研究者の方々へのインタビューを通して紹介しています。

前号2021年1月号の紹介記事はこちら▼

今回は小特集「AI原則から実践へ」の担当された江間 有紗氏にインタビューを行いました。

この特集ではAIの倫理やガバナンスのコミュニティ形成を牽引する海外の女性有識者たちから寄せられた5つの記事が紹介されています。

江間氏はこの有識者たちへの執筆依頼から原稿の翻訳をご担当されました。

AIにおける倫理問題に関して社会科学的視点から研究されている江間氏が、今回の特集をまとめあげる上で感じたAIの倫理問題の現状や海外の動向、そして特集の読みどころに関して伺いました。

東京大学未来ビジョン研究センター准教授。2017年1月より国立研究開発法人理化学研究所革新知能統合研究センター客員研究員。専門は科学技術社会論(STS)。人工知能学会倫理委員会委員。日本ディープラーニング協会理事。2012年東京大学大学院総合文化研究科博士課程修了。博士(学術)。

目次

世界と日本におけるAI倫理の取り組みの現在地

世界で進む「地球規模のAI活用」-国連やユネスコでも議論

AIによる性差別や人種差別、それによる事故の発生や企業の信頼問題など、今後AIが普及していく上で大きな問題として世界中で取り上げられています。

日本でも2020年4月、日本IBMと子会社などの従業員約120人による労働組合が同社のAI「Watson」を使った人事評価や賃金決定の施策に対し「判断の過程がブラックボックス化している」と反発して東京都労働委員会に救済を申し立てました。

このようにAIを活用していく上で倫理的問題を考えることは避けては通れなくなっており、世界中で議論が活発化しています。

ーー今回、寄稿の翻訳をご担当された上で感じられたことや世界のAI倫理の現状について簡単にお聞かせください。

江間氏:何を議論すべきか、という原則のコンセンサスはできつつある、と言いますが、その実践やどのようなことが問題になるのかは、かなり地域性があるな、と感じました。

例えば、日本ではまだ、イノベーションといった経済利益に基づいた論調で使われがちなAIですが、(他の地域では)地球温暖化問題、難民や奴隷問題といった地球規模の問題解決にもAIが使われています。またどんどん高度化していくAIは一企業に独占されてしまってはならず、協働と競争のバランスをどのように維持する枠組みを作るかといったことも、産学官民などの連携を中心として活発に議論されています。

ーー世界ではAIによる利益の追求だけではなく地球や未来のことまで考えたAI活用のあり方が検討されているのですね。国際的にはどのような機関がそのようなAIやDLについての倫理・公平性について議論を行っているのでしょうか。また、その内容はどのように発信されているのでしょうか。

江間氏:OECDは2016年などかなり初期の段階から、AIの適切な管理などに関する議論を始めていました。ちなみに日本は総務省が頑張っており、かなり初期の段階からOECDと連携をしています。

また、本特集には入りませんでしたが、国連のさまざまな機関、例えばユネスコなどもAIの影響や利活用について議論をしてきています。また2020年からは、GPAI (Global Partnership on AI)という国際的な議論のプラットフォームができ、そこでもデータ利用や雇用などいくつかの分科会に分かれた議論が行われています。

そのほか、WHOやインターポールなども個別領域ごと(医療や法執行機関)におけるAI利活用についての、原則やツールキットなどに関する議論を開始しています。これらの多くは国際的で異分野、異業種の専門家による委員会から結成されており、データベースや事例集、ツールキットなどが公開されているか、あるいは近々公開予定です。

日本特有の”長い産業構造” AIのガバナンスを考え、事例を発信していくことが求められる

ーーそうした世界の動きがある中で、今後日本がAI倫理の分野で担っていく役割はなんでしょうか。

江間氏:AI倫理、というよりはAIのガバナンス(舵取り、管理)といったほうが適切かもしれません。

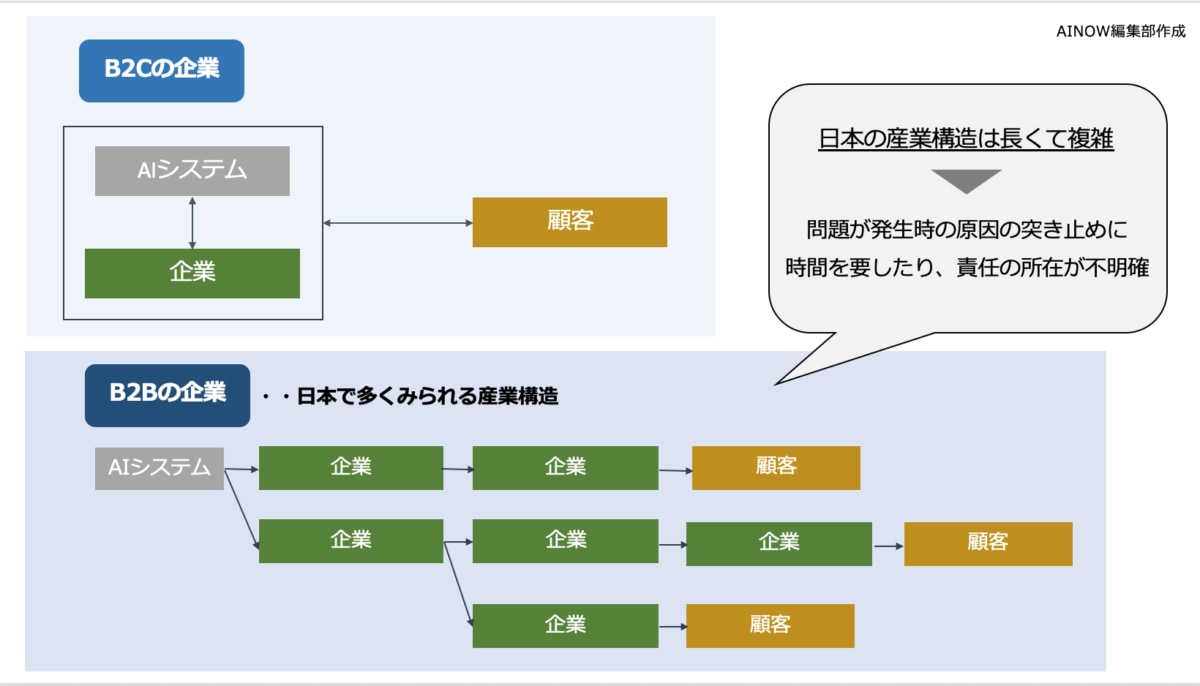

ガバナンスというと、誰がその舵取りを行うのかという主体が意識されます。第一義的にはAIに関するさまざまな課題をかじ取りしていくのは、サービスを展開する企業となります。

ただ、日本では、GAFAのようなB2C企業と異なり、下請けや業務委託などサプライチェーンの長い産業構造を持つという特徴があります。その中で、いかにして適切に消費者にいたるまでガバナンスができるか、を考えていくことが課題となります。

また、近年では、政府によるデータ管理、AI利用などもあるほか、学習するというAIの特徴を考えた場合、利用者や消費者事態によるAIの加工や悪用といったことも考えられます。このような状況になると、AIに関する問題の責任の所在がどこにあるのかが不明確になります。そのためにも、具体的な事例を共有、公開していくことが、他の企業や国にとっても参考になります。特に、日本からの事例発信は非常に国際的にも少ないのが現状です。

議論が中心だったAI倫理、実践に落とし込むには?

AIの議論と実践は双方向に、アジャイル的に作り上げて行く

世界的にAIの倫理問題やガバナンスをどうしていくかの議論が活発化している中で、「実践」へ足を踏み出すとなると難しいように感じている企業も少なくありません。

ーー向かう方向が定まったとき、実際に何を始めればいいのでしょうか。

江間氏:向かう方向を決めるのと実践は、一方向ではなく双方向である、と考えたほうがいいと思います。

AI自体が作って終わりというものではなく、アジャイルに作っていくこと、あるいは常に変化していく永遠のβ版といった要素が強いものです。当初の目的外利用も起こりえますし、想定していなかったユーザに(良くも悪くも)思いがけない方法で、使われることも起こりえます。国内外の様々な潮流にアンテナを張っておき、何かAIに関する事件や事例が起きたら、他山の石として、適切に対応をしていくといった機敏性が求められることになると思います。

ーー世界でますますAIの倫理問題がフォーカスされていく中で、これからどのようなポイントで議論を進めていくことが必要でしょうか。

江間氏:まずは、特集に書かれているようなAIに関する問題が「存在する」ということを認識することが重要かと思います。日本にいると、特集で多く議論されているような公平性の問題はそれほどまだ起きていないように思います。しかし、人種やジェンダー、出身地域、年齢などカテゴリによるバイアスの問題は、AIが展開していくにつれ、問題が大きくなっています。

また、アクセスの不平等、プライバシー、問題発生時の責任の所在などAI以前からの宿題にも取り組んでいかなければなりません。これは一部の専門家だけではなく、利用者や消費者、あるいは利用できていない人、声を上げられない人たちの声も拾うという目くばせをしながら、議論をしていく必要があります。言うは易し、ですが実践は難しく、具体的な方法論やツールに関しても、世界各国でまだ発展途上です。

今後の展望と今回の特集に込める想い

ーー今回の小特集のタイトル「AI原則から実践へ」とされた理由を教えてください。誰のどういった実践なのでしょうか。

江間氏:2016年ごろから、AIの公平性や安全性、頑健性などなどに関する様々な原則が、世界各国で公開されています。発行主体は企業、国家、産業団体、NPOなどさまざまです。原則そのものには大まかなコンセンサスはできつつありますが、ではそれをどう実践に落とし込んでいけばいいのか。

たとえばAIの公平性を担保するというにしても、公平性とは何を意味するのか。どうしたら、透明性を担保したことになるのか。医療AIとスマートスピーカーでも考え方は異なる可能性もあります。From Principle to Practiceとは、このような状況において、個別の具体事例、取り組みについて考えていこうとするメッセージを出すためにつけました。

ーー特集のポイント、読みどころを教えてください。

江間氏:原則と実践の双方向性にも絡んできますが、実践をするにあたって誰をどのように巻き込んで考えていくか自体を定期的に見直していく、自問していくことが大事だと思います。

人工知能学会でもダイバーシティ&インクルージョンで特集が作られましたが、この言葉自体にも気を付ける必要があります。本特集の中でも、多様性と包摂性という言葉が繰り返し出てきます。多様性と包摂性という価値は目指すべき原則ではありますが、私たちは、その価値と適切に向き合っているかを改めて問うているのが、各寄稿ににじみ出ています。

包摂性を担保するといいつつ参加の搾取になっていないか、多様性という大変さをちゃんと理解しているか。そして何より、AI倫理やガバナンスをしているということ自体が、サービス展開の免罪符になっていないかなど、この分野にかかわる人間にとっては耳の痛い、ただし重要な指摘がされています。

ーー江間氏ご自身は今後どういった活動を行っていきたいですか。

江間氏:短期的には、事例を発信していきたいと思います。

現在、幸いにも、抽象論ではなく、国内外の現場の人たちと具体的なボトムアップの議論に参加することができています。個別事例をある程度まで抽象化して、事例集として共有、公開していける仕組みを作れたらいいなと考えています。

例えば、東京大学ではリスクチェーンモデルというフレームワークを使って現在、さまざまなケースを蓄積しています。2021年夏くらいまでにはいくつかケースレポートを公開できるのでは、と考えています。また、日本ディープラーニング協会ではAIガバナンスとその評価研究会を開催しており、保険や監査、第三者委員会などAIの課題に対応するための外部環境をどのように「AIガバナンス・エコシステム」として整備していくかを関係者の方々と議論しています。これも、夏には報告書を日英で発信していけるのではないかな、と考えています。

また、もう少し幅広に、現在AIと社会をめぐってどんな議論が起こるのか、ということに関しては、現在「絵と図でわかるAIと社会」という本を5月中旬に出版予定です。AI関係者だけではなく、中高生、企業や政府の法務や広報など、これからAI開発をするあるいは利用をする人たちにも知ってもらいたいと思うことを詰め込みました。

今回江間氏が翻訳した寄稿の原文はこちらから読むことができます。▼

江間氏 著書「絵と図でわかるAIと社会」(2021/5/21発売予定)の詳細はこちら▼

人工知能学会 学会誌 『人工知能』 2021年3月号

2021年3月号では今回紹介した小特集「AI原理から実践へI」の他に特集として、

- 特集「企業における研究開発部門の役割と創出価値」

- レクチャーシリーズ「AI哲学マップ」(第1回)

- 合同研究会2020開催報告

などが取り上げられています。

「AI哲学マップ」はAIマップβに新たに追加される予定の俯瞰図であり、シリーズ第1回がこの3月号から始まりました。

第1回では、日本におけるAI研究のパイオニアとして知られる中島秀之先生(札幌市立大)、人工知能学会「AIマップβ」プロジェクトを主導された堤富士雄先生(電中研)を迎え、AIのフロンティアを切り開いていく上で哲学が果たしている重要な役割について語られています。第2回以降は、AI研究者と哲学者の対談を重ねることで、「AI哲学マップ」を構成していくことが目指されています。

『人工知能』編集委員長である清田氏に3月号に込めた思いをコメントしていただきました。

清田氏:AIの倫理やガバナンスをめぐる問題は、「面倒」「自分にはあまり関係がない」と受け止められることも少なくありません。しかし、本小特集の記事で取り上げられている多くの事例は、この問題に最初から真摯に向き合い、議論と実践を積み重ねることの大切さを教えてくれます。

すでに確立したAIシステムを事後的にAI原則に適合しようとすることは、つまらない話に終始してしまいがちですし、江間さんが指摘されているように、AI原則を隠れ蓑、免罪符にしてしまうことにもつながりかねません。むしろ、そもそもの開発段階からAIに倫理という観点を組み込んだり、「倫理的なAI」にするための根本まで掘り下げて考えたりすることで、逆にすごく画期的なAIシステムが生まれる可能性もあります。皆さんの研究をより面白くするヒントを得るという視点で、ぜひ「AI原則から実践へ」小特集を読んでいただければと思います。

レクチャーシリーズ「AI哲学マップ」第1回では、中島秀之先生、堤富士雄先生に、AI研究に哲学が果たしてきた、あるいはこれから果たしうる役割について語っていただいています。また、私を含む企業研究者4名による共同特集企画「企業における研究開発部門の役割と創出価値」は、企業の研究開発(R&D)の第一線で活躍されている11グループ13社の16名の方々からご寄稿いただき、企業R&Dの全貌を知ることができる充実した特集となっています。こちらもぜひお目通しください。

人工知能学会の個人会員であればこちらから無料で閲覧可能です。▼(非会員でも一部無料で閲覧できます。)

ご購入はこちらから▼(Amazonページに飛びます)

おわりに

AIにおける倫理問題は今後より一層活発に議論が展開されていくでしょう。いかに多くの人を巻き込み、誰もAIによる差別を受けない世の中を作れるかはIT化が急速に進む日本や世界全体の課題です。

また、AIを扱う専門家や企業で働く人たちだけでなく、製品やサービスを利用する私たち消費者もこのAI倫理について考えていく必要があります。公平性やプライバシーの問題はこれからのIT社会を生きる私たち自身が考えていかなくてはなりません。

その中で、江間氏の指摘するような多様性と包摂性が求められます。体裁だけ取り繕った取り組みや議論になっていないか、再度見直す必要があるでしょう。世界中で起こっているAI倫理を巡る議論・取り組みをリアルに伝える今回の特集は必読です。

『人工知能』2021年3月号、ぜひ手に取ってお読みください。

過去の学会誌はこちら▼

人工知能学会に関して詳しくはこちら▼