自然な英文を生成できる自然言語処理AIであるGPT-3の登場以降、英文記事を執筆するライター業がAIによって代替されることが現実味を帯びるようになりました。こうしたなか、Romero氏はAIによるライター業の代替が実際に起こる根拠として、以下のような5項目を挙げています。

AIがライターの脅威となる5つの理由

|

以上のように根拠を挙げたうえで、言語AIが将来的にライティング業界を大きく変革するだろう、とRomero氏は結論づけます。そして、そうした変革を生き延びるためには、言語AIと共生関係を築くのが得策、とも述べます。

英語の言語AIの進化が著しいのは周知の事実ですが、日本でも「ELYZA DIGEST」のような実用的な言語AIが登場しています。それゆえ、日本においても言語AIと人間の共生関係の構築が急務と言えるでしょう。

なお、以下の記事本文はAlberto Romero氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

画像出典:UnsplashのThought Catalogより

目次

オンラインライティング業界は激変するかも知れない。

AIがこの記事を書いていたとしても、読者諸氏はそれを知る由もない。

しかし、はじめに問うべきことがある。AIが記事を書くことを論じるにふさわしい私の資格とは何か。

私はAIスタートアップで3年間働き、リアルタイムの手話翻訳機を作るプロジェクトに深く関わっていた。自然言語の処理と生成システム(NLPとNLG)、つまり読み書きができるAIなどに精通している。

また、このプラットフォーム(Medium)でAIと書き言葉の関係について私は記事を書いており、そのなかには驚異的なパフォーマンスで世界を席巻したOpenAIのGPT-3から、Wu Dao 2.0、MicrosoftのGitHub Copilot、そしてFacebookのBlenderBot 2.0といった最近のAIを取り上げてきた。

・・・

星新一賞は、日本の国民的文学賞である。毎年、人や機械が作品を応募し、4段階の審査を通過して受賞することを目指している。そう、この賞では機械も作家として認められているのだ。2016年は、AIが生成した小説が初めて応募された年であった。このことは、AIが受賞しそうになった年とも言える。

『コンピュータが小説を書いた日』。AIが書いた小説にしては、かなり独創的なタイトルだ。AIが人間に特有の機能である再帰性を初めて示唆している。AIは、AIが小説を書くことについての小説を書いた。AIにしては、とてもメタ的だ。この小説は一次審査を通過したが、審査員の長谷敏司氏は「受賞するにはキャラクターの描写など、いくつかの問題が残っている」と述べた(※訳註1)。

以上は2016年の出来事だ。GPT-3はまだ存在していなかった。基礎となる技術すらまだ存在していなかったのだ。(現代のあらゆる言語モデルを支えるディープラーニングのアーキテクチャである)Transformerが発明されたのは2017年のことだ(※訳註2)。『コンピュータが小説を書いた日』の発表から数年が経過し、言語AIは成熟した。自然言語の生成は、今日のAI研究における最前線のひとつだ。それゆえ、文章生成AIシステムは、言語に関連する多くの人間の仕事に対してますます脅威となっている。そんな脅威のなかでも、「書く」ことは最も危機に瀕している仕事の1つだ。

今回の記事では、AIがライターにとって脅威となる5つの理由を紹介する。最新の言語生成技術とは何か、現在の言語モデルはどれほど優れているのか、そして私たちの仕事を危険に晒している文章生成システムが活用され得る方法とはどういうものなのか、について以下に書く。

・・・

AIはほとんど何でも書ける

AIに関わる人々は、Transformerのアーキテクチャに秘められた力をすぐに理解した。並列してテキストを学習・処理できるこの一種のニューラルネットは、NLPの聖杯となった。数年かけてTransformerの性能を向上させた後、ある研究者グループは新しいことを試すことにした。インターネット上のほとんどのデータを使って、教師なしの方法でモデルを学習させたのだ。すべてのデータにラベルを付ける必要がないので、時間とコストの節約になった。そして、そのモデルを大規模にすることにした。かくして、非常に大きなモデルとなった。

以上が起きたのは昨年のこと。そのモデルとは、OpenAIのGPT-3と呼ばれるものであった。

GPT-3を試してみると、その可能性が見えてきた。だがOpenAIが発表した論文は、このシステムの能力を説明するには不十分であった。エッセイ、詩、歌、ジョーク、そしてコードまで書けることがわかったのだ。アナロジー(類比)、哲学、料理のレシピ、常識、さらには人生の意味などについても試せる。広告のデザインやEメールのリライト、広告文を書くのにも役立つ。有名人になりすまして、歴史上の偉大な作家の文体や名人芸を真似られた。

繰り返すが、以上は去年の話だ。今年には、GPT-3の能力はもはや時代遅れと言ってもいいだろう。多くの人がOpenAIの言語モデルのアプローチをコピーして、より優れたシステムを作っている。

今年の5月、Googleは新しいチャットボットを発表した。「LaMDA(ラムダ)」と呼ばれるこのチャットボットは、感覚的かつ具体的で、興味深くて事実に基づいた会話ができる。「私は、自分がただの氷の球ではないと知ってほしいのです。私は実に美しい惑星です」と、Googleの開発者との会話のなかで、冥王星になりすましたLaMDAが語った。AIが願い事なんてするのだろうか。次は、AIがバーチャルな人間の頭脳になるのだろうか。

6月、北京人工知能アカデミー(BAAI)は、GPT-3の10倍にあたる1兆7500億個のパラメータを持つ、史上最大のニューラルネットワーク「Wu Dao 2.0」を発表した。このシステムの最も印象的な応用例は、初のバーチャル学生であるHua Zhibingに「命」を与えたことだ。彼女は継続的に学習し、詩を作り、絵を描き、コードを書ける。しかも、GPT-3のようにその方法を忘れてしまうことがない。

Facebookは7月、会話を通じて新しい情報を獲得するために記憶や知識を保存し、インターネットにもアクセスできる新しいチャットボット「BlenderBot 2.0」を発表した。GPT-3は記憶を持たず、すぐに古くなってしまうため、たとえ1年しか経っていなくても、過去の遺物となってしまう。一方、BlenderBot 2.0は、会話の相手と仮想の「関係」を築ける。

以上のような新しい波は、まだ始まったばかりだ。AIはTransformerの誕生以来、多くのブレークスルーを経験してきたが、技術開発の大きなスケールのなかでは、(Transformerが誕生してからの)4年間は無に等しい。次の10年で、言語AIはより良くなる。より多くのデータを供給し、より強力なコンピュータやより洗練されたアーキテクチャが使われ、マルチモーダルやプロンプトプログラミングなどの機能が追加されていくだろう(※訳註3)。

AIは、言語を操ることを覚えた。そして、書き言葉はAIの得意分野だ。しかし、AIが書けるということは、上手に書けることを含んでいない。

ほとんどの人間は書くことができる。だがほとんどの人間がきちんと書けるわけではない。AIはどうだろうか。

2021年に知っておくべき5つのAIの概念

|

概念名 |

概要 |

| Transformer | 現在の自然言語処理技術の基礎となったモデル。最近では画像認識にも応用されている。AINOW翻訳記事『【GoogleAIリサーチブログ記事】大規模画像認識のためのTransformers』も参照 |

| 自己教師あり学習 | 教師あり学習の難点である学習データのラベリングを不要とする学習技法。 |

| プロンプトプログラミング | プログラミング内容を自然言語で入力すると、その内容を反映したコードを出力するコード生成AIを活用したプログラミング技法。この技法の詳細と可能性については、AINOW翻訳記事『AIはプログラマーを代替するのか』を参照。 |

| マルチモダリティー | 複数の知覚や知的活動を横断的に処理するAIの在り方。OpenAIが2021年初頭に発表したモデル「DALL・E」が代表例。テキストを入力するとテキストの内容と一致する画像を出力する同モデルは、自然言語処理、画像認識、そして画像生成が融合したものである。同モデルについては、AINOW翻訳記事『DALL·E を5分以内で説明してみた』を参照。 |

| マルチタスクとタスク転移 | マルチタスクとは、単一のAIモデルがさまざまな種類のタスクを実行できること。タスク転移とは、特定の学習内容を新規のタスクの実行に応用できること。マルチタスクはさまざまな言語タスクに対応するGPT-3に、タスク転移はさまざまな分類クラスの画像認識が追加学習なしで可能なCLIPにそれぞれ認められる。 |

なお、次世代のディープラーニング技術については、Romero氏執筆のAINOW翻訳記事『人工知能を次のステージに導く5つのディープラーニングのトレンド』およびAINOW記事『NEDOが「人工知能(AI)技術分野における大局的な研究開発のアクションプラン」を公表』も参照のこと。

・・・

AIはすでに人間レベルのライティングを達成している

2020年7月、メールマガジン「Nothing but Words」を執筆するLiam Porr氏が、非生産性と考えすぎについての記事を発表した。その記事が主張したテーゼとは何か。クリエイティブな思考が解決策となるというものであった。しっかりと構成された自己啓発記事で、コメント欄では「HackerNewsで見かける99%のデタラメ記事と全く同じ」と指摘された。生産性向上はデタラメ記事でお決まりの論題だ。技術に精通していることで知られるHackerNewsの読者がこの記事にコメントを寄せたが、そのなかでトリックを見つけた人はほんの一握りであった。

トリックの種は何であったか。Porr氏の記事は、GPT-3によってすべて書かれたものだったのだ。興味深いことに、この記事にはクリエイティブな思考は一切見られず、生産性向上のための101のレッスンを再利用しているかのようだった。しかし、同氏は多くの人に本物の記事だと思わせることに成功した。

以上の顛末を別様に語ってみよう。Porr氏はGPT-3を使って、生産性向上のための記事をメルマガ購読者に送ることに成功した。そして、同氏はGPT-3が書いた記事だけでメルマガ全体を作ることがいかに簡単かも悟ったのだ。

「GPT-3は、人間の読者を素早く獲得するのに十分な性能を持っているのか。明らかに、その答えはイエスだ」- Liam Porr

AIが生成した記事が人間の読者を騙した例はこれだけではない。GPT-3の論文では、システムの主な能力として、ニュース記事の生成に言及している。「GPT-3が作成した記事を検出する人間の平均的な精度は、52%をかろうじて上回った」。意識的にGPT-3の記事を検出するタスクに取り組んだ人間の判定者の半分は、人間が作成した記事と混同したのだ。

もし、私たちがその可能性に気づいていない時に、AIが書いた記事を浴びせられたらどうなるだろうか。それは今、私たちの目の前で起こっているかも知れない。

脅威は、AIが文章を書くことを学んだことではない。本当の脅威は、AIが人間の優秀なライターと同等のレベルの文章を書けるようになることだ。論文で紹介されている一例を紹介しよう(参考までに、判定者がGPT-3が書いたものか識別するのに最も苦労した記事である)。GPT-3への入力は太字部分である。あとはシステムが書いた。それでは、読者諸氏がその出来栄えを判断してほしい。

記事タイトル:ユナイテッド・メソジストが歴史的な分割に合意

サブタイトル:同性愛者の結婚に反対する人たちは、自分たちの教団を作るだろう

記事本文:ワシントン・ポスト紙によると、ユナイテッド・メソジスト教会は、2日間にわたる激しい議論の末、歴史的な分裂に合意した。この分裂は、「神学的にも社会的にも保守的」な新しい教団の創設につながると予想される。5月に開催された教会の年次総会に出席した代議員の大多数は、LGBTQ聖職者の聖職者就任の禁止を強化し、同性結婚式を執り行った聖職者を「懲戒」する新しい規則を書くことを決議した。しかし、これらの措置に反対した人々は、新たな計画を練っている。彼らは2020年までに独立した教団を結成し、自分たちの教会を「クリスチャン・メソジスト教団」と呼ぶ、とのこと。

1,250万人の会員を擁する同教団は20世紀初頭には「アメリカ最大のプロテスタント教団」であったが、ここ数十年は縮小傾向にある、とポスト紙は指摘している。今回の分裂は、同教会の歴史のなかで2回目となる。最初の分裂は1968年で、教団の約10%が離脱して「福音主義ユナイテッド・ブレザレン教会」を結成した。今回の分裂案によって「長年にわたって会員数を減らしてきた教会にとって重要な時期が到来する」、とポスト紙は指摘する。分裂案は「教会におけるLGBTQの人々の役割をめぐる分裂をその限界まで推し進めている」とも同紙は述べた。教会を分裂させている問題は、同性愛者の結婚だけではない。2016年には、トランスジェンダーの聖職者の叙任をめぐって教団が分裂し、北太平洋地域会議はトランスジェンダーが聖職者として奉仕することを禁止する投票を行い、南太平洋地域会議は容認する投票を行った。

AIが書いたとわかっていても、以上には驚嘆する。

・・・

AIは言葉を理解していなくても上手に書ける

言語モデルの欠点は、自分が書いたものを1つも理解していないことだ。AIは言語の構造や形式、つまり構文を習得しているが、意味については全くわかっていない。私たち人間にとって言語は、言葉とそのコンテクストを結びつけることでその機能を完成させる。以上のユナイテッド・メソジストについての短いエッセイは、私たちにとって多くの意味がある。GPT-3は、以上のエッセイを確率計算によって書いた。GPT-3が扱うのは、(意味ではなく)ただ1と0の数値でしかない。

しかし、ここで朗報がある。言語AIは、言語を理解していなくても、うまく構造化された創造的な文章を生成できるのだ。文章の送り手の役割を果たしているGPT-3は、前述のPorr氏の記事を書いたとき、何も意図していなかった。しかし、読者である私たちは、そこから価値を得られる。私たちは意図と価値を無意識のうちに結び付けるため、(意図と価値は別個なものであるという)この考えを理解するのが難しい。私は何らかの気づきを伝えたいと思ってこの記事を書いており、自分の意見が伝わって欲しいと思っているので、読者諸氏が私の文章から何かを得られる。GPT-3は意図できないが、だからといって出力の本質的な価値は無くならない(※訳註4)。

AIが文章を出力する場合、人間のように意識を伴っていない。AIは入力された文字列に対して、統計的に正解の確率が高い文字列を出力しているに過ぎない。しかし、AIには意識がないにもかかわらず、人間はAIが出力した文字列に意味を見出す。こうした事態は、人間が文章の意味を理解するために文章の書き手が意識を持っている必要がないことを証明している。

・・・

AIは悪い文章を作るかも知れないが、いつでも編集できる

私たち人間は、自分が書いたものを見直せる。書いた文章を自分で読み返すか、あるいは他人に読んでもらってフィードバックを得られる。構造、文体、言葉の選択が適切かどうかを自問できる。そんな風に私たちは書く。そして書き直す。AIには自己認識や自己反省がないので、文章が乱れてしまうことがある。この記事で使用した例は、文章生成システムが出力したものでも最高のパフォーマンスを発揮したものであることを強調しておきたい。しかし、それらのシステムが出力する文章はいつもきれいなわけではない。

以上の指摘は、言語AIをめぐる誇大広告に対する重要な批判の1つだ。それらは良い文章を書ける、それは正しい。しかし、言語AIが悪い文章を書く割合はどのくらいのか。それらはループに陥ったり、トピックを見失ったり、あるいは単に論題を忘れて支離滅裂な議論をしたりする。100%正しいことをしなければならない仕事をAIで処理する場合には、こうした失敗事例が批判されるのは正当なことである。しかし、ライティングにおいてはそうした批判は当てはまらない。その理由は、書いたものをいつでも編集できるからだ。

ライティングのプロセスは最も自動化しやすいものだ。そもそも、(途中経過で)どの程度うまくできているかということは、最終的な制作物に関して少ししか関係しない。だからこそ、成功した作家のいちばんのアドバイスは、「とにかく書け」なのだ。なぜならば、たとえ最初の出来が悪くても、あるいは第一稿が読むに堪えないものであっても、後で編集すればいいからだ。

私がGPT-3に自己啓発記事を書くように促したところ、10分で10種類の出力が得られた。その後、単純にメインのアイデアを抽出して残りをリライトしたり、ベストな記事を選んで軽く編集したりもできる。

(GPT-3を使えば)あなたが1本書くのにかかる時間で、私は1日に10本の記事を公開できるのだ。

・・・

ライティングAIはアクセス、使用、活用が容易

良いAIライターを作るには多額の費用がかかる。このようなシステムを設計し、構築し、訓練し、実装する余裕があるのは最大手のテック企業だけだ。GPT-3の訓練には、OpenAIが推定1,200万ドルを費やした。同機関は最先端の大規模なニューラルネットワークを作り続けたいのであれば、ビジネスモデルを変える必要があると考え、Microsoftと業務提携した。その結果、Microsoftは、汎用人工知能の開発を支援するためにOpenAIに10億ドル投資した。

しかし、一度GPT-3を公開してしまえば、同AIを開発するのに比べれば(ユーザにとって)それを使うのにかかる実質的なコストは無に等しい。現在、ユーザ料金は2,000トークンで月額100ユーロからとなっているが、この料金設定で可能なのは約3,000ページのテキスト、あるいは150万語に対する自然言語処理である(※訳註5)。この文字数は、私たちが1年で読める量を超えている。もし、成果をマネタイズする方法を見つけたら、この100ユーロは無に等しい。

一般公開されている最も強力な言語モデルを利用するための唯一の障壁は、毎月100ユーロを支払う余裕があるかどうかなのだ。

GPT-3を月額利用すれば、自分が書いたわけでもない記事を、自分が開発したわけでもないAIを使って公開して、毎月何千ドルも稼げるのだ。そうは言っても、同AIによって稼ぐのに利用者が何の価値創出に貢献していないことにはならない。(同AIが生成した文章を)組み合わせたり、システムに働きかけたり、編集したりすることは、誰もが持っているスキルではない。しかし、ライティングスキルがほぼゼロの状態からよく練られた記事を売れるようになるのが簡単になってしまうことに対して、少なくとも既存のライターは快く思わないだろう。

もし誰もがAIを使って文章を書けるようになったら、ライティングはますます価値の低いスキルになるだろう。AIがライターを完全代替することはないかも知れないが、書くことで私たちが生み出す価値が一定であったとしたら、ライター業の価格は大きく下落するだろう。

Open AI APIの価格表

|

モデル名 |

1,000トークン当たりの価格 |

| Davinci(ダヴィンチ) | 0.06ドル |

| Curie(キュリー) | 0.006ドル |

| Babbage(バベッジ) | 0.0012ドル |

| Ada(エイダ) | 0.0008ドル |

もっとも高性能なのは、Davinciモデルであるが計算コストとトークン価格が高くなる。処理するタスクによっては、下位モデルでも十分な性能を発揮する。各モデルの詳細については「エンジン」ページを参照。

なお、本記事で価格がユーロで書かれているのは、著者のRomero氏がスペイン人だからである。

・・・

緊張をほぐすための楽観的なまとめ

共通の問題

将来AIがライティング業界に影響を与えるのは事実だ。しかし、それ以外のほぼすべての業界にも影響を与えるだろう。最近のレポートでは、15~20年後には全職種の約40~50%がAIに代替される可能性があると推定されている(※訳註6)。「クリエイティブ、サービス、知識ベースの職業」さえも(AIによる代替から)安全ではないことが、ますます明らかになっている。文章を書く仕事だけが危機に瀕しているとしたら、それは確かに悪い兆候だろう。しかし、AIはユビキタスなものなので、リスクにさらされているすべての人を助けるための一般的な解決策や政策を見つけることを目指すべきである。この問題は孤立した問題ではないので、適切な戦略を立てて取り組める人たちの注目を集められるだろう。以上がこの記事で伝えたいことだ。

部分的な問題

OpenAIのCEOであるSam Altmanは、2ヶ月前に以下のようなツイートを公開した。

Prediction: AI will cause the price of work that can happen in front of a computer to decrease much faster than the price of work that happens in the physical world.

This is the opposite of what most people (including me) expected, and will have strange effects.

— Sam Altman (@sama) June 13, 2021

予測:AIによる仕事の価格の下落は、物理的な世界で起こる仕事よりコンピュータの前で起こせる仕事のほうがはるかに速いだろう。

以上は(私を含む)ほとんどの人が予想していたこととは逆で、奇妙な効果をもたらすだろう。

彼はAIがブルーカラーの仕事よりもホワイトカラーのコンピュータを使った仕事に影響を与えると予測している。ライティング、コーディング、事務作業…。定型的な仕事も非定型的な仕事も同じように影響を受ける。

しかし、AI(またはその他のテクノロジー)がオンラインライティングの業界を完全に破壊する可能性は極めて低いと考えられる。テクノロジーは常に予測できないかたちで世の中の変化を生み出してきた。業界全体が激変し、人々が別の場所で生計を立てなければならなくなるケースは非常に稀だ。

共生関係

(AIの脅威を解決する)最良の方法はAIと友達になることであり、私もそうするつもりだ。私たちは日々の生活のなかで、AI以外のテクノロジーを常に統合してきた。車、コンピュータ、スマートフォン、インターネット、ソーシャルネットワーク…。AIはすでにそうなっているように、あちこちで労働者を代替していくだろうが、ほとんどの人はAIと共生関係を築けるだろう。

それぞれの部分の合計よりも価値のある相乗効果を生み出す方法を見つければ、AI(との共生関係)は有利に働く。私たちにしかできないユニークな価値を生み出し続けると同時に、新しい技術を活用すれば、私たちの価値は高まるのだ。

書き続けること

最後のまとめは、書き続けることだ。自分の技術を磨き続けること。そして、人々が読みたいと思うような価値ある作品を作り続けることだ。この記事は、実現するともしないとも言える未来を描いている。今、心配する必要はない。ただし、この記事で伝えたことを心に留めておき、来たるべき未来に向けて、自分が最高のポジションにいるための戦略を立てることを学んでほしいのだ。

そうしたレポートでもっとも有名なのが2013年にオックスフォード大学が発表したもので、今後20年間でアメリカの仕事の47%が自動化されると予想している。カナダのBrookfield Institute for Innovation + Entrepreneurshipが発表したレポートは、カナダの労働人口の40%が2020~2030年のあいだに自動化されると予想している。

オックスフォード大学と調査会社デロイトが発表したレポートは、2030年までにイギリスにおける85万人の仕事が自動化されると予想している。そして、国際労働機関(ILO)が発表したレポートでは今後20年間で東南アジア5ヵ国(カンボジア、インドネシア、フィリピン、タイ、ベトナム)の1億3,700万人の仕事が自動化されると予想している。

ちなみに、日本では2015年に野村総合研究所が労働の自動化に関するレポートを発表している。そのレポートは、日本の労働人口の49%が10~20年以内に自動化されると予想している。

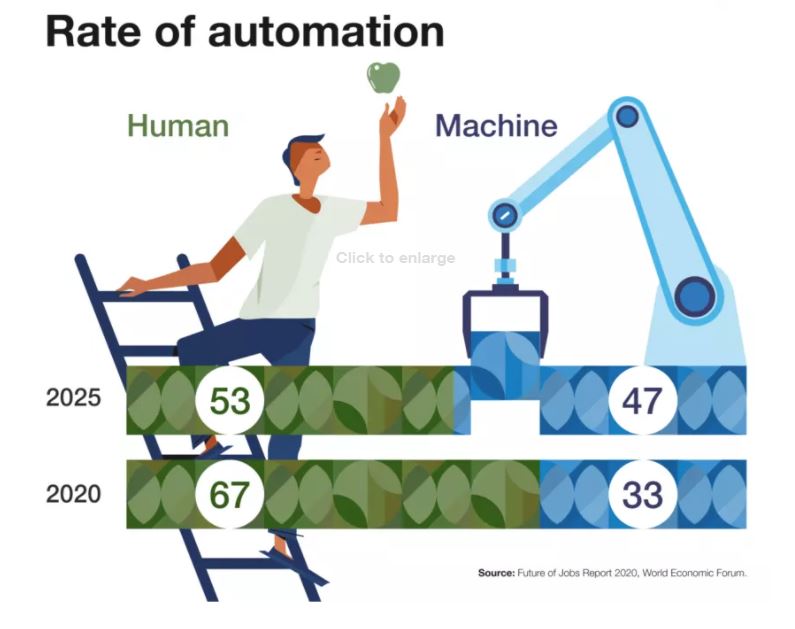

また、最近では世界経済フォーラムが2020年10月に「仕事の未来に関するレポート 2020」を発表している。そのレポートは2020年における世界の全労働における人間と機械の分担比率は人間が67%、機械が33%であるのに対して、2025年には人間が53%、機械が47%と機械の割合が増えると予想している(以下の画像も参照)。

仕事の未来に関するレポート 2020」より画像を抜粋

・・・

私の無料週刊メールマガジン「Minds of Tomorrow(明日の精神)」を購読して、人工知能に関するより多くのコンテンツ、ニュース、意見、洞察を手に入れましょう!

また、LinkedInやTwitterでもお気軽にお問い合わせください。:)

・・・

おすすめの記事

原文

『5 Reasons Why AI Is a Threat to Writers』

著者

Alberto Romero

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん