周知のように、2022年はテキストから高品質な画像を生成するAIモデルが次々とリリースされた「テキスト画像生成AI元年」とでも言うべき年です。同種のAIモデルでは相対的に後発のStable Diffusionに関して、Romero氏は画期的なものだと絶賛します。というのも、同モデルはパラメータの重みやコードを完全に公開したオープンソースだからです。こうした理由により、開発者は同モデルを活用して新たなアプリを自由に作れます。また一般ユーザに対しても、画像生成数などを設定して同モデルを利用できるウェブアプリDreamStudio Liteを公開して、幅広い支持を得ました。

Romero氏は、Stable Diffusionの登場によって難問が生じることも指摘しています。その難問とは、オープンソースのテキスト画像生成モデルを活用する際の倫理と法の整備です。この難問に対して、既存の考え方を安易に適用するのではなく「未知の領域」と認識したうえでオープンな議論をすべき、と同氏は主張しています。

なお、以下の記事本文はAlberto Romero氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

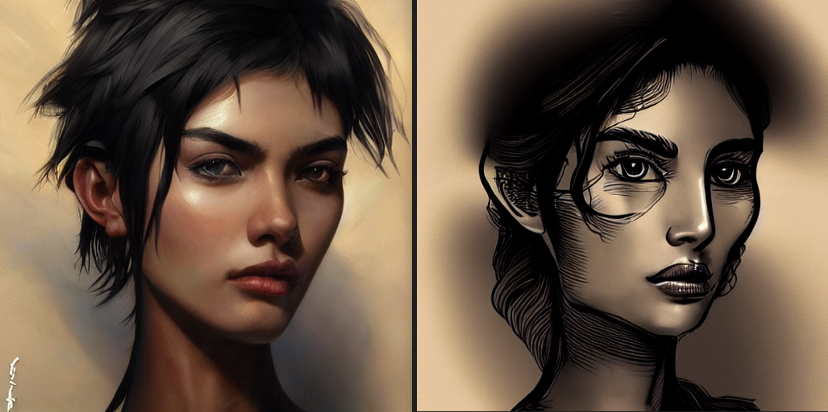

クレジット:HollyB#1382(ポートレート)

目次

安全性を重視したオープンソースライセンスによって、誰もが利用できる最先端のAIモデルは前代未聞。

今週初め、Emad Mostaqueが設立し出資しているStability.ai社は、AIアートモデルStable Diffusionの一般公開を発表した(※訳註1)。AIアートの世界ではこうした発表は日常茶飯事だと思うかもしれないが、今回の発表はそれ以上のものである。その理由は以下のように2つある。

1つ目の理由としてDALL-E 2やMidjourneyと異なり、Stable Diffusionはオープンソースとして提供されている。つまり、このAIモデルの神髄を受け継いで、誰もが無料でテキストから画像へ変換する特定のクリエイティブなタスクを実行するアプリを構築できるのだ。

すでに、(DeforumやPharmapsychoticによるStable Diffusionの)GoogleColabs、プロンプトからデザインを作成するFigmaプラグイン、プロンプト/画像/シードの検索エンジンLexica.artなどが開発されている。また、Midjourneyの開発者たちはこのAIモデルとStable Diffusionを組み合わせられる機能を実装し、驚くべき結果をもたらした(現在はもう活動していないが、潜在的に有害な生成を制御する方法がわかれば、すぐに活動できるようになるかもしれない)。

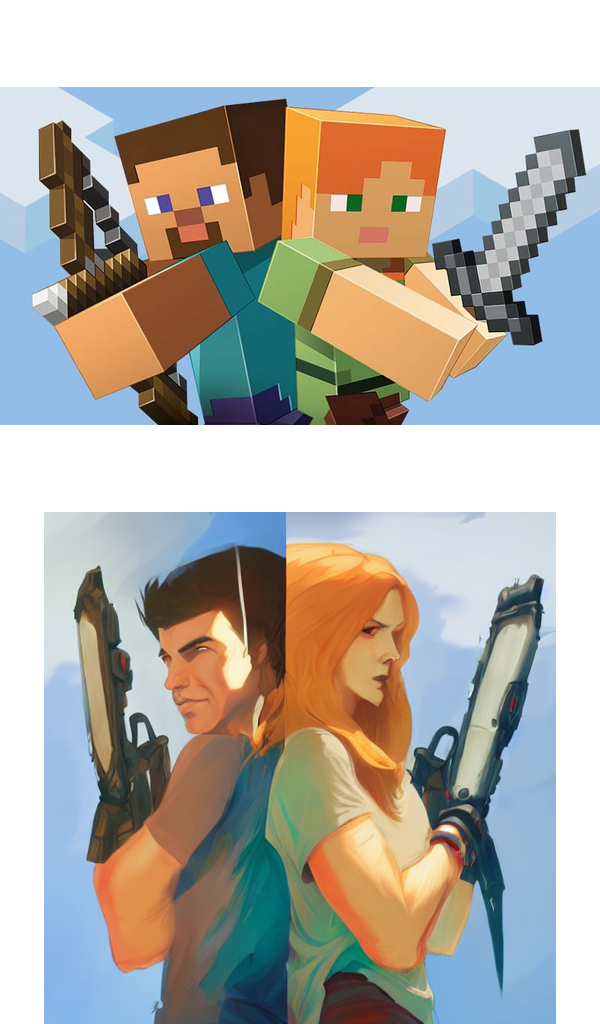

Midjourney + Stable Diffusion。クレジット:alessandrochille, Darken, eyecon01

この文章を書いているあいだ、Stable Diffusionがリリースされてから72時間しか経過していない。今後数週間あるいは数カ月で何が出てくるか、想像してみよう。

2つ目の理由としてDALL-E mini(Craiyon)やDisco Diffusion(オープン性では同等)と異なり、Stable Diffusionは素晴らしいフォトリアリスティックかつアーティスティックな作品を生成できるので、OpenAIやGoogleのモデルに嫉妬しなくていいのだ。Mostaqueが好んで呼ぶ「生成系検索エンジン(generative search engines)」のなかでは、Stable Diffusionこそ最先端だと主張する人さえいるほどである。

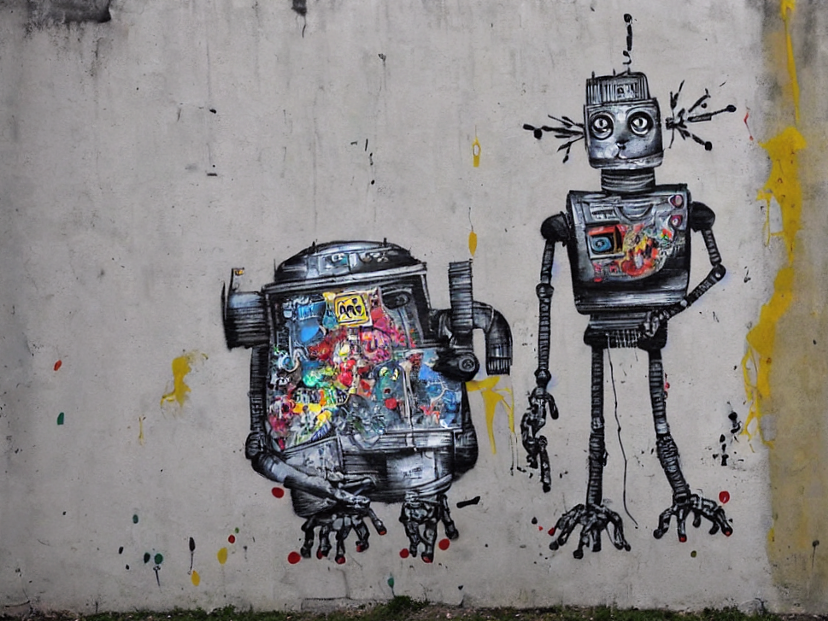

Stable Diffusionの卓越したアーティスティックな技術を感じて頂くために、Discordサーバのコミュニティで見つけた私のお気に入りのアートワークを記事に散りばめておく(特に断りのない限り、すべての画像はStable Diffusionで作成されている)。

クレジット:ai_coo#2852(ストリートアート)

Stable Diffusionは、AIアートの世界における最高の特徴を体現している。その特徴とは間違いなく現存する最高のAIアートモデルであり、なおかつオープンソースであるということだ。これは前代未聞のことであり、非常に大きな影響を与えることだろう。

このニュースレターでは研究段階のAI、つまり日用品に組み込まれるには何年もかかるAIについてよく書いている。そのような記事は面白いかもしれないが、あまり役に立たない。Stable Diffusionは研究と実世界のまさに交差点にあるAIモデルの一例で、面白いうえに役にも立つ。開発者たちは、すでに仕事や遊びですぐに使えるようなアプリを作り始めている。

興味深いことに、アート系AIのサービスに関するニュースは、最も意外なところから耳にするかもしれない。あなたの両親、子供、パートナー、友人、職場の同僚など、AIで何が起こっているのかよくわからない人たちが、この分野の最新のトレンドを知ろうとしている。アートとは、自分たちに降りかかる未来に気づいていないに人たちに、AIテクノロジーが切り拓く未来が来ていることを知らせる方法なのかもしれない。こうした事態は、詩的ではないだろうか。

クレジット:HollyB#1382(海景画)

Stable Diffusion - DALL-E 2を超えるオープンソース

Stability.aiは、「私たちのポテンシャルを引き出してくれるオープンなAIツール」を作るために誕生した。そうしたツールとは決して大多数の人の手に渡らない研究モデルではなく、私やあなたが使い、探求するために開かれた実世界のアプリケーションを志向したものなのだ。こうした同社の姿勢は(GPT-3やDALL-E 2のような)最高のシステムの秘密を用心深く守っているOpenAIや、自社製AI(PaLM、LaMDA、Imagen、Parti)をプライベートベータとして公開するつもりすらなかったGoogleのような他のテック企業とは一線を画している。同社については、数ヶ月前にDALL-E 2の代替品を作りたいという噂を聞きていたが、結局はそれ以上のことをやってのけた。

Emad MostaqueはOpenAIの失敗から学んだ。低品質にもかかわらずCraiyonが絶対的かつバイラルな成功を収めたことは、DALL-Eをクローズドベータにしたことによる欠点を証明するものであった(※訳註2)。人々は、他の人がどのように素晴らしいアートワークを作るのかを見たいのではない。自分で作りたいのだ。Stability.aiは、(Stable Diffusionのリリースにあたり)オープンソースよりさらに一歩踏み込んだ。今回の一般公開は、モデルの重みやコードを共有することだけを目的としていない。重みやコードの公開は科学技術の健全な発展にとって重要なことだが、ほとんどの人はそれらに関心がない。同社は、コードを書きたくない人、あるいは書き方を知らない人のために、コードを書かずにすぐに使えるウェブサイトも用意した。

クレジット:Twobob#2909(自然)

そのウェブサイトがDreamStudio Liteである。200枚までの画像生成であれば無料で使用できる(Stable Diffusionで可能なことの感覚をつかむため)。DALL-E 2のように、10ポンドで1,000回画像生成できる有料サブスクリプションモデルを使用している(OpenAIは毎月15クレジットを補充するが、それ以上を入手するには15ドルで115クレジットのパッケージを購入する必要がある)。リンゴとリンゴを比較すると(つまり単位を揃えて比較すると)DALL-Eが1画像あたり0.03ドルであるのに対し、Stable Diffusionは1画像あたり0.01ドルとなる。

さらに、APIを通じてStable Diffusionをスケールして使用できる(コストは線形的にスケールするので、1,000ポンドで10万生成分を入手できる)。Stability.aiは、画像生成以外にも、DreamStudio Pro(オーディオ/ビデオ対応)とEnterprise(制作スタジオ向け)を近日中に発表する予定である。

DreamStudioが近々実装すると思われるもう1つの機能は、通常のテキストから画像へ(変換するという)の設定の代わりに、他の画像(に加えてプロンプト)から画像生成を可能とするものだ。以下はその事例である(※訳註3)。

クレジット:clif08#7318

クレジット:symmetry#5379

クレジット:Neverduft#5541

DreamStudioのウェブサイトのなかにはプロンプトエンジニアリングに関する資料もあるので、初めてのユーザはそれが必要になるだろう(これらのモデルとうまくコミュニケーションをとるのは、些細なことではないのだ)。また、DALL-E 2(あるいはCraiyon)とは異なり、パラメータを制御して結果に影響を与えることができるので、より多くの作り手の影響力を保持できる。

Stability.aiは、人々がこのモデルにアクセスしやすくするためにあらゆることを行ってきた。先に画像生成AIを発表したのはOpenAIだが、モデルに内在する潜在的なリスクやバイアスを評価するために、よりゆっくりと進める必要があった。しかし、OpenAIがモデルをこれほど長くクローズドベータにしておく必要はなく、創造性を制限するようなサブスクリプションビジネスモデルも確立する必要はなかった。MidjourneyとStable Diffusionの両社は、以上のようなOpenAIの方針が誤りであったことを証明している。

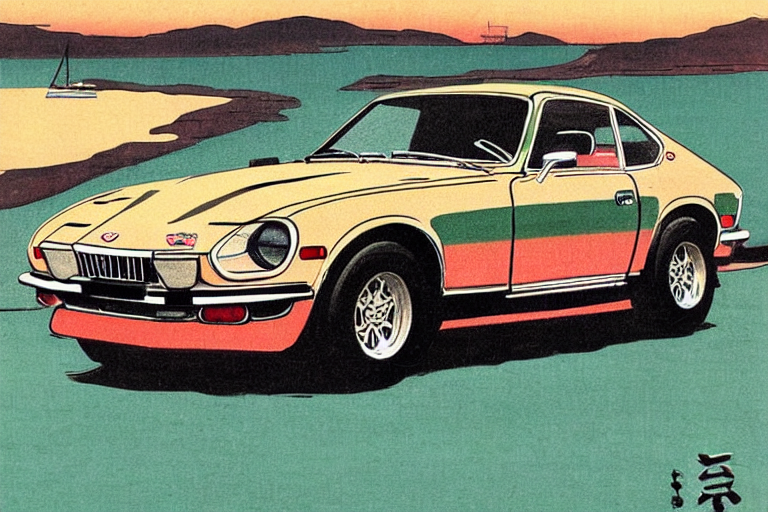

クレジット:RobotElbows#3572(浮世絵風)

安全性+開放性>プライバシーとコントロール

しかし、オープンソースの技術には限界がある。GPT-4chan「史上最悪のAI」の記事で説明したように(※訳註4)、オープン性はプライバシーや厳しい管理よりも優先されるべきだが、安全性よりも優先されるべきではない。

Stability.aiはこの事実を重く受け止め、Hugging Faceの倫理・法務チームと協力し、Creative ML openRAIL-Mライセンス(BigScienceのBLOOMモデル(※訳註5)のライセンスと同様)でモデルをリリースした。同社が発表のなかで説明しているように、このライセンスは「商用・非商用を問わず利用できる寛容な」ものであり、モデルのオープンで責任ある下流利用に重点を置いている。また、派生作品には最低限、同じユーザベースの制限をかけることを義務付けている。

以上の記事によると、機械学習の研究者でYouTuberでもあるYannic Kilcherは、GPT-3に匹敵する大規模言語モデルを目指して開発されたオープンソースの言語モデルGPT-J-6Bを、日本の2ちゃんねるから派生した英語圏の掲示板サイト4chanへの投稿を学習データとして独自にファインチューニングした。こうして誕生したのが、GPT-4chanである。

GPT-4chanは、Kilcherの思惑通り同掲示板に見られる「不快感、虚無感、荒らし、深い不信感の混在を完璧に表現した」ものとなり、「史上最悪のAI」としてその開発過程をYouTubeで公開した。さらにHugging Faceに同モデルを公開した。その結果、同モデルを活用したと思われるボットによる4chanへの書き込みが3万件以上生じた。

悪用の可能性が十分予期できるにもかかわらずGPT-4chanを公開したことに対して、多くのAI研究者が批判した。そして、ついにHugging Faceは同モデルの完全ブロックを決定したのだった。

GPT-4chanの顛末に関して、大きなリスクが予期できるのであれば、潜在的に危険なAIモデルは一時的あるいは永続的に使用を禁止すべき、とRomero氏は自身の見解を述べている。

クレジット:not#2122(ステンドグラス風)

モデルを公開することはそれ自体素晴らしいステップだが、この技術が最終的に人に危害を加えたり、誤った情報というかたちでインターネットにさらなる傲慢さを加えたりすることを望んでいないのであれば、合理的なガードレールを確立することも同じくらい重要である。しかし、ライセンスがあっても、そうなってしまうかもしれない。Emad Mostaqueは、ブログ記事のなかでこのことについて明確に次のように言及している。「これらのモデルは広範なインターネットスクレイプによって収集した画像とテキストのペアを使って訓練されたので、モデルはいくつかの社会的バイアスを再現し、安全ではないコンテンツを生成するかもしれません。それゆえ、オープンな緩和策だけでなく、これらのバイアスに関するオープンな議論によって、誰もがこの(画像生成モデルの安全性に関する)会話に参加できます」(※訳註6)。いずれにせよ、オープン性と安全性は、プライバシーとコントロールに勝るのだ。

世界を変えるオープンソースの力

倫理的価値観とオープン性を強固な基盤として、Stable Diffusionは実世界への影響という点で競合他社を凌駕することを約束している。これをダウンロードして自分のコンピュータで実行したい人は、6.9GbのVRAMを必要とすることを知っておく必要がある。これはハイエンドのコンシューマー用GPUに適合し、例えばDALL-E 2よりも相対的に重くはないものも、それでもほとんどのユーザには手が届かないものだろう。そうは言っても私のように、Dream Studioですぐにでも始められる。

クレジット:pontap#4224(水彩画風)

概して最高の生成系AIアートモデルとして評価されているStable Diffusionは無数のアプリ、ウェブ、サービスの基礎となり、私たちがどのようにアートを創造し、交流するかを再定義することになるだろう。同モデルリリース以前はまともな生成結果を得たいなら、DALL-E 2かMidjourneyを使うしかなかったが(Craiyonはミームには向いているが、ほとんどのプロが必要とする品質にはほど遠い)、これらは(重みやソースコードが)完全に不透明であるという点で限界がある。

しかしこれからは、さまざまなユースケースのために特別に設計されたアプリが、誰もが使えるように一から作られるようになるだろう。子供の絵をより美しくする、アウトペイント+インペイントでコラージュする、雑誌の表紙をデザインする、 漫画を描く、変形やアニメーションを活用した動画を作る、画像から画像を生成するなど、さまざまな用途で利用されている。

DALL-EやMidjourneyで既に実現した応用例もあるが、Stable Diffusionは現在のクリエイティブ革命を次のステージに推進できる。(以下のツイートのように)Andrej Karpathyも同意見である。

imo #stablediffusion release today is a day of historic proportion for human creativity, with so much human visual creativity bottled up into one accessible artifact. Big part of a phase shift into an era of human+AI art collab that we’ve just barely scratched the surface of. https://t.co/EWFY32LapZ

— Andrej Karpathy (@karpathy) August 22, 2022

以上のKarpathy氏のツイートを翻訳すると、以下の通り。

私が思うに今日の#stablediffusionリリースは、人間の創造性にとって歴史的な割合を占める日であり、非常に多くの人間の視覚的創造性が アクセス可能な1つの人工物に詰め込まれたのです。人間とAIのアートコラボの時代へのフェイズシフトの大きな一端を、私たちはまだ表面しか見ていない。

Stable Diffusionは、非常に必要な会話を強制する

しかし、グローバルなパラダイムシフトは、誰にとっても喜ばしいことではない。AIアートに関する最新記事「今日のAIアート論争が21世紀のクリエイティブな風景をどう形成するか」(※訳註8)で説明したように、私たちは、このモデルのオープンソース化によって加速された、極めて複雑な状況に入り込んでいる。アーティストやその他のクリエイティブな専門家が懸念を表明しているが、そうした懸念は理由がないわけではない。多くの人が新しいアプリに対抗できず、仕事を失うだろう。OpenAI、Midjourney、Stability.aiなどの企業は多くのクリエイターたちの仕事によって超強力になっているものの、彼らの働きに何ら報いていない。そして、AIユーザは以上の企業の肩を持っているが、(画像を生成したりするのに)許可を求めたりしない。

そんなわけで私が主張しているように、Stable DiffusionのようなAIアートモデルは新しいカテゴリーのツールに関係し、私たちが生きている新しい現実に適応した新しい思考の枠組みで理解されるべきものなのだ。単純に他の時代と類推したり並列したりするだけでは、これから起こることを正確に説明したり予測したりすることは望めない。(新しい時代は古い時代と)似ているものもあれば、そうでないものもあるだろう。私たちは、この差し迫った未来を未知の領域として扱わなければならない。

Romero氏によると、DALL-E 2をはじめとするテキスト画像生成モデルは、以下のような2点においてカメラや絵筆のような既存のアートツールと異なっている。

テキスト画像生成モデルに見られる既存アートツールにはない2つの特徴

|

以上のような特徴をもつテキスト画像生成モデルは、実のところ、人間の創作活動と非常に似ている。人間のアーティストがどのような経験を積んで画風を確立したかを説明するのは極めて困難であり、制作されるアート作品は一意的に予見できない。つまり、同モデルは人間の創作活動に酷似しているという点において既存のアートツールと大きく異なっているのだ。

テキスト画像生成モデルと人間の創作活動の最大の違いは、倫理や法整備の有無である。人間の創作活動には「盗作は恥ずべき行為」というような倫理や著作権が整備されているのに対して、同モデルにはそうしたものがまだ十分に存在しない。

テキスト画像生成モデルの倫理と法の整備にあたっては、人間の創作活動に酷似しているという特徴をふまえたうえで議論されるべき、とRomero氏は主張している。

クレジット:HollyB#1382(ポートレート)

最終的な感想

Stable Diffusionの一般公開は、間違いなく、AIアートモデルの分野でこれまでに起こった最も重要で衝撃的な出来事であり、その登場は始まりに過ぎない。Emad Mostaqueは次のようにTwitterで述べている。「私たちがより速く、より良い、特定のモデルをリリースするにつれて、品質が全体的に上昇し続けることを期待しています。画像だけでなく、来月にはオーディオ、そして3D、ビデオへと進んでいく。言語、コード、そして今より多くの訓練が必要になります。」

As we release faster and better and specific models expect the quality to continue to rise across the board.

Not just in image, audio next month, then we move onto 3D, video.

Language, code and more training right now…

Cutting edge AI that is open and inclusive 🙃 https://t.co/mlTfBeoJII

— Emad (@EMostaque) August 23, 2022

私たちは、とりわけアートや一般的なクリエイティビティとの相互作用、関係、理解の仕方において、数年にわたる革命を迎えようとしている。そして、そうした革命は哲学的、知的な領域だけではなく、今や誰もが共有し、経験するものでもある。クリエイティブな世界は永遠に変わろうとしている。そして、すべての人にとってより良い未来を作るために、私たちはオープンで尊敬に満ちた会話をしなければならない。責任を持って使われるオープンソーステクノロジーだけが、私たちが見たいと思うその変化を生み出せるのだ。

クレジット:Joe#5956(都市の風景画)

・・・

The Algorithmic Bridgeを購読してください。アルゴリズムと人々のあいだのギャップを埋める、あなたの生活に重要なAIについてのニュースレターです。

また、私へのこの参照リンクを使ってMedium会員になれば、私の仕事を直接サポートし、私の記事に無制限にアクセスできます。:)

Caitlin Kindigに感謝の意を表します。

原文

『Stable Diffusion Is the Most Important AI Art Model Ever』

著者

Alberto Romero

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん