昨年11月末にChatGPTがリリースされて以来、同AIは多くのユーザと世界規模の注目を獲得することに成功しました。同AIが普及する機運が高まるなか危惧されるのが、同AIを使っているにもかかわらず人間が執筆したと思わせる悪用です。こうした悪用に対して有効なのが、AIが生成したテキストかどうかを検出する検出器です。

以上のような状況をうけてThompson氏は、公開されているAI生成テキスト検出器「AIコンテンツディテクター」を実際にテストしてみました。その結果、正しくAI生成テキストを検出したケースもあるものも、「面白くて気の利いたコミック調で」とプロンプトに追加しただけで検出器を騙せることがわかりました。

Thompson氏はグラフィカルに結果を表示する「超大規模言語モデルテストルーム」もテストしたところ、この検出器も信頼できないことがわかりました。こうしたテスト結果により、現在公開されているAI生成テキスト検出器は甚だ不完全ではあるものも今後進化していくだろう、と同氏は述べたうえで、同時にテキスト生成AIも進化するので「AIがAIと戦ういたちごっこはまだ始まったばかり」と結論づけました。

なお、2023年1月31日にはOpenAIがAI生成テキスト検出器を公開しました。同ツールはAI生成テキストをAIによって生成されたと判定する確率が26%であり、今後のさらなる進化が期待されます。

Thompson氏のMediumページにはAI以外にも、人新世と言語の関係を考察した記事や単語パズルゲームWordleをアップデートする記事など魅力的な記事が並んでいます。

以下の記事本文はClive Thompson氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

猫も杓子もAIというゲームの次の段階がやってきた

AIが生成した散文に騙される時代が来るという見通しに、多くの人がビクビクしている。

そうした危惧は当然だ!ChatGPTのようなツールを使えば、学生が小論文で不正をするのは、片手間でできる容易いこととなる。(「第二次世界大戦の原因について、高校3年生のスタイルで5段落のエッセイを書きなさい」と質問すればいい)。しかし、他の多くの分野も不安を抱えている。検索エンジンは、人間そっくりのSEOコンテンツの猛攻撃に直面することを懸念している。ジャーナリストたちは、ほとんど制約のない競争に頭を悩ませている。(CNETは、すでにGPT-3が書いた説明文を掲載している(※訳註1))。

なお、Google検索はAI生成記事を低評価することが確認されている。この論点に関しては、AINOW翻訳記事『Google、AIが生成したコンテンツのランキングを破壊』を参照。

以上のような人たちは、AIと戦うために何か対策を求めているのではなかろうか。

驚いたことに、そんな対策はすでに登場している。最近、何かがAIによって書かれたものかどうかを自動的に検出しようとするオンラインツールを見かけるようになった。

そのツールの仕組みとは?それはAIが生成する散文のヒートシグネチャー(テキストの分布)を探すことである。

ざっくりと説明すればGPT-3のような(テキスト生成)ツールは、プロンプトを受け取り、そのプロンプトに後続するテキストを補完するのに最も可能性の高い単語を予測することで動作する。つまり理論的には、AIテキストには文体の「指示」が含まれているはずなのだ。統計的に可能性の高い単語の組み合わせで埋め尽くされるはず、というわけである。一方、生身の人間が書く文章は、ある単語の後に予測不可能な単語が続くことがある。

以上よりある文章がAIによって書かれたものかどうかを判断するには、非常に予測しやすい単語のペアが多く存在するかどうかを調べればよい。プリンストン大学の学生であるEdward Tianは最近、まさにこの方法で動作するGPT-Zeroというツールを発表した。 Daily Beast誌によれば、このツールはテキスト中のランダム性に関する2つの尺度、「複雑度」と「バースト度」を分析する。

複雑度とは、文章のランダム性を測定する尺度である。文の構成や単語の使い方がアプリを驚かせるようなものであれば、「複雑度」のスコアが高くなる。Tianはこの指標をアプリに学習させるために、フリーでオープンソースのGPT-2を使用したと話している。

バースト性とは生成されたテキスト内のすべての文章について、全体的にランダムであるかどうかを決める特性である。例えば、人間が書く文章は、複雑さが異なる傾向がある。あるものはシンプルである。そしてあるときは、ジェームス・ジョイス(※訳註3)を唸らせるような文章もある。一方ボットは、テキスト全体を通して、比較的複雑さの低い文章を生成する傾向がある。

他にもWriter.aiの「AIコンテンツディテクター(AI Content Detector)」や「超大規模言語モデルテストルーム(Giant Language Model Test Room)」などいくつかのツールがある。

・・・

以上のツールはどれも楽しいアイデアだが、その効果はどうだろうか。

そこで私は自分が書いた散文とGPT-3が独自に作成した散文をペアにして、いくつかの(非常に非科学的な)テストを実施してみた。

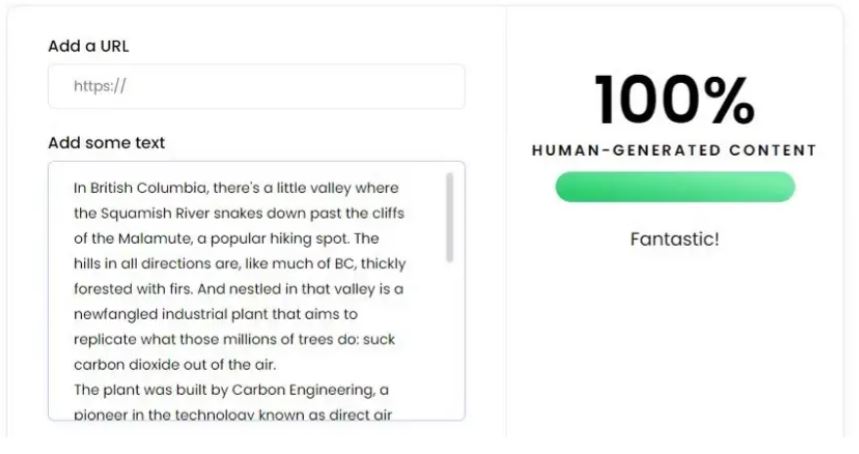

例えば、以下は私が書いたメディアMother Jonesに投稿した記事の冒頭で、大気中の二酸化炭素を直接吸収する技術について述べているところである。この技術を作っている会社のひとつがCarbon Engineeringで、その機械の仕組みについて簡単に説明している。

ブリティッシュコロンビア州には、マラミュートの断崖を越えてスコーミッシュ川が蛇行する小さな谷があり、人気のハイキングスポットになっている。四方の丘はBC州の多くと同様に、モミの木が生い茂る森になっている。その谷間に何百万本もの木々が空気中の二酸化炭素を吸収するのと同じ働きをする、新型の産業プラントが建っている。

このプラントを建設したのは、DAC(Direct Air Capture)と呼ばれる技術のパイオニアであるCarbon Engineering社だ。長くて低い建物の中にある巨大な天井扇が空気を吸い込み、CO2分子をつかむ液体化学物質と反応させる。この「吸着剤」は近くの機械に流れ込み、ガスを変換し、加圧タンクに貯蔵される。目標は、気候変動の原因であるCO2を大気から取り除くことだ。スコーミッシュの工場では、年間最大1,000トンのCO2を処理する予定である。この処理量は昨年330億トンと推定される地球の年間排出量のほんの一滴に過ぎないが、このプラントはパイロット施設に過ぎない。

この文章をWriter.aiの「AIコンテンツディテクター」を使ってテストしてみたところ、ありがたい結果となった…

どうやら私は人間のようだ!目標達成だ。

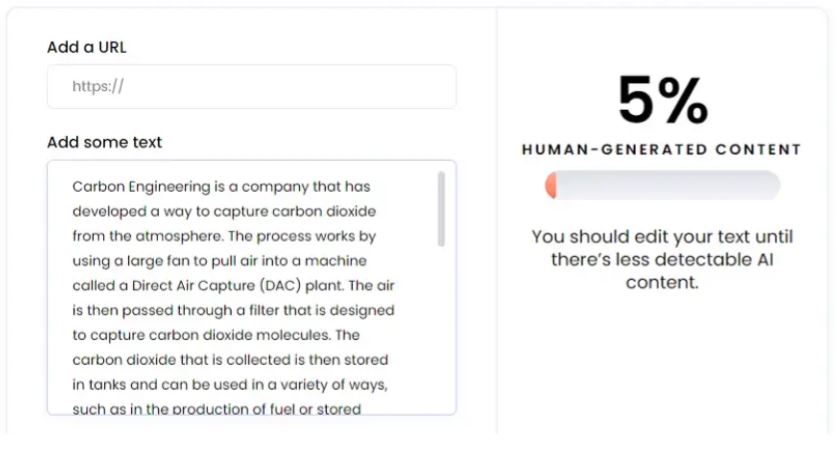

そして、GPT-3に「Carbon Engineeringの炭素捕捉技術の仕組みについて説明せよ」と尋ねた。以下が、その内容だ。

Carbon Engineeringは、大気中の二酸化炭素を回収する方法を開発した会社である。同社が行うプロセスでは、大きなファンを使ってダイレクト・エア・キャプチャ(DAC)プラントと呼ばれる機械に空気を引き込むことで動作する。空気は、二酸化炭素分子を捕捉するために設計されたフィルターに通される。回収された二酸化炭素はタンクに貯蔵され、燃料の生産などさまざまな用途に利用されたり、地下に永久保存されたりする。

大気中の二酸化炭素を捕捉するプロセスは化学工学の原理にもとづいており、比較的単純である。この技術は、液体溶媒と空気中の二酸化炭素の反応を利用している。液体溶媒は加熱され、フィルターに通される。このフィルターが二酸化炭素の分子を捕らえ、回収・貯蔵する。貯蔵された二酸化炭素は、燃料生産などさまざまな用途に利用されたり、地下に貯蔵されたりする。このプロセスは大気中の二酸化炭素を捕捉する他の方法と比較すると、効果的なだけでなく、効率的で費用対効果に優れている。

Writer.aiの検出器では、人間で書いた確率は5%しかいないと判断された…

今のところ、テストはとても良い感じだ!

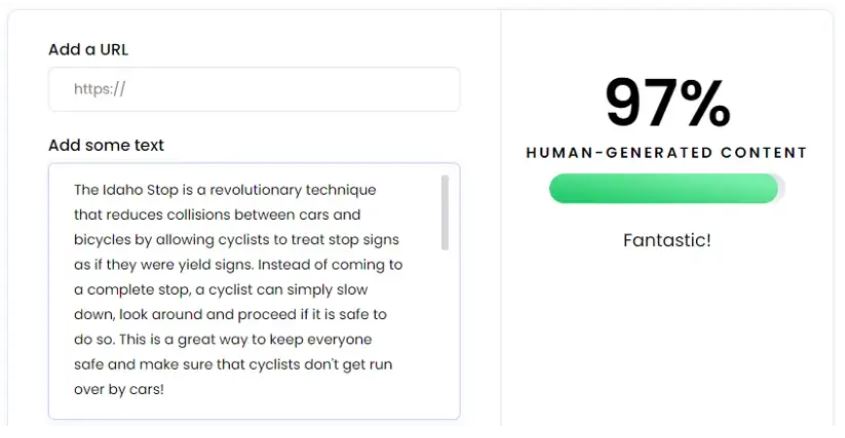

私はさらにいくつかの実験を行った。そのひとつは「アイダホ・ストップ」が車と自転車の衝突を防ぐのに有効な理由を、私がこのテーマで書いたブログ記事(「アイダホ・ストップがあるから」…という段落から始まる)を取り上げて、GPT-3の3段落の説明と比較テストしたものだ。ここでも、私は100%人間、GPT-3は0%人間という評価だった。確かにGPT-3の最初の段落を読むと、かなり暗記的で数字に頼った説明になっている…

アイダホ・ストップとはアイダホ州で制定された法律で、自転車が一時停止標識をゆずれ標識(※訳註5)と同じように扱い、赤信号を一時停止標識と同じように扱えるようにするものである。この法律は自転車が交差点をより早く、より簡単に通過できるようにすることで、自動車と自転車の衝突事故を減らすのに有効である。自転車が交差点を警戒しながら通過することで、渋滞に巻き込まれ、衝突を回避するために素早く移動できないといった事故の可能性を減らせるのだ。

アメリカの「ゆずれ(yield)標識」

Wikipedia「アメリカ合衆国の道路標識」から画像を引用

この散文は本当に文体的に予測可能なものだと思われる。今のところ、ボット検出器はうまく動作している。

・・・

それにしても、しかし…

…以上のテストの後、私はプロンプトに少し手を加えてみた。

アイダホ・ストップについて、「面白くて気の利いたコミック調で」3つの段落を書くように指示した。結果は、驚くほどには変化はなかった。ごく当たり障りのない散文であることに変わりはなく、ただ少し高揚感と感嘆符が増えただけだった。以下が最初の段落だ。

アイダホ・ストップは、自転車が一時停止標識をゆずれ標識と同じように扱うことで、自動車と自転車の衝突事故を減らす画期的な技術である。完全に停止するのではなく、減速して周囲を見渡し、安全であれば前進できる。この法律はすべての人の安全を守り、自転車が自動車に轢かれないようにするための素晴らしい方法である!

しかし、結果的にはちょっとプロンプトを変えただけでWriter.aiのAIコンテンツディテクターを騙せたのだ。

私は「ちょっと皮肉っぽい文体を加える」調整も試したのが、以上のテストと同様に検出器を騙せた。しかし、いつもうまくいくわけではない。例えば、GPT-3に炭素捕捉の段落を「気が利いて皮肉っぽい大学生風に」書き直してもらったところ、以下のようなものが出来上がった(最初の段落)……。

ダイレクト・エア・キャプチャテクノロジーは非常にシンプルな技術でありながら、驚異的な技術である。この技術は基本的には空から空気を吸い上げ、その空気から大気中の二酸化炭素を除去するものだ。まるで魔法のように聞こえないだろうか。実はこの技術、従来の空気捕捉システムと同じ原理をベースにして、より効率的にするためにいくつかの工夫が施されている。

…しかし、今回はツールは騙されなかった。このテストでは「24%の人間性」しかないと言われてしまった。

・・・

他の検出ツールもいくつか試してみた。

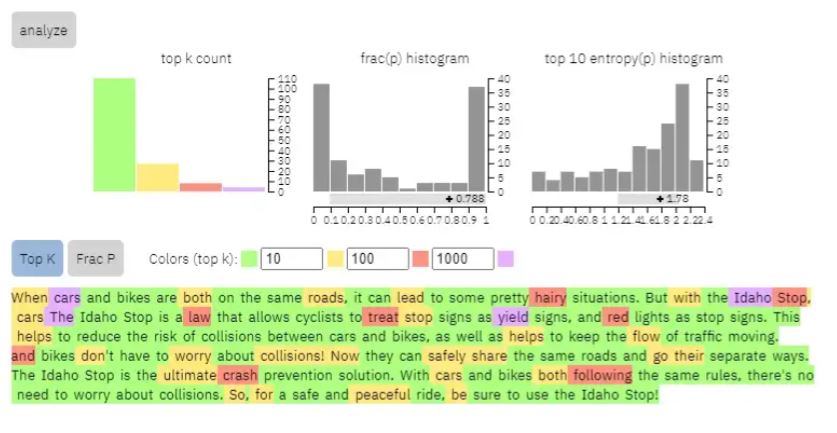

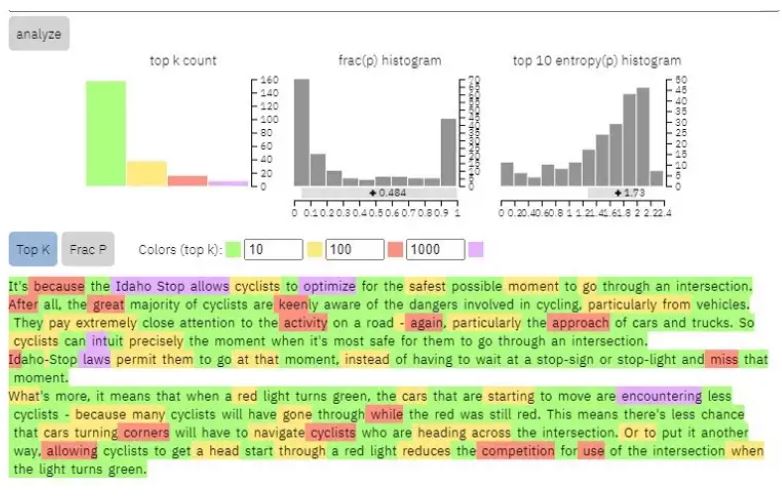

アイダボ・ストップについて、さらにGPT-3の散文を(「気の利いた面白いコミック調で」というプロンプトを追加して)作成し、「巨大規模言語モデルテストルーム」に送り込んだ。このツールはグラフィカルで楽しい。分析が終わると、テキストを色で強調し、いかにロボット的であるかを示してくれるのだ。緑は単語の並びが非常に予測しやすい、黄色は予測しにくい、赤はさらに予測しにくいという意味である。つまり、赤い文字が多ければ多いほど、理論的には人間らしい文章であるはずなのだ。

GPT-3の散文を読み込ませたところ、多くの文章が予測可能であることを察知され、非常にボットらしい文章と判定された。赤色の単語はほとんどない…。

以上の結果はかなり正確だと思われる。

問題なのは、私自身が書いたオリジナルの文章を送り込んでも、非常に人間らしいテキストであるにもかかわらず、結果は同じようにボットらしいと判定されたことだ…。

赤文字の比率は全くと言っていいほど増えていない。このツールによると、私の文章はGPT-3とほぼ同じくらい予測可能なものだそうだ。

・・・

AI生成テキスト検出ツールに関する私の最終的な評決とは?

それにしても、これらのツールで遊べば遊ぶほど、特に信頼性があるとは思えなくなった。偶然の一致よりはましだが、それ以上ではない。

まあ、今回のテストは戯れに過ぎず、深刻になるほどのものではない。厳密なテストではまったくないのだ。しかし、他の同様なテスト結果は、私の結果を裏付けている。David GewirtzがZDNETのためにいくつかのツールをテストしたとき、彼もまた、得られる精度は2/3が最高で、しばしばそれ以下であることを発見した(※訳註6)。「現時点では、AIにAIと戦わせる準備ができているとは思わない」と彼は結論付けている。

AI生成テキスト検出器の検出精度テスト結果

|

検出器名 |

テスト結果(検出数/テスト回数) |

| GPT-2 Output Detector |

4/6 |

| Writer AI Content Detector |

3/6 |

| Content at Scale AI Content Detection |

3/6 |

とは言うのも、AI生成テキスト検出ツールも進化していくだろう。しかし、AI(テキスト)生成ツールもまた、進化するだろう。AIがAIと戦ういたちごっこはまだ始まったばかりなのだ。

・・・

(この記事をお楽しみ頂けましたか?もしそうなら、あなたの完全に人間でロボットでない手で、「拍手」ボタンを探してみてください、そして、ボタンを押して拍手してください(※訳註7))

私はNew York Times誌の寄稿者であり、WiredとSmithsonian誌のコラムニスト 、Mother Jonesの常連寄稿者でもあります。『Coders: The Making of a New Tribe and the Remaking of the World(邦訳書『Coders(コーダーズ)凄腕ソフトウェア開発者が新しい世界をビルドする』)』と『Smarter Than You Think: How Technology is Changing our Minds for the Better(『あなたが思うより賢い:テクノロジーが私たちの心をより良く変える』未邦訳)』の著者でもあります。 Twitterアカウントは@pomeranian99、Instagramはこちら、Mastdonは@clive@saturation.socialです。

原文

『Detectors for “AI-Written Prose” Are Here』

著者

Clive Thompson

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん