画像出典:AI Safety Summit UK 公式サイト

目次 [非表示]

はじめに

2023年5月に広島で開催されたG7広島サミットでは、生成AIの安全性とリスクに関して国際的に対処するための枠組みとして広島AIプロセスが創設されました。こうした動向をうけて、2023年11月には第1回AI安全サミットがイギリスのブレッチリ―・パークで開催されました。

本稿では広島AIプロセスの進捗と第1回AI安全サミットの成果を確認したうえで、2023年12月時点における主要AI各国のAI規制とガイダンスの動向をまとめます。

なお、主要AI各国のAI規制とガイダンスの概要を比較したい場合は、以下の見出し「各国のAI規制とガイダンス一覧表」を参照してください。

広島AIプロセスの進捗

以下では、2023年12月時点での広島AIプロセスの進捗である「G7首脳声明」と「G7デジタル・技術閣僚声明」をまとめます。

G7首脳声明と関連文書

日本時間2023年10月30日、G7首脳は広島AIプロセスに関するG7首脳声明を発出しました。この声明は、同プロセスを推進する指針を定めた「高度なAIシステムを開発する組織向けの広島プロセス国際指針」と「高度なAIシステムを開発する組織向けの広島プロセス国際行動規範」を歓迎するというものです。

高度なAIシステムを開発する組織向けの広島プロセス国際指針は、以下のような11の指針を定めています。なお、以下の「指針概要」は便宜上のものであり、同指針には書かれていません。

|

指針概要 |

指針詳細 |

| リリース前のリスク評価 | AIライフサイクル全体にわたるリスクを特定、評価、軽減するために、高度なAIシステムの開発全体を通じて、その導入前及び市場投入前も含め、適切な措置を講じる。 |

| AIアカウンタビリティ | 高度なAIシステムの能力、限界、適切・不適切な使用領域を公表し、十分な透明性の確保を支援することで、アカウンタビリティの向上に貢献する。 |

| リリース後のリスク対応 | 市場投入を含む導入後、脆弱性、及び必要に応じて悪用されたインシデントやパターンを特定し、緩和する。 |

| リスクの共有 | 産業界、政府、市民社会、学界を含む、高度な AI システムを開発する組織間での責任ある情報共有とインシデントの報告に向けて取り組む 。 |

| AIガバナンスの制定 | 特に高度な AI システム開発者に向けた、個人情報保護方針及び緩和策を含む、リスクベースのアプローチに基づくAIガバナンス及びリスク管理方針を策定し、実施し、開示する。 |

| AIセキュリティの徹底 | AIのライフサイクル全体にわたり、物理的セキュリティ、サイバーセキュリティ、内部脅威に対する安全対策を含む、強固なセキュリティ管理に投資し、実施する。 |

| AI生成コンテンツ識別ツールの提供 | 技術的に可能な場合は、電子透かしやその他の技術等、ユーザーが AI が生成したコンテンツを識別できるようにするための、信頼できるコンテンツ認証及び来歴のメカニズムを開発し、導入する。 |

| AIリスクの研究推進 | 社会的、安全、セキュリティ上のリスクを軽減するための研究を優先し、効果的な軽減策への投資を優先する。 |

| 公益のための高度AI | 世界の最大の課題、特に気候危機、世界保健、教育等(ただしこれらに限定されない)に対処するため、高度なAIシステムの開発を優先する。 |

| 国際規格の推進 | 国際的な技術規格の開発を推進し、適切な場合にはその採用を推進する。 |

| データ保護 | 適切なデータインプット対策を実施し、個人データ及び知的財産を保護する。 |

高度なAIシステムを開発する組織向けの広島プロセス国際行動規範は、以上の指針を実行するために推奨される行動を定めています。注目すべき推奨事項は、以下の通り。

|

G7デジタル・技術大臣会合の成果

2023年12月1日、総務省はデジタル庁および経済産業省と共同でG7デジタル・技術大臣会合を開催しました。この会合は、G7関係大臣にEU、OECD、GPAIの関係者を加えて、広島AIプロセスについて議論するというものでした。この議論の成果は、「広島AIプロセス G7デジタル・技術閣僚声明」でまとめられています。同声明では、以下のような項目を成果として報告しています。

|

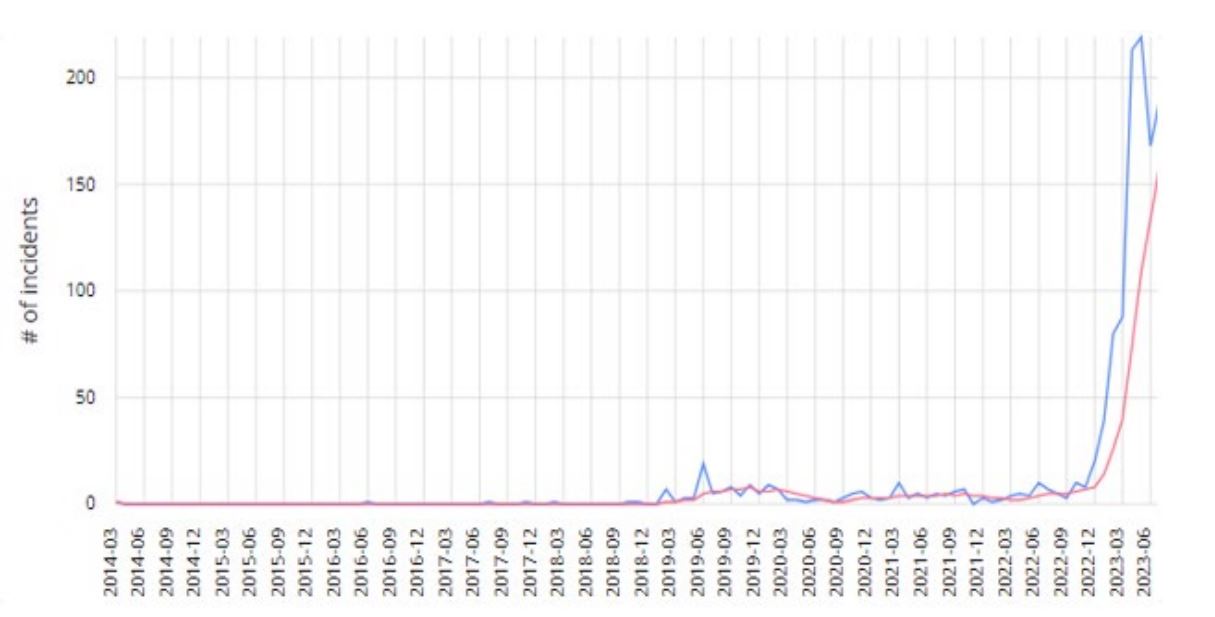

以上のOECDレポート『生成AIにおけるG7広島プロセス:生成AIに関するG7の共通理解に向けて』は、AIリスクの現状とAI規制の在り方を論じています。同レポートによると、OECDは2014年3月から2023年6月のあいだにおける生成AIに関連したインシデント件数(※注釈2)を調査しました。その結果、2023年になってインシデント件数が急増していることがわかりました。

生成AI関連インシデント件数の推移。画像出典:OECDレポート

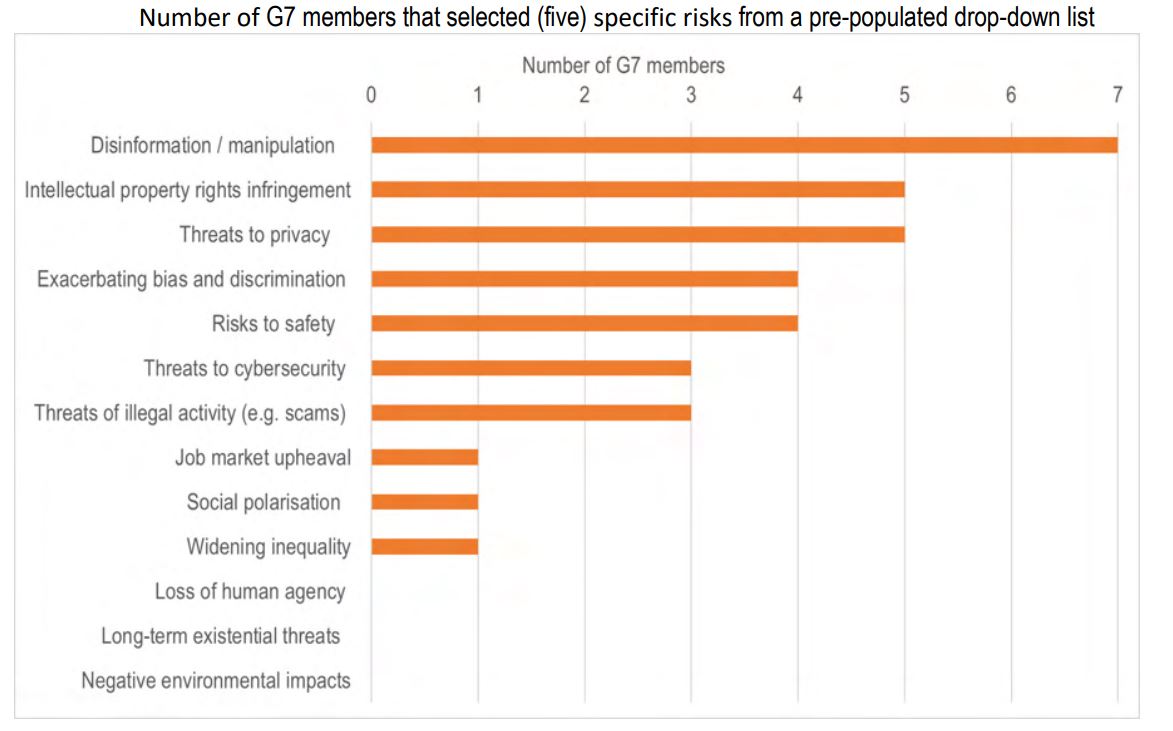

以上のレポートでは、G7各国関係者に生成AIに関する具体的なリスクについて尋ねたアンケート結果も掲載されています。G7各国すべてがリスクと感じているのは「偽情報とそれによる情報操作」であり、次いで「知的財産権の侵害」と「プライバシーへの脅威」が6ヶ国で脅威と考えられていました。反対に「長期的な実存的脅威」や「環境へのネガティブなインパクト」(※注釈3)はまったく脅威と見られていませんでした。

G7における生成AIに関する具体的リスク。画像出典:OECDレポート

以上の「プロジェクト・ベースの協力」とは、AIの安全性を推進するプロジェクトの立ち上げとその推進を意味しています。現在立ち上がっているプロジェクトには、偽情報の拡散に対抗するための革新的なアイデアを提示し検証することを目的とした「生成AI時代の信頼に関するグローバル・チャレンジ」があります。同プロジェクト公式サイトでは、プロジェクトに参加する組織を募集中です。

広島AIプロセス G7デジタル・技術閣僚声明では、今後、広島AIプロセスの専用ウェブサイトを立ち上げる予定であることも明記されています。

第1回AI安全サミットの成果

2023年11月1日と2日、AIの安全性とリスクについて国際的に討論する第1回AI安全サミットがイギリスのブレッチリ―・パーク(※注釈4)で開催されました。G7と中国を含めた29ヶ国が参加した同サミットでは11月1日、合意された内容をまとめたブレッチリー宣言が発表されました。この宣言は、以下の2点を合意内容として挙げています。

|

11月2日に発表された議長総括では、第1回AI安全サミットから6ヶ月後に韓国でバーチャルサミットを、1年後にはフランスでオフラインのサミットを開催することが確認されました。

また11月同日にブレッチリ―宣言にもとづくアクションとして、AIの安全性とリスクに関する最新研究をまとめたレポート『科学の現状』を作成することも発表されました。同レポートの作成を統括するのは、「ディープラーニングの父」の1人として知られチューリング賞受賞者でもあるヨシュア・ベンジオ氏です。同レポートは、次回の(韓国が主催する)AI安全サミットの開催前に発表される予定です。

各国のAI規制とガイダンス一覧表

2023年12月時点での主要AI各国のAI規制とガイダンスの進捗は、以下の表のようにまとめられます。各国の取り組みの詳細は、本稿の各国見出しを参照してください。

|

国名 |

主な規制法/ガイダンス |

主なアクション |

| 日本 | AI事業者ガイドライン案 | ・AI戦略会議作成のAI開発者とAIサービス提供者の行動規範を定めたガイドライン案。2024年3月正式版を公表予定。 |

| アメリカ | 安全、安心で信頼できる人工知能の開発と利用に関する大統領令 | ・強力なAI開発に関する情報共有を義務づける。 |

| ・AI生成コンテンツを検出するAI検出器に関するガイダンスを策定する。 | ||

| EU | AI規制法 | ・禁止AIアプリや生成AI開発に関する透明性義務を定める。 |

| ・違反した場合の罰金も制定。 | ||

| イギリス | フロンティアAIの安全性に関する新たなプロセス | ・AI安全研究所を設立。 |

| ・公務員向けの生成AI活用ガイダンスを作成。 | ||

| カナダ | 生成AIのためのカナダのガードレール – 実施規範 | ・ディープフェイク等への対策を義務づけ。 |

| ・学習データの品質評価を推奨。 | ||

| 中国 | 生成人工知能サービス管理暫定弁法 | ・国家イメージを損なうコンテンツの生成を禁じる。 |

| ・世論属性サービスにおける生成AI活用時には、アルゴリズムの届け出が必要。 |

日本の動向

日本のAI規制とガイダンスに関しては、AI戦略会議、デジタル空間における情報流通の健全性確保の在り方に関する検討会、AI時代の知的財産権検討会が異なった観点から議論を進めています。以下では、それぞれの会合の議論進捗をまとめます。

AI戦略会議

2023年12月21日に開催された第7回AI戦略会議では、AI事業者ガイドライン案が議題となりました。同案を要約した「AI事業者ガイドライン案 概要」によると、このガイドラインは以下のような5部構成となっています。

|

目次 |

部の概要 |

| 第1部 AIとは | AIおよびAIをめぐる用語を定義する。 |

| 第2部 AIにより目指すべき社会と各主体が取り組む事項 | AI開発者が遵守すべき基本理念や原則を定義したうえで、高度なAI開発時の指針とAIガバナンスを解説する。 |

| 第3部 AI開発者に関する事項 | AI開発者が遵守すべき行動規範を定義する。 |

| 第4部 AI提供者に関する事項 | AIサービス提供者が遵守すべき行動規範を定義する。 |

| 第5部 AI利用者に関する事項 | AIシステムユーザが遵守すべき行動規範を定義する。 |

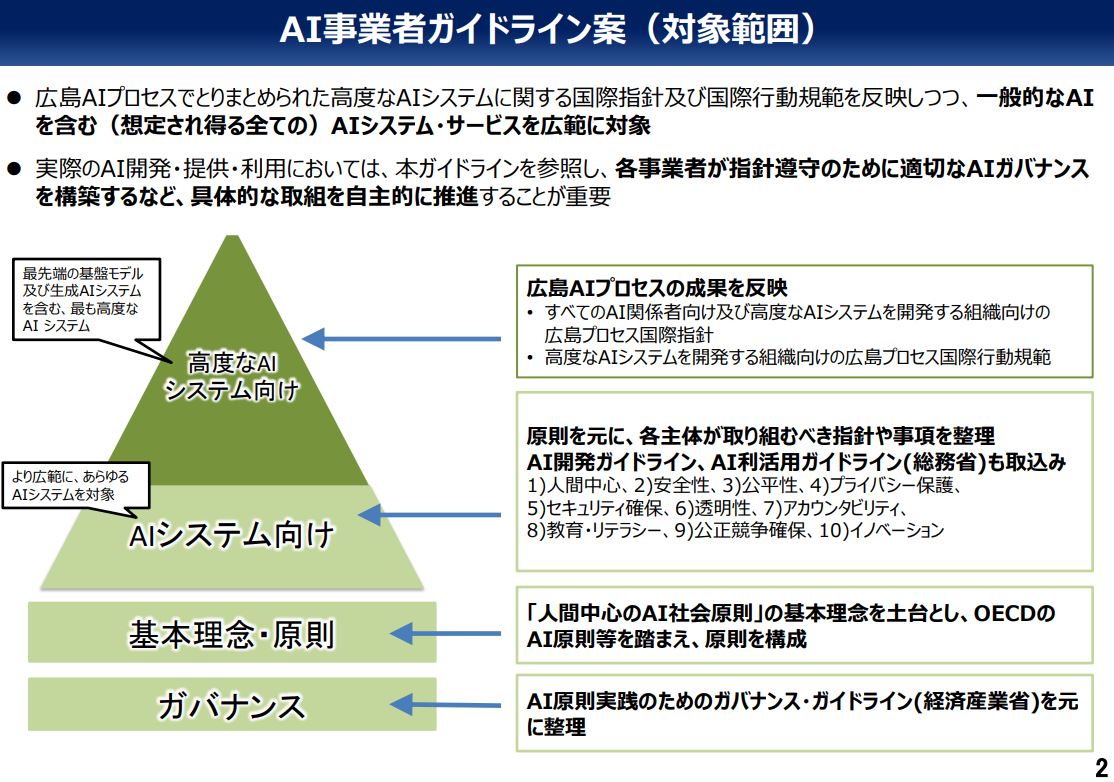

AI事業者ガイドライン案は、前出の広島AIプロセスの成果と日本政府がこれまで公布してきた「AI開発ガイドライン」「AI利活用ガイドライン」「AI原則実践のためのガバナンスガイドライン」を踏襲・アップデートしながら、既存のAIシステム全般に加えて、生成AIをはじめとした新興の高度なAIシステムにまで適用対象に拡大したものとなっています。

AI事業者ガイドライン案の対象範囲。画像出典:第7回AI戦略会議資料

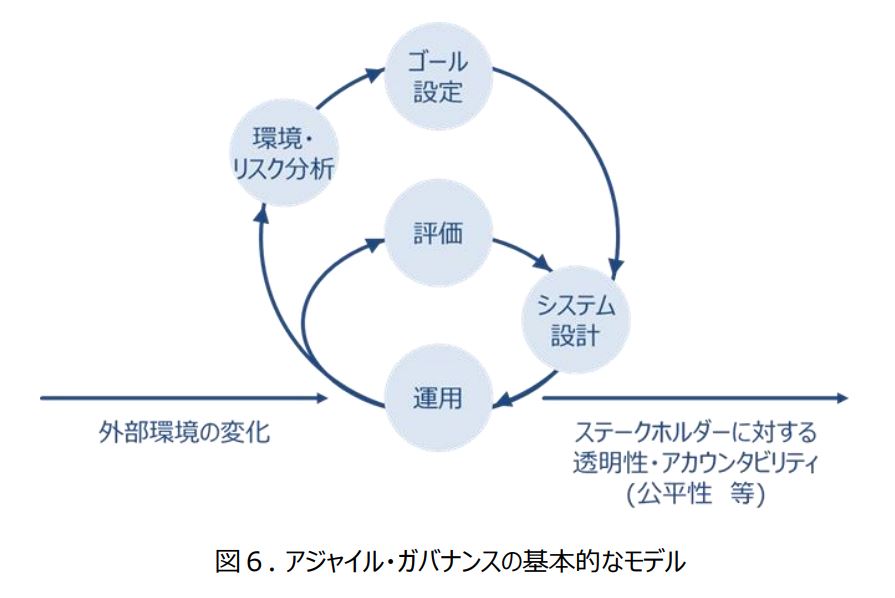

第2部で言及されているAIガバナンスに関しては、アジャイル・ガバナンスが提唱されています。この方法論は、以下のような5つの行動をサイクル状に回転させて、技術の進化や社会情勢の変化に対応していくというものです。

|

行動サイクル名 |

行動概要 |

| 環境・リスク分析 | AIシステムを実装する環境や社会情勢、AI規制等を考慮して、AIシステムのリスク分析を実施する。 |

| ゴール設定 | リスク分析をふまえて、AIガバナンスにおけるゴールを設定する。 |

| システム設計 | ゴールを達成するために、AIシステムの運用体制や各種文書を作成する。 |

| 運用 | 設計した運用体制にしたがい、AIシステムを運用する。環境や社会情勢に変化が生じた場合、再び「環境・リスク分析」を実施する。 |

| 評価 | AIシステム運用時には、ガバナンスが有効に機能しているかどうか定期的に評価する。 |

画像出典:第7回AI戦略会議資料

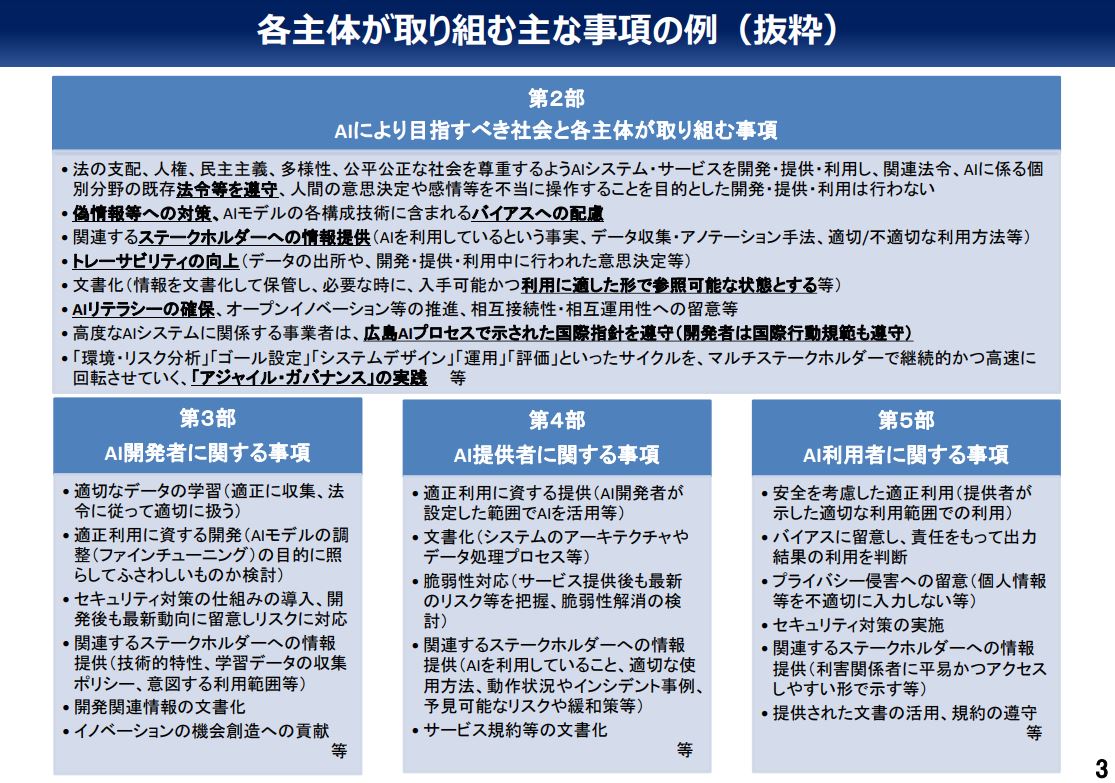

第3部から第5部は、AI開発者、AI提供者、AI利用者ごとの各論となっています。各部では、各主体が遵守すべき行動規範が以下のスライドのように定められています。

各主体が取り組む主な事項の例。画像出典:第7回AI戦略会議資料

以上のAI事業者ガイドライン案の全文は、こちらより確認できます。なお、同ガイドラインは2024年3月に正式に公表される予定です。また、AI事業者が遵守すべき項目を確認できるチェックリストの作成も進んでいます。

デジタル空間における情報流通の健全性確保の在り方に関する検討会

2023年11月7日、ディープフェイク等の新たな懸念に対してデジタル空間の健全性を確保を目的とした第1回デジタル空間における情報流通の健全性確保の在り方に関する検討会が開催されました。同検討会では、議論すべき内容をまとめた資料「デジタル空間における情報流通に関する現状と課題」が配布されました。この資料では、以下のような4つの課題が提示されました。

|

「AI・国際戦略」については、2023年10月8日~12日に開催されたインターネット・ガバナンス・フォーラム京都2023で公表された「偽情報対策既存プラクティス集」を共有しました。この資料は、各国の偽情報対策に関して取り組んでいる組織と取り組み内容を総務省がまとめたものです。

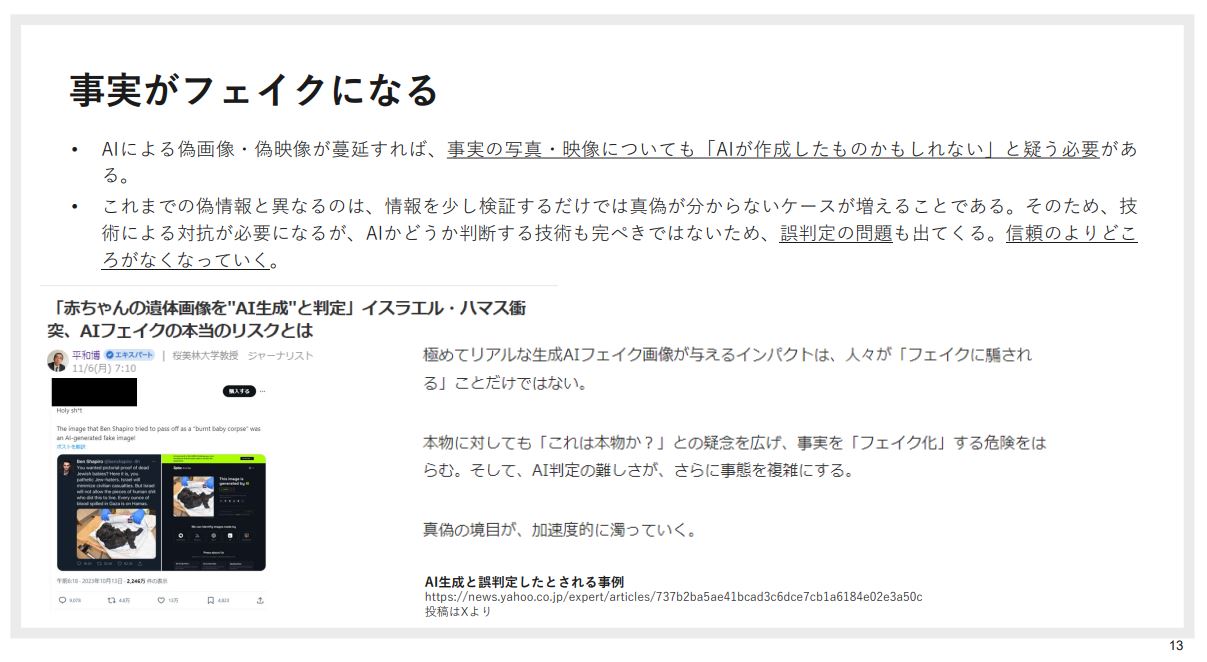

11月21日に開催された第2回検討会では、検討会構成メンバー作成資料の発表がありました。そのなかのひとつである山口 真一国際大学GLOCOM准教授作成資料では、フェイクニュースの現状とその対策がまとめられています。同資料では、AIの進化により事実と区別するのが難しい偽情報が生成できるようになった結果、事実の信頼性が損なわれて「事実がフェイクになる」懸念を指摘しています。

山口准教授作成資料より抜粋。画像出典:第2回検討会資料

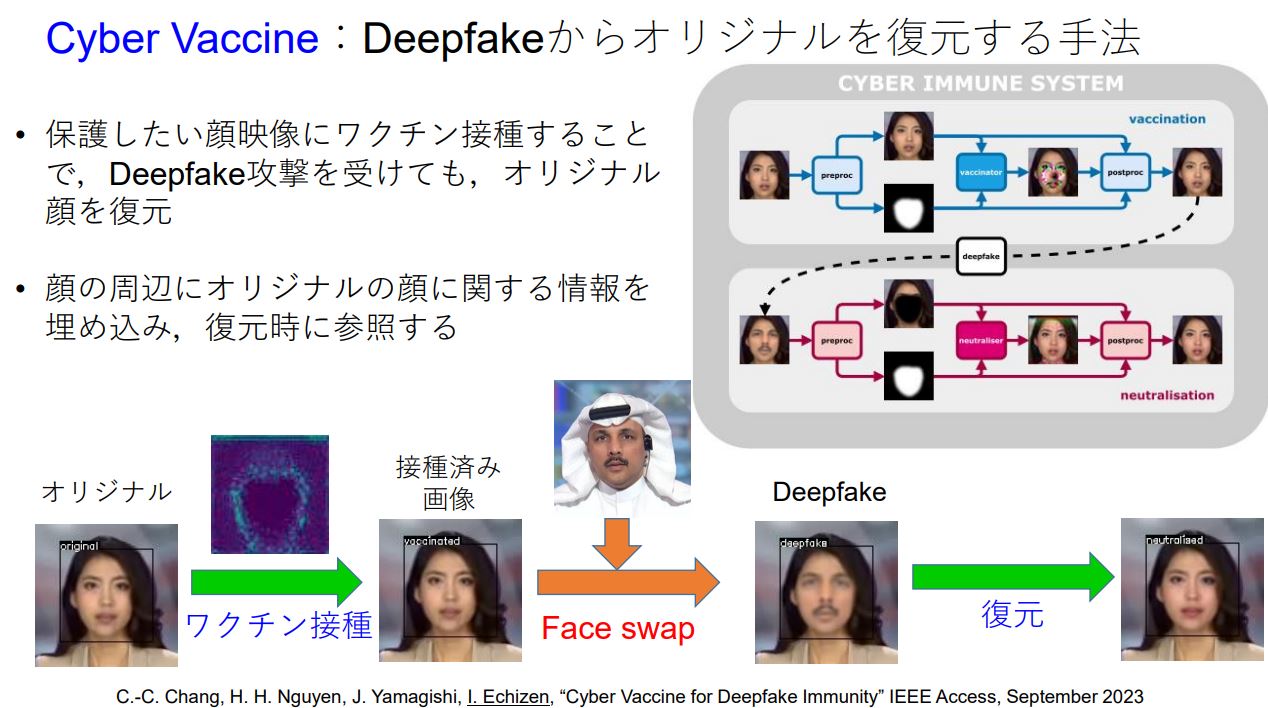

11月27日に開催された第3回検討会では、国立情報学研究所シンセティックメディア国際研究センターの越前 功センター長がフェイクメディアに関する技術動向を発表しました。その発表では、ディープフェイク攻撃に対する防御策である「Cyber Vaccine(サイバーワクチン)」が紹介されています。この技術は、ディープフェイク攻撃後でも元の画像を復元できるようにするものです。

越前センター兆作成資料より抜粋。画像出典:第3回検討会資料

なお、以上の検討会は2024年6月末頃に検討結果をとりまとめる予定です。

AI時代の知的財産権検討会

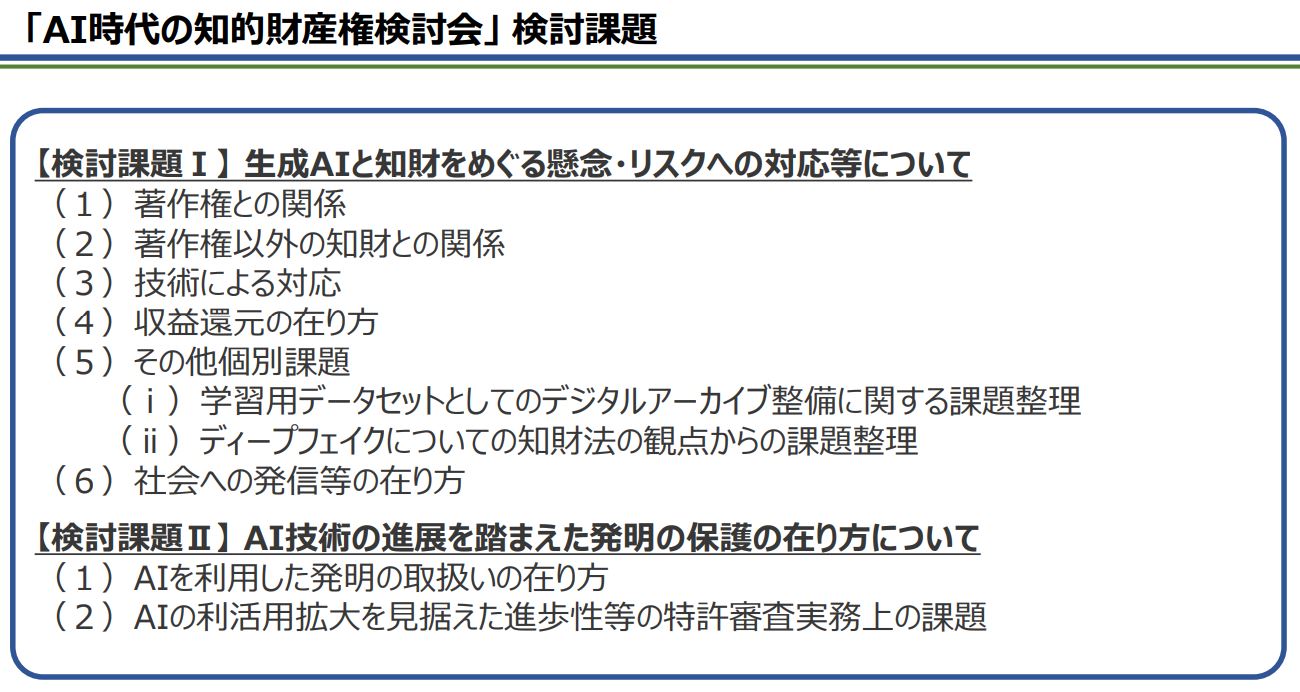

2023年10月4日、生成AIと知的財産権等との関係をめぐる懸念やリスクへの対応の推進を目的とした「AI時代の知的財産権検討会」が発足しました。2023年11月7日には第3回会合が開催され、同検討会が議論すべき内容をまとめた資料「本検討会において検討すべき課題について(追補)」が配布されました。この資料には、検討課題として「生成AIと知財をめぐる懸念・リスクへの対応等について」と「AI技術の進展を踏まえた発明の保護の在り方について」が挙げられています。

AI時代の知的財産権検討会議題。画像出典:第3回検討会資料

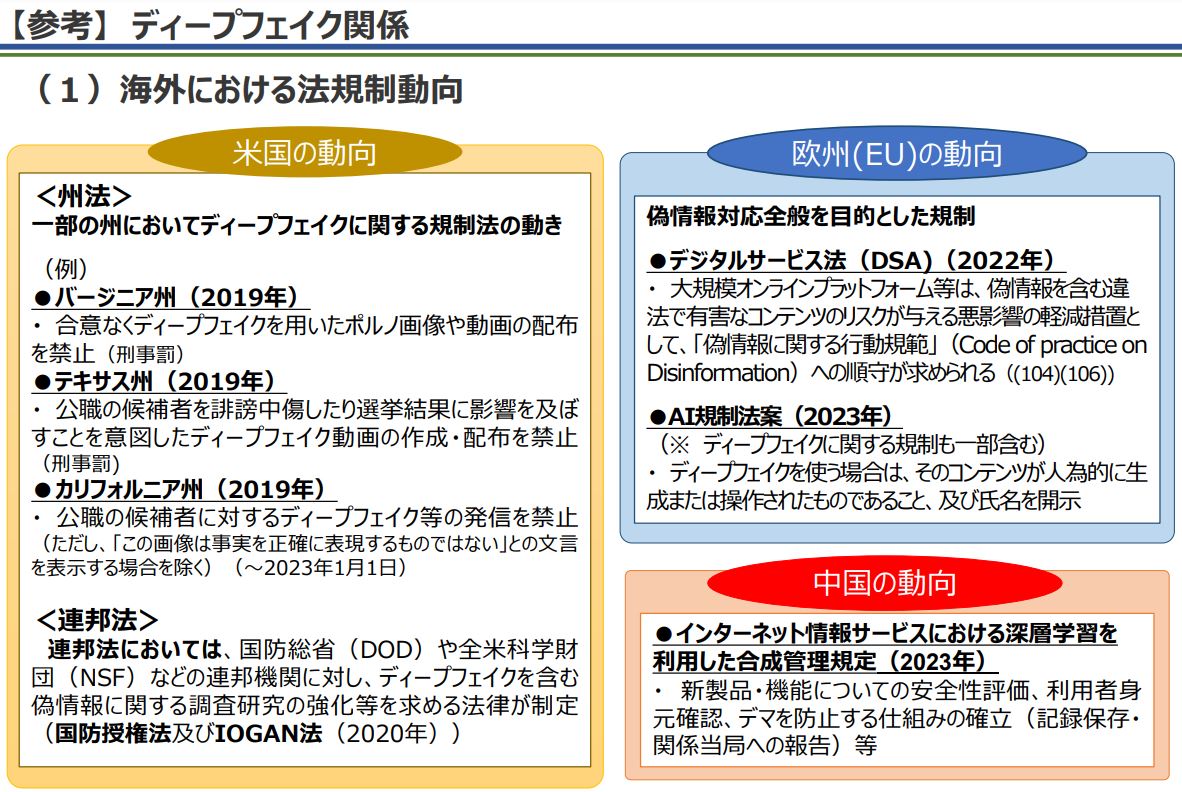

以上の資料には、ディープフェイクを対象とした規制の在り方をさぐる参考情報として海外におけるディープフェイク法規制動向がまとめられています。

海外におけるディープフェイク法規制動向。画像出典:第3回検討会資料

AI時代の知的財産権検討会の討論結果については、2024年4月~5月に中間とりまとめを行う予定です。

アメリカの動向

アメリカでは、広島AIプロセスに関するG7首脳声明の発出と同時期にAIの安全性に関わる二つの重要な政策が発表されました。以下では、それらの政策をまとめます。

安全、安心で信頼できる人工知能の開発と利用に関する大統領令

2023年10月30日、バイデン米大統領は人工知能の利用とその管理を推進するための「安全、安心で信頼できる人工知能の開発と利用に関する大統領令」を発表しました。この大統領令を要約したファクトシートによれば、同令は8つの指導原則から構成されており、その原則に対する代表的なアクションと合わせてまとめると、以下の表のようになります。

|

指導原則 |

指導原則にもとづいた代表的なアクション |

| 安全・安心のための新基準 | ・最も強力なAIシステムの開発者に対し、安全性テストをはじめとした重要事項に関してアメリカ政府と情報共有することを義務づける。 |

| ・AI生成コンテンツを検出するAI検出器に関するガイダンスを策定する。 | |

| プライバシー保護 | ・学習データに含まれるプライバシー情報を保護する技術を開発支援する。 |

| ・アメリカ政府が活用する学習データに関するプライバシー・ガイダンスを強化する。 | |

| 公平性と公民権の推進 | ・家主、連邦給付プログラム、連邦請負業者に対して公平なAIアルゴリズムに関するガイダンスを提供する。 |

| ・司法におけるAI活用に関するベストプラクティスを整備する。 | |

| 消費者、患者、学生のためのAI | ・医療におけるAI活用のためのプログラムを確立する。 |

| ・教育におけるAI活用を試みる教育者を支援する。 | |

| 労働者支援 | ・雇用転換や労働基準の観点から労働者に対するAI活用のベストプラクティスを整備する。 |

| ・労働市場に対するAIの影響に関するレポートを作成する。 | |

| イノベーションと競争の促進 | ・研究用AIリソースを提供する国立AI研究リソースを試験運用する。 |

| ・海外からのAI人材を支援する。 | |

| 世界に対するリーダーシップの推進 | ・AIの安全性に関する国際的なAI標準の策定に参画する。 |

| ・持続可能なAI開発を海外展開する。 | |

| 責任ある効果的なAI利用の確保 | ・政府省庁におけるAI利用ガイドラインを整備する。 |

| ・あらゆるレベルの政府職員に対して、AIトレーニングを提供する。 |

安全で責任ある人工知能の利用を推進するための新しいアメリカ・イニシアティブ

2023年11月1日、カマラ副大統領は前出の大統領令にもとづいた一連の政策「安全で責任ある人工知能の利用を推進するための新しいアメリカ・イニシアティブ」を発表しました。この政策パッケージは、以下のような7項目から構成されています。

|

政策概要 |

政策内容 |

| アメリカAI安全研究所の設立 | アメリカAI安全研究所を設立する。同研究所では、電子透かし、AIバイアスの緩和、AI検出器などについてのガイダンスを作成する。 |

| 政府によるAI利用に関する指針 | 政府がAIを利用する際の政策行動指針案を策定する。行政管理予算局が作成した草案について、2023年12月5日まで意見を募集していた。 |

| AIの軍事利用に関する規範の呼びかけ | アメリカ政府は2023年2月、AIの軍事利用に関する規範の構築を呼びかける「人工知能と自律性の責任ある軍事利用に関する政治宣言」を発表したのだが、この呼びかけを継続する。ちなみに、日本もこの呼びかけに賛同している。 |

| 「公益のためのAI」の推進 | 慈善事業のためにAIを活用するために、資金提供者のネットワークを構築する。 |

| 詐欺電話撃退AIの開発 | 高齢者を標的としたAI生成音声による詐欺電話をブロックするAIを開発する。開発に際しては、ホワイトハッカーによるハッカソンを開催する。 |

| コンテンツ認証に関する国際規範の呼びかけ | 電子透かしやAI検出器等のコンテンツ認証に関して、国際的な技術標準の構築を呼びかける。 |

| 責任あるAI利用の国際的呼びかけ | アメリカ政府は、前述の政策行動指針案について国際的な枠組みに発展するように国際社会に呼びかける。 |

なお、アメリカ政府のAI政策についてはウェブサイト「AI.gov」に情報が集約されています。

EUとイギリスの動向

EUとイギリスについても、規制法の発表や関係機関の設立がありました。以下では、EUとイギリスの動向をまとめます。

EUの「AI規制法」

欧州議会は2023年12月9日、AIの安全な利用に関する規制を定めた「AI規制法」について政治的合意に達したことを発表しました。同法の概要は、以下のような6項目によって説明できます。

|

規制項目概要 |

規制内容 |

| 禁止AIアプリの設定 | 職場や教育現場における感情認識、社会的活動や個人的特徴にもとづく社会的採点など個人の権利と民主主義を脅かす可能性のあるAIアプリの開発と利用を禁止する。 |

| 法執行機関を対象とした免除 | 警察などの法執行機関については、犯罪捜査に限定して例外的にAIによる生体認識システムの利用を認める。 |

| 高リスクシステムに対する規制 | 医療や保険、金融などの高リスクを伴うAIシステムについては、厳格な義務条項を課す。 |

| AGIに対するガードレール | AGI(汎用人工知能)の開発には、欧州議会が定めた透明性要件を遵守しなければならない。この要件には技術文書の作成、学習データに関する情報開示が含まれる。 |

| 中小企業支援 | 大手テック企業による圧力を受けずに中小企業がAI開発できるように、各国当局によるテスト環境等の提供を促進する。 |

| 制裁と罰金 | AI規制法に違反した場合、違反行為と企業規模に応じて、3,500万ユーロまたは世界売上高の7%、あるいは750万ユーロまたは売上高の1.5%の罰金が科される可能性がある。 |

生成AIを対象とした規制は、AI規制法「第52条 特定のAIシステムに対する透明性義務」で定められており、1項はAIによるなりすましの禁止、3項はAI生成コンテンツであることの開示を義務づけています。それらの条文は、以下のようなものです。

(第52条1項)プロバイダーは、自然人と対話することを意図したAIシステムが、状況や使用の文脈から明らかな場合を除き、自然人がAIシステムと対話することを知らされるように設計・開発されていることを保証しなければならない。この義務は、犯罪を検知し、防止し、捜査し、起訴することを法律で認められたAIシステムには適用されない。

(第52条3項)実在する人物、物体、場所、その他の実体や事象に著しく類似し、真正または真実であるかのように人に見せかける画像、音声、映像コンテンツ(「ディープフェイク」)を生成または操作するAIシステムの利用者は、当該コンテンツが人為的に生成または操作されたものであることを開示しなければならない。

以上のようなAI規制法がEU加盟国で施行されるのは、今後、同法が欧州議会と欧州理事会において正式に採択される必要があります。

なお、AI規制法の全文はこちらの公式サイトから確認できます。

イギリスの動向

イギリス政府は2023年9月23日、公務員による生成AI活用の指針を定めた「生成的AIの利用に関する公務員へのガイダンス」を発表しました。このガイダンスには、公務員が生成AIを活用する場合に機密情報を入力しないことや、生成AIの出力にはバイアスや誤情報が含まれることがあるので留意することが明記されています。

AI安全サミット直前の2023年10月27日、AI企業がAI安全性ポリシーを定めるにあたっての参考資料となる文書「フロンティアAIの安全性に関する新たなプロセス」を発表しました。この文書はAI生成コンテンツの識別に言及しており、AI企業にAI検出器と電子透かしの開発と、生成AIの出力を追跡できる来歴データベースの構築を推奨しています。来歴データベース構築では、個人情報を保護するために個人情報のハッシュ化が提案されています。

AI安全サミット終了直後の2023年11月2日には、AIの安全性を研究する「AI安全研究所」の設立を発表しました。同研究所には研究をサポートするための計算リソースが提供され、3億ポンド規模の資金援助も実施されます。

AI安全研究所の紹介ページによると、同研究所は以下の3項目に取り組みます。

|

その他の国の動向

アメリカと欧州圏以外の地域の海外動向として、以下ではカナダと中国の動向をまとめます。

カナダ

カナダ政府は2023年8月16日、生成AIに関する規制のたたき台となる「生成AIのためのカナダのガードレール – 実施規範」を発表しました。このガードレールには、AI開発者がディープフェイクのような悪意のあるAI利用に対して対策することや、学習データの品質評価などが定められています。

2023年9月12日には、カナダ政府が生成AIを利用する際の指針となる「生成AI活用ガイド」を発表しました。このガイドの末尾にある「よくある質問」における「生成AIを政策に活用することは可能か?」という質問に対して、政策立案時の調査には利用できるが、政策の決定や解釈には使用してはならない、と回答しています。

中国

中国政府は2023年7月10日、生成AIに関する規制をまとめた「生成人工知能サービス管理暫定弁法(中国語表記:生成式人工智能服务管理暂行办法)」を公布し、同年8月15日に施行しました。

企業法務ニュース専門メディア『企業法務ナビ』は2023年7月21日、以上の法律を解説した記事を公開しています。その記事によると、同法が定める「サービス提供の原則」には国家イメージを損なうコンテンツや、暴力コンテンツやポルノコンテンツのような法律で禁止されているコンテンツの生成を禁止しています。

また、世論操作や大衆の動員を可能とするフォーラム等を「世論属性サービス」と定め、このようなサービスに生成AIを活用する場合、アルゴリズムの届け出を義務づけています。

民間企業の動向

民間企業による自主的なガイドラインも発表されています。そうした事例のひとつとして、アメリカの大手テック企業によるコミットメントがあります。ホワイトハウスは2023年7月21日、Amazon、Anthropic、Google、Inflection、Meta、Microsoft、OpenAIが共同で制定したコミットメント「安全かつ安心で信頼できるAIの確保」を受理したことを発表しました。

以上のコミットメントでは、以下のような3項目の履行が約束されています。

|

コミットメント項目 |

コミットメント内容 |

| 製品の安全性の確保 | ・製品リリース前にリスクに関するテストを実施する。 |

| ・リスクに関して、政府やユーザと情報共有する。 | |

| セキュリティの徹底 | ・非公開のモデルウェイトを保護するためのセキュリティを徹底する。 |

| ・第三者によるAIシステム脆弱性に関する報告を促進し、報告された脆弱性を速やかに対処する。 | |

| ユーザからの信頼の確保 | ・電子透かし等のAI生成コンテンツを識別する技術を開発する。 |

| ・AIバイアスやプライバシー保護に関する研究を約束する。 |

まとめ

以上にまとめたように、AI規制とガイダンスに関して対処すべきリスクは各国でほぼ共通しているものも、その対処策では各国の特色が表れています。アメリカはAIの安全性とリスクに関して「すべきこと(推奨事項)」を定めているのに対して、EUのAI規制法は「してはいけないこと(禁止事項)」を規定しているのが対照的です。また、中国は「国家秩序の維持」を目的として生成AIを規制しているのが特徴的です。

もっとも、今回まとめた内容でAI規制とガイダンスが確立されたわけではありません。世界共通の課題として「偽情報に対する防衛策」があり、この課題に関しては2024年前半に開催される韓国主催の第2回AI安全サミットで進捗が報告されるでしょう。

日本のAI事業者ガイドライン案は、アメリカやEUのAI規制と比較して緩やかな印象を受けます。例えば、高度なAIに関して、アメリカとEUは情報共有を義務づけていますが、同ガイドライン案には強い強制力が感じられません。もっとも、正式版では諸外国と足並みを揃えるためにより厳しい内容になるかも知れません。

AINOWでは、世界と日本のAI規制とガイダンスに関して今後も折りに触れて情報発信していきます。

記事執筆:吉本 幸記(AINOW翻訳記事担当、JDLA Deep Learning for GENERAL 2019 #1、生成AIパスポート、JDLA Generative AI Test 2023 #2取得)

編集:おざけん