機械学習モデルの開発には、周知の通り、大量の学習データが必要になる時があります。大規模な学習データを用意する際に問題となるのが、データのプライバシーです。例えば、医療データを収集して学習データを用意したい場合、患者の同意なしにはデータを収集できません。

以上のような問題に対処できるように考案されたのが、連合学習(Federated Learning)です。この技法は、ユーザーのプライバシーを保護しながらユーザーデータを活用した学習を可能とします。その仕組みを要約すると、各ユーザーの端末にサーバーにある機械学習モデルをダウンロードした後に、各端末のユーザーデータを使ってモデルを訓練して、その学習結果のみをサーバーに送信する、となります。

もっとも連合学習にはモデルを学習する各端末の計算能力に制限がある、といった課題もあります(課題の詳細は以下の記事本文を参照)。しかしながら、データプライバシーを保護できる同技法に関しては、ヘルスケアをはじめとした多数の分野での応用が期待されています。

なお、以下の記事本文はBenedict Neo氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

目次

機械学習のためのプライバシーのアップグレード

多くの機械学習アプリケーションでは、その動作のために大量のデータが必要とされる。しかし、問題はユーザーデータが機密的かつ私的なものであることだ。

プライバシーやデータの権利に関する懸念の高まりは、機械学習モデルの訓練や開発において、ユーザーが機密データをクラウドサーバーに引き渡さなければならない従来の方法に問題を提起している。

その解決策は?連合学習(Federated Learning)だ。

今日の記事に飛びつく前に、私たちは新しいdiscordサーバーを持っており、そこにあるbitgritコミュニティでは新しくリリースされたBGRトークンを含むすべてのデータサイエンスとAIについて議論しています。サーバーへの参加はこちらから!(※訳註1)

・・・

連合学習とは

分散最適化、プライバシー研究、機械学習を組み合わせることによって、連合学習は生まれた。

Wikipediaによる正式な定義は、以下の通り。

連合学習(協調学習(collaborative learning)とも呼ばれる)とは、ローカルなデータサンプルを保持する複数の分散型エッジデバイスまたはサーバー間で、ローカルデータを交換せずにアルゴリズムを学習する機械学習手法である。

ここでのキーワードは、分散型とローカルデータである。

連合学習は、GoogleのAI研究者が2016年に発表し次の論文で初めて紹介された。「分散型データからのディープネットワークに関する通信効率的学習」。

連合学習の主な考え方は、中央集権的なモデルを分散型デバイスに持ち込むことで、ユーザーデータの取得を不要にすることにある。

ユーザーデータはデバイスから離れないため、モデルの結果のみが共有され、データのプライバシーとセキュリティを保つのに役立つ(詳しくは後述)。

以上のような機械学習のプライバシー向上は画期的であり、機密データを扱うMLアプリケーションに新たな可能性をもたらす。

しかし、連合学習のユースケースと利点に飛び込む前に、例を挙げてその仕組みについて説明したい。

・・・

仕組み

以下では、GoogleのGboard(※訳註2)における次の単語の予測を例にとり、連合学習のプロセスを順に追って見ていくことにする。

まず、Googleは公開データを使って学習したベースとなるMLモデルをクラウドサーバーに構築する。

そして、複数のユーザー端末が自発的にMLモデルを学習する。そうした端末は、電源とWi-Fiネットワークに接続されているときにダウンロードして、モデルを取得する(モデルの訓練は電力消耗の激しい操作なので、ユーザーのデバイスのバッテリーを消耗しないようにしたいのだ)。

ユーザーの端末はキー入力のログや予測結果のフィードバックなど、モデルに関連するデータを提供し、モデルの学習と改良に役立てる。

学習が完了するとモデルの更新や改良が集約されてから、暗号化されてクラウドに送信され、新しい情報で(サーバーにある)ベースモデルが更新される。

このダウンロードとアップデートのサイクルは複数のデバイスで行われ、良い精度に達するまで何度も繰り返される。こうして完成したモデルは、他のすべてのユーザーに配布され、あらゆるユースケースに対応できるようになる。

重要なのは学習データは依然としてユーザーのデバイスに残っていることであり、学習結果だけが暗号化されてクラウドに送信される。

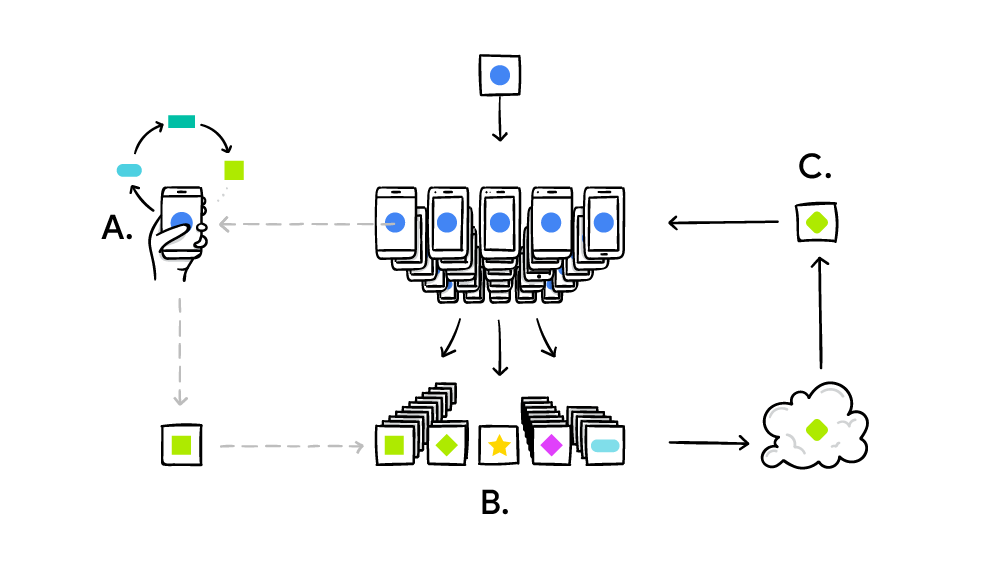

以上のプロセスの詳細を画像で説明すると、以下のようになる。

携帯電話は、利用状況に応じてローカルにモデルをパーソナライズする( A )。多くのユーザーの更新が集約され( B )、共有モデルに対する変更合意( C )が形成され、その後、この手順が繰り返される。(出典)(※訳註3)

このように機械学習モデルを協調的に学習・開発する方法は強力であり、実世界に応用事例がある。

・・・

応用事例

法的、経済的な理由などでデータがサイロ化(※訳註4)されている場合、より大きなデータセットで個々の関係者がモデルを学習できるため、連合学習が威力を発揮する。

1.ヘルスケア

連合学習応用の好例がデジタルヘルスだ。医療機関のデータは、患者のプライバシーやデータガバナンスの関係でサイロ化されており、患者の同意なく利用できない。従来のアプローチでは、機械学習モデルは限られた利用可能なデータソースからしか学習できないので、学習結果に病院の機器/人口統計/診療行為に関する偏りが生じてしまう。

連合学習ではAIアルゴリズムは他の病院からより多くの情報を得られるので、性別、年齢、人口統計などに関してより偏りのない情報を取得できる。こうしたことによって、モデルがより一般化された予測を実行できるようになる。

参考文献 → 連合学習がもたらすデジタルヘルスの未来(※訳註5)

連合学習の医療現場への導入による関係者の影響

|

2.自動運転車

自動運転車も個々のアクターとして扱えるので、中央のサーバーにデータを送り返すのではなく、車に学習機能を搭載できる。

現実世界での運転は危険であり、予測できないことも多いため、連合学習は学習プロセスを加速させ、大量のデータを転送する必要性を減らせる。最終的には、完全な自律型自動運転に向けたプロセスを加速させる可能性を秘めているのだ。

連合学習は、主にモノのインターネット(IoT)の分野でより多くの応用事例がある。それらの事例は、データのプライバシーを維持しながら、ハイレベルの通信とストレージのオーバーヘッドを削減しつつMLを使ってIoTを可能にするという、連合学習の狙いに同じように共鳴している。

・・・

限界と課題

連合学習はまだ新しいアイデアであり、いくつかの広く知られている課題があるため、その可能性を十分に発揮できていない。

1.非-独立同分布なデータ

世界中のデバイスは、常に非-独立同分布なデータを生成している。統計学の文献では、非-独立同分布とはデータが独立でなく、同一分布でないことを意味する。独立同分布な変数の仮定は多くの統計手法やアルゴリズムの中心となっており、非-独立同分布なデータはモデルに複雑さを与え、問題を引き起こす可能性がある。

2.端末の計算能力

連携ネットワークに参加する各デバイスは、ソフトウェアおよびハードウェアのレベル(ネットワーク接続性、RAM、電力など)においてその能力が異なる。今日のほとんどのスマートフォンはモデルの訓練のような計算集約型のタスクに高い能力を発揮するが、エッジデバイスの大部分はまだそうした演算ができず、デバイスのパフォーマンスが低下してしまう可能性がある。つまり、デバイスのパフォーマンス維持とモデルの精度のあいだにはトレードオフがあるのだ。

3.データラベリング

多くの教師ありML技術は、アルゴリズムの実行のために明確で一貫したラベルを必要とする。さまざまなデバイスから送られてくるデータに対して自動的にラベル付けを行うには、優れたデータパイプラインを実装する必要がある。

4.データリーク

リバースエンジニアリングにより、特定のユーザーのデータを特定し、入手することは依然として可能だ。もっとも差分プライバシーなどのプライバシー技術により(※訳註6)、連合学習のプライバシーを強化できるが、その代償としてモデルの精度が低下する。

連合学習の課題については、こちらを閲覧のこと(※訳註7)。

連合学習研究における5つの未解決問題

|

・・・

フレームワーク

連合学習を弄り回すことに興味を持っただろうか。

以下では、連合学習を実装するためのフレームワークをいくつか紹介する。

- TensorFlow Federated

- PySyft

- OpenFL

- Flower:親しみやすい連合学習フレームワーク

- FATE

・・・

連合学習は人工知能における強力なアイデアだ。この技術によって複数のデバイスにまたがって、低レイテンシーかつ低消費電力でデータのプライバシーとセキュリティを確保しながら、分散型の学習が可能になるのだ。

実世界で実用化されるまでにはまだ課題に直面しているが、今日も膨大な研究が行われている。

この記事が連合学習に興味を持つきっかけとなり、連合学習とは何か、何が実現できるかを垣間見て頂けたなら幸いです。

以下に、連合学習に関するより多くのリソースを紹介します。

お読み頂きありがとうございました。

・・・

その他の読み物/リソース

参考文献

この記事が気に入りましたか?他にも楽しめる私が書いた記事が以下にあります👇。

Bitgritが提供するデータサイエンスに関する出版物をさらにフォローしましょう。

以下のBitgrit関連プラットフォームで私たちを見つけましょう👇📱📱。

原文

『Federated Learning — Decentralized ML』

著者

Benedict Neo

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん