ハーバード大学コンピュータサイエンス学科の学生である著者のCatherine Yeo氏は、AI倫理に関する記事をMediumに投稿しており、その一部はAINOWでも紹介しました(Yeo氏の詳細は同氏の公式サイトを参照)。同氏がMediumに投稿した記事『Shalaleh Rismaniと考えるロボットの倫理と設計』では、AI倫理とロボット倫理学の専門家にインタビューした内容がまとめられています。

カナダ・バンクーバーで活動するAI倫理とロボット倫理学を研究するシンクタンクOpen Roboethics Instituteに所属するShalaleh Rismaniにインタビューした内容は、以下のような箇条書きで要約できます。

Shalaleh Rismani氏インタビューの要約

|

以上のインタビューで指摘されているように、AI倫理とロボット倫理学は例えばサイバーセキュリティのようには普及していない概念です。そうだからこそ、AI倫理とロボット倫理学の周知は、現在のAI業界全体の課題と言えるでしょう。

なお、以下の記事本文はCatherine Yeo氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

どのようにして責任あるAIやテクノロジーをデザインできるのだろうか?

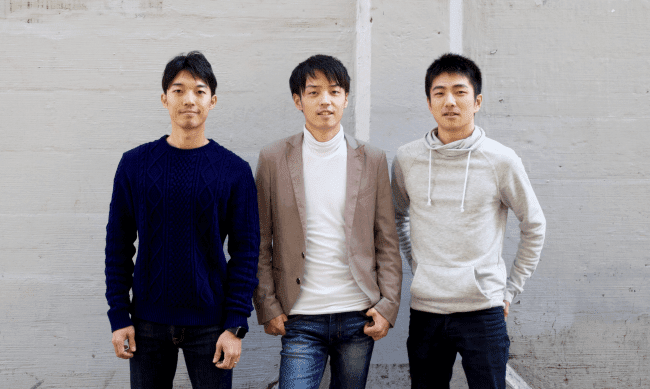

待望のAI専門家へのインタビューシリーズ第1回目として、光栄なことにShalaleh Rismani氏と対談できて大変うれしい限りです。

Shalaleh氏は現在、カナダのシンクタンクOpen Roboethics Institute(ORI)(※訳註1)の共同ディレクター兼デザイン研究者として、AIやロボット工学が及ぼす倫理的・社会的影響について研究しています。また、マギル大学(※訳註2)の電気・コンピュータ工学博士課程にも在籍しており、同大学の責任ある自律的なインテリジェントシステムの倫理研究室に所属して、AIシステムがAI倫理原則を遵守しているかどうかを測定・評価する方法を研究しています。

今回は、以下について同氏に伺います。

- AIとロボット倫理学

- 人間中心の価値観にもとづいたデザイン

- AIの開発と規制

主な回答と留意点

注記:この以下のインタビューをまとめたセクションは、わかりやすくするために編集され、短くなっています。インタビューの全文をご覧になりたい方は、「インタビュー全文」のセクションにスクロールしてください。

Shalaleh Rismaniインタビューのハイライト

ご自身の経歴と、AIやロボット工学の世界に入ったきっかけについて少しお話いただけますか?

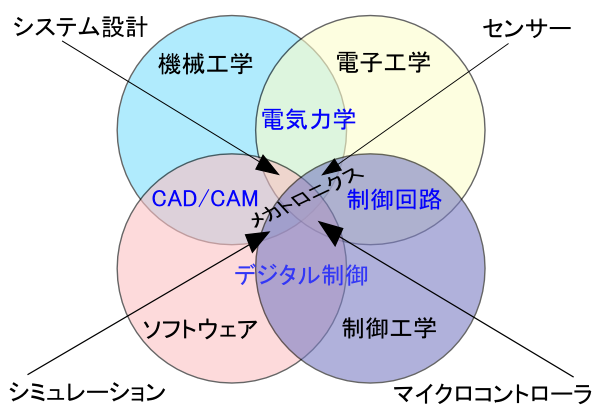

私のバックグラウンドはエンジニアリングです。ブリティッシュ・コロンビア大学(※訳註3)の学部でメカトロニクスを専攻しましたが、当時のメカトロニクスは新しい分野と言っていいでしょう(※訳註4)。メカトロニクスは機械(工学)、電気(工学)、コンピュータサイエンスが融合した分野で、あらゆることができるのでとても気に入りました。

その頃、Elizabeth Croft博士が人間とロボットのインタラクションに焦点を当てたプレゼンテーションを行いました。そのプレゼンは、どのようにしてロボットシステムと人間が良好なコラボレーションを実際に築けるのかについて論じていました。そんなプレゼンを聴いて、私はその研究にとても興味を持ちました。そこで、ロボットとのインタラクションに関して学部での研究やインターンシップを重ねていきました。そうした活動がきっかけとなって、ロボット倫理の分野に興味を持つようになりました。特に私の学部ではロボットシステムの作り方は学びましたが、なぜそのシステムを作るのか、そのシステムが人にどのような良い影響を与えるのか、あるいは悪い影響を与えるのか、という質問はあまりしませんでした。それが悔しかったんです。その悔しさから、当時のOpen Roboethics Instituteに参加したことが、私がこの分野に入ったきっかけとなりました。

従来のエンジニアリングやロボット工学のプログラムでは、倫理的・社会的な問題を授業で教えたり、研究で考慮したりすることはあまりありませんでしたが、ありがたいことに、最近ではその傾向がどんどん変わってきています。しかし、あなた個人としては、いつこれらの問題について考え始めたのでしょうか?また、倫理的原則や社会的な意味合いがあなたの研究や調査に活かされるようになったのはいつですか?

私の場合は、(倫理的・社会的な問題を考えることが)そもそもエンジニアリングの道に進んだ理由のひとつだったと思います。高校生の時、エンジニアは社会的な問題を解決することができるので、エンジニアリングの道に進みたいと思うようになりました。私がエンジニアリングやデザインに初めて触れたのは、「ゼロ・ウェイスト(zero waste:「無駄がゼロ」)」というテーマで問題を特定し、それをデザインで解決するというプログラムに参加したときでした。社会的な問題を、部分的にはテクノロジーで解決できるということに私は魅力を感じたのです。

エンジニアリング課程に進学して、幸運なことにブリティッシュ・コロンビア大学では「グローバルエンジニアリング」というコースを履修したおそらくは最初の学生となりました。このコースでは倫理的・社会的な問題をテクノロジーで解決することをより実践的に学べました。そこで、人間中心のデザイン、サービスデザイン、インパクトアセスメント、ステークホルダーの理解、コンテクストの理解などの概念を学びました。倫理的・社会的な問題に関わる個人的な興味や考えはありましたが、グローバルエンジニアリングという特別なコースでこれらの問題により正式に触れられました。その後は、私自身が個人的に読んだり、この分野に興味を持ったりしたことが、私を成長させ、より多くのことを学ばせてくれました。

現在、研究や仕事で取り組んでいることは何ですか?

ロボット倫理やAI倫理の分野は、私が初めてこの分野に触れた2012年から2013年にかけて、かなり進化してきました。ロボット倫理学(roboethics)という言葉は(2002年に)作られたものですから、それほど昔のものではありません(※訳註5)。AI倫理という言葉はもっと新しく、5、6年前のものだと思いますし、この分野の学会も5、6年前にできました。ですから、私がまさに今見ている問題は、他の確立された分野では単純で予備的なものに見えるかも知れませんが、この分野では依然として注目されるものなのです。私たちは、公平で、透明性があり、倫理的なAIシステムを構築する必要性と願望について話し合っています。しかし、AI倫理が何を意味するのか、それを具体的にどのように測定すればよいのかがわからない場合、あるいは機械学習エンジニアが実際にシステムを構築する場合、どのような基準や規制に従うべきなのか、開発における基準はいくつかありますが、実際に人々が当然なものとして同意したり従ったりするものはまだ実際にはないのです。ですから、私の研究では特に、AI倫理を現在どのように測定しているのか、そしてどのように測定すべきなのかを調べています。

テクノロジーやAIの倫理業界における今後のトレンドや新たな課題について、どのようにお考えですか?

新しいトレンドですか?興味深い質問ですね。現在AI業界では、AIシステムとそれにまつわる挑戦をさまざまなレベルで実際に成功させるという大きな課題に直面していると言えるでしょう。多くの企業がAIシステムを実際に導入するための準備が必ずしもできていないという意味で、これは技術的な課題と言えます。その準備とは、機械学習モデルを実際に開発・導入するための適切なデータ、インフラ、システムが整っていないということです。AIシステム導入を準備するためには、AIシステムや機械学習システムを実際に導入するための良いプロセスとは何かという問いかけをより良く理解し、実践する必要があります。

実際には、どのようにデータを保護するのか、どのようにデータを形成するのか、誰がそのデータにアクセスするのか、データはどの程度安全なのか、といった技術的な課題があります。また、モデルの実装、モデルの効率性などの技術的な課題もあります。多くの企業が持っている限られた計算能力で実際に計算を実行できるのか、などなど様々な課題があります。

以上は技術的な課題ですが、同時に社会的な課題も非常に大きくなっています。機械学習デバイスは人々とどのように相互作用するのか、人々にどのような影響を与えるのか、人々は長期的に使用するのか、故障したらどうすればいいのか。これらの問題に対して、どのように行動すべきなのか。

私のほかにも多くの人々が以上の社会的・倫理的問題を認識し、積極的に取り組んでいると認識しています。(AIをめぐる技術的な問題と社会倫理的な問題という)この2つが、言及すべき主なトレンドと言えるでしょう。

現在または将来の産業界や学界のロボット工学者、研究者、開発者(またはそれに関連する人々)に対して、責任あるテクノロジーをよりよくデザインする方法についてアドバイスはありますか?

AIシステムやロボットを設計する際に、何十年も前から実践されてきたのに、今ではあまり実践されていないことのひとつに、ステークホルダーを理解し、特定のステークホルダーが持つ価値観を理解することが挙げられます。

例えば、バンクーバーで何かをデザインする場合、カナダの先住民コミュニティのためにデザインする場合には違いが生じます。彼らは本質的に異なる価値観を持っているので同じ国であっても、コミュニティによって自動化システムを自分たちの生活にどう取り入れたいか(あるいは取り入れたくないか)について価値観が異なるのです。

人間中心設計や価値観重視設計と呼ばれるものは、非常に基本的な設計理論であり、他の分野では何十年も前から適用されていますが、AIシステム開発やロボット開発にはあまり適用されていないと思います。倫理的な設計について他分野から学び、その学びをAIとロボットの開発に取り入れる余地は十分にあると思います。

理想的な未来の世界において、システムにAI倫理をどのように含ませたいと思っていますか?

理想的な世界では、一度や二度ではなく、何度も機能するシステムを構築するために、AI倫理とAIシステムが規制されなければならないと考えています。コンピュータサイエンスのコミュニティや機械学習の実践者のコミュニティでは、規制がイノベーションを妨げているという意見がありますが、規制があるからこそ、実際にイノベーションを維持し、AIシステムを使い続けられる、とも私は考えています。規制がイノベーションの妨げになるという意見には賛成できません。私は、イノベーションはさまざまな場所に存在すると考えています。特定の方法でデータを収集しなければならないという規制があるからといって、企業としてのイノベーションが妨げられるわけではありませんよね。さまざまな制約のもとでも、革新的になれるのです。ですから、長い目で見れば、この分野は規制されなければならないと思います。

しかし、AI規制が整うまでの間、理想的なのはAIシステムを設計しているすべての人が、設計中に(規制を検討すべき倫理的な)質問を自分自身に問いかける方法を知っていることだと思います。つまり、会社のなかで1人だけがAI倫理を推進しているような状況では、決してうまくいかないのです。会社の全員が、あるいは大多数の人がこのような倫理的な質問をするのが望ましいと思われることで、実際に良い方向に向かうのです。

AI倫理は非常に進化しているダイナミックな分野ですが、インターネットユーザーやテクノロジーユーザーの多くにはまだ浸透していません。そこで、ぜひあなたのご意見をお聞きしたいと思いました。どうすれば、友人や同僚、周囲の人たち、そしてそれ以外の人たちとAI倫理に関する会話を始められるでしょうか。倫理的で責任あるAIについての会話を促進し、AI倫理の普及に着手するために、私たちはどのような役割を果たせるでしょうか?

それは素晴らしい質問ですね。あなたが指摘しているのは非常に今日的なことであり、人々はAIからの影響を受けているにもかかわらず、必ずしもこの会話に参加していないのが問題だと思います。私がこの問題について考えたり、友人に話したりする時に使う簡単な方法は、「自分の時間をどのように使っているか」と自問してみることです。そして、誰があなたの時間を演出するのか、と問うのです。例えば、ソーシャルメディアのアプリを使っていると、機械学習システムによって自動的に特定のものが他のものより多く見られるようになっています。次の機会に注意して頂きたいのですが、あなたに対して何が表示されていますか。何を見るように指示されていますか。もしかしたら、あなたの1日のうち1時間は機械学習システムに指図されているかも知れません。これは私にとって非常に大きな問題であり、みんなに考えてもらいたいことだと思っています。そして、一度でも考えてみた人は、自分の疑問について問い始めるのです。

もしかしたら、あなたの1日のうち1時間は機械学習システムに指図されているかも知れません。

インタビュー全文

Shalaleh氏のインタビューのすべては以下の動画でご覧いただけます(共同ホストはFair BytesチームのCatherine YeoとElisée Djapa)。

Shalaleh氏についてはhttps://shalalehrismani.comを、ORIの詳細を知るにはhttps://openroboethics.orgをご覧ください。

原文

『Robot Ethics & Design with Shalaleh Rismani』

著者

Catherine Yeo

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん