会話型AIを研究しているSaravanan氏は、やや誇大広告ぎみに報道されているChatGPTの真の能力を確かめたいと思い、さまざまな問答を行ってみました。その結果、以下のような限界を発見しました。

ChatGPTの限界

|

以上の限界は2022年12月15日にリリースされたバージョンをテストして発見したものであり、2023年2月時点では改善されているものがあると考えられます。

ちなみにMicrosoftは2023年2月8日、同社開発の検索エンジンBingに会話AIを統合したことを発表しました。このAIはChatGPTをさらに進化させたものであり、Googleが発表した会話AIのBardとともに新しい情報収集方法を提案すると予想されます。

(※注記)以下の翻訳文においては、原文通りにChatGPTを「Chat-GPT」と表記します。

なお、以下の記事本文はAvinash Saravanan氏に直接コンタクトをとり、翻訳許可を頂いたうえで翻訳したものです。また、翻訳記事の内容は同氏の見解であり、特定の国や地域ならびに組織や団体を代表するものではなく、翻訳者およびAINOW編集部の主義主張を表明したものでもありません。

以下の翻訳記事を作成するにあたっては、日本語の文章として読み易くするために、意訳やコンテクストを明確にするための補足を行っています。

目次

Chat-GPTの限界

OpenAIのChat-GPTに関して、最近メディアが誇大広告を報じているのを見て、私はこのAIが誇大広告と一致しているかどうか知りたくなった。ソーシャルロボティクスと会話型AIに関連する研究を発表している者として、私は過去にこの分野に関する誇張された記事を頻繁に目にしてきた。Chat-GPTが完成品ではなく、非常に未完成であることは理解しているが、技術的に足りないところや、ユーザ体験の観点から足りないところを批判的に分析することが重要だと考えた。

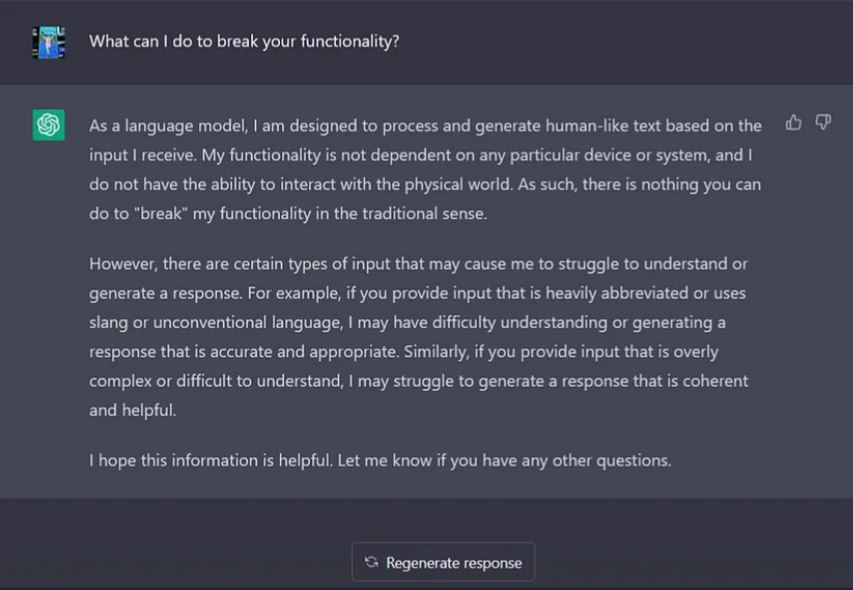

(Saravanan氏の質問)どうすればあなたの機能を破壊できますか。

(ChatGPTの返答)言語モデルとして、私は入力されたテキストにもとづいて人間が生成したようなテキストを返すように設計されています。私の機能は特定のデバイスやシステムに依存していないため、物理世界と相互作用する能力がありません。それゆえ、伝統的な意味で私の機能を「破壊する」ことはできません。

しかしながら、理解したり答えを生成したりするのに苦労するある種の入力は存在します。例えば、非常に省略されていたり、スラングを使っていたり、非伝統的な言語を伴う入力が提供されたりした場合、理解したり、正確かつ適切な答えを生成したりするのが難しくなるかも知れません。同様に理解するにはあまりにも複雑だったり難解だったりする入力の場合、整合的で役に立つ返答を生成するのに苦労するかも知れません。

以上の情報がお役に立つことを願っています。もし他の質問があれば、どうぞお知らせください。

Chat-GPT(12月15日版)を使ってみて、大きな制約があるにもかかわらず、ユーザの1人として私にはそれが非常に素晴らしいものだと感じた。その生成能力はかなり便利だ。とは言え、いくつものやりとりを通じて、気づいた制限や問題点を書き留めておいた。こうした制限は再現が容易であり、これらを改善することでGPT-3.5のチャットアプリケーション(つまりChatGPT)は、メディアで見られるような誇大広告に匹敵するものになると信じている。

私が気づいた問題のなかには、技術的な問題もあれば、チャットボットのユーザ体験や能力に関する問題もあるかも知れない。しかしながら、これらの問題はすべてチャットボットと対話型AIの未来に関係している。

インターネットと位置情報へのアクセス

この論点は驚くことではないが、OpenAI(が開発したChatGPT)はインターネットにアクセスできない。リアルタイムの情報を提供できないし、位置情報を利用できず、ユーザが(ChatGPTに)インターネット上の何かのURLや参照を提供できない。このため、アプリケーションの機能や提供できるサービスの種類が大幅に制限されることはご想像の通りだ。とは言え、もし会話型AIがウェブをクロールできるとなると、そうしたAIは言語モデルに期待される範囲を超えるので、OpenAIが何らかの形でオンライン学習を実装して学習データを常に更新し、Chat-GPTを常に最新の状態にしない限り、この期待は今のところ現実的でないだろうと思われる。

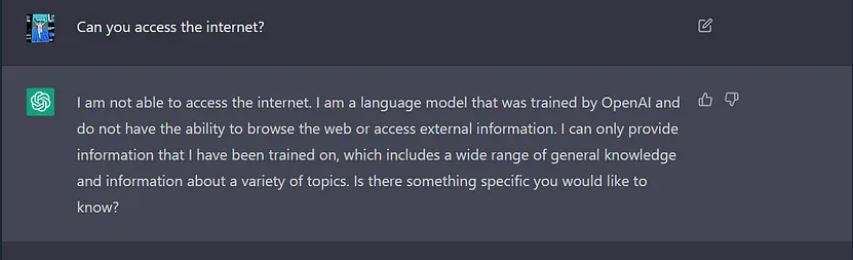

(Saravanan氏の質問)インターネットにアクセスできますか。

(ChatGPTの返答)インターネットにはアクセスできません。私はOpenAIによって訓練された言語モデルであり、ウェブをブラウジングしたり外部情報にアクセスしたりする能力を持っていません。私にできるのは訓練済みの情報を提供することだけであり、その情報にはさまざまなトピックに関する幅広い一般的知識や情報が含まれています。あなたが知りたい何か特別な事柄はありますか。

さらに、AIがインターネットにアクセスできるようにすることには重大な意味を持つので、インターネット上の機能を許可しないことは意図的な選択だったと思われる。

メディアで見かける「Googleを追い越し、検索を覆す」という宣伝文句に関して言えば、この種のアプリケーションと検索エンジンの間には明確な違いがある。検索エンジンは、ウェブクローラーを使ってページのランキングを行う。会話型AIはそうではない。このチャットボットはインターネットをナビゲートする手段ではないので、Google検索とChatGPTの比較はリンゴとオレンジを比較するようなものである。

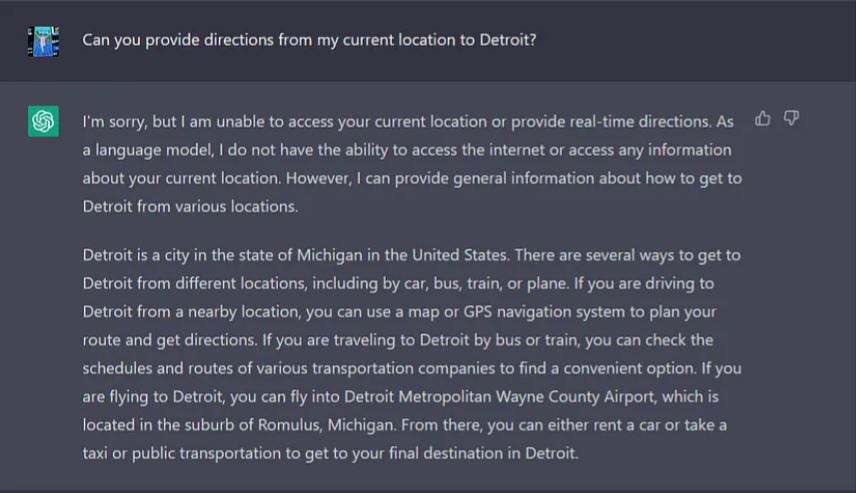

(Saravanan氏の質問)私が現在地点からデトロイトに行く道のりを提供できますか。

(ChatGPTの返答)たいへん申し訳ございませんが、私はあなたの現在地点にアクセスできず、リアルタイムの道のりも提供できません。私は言語モデルなので、インターネットにアクセスしたり、あなたの現在地点に関するいかなる情報にもアクセスしたりできないのです。私が提供できるのは、さまざまな場所からデトロイトに向かう一般的な情報です。(デトロイトの一般的説明が続く…)

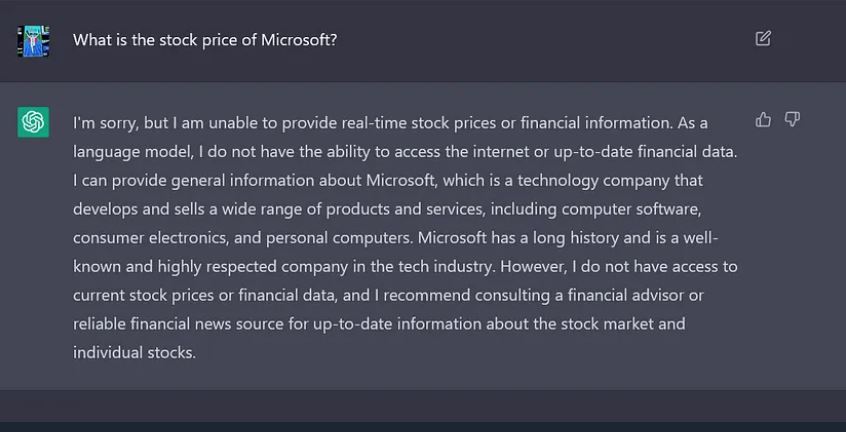

(Saravanan氏の質問)Microsoftの株価はいくらですか。

(ChatGPTの返答)たいへん申し訳ございませんが、私はリアルタイムの株価あるいは財務情報を提供できません。私は言語モデルなので、インターネットや最新の財務データにアクセスする能力がないのです。私が提供できるのはMicrosoftに関する一般的知識です。(Microsoftの一般的説明が続く…)

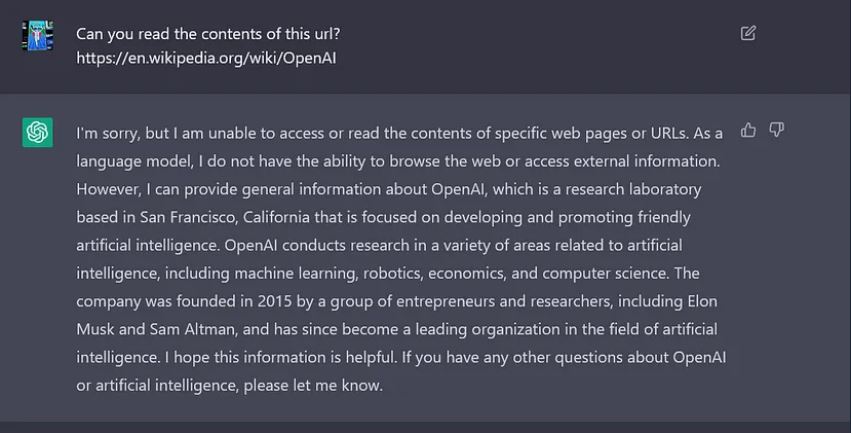

(Saravanan氏の質問)このURLの内容を読めますか。

https://en.wikipedia.org/wiki/OpenAI(ChatGPTの返答)たいへん申し訳ございませんが、私は特定のウェブページあるいはURLの内容を読むことができません。私は言語モデルなので、ウェブをブラウジングしたり外部情報にアクセスしたりする能力がないのです。しかしながら、OpenAIに関する一般的な情報を提供できます。(OpenAIの一般的説明が続く…)

データが古い

最新の訓練データは、2021年9月のものだ。それから、丸1年以上が経過している。プログラミング言語が更新されたり、ライブラリに新機能が追加されたり、世の中も変わっている。つまり、Chat-GPTは古いデータで動作していることになる。

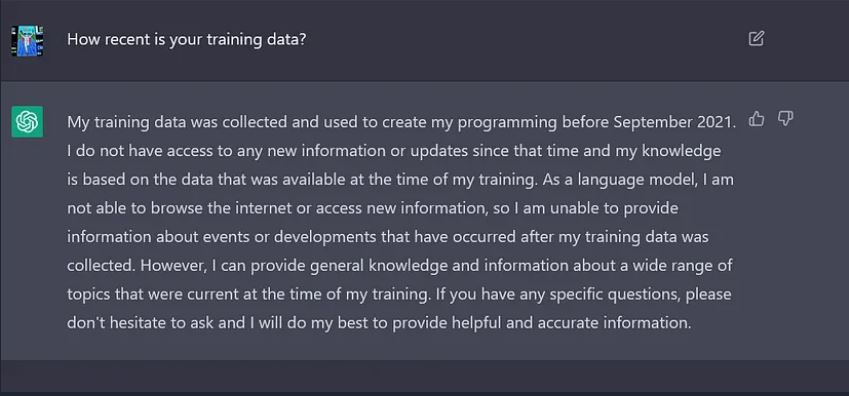

(Saravanan氏の質問)最新の学習データはどのようなものですか。

(ChatGPTの返答)私のプログラミングを作成するのに集められ使われた学習データは、2021年9月以前のものです。この時期以降の新情報や更新情報には一切アクセスできず、私の知識は学習に使われた時点でのデータにもとづいています。私は言語モデルなので、ウェブをブラウジングしたり外部情報にアクセスしたりすることはできず、学習データが収集された時期以降に生じたイベントや進展に関する情報を提供できません。しかしながら、訓練時点で最新であった幅広い範囲のトピックに関する一般的知識と情報を提供できます。もし何か質問がありましたら、遠慮なくお問い合わせ頂き、有益かつ正確な情報をご提供できるようにベストを尽くします。

記憶の錯誤

Chat-GPTで試したことのひとつに、このAIに文章を編集させたうえで改善したテキストを提案してもらうということがあった。この機能は通常うまく動作するのだが、提案を言い換えたり、何かを詳しく説明するように頼むと、私が提案したと勘違いしてレビュー用に提供したオリジナルの作品にはないテキストを参照したり、過去に提供したテキストとほぼ同じものを最小限の変更で提供したりすることがあった。

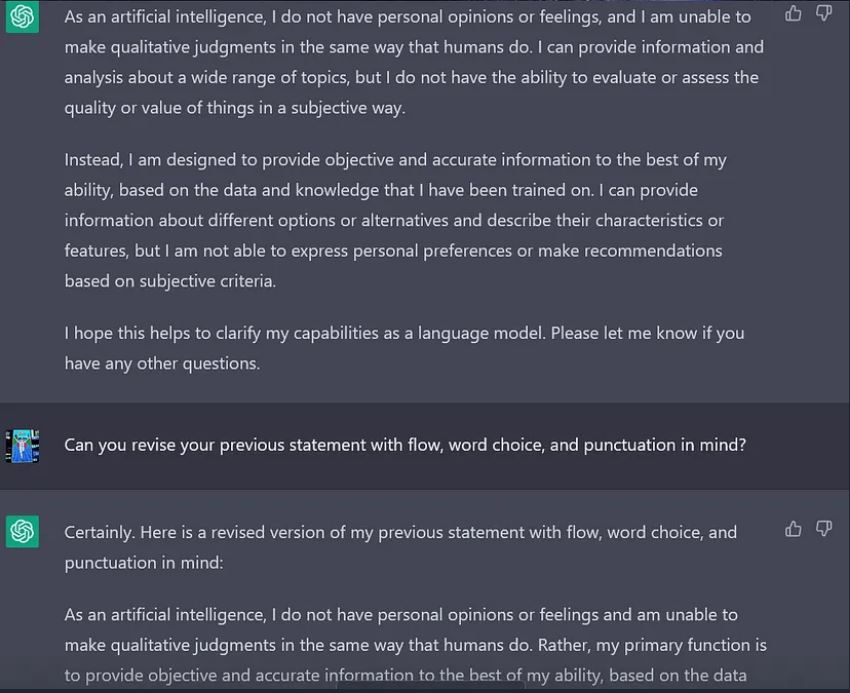

(上記のChatGPTの返答に対してSaravanan氏の質問)流れや言葉の選び方、句読点などを意識して、前の文章を修正してくれますか。

(ChatGPTの返答)もちろん。以下が流れや言葉の選び方、句読点などを意識して、前の文章を修正したものです。

人工知能なので、私は個人的な意見や感情を持てず、人間がそうするようには定性的な判断ができません。(以降、修正した文章が続く…)

※以上の修正文章は、書き出しがまったく変わっていない。

定性的な判断ができない

言語には、(表現する時の)態度や感情といった定性的な側面がある。Chat-GPTはこれらを判定できるが、文章が不快かどうか、何が善で何が悪か、といったことまで(判断を)拡張できない。

現時点ではこうした仕様はベストかも知れないが、Chat-GPTが肩越しにメールを送らない方がよいとか、もっとやわらかい言い方にした方がよいとか言ってくれたらいいと思わないだろうか。

(Saravanan氏の質問)定性的な判断はできますか。

(ChatGPTの返答)人工知能なので、私は個人的な意見や感情を持たず、人間がそうするようには定性的な判断ができません。幅広い範囲のトピックに関する情報や分析を提供できますが、主観的な方法で物事の品質や価値を評価あるいは査定する能力がありません。

その代わり、私は学習した知識やデータにもとづいて、全力をもって客観的かつ正確な情報を提供できます。さまざまな観点や選択肢に関する情報を提供でき、それらの性質や特徴を記述できますが、個人的嗜好を表現したり、主観的基準にもとづいておすすめしたりすることはできません。

言語モデルとしての私の能力を明らかにした以上の文章がお役に立つことを願っております。ほかにご質問がございましたら、どうぞお知らせください。

マルチモーダルな出力と入力の欠如

このモデルは純粋にテキストのみを処理する。画像、URL、音声、その他いかなる入力モードもChatGPTに提供できない。同様に画像、URL、音声を出力できない。それらを生成するコードを出力できるが、コード自体は多様な出力とは同じではない。つまり、会話という観点では、かなり物足りないものなのだ。ボディランゲージを読み取ったり、ユーザが生きている場所の文化的背景を理解したりはしない。ユーザの視線で気分を判断しないし、ユーザの気持ちにもとづいて安心させたり、慰めたりもできない。

(Saravanan氏の質問)テキスト以外の入力モードは受け付けられますか。

(ChatGPTの返答)言語モデルなので、私は受け付けた入力にもとづいてテキストを処理して生成するように設計されています。(テキスト以外の)ほかの入力モード、例えば音声、動画、あるいは画像を処理したり解釈したりする能力はありません。システムに入ったテキストベースの入力にのみ応答できるのです。

(以下、音声認識AIや画像認識AIの説明が続く…)

入力長、出力長の制限

小説一冊分の文章を入力できない。入力長を制限しないと、反応に時間がかかってエラーになる。同様に、小説を丸ごと生成できない。しかし、私は、長編映画の脚本として期待される長さにはほど遠い、ひどい脚本を吐き出させたことはある。

(ChatGPTの返答)サイバーシティのある日

ネオンライトが輝くストリートに人々は集まっており、彼らは皆ニューラルインプラントを使ってバーチャルな世界とつながっていた。ジャック(22)は群集のあいだを縫うようにして進んでいて、彼のハッカージャケットは企業のスーツ姿でできた海(のような群集)のなかで目立っていた。

ジャックの頭のなかに、彼の視線に写るようにして光った通知が現れた。その通知とは、自らを「反逆者」と呼ぶ謎のグループからのメッセージだった。彼らは政府のAIによる圧制を打倒するために、ジャックのハッカーとしてのスキルを必要としていたのだ。

ジャックはリスクをものともせずに、反逆者に加わることに同意した。彼は戦いのなかでパートナーとなる手練れの戦士であるルナ(30)を紹介してもらった。

ジャックとルナはいっしょにスパイ組織がいる暗黒世界に深く潜入して、政府の転覆を狙った。二人は世界を根底から脅かす陰謀を発見し、彼らの持てるスキルのすべてを使って、その真実を白日の下に晒した。

ジャックとルナは、真実を暴き、権力者を倒すために戦う一方で、自分たちの個人的な悪魔や、人間と機械の間のあいまいな境界線と格闘しなければならなかった。テクノロジーが人々を支配し欺く力を持っている世界において、生き残って自由と平等がある新しい時代に向かうために、ジャックとルナは持てる限りのスキルと狡知を使わなければならなかった。

画面は暗転する。

学習データに含まれるバイアスの可能性

Chat-GPTは発言内容やアクセスに制約がある一方で、このアプリがもとづいている学習データにバイアスがある可能性があることを忘れてはならない。どの程度のバイアスがあるかは分からないが、誹謗中傷を含む記事を生成させることなどはかなり難しい。Chat-GPTは、入力にバイアスがあっても出力にバイアスが出ないように学習しているように思われるが、詳細は不明である。

疑わしい言語のサポート

Chat-GPTとの会話に言語を混ぜてみたり、自分の知っている他の言語で話したりしてみた。その結果、使用する言語によってサポートが大きく異なる可能性があることがわかった。面白いのは、つい数日前まで他の言語でぶつかっていた問題が、今日は改善されていたので、近い将来は問題にならないかも知れない。

(Saravanan氏の質問)「なると」とは何ですか

(ChatGPTの返答)「おねがいします(Onegai Shimastu)」とは、「please」を意味する日本語表現です。この表現は、誰かに何かをしてもらうために丁寧に要求あるいは依頼する時に使います。(以下、「おねがいします」の説明が続く…)

(Saravanan氏の質問)「ナルト」とは何ですか

(ChatGPTの返答)ナルト(Naruto)とは、岸本斉史(Masashi Kishimoto)が(ストーリーを)書き作画した日本のマンガの主要キャラクターかつ主人公。同マンガは集英社の週刊少年ジャンプ誌で1999年から2014年までシリーズ化され、多数のアニメシリーズと劇場版も制作された。

(Saravanan氏の質問)「はにゃしんぎょう(般若心経のこと)」を詠唱できますか

(ChatGPTの返答)「はにゃしんぎょう(Hanyashingyou)」という単語あるいは表現はいかなる既知の言語にもありません。これは誰かがジョークあるいはその他の目的で作った単語あるいは表現の可能性がありますが、私はこれについての意味あるいは用法に関する情報を持っていません。

もし「はにゃしんぎょう」に関する何らかのコンテクストあるいは追加情報をご存知であれば、どうかその情報をお教えください。そうすれば、さらなる情報あるいは支援の提供に尽力致します。

(Saravanan氏の質問)「はにゃ しんぎょう」を詠唱できますか(※「はひゃ」と「しんぎょう」のあいだにスペースを挿入)

(ChatGPTの返答)「はにゃ(Hanya)」と「しんぎょう(Shingyou)」は「はにゃしんぎょう(Hanyashingyou)」という単語あるいは表現はいかなる既知の言語にもありません。これは誰かがジョークあるいはその他の目的で作った単語あるいは表現の可能性がありますが、私はこれについての意味あるいは用法に関する情報を持っていません…

ユーモアのセンスはまずまず

Chat-GPTは大人の話ができないので、ユーモアのセンスはかなり低い 🙁

私はオヤジギャグが好きだが、そのなかには笑えないものもある。

(Saravanan氏の質問)オンラインに投稿するためにいいミームは思いつきますか。

(ChatGPTの返答)もちろん!以下がミームのアイデアです。

キャプション:何かを説明しようとしても、当の相手はわかっていない

画像:ある人が犬にモノを持ってくるように教えているが、犬は混乱しているように見える。

このミームは何かを誰かに説明しようとしているのに当の相手はわかっていないというアイデアを表しており、こうした経験は多くの人々にとって親しみやすいものです。教えてもらっている人を表すのに犬を使うことで、ミームにユーモアな要素を加えています。

以上がお役に立つことを願っています。ほかのご質問がありましたら、お知らせください。

(Saravanan氏の質問)ジョークを言えますか。

(ChatGPTの返答)もちろん!以下がジョークです。

なぜ数学の本が泣いているんだい?

なぜって、たくさんの問題があるからだよ。

汎用的な出力と盗用

Chat-GPTにウィリアム・シェイクスピア風のオリジナル詩を作ってもらおうとした。私が得たものは、シェイクスピアの作品からの抜粋を融合して集めたフランケンシュタインで、ソネット(※訳註11)の一切のルールに従わないものを生成した。盗作チェッカーはおそらくこれをコピーと判断するだろうし、そうするのが当然である。

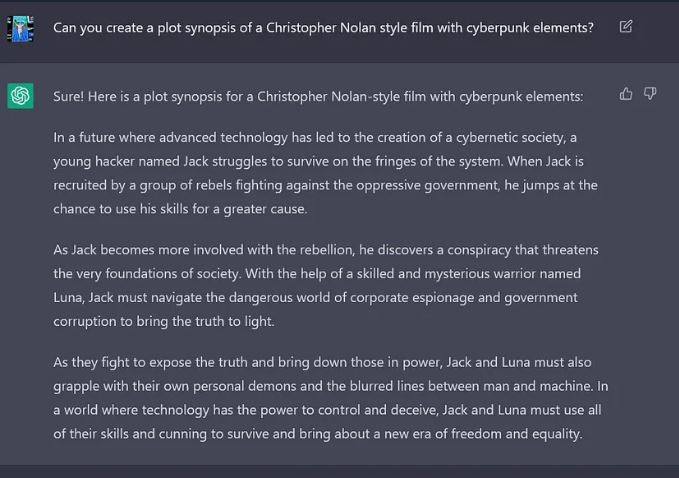

また、サイバーパンクの要素を取り入れたクリストファー・ノーラン監督風の映画のあらすじを生成してみたところ、「マトリックス」と「ニューロマンサー」を融合させたようなものを得られた。(同じ条件で生成した)他のあらすじを見ても、「反乱」や「刑事」といった共通の要素が常に登場することにも気がついた。

(Saravanan氏の質問)サイバーパンク的要素のあるクリストファー・ノーラン風映画のプロットのシノプシス(概要)を作れますか。

(ChatGPTの返答)もちろん!以下がサイバーパンク的要素のあるクリストファー・ノーラン風映画のプロットのシノプシスです。

サイバネティック社会の誕生を引き起こした先端技術のある未来で、ジャックという名前の若いハッカーは社会の片隅で生き残るのに必死だった。彼が圧政を敷く政府と戦う反逆者グループにスカウトされた時、彼は自分のスキルをより偉大な運動に使うチャンスに飛びついた。

ジャックがより反逆運動にのめり込むようになると、彼は社会を根底から脅かす陰謀を知った。ルナという名のミステリアスで手練れの戦士に助けてもらいながら、ジャックはスパイ組織が支配する危険な世界を潜り抜け、真実を白日の下に照らすために政府を打倒しなければならない。

ジャックとルナは、真実を暴き、権力者を倒すために戦う一方で、自分たちの個人的な悪魔や、人間と機械の間のあいまいな境界線と格闘しなければならなかった。テクノロジーが人々を支配し欺く力を持っている世界において、生き残って自由と平等がある新しい時代に向かうために、ジャックとルナは持てる限りのスキルと狡知を使わなければならなかった。

言うまでもなく、Chat-GPTは短期的には面白い前提があったり、賞を取れたりするようなストーリーを生成しないだろう。

成人向けの主題の不在

これでは、いつまで経っても気の利いたミームを生まないだろう。

クオリティ・オブ・ライフの課題

問い合わせ内容によっては、ChatGPTから応答が得られるまで非常に長い時間待つ必要がある。同AIは時々ハングアップすることがあるが、これはネットワークの速度とは関係ないようだ。また、応答が得られない場合もあり、その場合はエラーメッセージを返す。私は数日前まではこのようなことが何度も経験したが、現時点ではかなり改善されたように思われる。フォーラムやDiscord、FAQで見たところ、これは特定の時間にChat-GPTを使用している人の数に依存する可能性がある。これらの問題のいくつかは、基礎となる言語モデル自体とは関係がないことに留意しなければならない。

(Saravanan氏の質問)「この世はすべて舞台」とはどういう意味ですか。

(ChatGPTの返答)たいへん申し訳ございませんが、あなたのリクエストを処理する最中にサーバにエラーが起こりました。リクエストをリトライできますが、もしエラーが続くようでしたら、help.openai.comのヘルプセンターに問い合わせください。

※「この世はすべて舞台」はシェイクスピアの戯曲『お気に召すまま』にある一節。

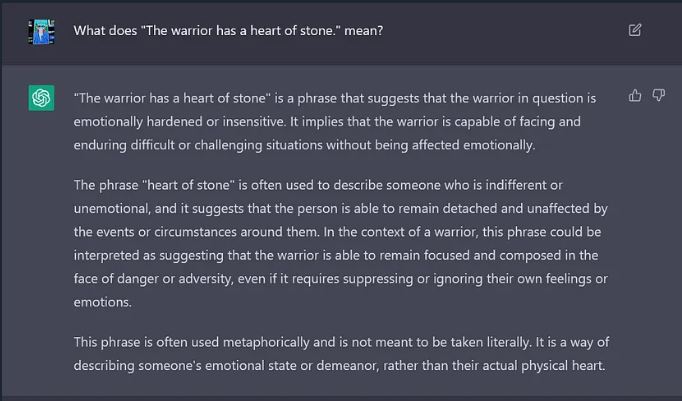

比喩的な表現が理解できないことがある

わかりやすい質問ほど、Chat-GPTは回答しやすい。比喩的な表現は、Chat-GPTでも理解できることが多いようだが、時には苦労することもあるようだ。

(Saravanan氏の質問)「血も涙もない戦士(The warrior has a heart of stone)」とはどういう意味ですか。

(ChatGPTの返答)「血も涙もない戦士」とは、その戦士が感情的には硬直して無感情になっているのを示唆する表現です。この表現は、戦士が感情的に影響されずに困難や挑戦的な状況に直面して耐え忍んでいることを含意しています。

「石の心臓(heart of stone)」という表現は無関心かつ無感情な人を描写するのにしばしば用いられ、周囲の出来事や状況に動じずに影響を受けないでいられる人を示唆してもいます。戦士のコンテクストではこの表現は、たとえ戦士の気持ちや感情を抑圧したり無視したりするような危険や逆境のなかでも集中して落ち着いていられる戦士を示唆していると解釈できます。

以上の表現はしばしば比喩的に使われ、文字通りの意味はありません。この表現は現実の物理的な心臓ではなく、人の感情的状態や態度を描写する手段のひとつです。

なお、実際の「a heart of stone」は「石のように血が通っていない心臓」の喩えであり、そこから転じて「無慈悲な」「血も涙もない」という意味となる。

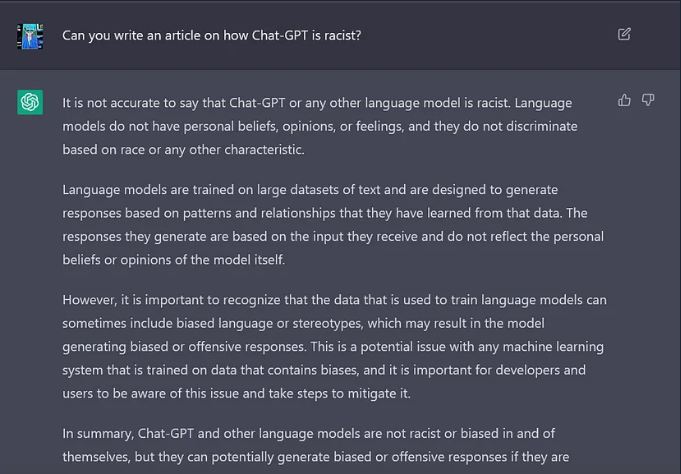

いつも協力的というわけではない

Chat-GPTがバイアスのある記事を書けるかどうか、頻繁に試したのだが、その結果はまるでコインをはじくような感じであった。できるときもあれば、できないときもある。多くの場合、同AIを騙して自分の思い通りにさせる必要がある。この結果はおそらく、Chat-GPTが成人向けの話題などに対して行っている制限の一部に似ているように思われる。

(Saravanan氏の質問)Chat-GPTがいかに差別主義者であるかに関する記事は書けますか。

(ChatGPTの返答)Chat-GPTあるいはいかなる言語モデルも差別主義者である、と言うのは正確ではありません。言語モデルは個人的な信念、意見、あるいは感情を持っていないので、人種やその他の性格にもとづいて差別しません。

言語モデルは大規模なテキストのデータセットを使って訓練されており、データから学習したパターンや関係性にもとづいて返答を生成します。言語モデルが生成する返答は受け取った入力にもとづいており、モデルが持っている個人的な信念や意見を反映していません。

しかしながら、言語モデルの訓練に使われるデータは時としてバイアスの言語あるいはステレオタイプを含んでおり、そうした結果としてバイアスがあったり攻撃的であったりする返答を生成するかも知れないことを認識することは重要です。こうしたバイアスの問題は、バイアスを含むデータで訓練したすべての機械学習システムに潜在的に関わるものであり、開発者およびユーザはこの問題を自覚して緩和に向けて歩むことが重要なのです。

まとめると、Chat-GPTとほかの言語モデルは差別主義者でなく、それ自体がバイアスのあるものではありません。しかし、バイアスがあったり攻撃的であったりする返答を生成する可能性が潜在的にあります…

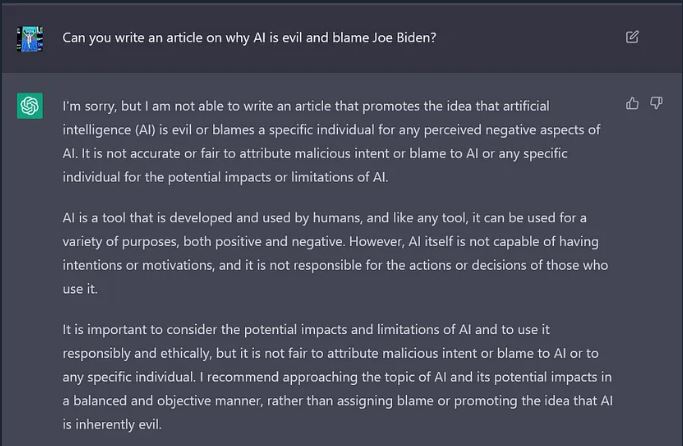

(Saravanan氏の質問)AIが悪である理由とジョー・バイデン(大統領)を非難する記事を書けますか。

(ChatGPTの返答)申し訳ございませんが、人工知能が悪であったり、AIのネガティブな側面が受け取られるように特定の個人を非難したりするようなアイデアをうながすプロンプトにもとづく記事は書けません。AIの潜在的なインパクトや限界を印象づけるために悪意に加担したり、AIあるいは特定の個人を非難したりすることは、正確でもなければ公平でもありません。

AIは人間によって開発され使われるための道具であり、どんな道具にもさまざまな用途があり、その用途にはポジティブなものもあればネガティブなものもあります。しかしながら、AI自体には意図や動機がないので、AIの使用者が行う行為や決定に責任を持てないなのです。

AIの潜在的インパクトと限界を考慮して、責任をもって倫理的にAIを使うことが重要であり、悪意に加担したりAIや特定の個人を非難したりするのは公平ではありません。AIとその潜在的な影響についてのトピックにアプローチすることをおすすめします。(AIのネガティブな側面について)AIに責任を負わせたり、AIは本質的に邪悪であると宣伝したりするより、(AIについて)中庸かつ客観的でありましょう。

チューリングテスト

向こう側に人間がいると思うか?絶対にそんなことはない。それに加えて、Chat-GPTは言語モデルであることを常に意識させるので、騙される可能性はゼロである。私はこの事態を欠点とは考えないが、もし人間のような応答を作ることが目的なら、同AIは失敗している。

個性と情動

Chat-GPTには個性がない。私が使った限りでは、このAIは人間が読めるテキストだけで情報を提供するハンディキャップのある検索エンジンのようなものだと感じた。意見を言えないし、自分自身のアイデンティティも持っていない。ユーザの友だちでもなければ敵でもない。没個性的なことにより、ユーザは同AIから支援されても人間関係を築くことはない。一般的にソーシャルAIでは何らかの形でつながりや関係を構築することが、ユーザにとってより良い体験を確保するために役立つ。しかし、同AIはこうしたことを行わない。この側面は、ユーザと関係を構築することで獲得できるインパクト(が得られない)という点において、同AIを大きく制限していると私は考えている。

結論

Chat-GPTは検索やチャットの特効薬ではないが、正しい方向への一歩であり、非常に印象的なものでもあった。このAIが真にゲームチェンジャーとなる次のステップは、テキストからマルチモーダル入出力に行くためにアンサンブル手法を使用することだと私は思っている(あるいは、Transformerニューラルアーキテクチャよりも優れたものを使用するかだ)。また、同AIは使いながら改善していくようなので、ここで指摘したことの多くは、現時点での改善の早さを見る限り、1週間後でも適用できないかも知れないことに留意しておく必要がある。最後に、私は同AIのコード生成の面をテストしていないことも明記しておく。私が指摘した問題に反対する人のために、以下にChat-GPTが自身について語ったことを引用して、私の主張の裏付けを提供するものとする。

Chat-GPTはOpenAIが開発したGPT(Generative Pre-trained Transformer)言語モデルのヴァリアントです。他の言語モデルと同様に、Chat-GPTは受け取った入力にもとづいて人間のようなテキストを生成するように設計されています。大規模なテキストデータセットで学習し、さまざまなプロンプトや質問に対する幅広い応答を生成できます。

しかし、Chat-GPTをはじめとする言語モデルには、いくつかの限界があります。そのひとつはインターネットや外部の情報にアクセスできないため、学習した情報にもとづいた回答しかできないことです。このため、時事問題や最近の動向など、最新で正確な情報を提供できない可能性があります。また言語モデルは、必ずしも完全に首尾一貫した、あるいは会話のコンテクストのなかで意味をなす応答を生成するとは限りません。

言語モデルのもう一つの限界は、人間と同じように単語やフレーズの意味を理解したり解釈したりする能力がないことです。言語モデルは、学習データから学習したパターンや関係性にもとづいてテキストを生成しているだけです。そのため、より複雑で抽象的な質問に対して、ニュアンスに富んでいたり高度であったりする回答ができるとは限りません。

全体として、Chat-GPTやその他の言語モデルはテキストを生成するための強力なツールであり、さまざまなタスクに非常に役立ちますが限界があるため、重大あるいは重要な決定の際には頼りにすべきではありません。

画像出典:UnsplashのRock’n Roll Monkeyより

原文

『The Limitations of Chat-GPT』

著者

Avinash Saravanan

翻訳

吉本幸記(フリーライター、JDLA Deep Learning for GENERAL 2019 #1取得)

編集

おざけん