こんにちは、AINOWライターのゆーどーです。

AIの進化により、私たちの生活が豊かになると共に、AIをターゲットにしたサイバー攻撃が増加しています。もし、AIをターゲットにしたサイバー攻撃が成功してしまえば、自動運転車を自由に操作したり、AIの判断基準を変更するなど、社会に膨大な被害をもたらしてしまう可能性があります。AIが操作するロボットのセキュリティに脆弱性があれば、SFの世界のようにロボットを使った悪事を働くことも可能です。

そのようなサイバー攻撃からAIを守るため、AIのセキュリティを強化する重要性が高まっており、現在も取り組んでいます。

今回は、世界最高レベルのAIのセキュリティ技術を開発・提供するChillStackの代表取締役である伊東氏に、AIのセキュリティについてインタビューしました。

▼AIに詳しく知りたい方はこちら

| 【この記事でわかること】※クリックすると見出しにジャンプします |

目次

プロフィール

伊東道明(いとう みちあき)

1995年生まれ。法政大学大学院理工学研究科修士課程修了。AIセキュリティに関する研究に従事し、IEEE CSPA 2018 Best Paper Award受賞やセキュリティキャンプアワード2018最優秀賞を受賞。セキュリティやインフラの大会である「SECCON」、「ICTトラブルシューティングコンテスト」など様々な大会を運営。公益財団法人クマ財団第2期生に選抜。在学中にChillStackを創業し、AIを用いてセキュリティ人材の不足や対策の高コスト化、AIを標的とする新しいサイバー攻撃など既存のセキュリティにおける社会課題に取り組んでいる。

AIセキュリティの課題

冒頭でも説明した通り、AIが普及し進化していくと同時に、AIを守るためのセキュリティとAIを活用したセキュリティを強化する重要性が高まっています。

一方、AIセキュリティには多くの課題があることも事実です。

AIにとって欠かせないコンピュータシステムや、インターネットをサイバー攻撃やマルウェアから守る「IT」面でのセキュリティ対策を充実したものにしなければならない点が1つとしてあげられます。

また、AIが普及すると同時にハッカーがAI技術を悪用する可能性も出てきました。

AIを悪用したサイバー攻撃は非常に大きな脅威になり得るため、その脅威に対抗するAI技術を利用したセキュリティをどのようにして設計・構築するかという点も課題点です。

高まるサイバーセキュリティの需要

サイバー攻撃のパターンが複雑化しています。

ITの歴史においては、過去、いくつものセキュリティ問題が発生してきました。

企業の情報が流出するだけではありません。2018年には、国内で巨額の仮想通貨が流出する事件が起こりました。

過去の問題を踏まえて、サイバーセキュリティに力を入れる企業も増えています。

▼社会で活用されるAIについてまとめた記事はこちら

▶︎社会の安全はAIで守る!AIセキュリティまとめ>>

IDC(International Data Corporation Japan)が発表したレポートによると、2019年では、世界中のサイバーセキュリティへの支出が1,000億ドルを超えているといいます。より多くの企業がセキュリティーの分野に興味を示し、安心安全なシステム構築に意欲を示していることがわかります。

AIで守り、AIを守るChillStack

セキュリティの重要性が高まる今、ChillStackはAIを活用し、セキュリティの信頼度をさらに挙げるサービスを運営しています。また、AI自身も守るセキュリティシステムを作り、社会に貢献すべく技術開発を進めています。

ーーどのようなサービスを提供されていますか?

伊東氏

ーーセキュリティソフトというと、一見、AI(機械学習)と関連があるように思えません。今、セキュリティ分野ではAIがどのように活躍しているのですか?

伊東氏

古典的な例だとスパムメールフィルタが昔から自然言語処理(テキスト処理)の技術を用いています。最近だとマルウェアの検知やサイバー攻撃の通信検知など、さまざまな既存のセキュリティシステムに取り入れられています。

ですが、基本的にAIは100%正しい結果を導くという保障はありません。そのため、AIのみを使って安全な空間を提供するのではなく、主に既存のセキュリティシステムにAIを上乗せして強化をするという活用方法が取られています。

ーーChillStackのサービスは従来のセキュリティシステムに比べてどの点が優れているのですか?

伊東氏

ここでは、事前に定めた攻撃パターンをすり抜ける新規の攻撃や、既存の攻撃を少し改変した亜種攻撃は従来のシステムでは防げません。

そこでAIを導入すると、単純なパターンマッチングとは別の指標による攻撃検知を行うため、従来のシステムと重ねて使うことで新規の攻撃や亜種攻撃を防げる可能性が各段に向上します。

ーーまた、ChillStackは、不正なオンラインユーザを検知するシステムも提供しています。「不正ユーザ」検知システムについて教えてください。

伊東氏

一言に不正ユーザといってもさまざまなパターンがあります。

例えば

- 暴言を吐きまわるユーザ

- 開発者の意図しない行動で他ユーザを妨害するユーザ

- 転売の自動化などを行うユーザ

があります。

これらのユーザはルールベースでの発見が非常に困難で、今までは簡易的なルールベースでのパターンマッチングと組み合わせて人力で監視している例が多いです。

ChillStackが提供するサービス”Stena“は、自然言語処理技術や異常検知技術を組み合わせ、世界トップレベルの不正検知精度を誇るAIをサービス毎にチューニングしています。

そうすることによって従来の人力監視をある程度、自動化することができます。さらに従来のパターンマッチングや人力監視では見落としてしまう不正ユーザを検知することが可能になります。

ーーAIはどのように不正ユーザと判定しているのですか?

伊東氏

また、1つの行動だけを見るのではなく、特定の時間内における一連の行動を時系列データとして扱うことにより、Stenaを騙して不正をすることが非常に難しくなっています。

例えば、「この行動だけしなければ引っかからなくなるでしょ?」と考える不正ユーザや「明らかに不正な行動はしていないがずっと繰り返し同じ行動を自動化している」BOTユーザなどを検知することが可能です。

AIが危機に晒されている?

サイバー攻撃からAIを守る

ChillStackはAIを活用してセキュリティソフトの精度を高めるだけでなく、AIのサイバー攻撃から守る技術開発も行っています。

ーーなぜ今、AIを守る必要があるのでしょうか?

伊東氏

空港では顔認証により入出国がスムーズになり、スピーカーに話しかけるだけで電気やテレビを操作できます。また、自分に相性のいい商品や映画や音楽が自動でピックアップされます。

さらに、泥棒はカメラで自動で発見され、車に目的地を入力すると全自動で連れて行ってくれるようになります。

そんなAI社会ができつつある中、AI自体が簡単にハッキングされたらどれほどの被害が出るか容易に想像ができます。

IoTがそうだったように、新しい技術は普及すると必ずサイバー攻撃の対象になります。AIも例外ではありません。

AIが被害にあった具体例 −AIに誤認識させることも可能?

ーー具体的にAIが被害にあった例はありますか?

伊東氏

他にも、自動運転技術のひとつで車線認識機能を提供しているTesla Autopilotに対して、道路にステッカーを貼ったりドローンで映像を投影することで意図的に車線を変更できる脆弱性が報告されています。

また、AIを扱う企業は非常にセンシティブなデータを保有していることが多く、攻撃対象になりやすいです。例えば、顔認識を開発する Clearview AI が不正アクセスを受けて情報流出被害がでています。

▼参考記事はこちら

▶︎数理モデルAI をセキュリティに導入。正確性、予測検知、超軽量を実現>>

▶︎機械学習アルゴリズムに脆弱性(JVN)>>

▶︎顔認識企業Clearview AIに不正アクセス–全顧客リストが盗まれる>>

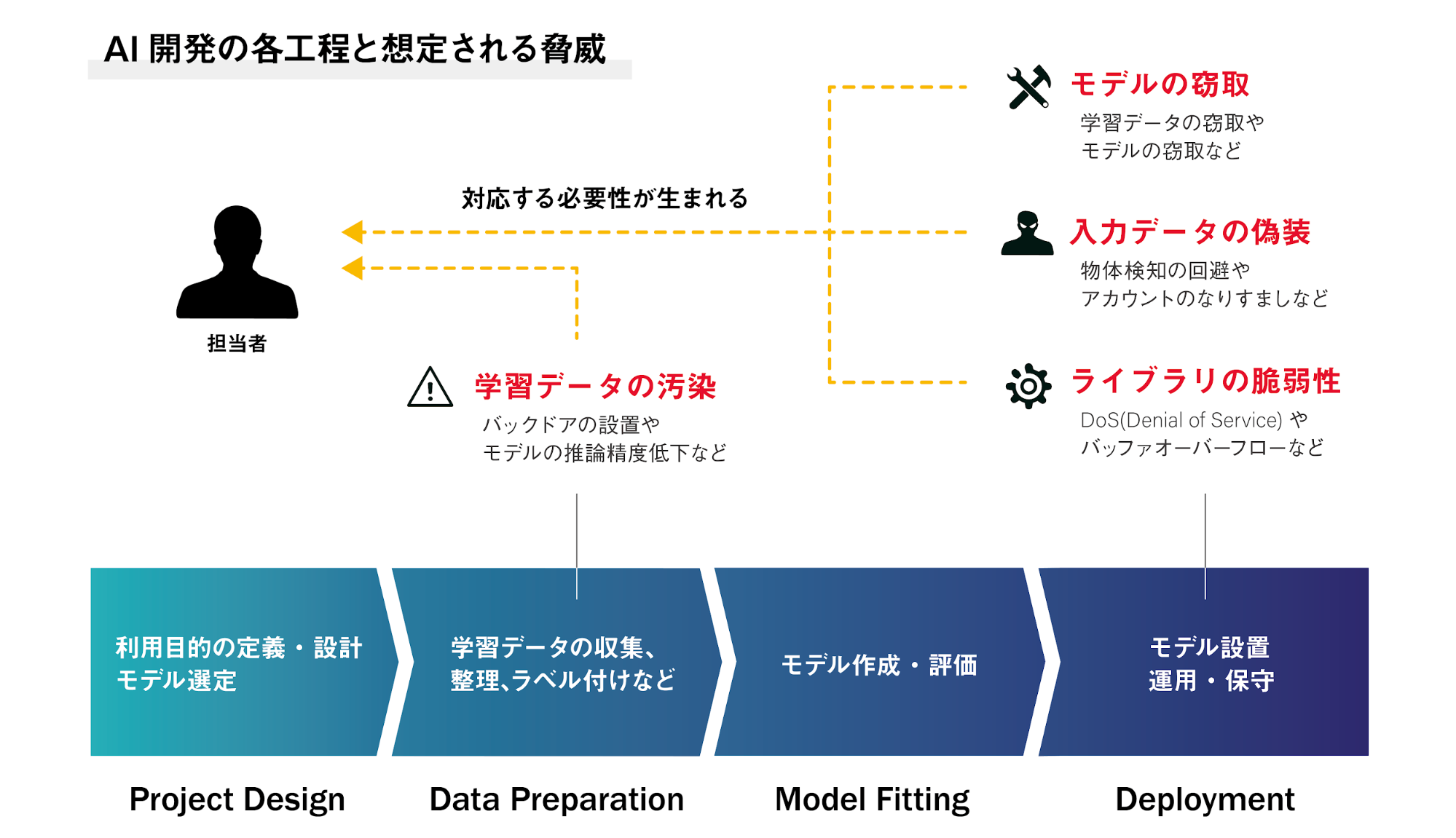

ーー例えば、AIを作る上でどのフェーズで脅威があるのでしょうか?

伊東氏

- Project Design(企画)

- Data Preparation(データの準備)

- Model Fitting(モデルの作成)

- Deployment(実装)

例えば、Data Preparationフェーズではネット上にあるデータを収集する際に悪意のあるデータを合わせて収集してしまい、脆弱性を作りこんでしまう危険性があります。

Deploymentフェーズでは実行環境の不備による任意コード実行(RCE)であったり、入力データの偽装による誤認識の誘発が行われる危険性があります。

ーーその上で、AIを守るためにはどのような心がけが必要なのでしょうか?

伊東氏

現状AIの脆弱性がまとまっている資料がありませんでしたが、ChillStackがガイドラインを作成しています。

ChillStackがAIを守る

ーー実際にどのようなAIを守るセキュリティシステムを開発されているのですか?

伊東氏

また、開発したAIが安全かどうかを検査するシステムを開発中です。

ーーChillStackの三井物産セキュアディレクションとの提携によって、今度はどのようなことに注力していくのでしょうか?

伊東氏

▼参考記事はこちら

▶︎ChillStackと三井物産セキュアディレクション、AIを守る技術に関する共同研究を開始>>

まとめ

近年、私たちの暮らしや仕事は、AIと密接に関わる機会が増えています。AIの開発により、生活や仕事の質は向上しているのではないでしょうか。

しかし、不正アクセスやサイバー攻撃により、数億円もの被害額が発生していることも事実です。

私たちはAIサービスが展開されることで、より活用しやすいAIや学習効率が高いAIを求めるようになるでしょう。

その時は、AIを安心して使うために開発者はもちろん、それを活用する私たちもセキュリティの面にも目を当てる必要があるのかもしれません。

今後、ChillStackにより、全8回にわたりAIセキュリティのガイドラインを掲載していく予定です。AINOW編集部でも随時紹介するので、お楽しみに!

駒澤大学仏教学部に所属。YouTubeとK-POPにハマっています。

AIがこれから宗教とどのように関わり、仏教徒の生活に影響するのかについて興味があります。

世界最高レベルのAIセキュリティ技術を保有する企業として、既存のサイバーセキュリティ技術をAIで進化させます。さらに、AI自身を含めた新しい技術を守り、社会の発展を加速させるため、実現できるように貢献します。