生成AIの安全対策をどこまでやれば十分なのか、見えなくて困っている企業の担当者の方は多いのではないでしょうか。

この記事では、公的ガイドに基づく社内安全対策10選と、すぐに使える雛形・チェックリスト・インシデント対応手順をまとめて解説します。

目次

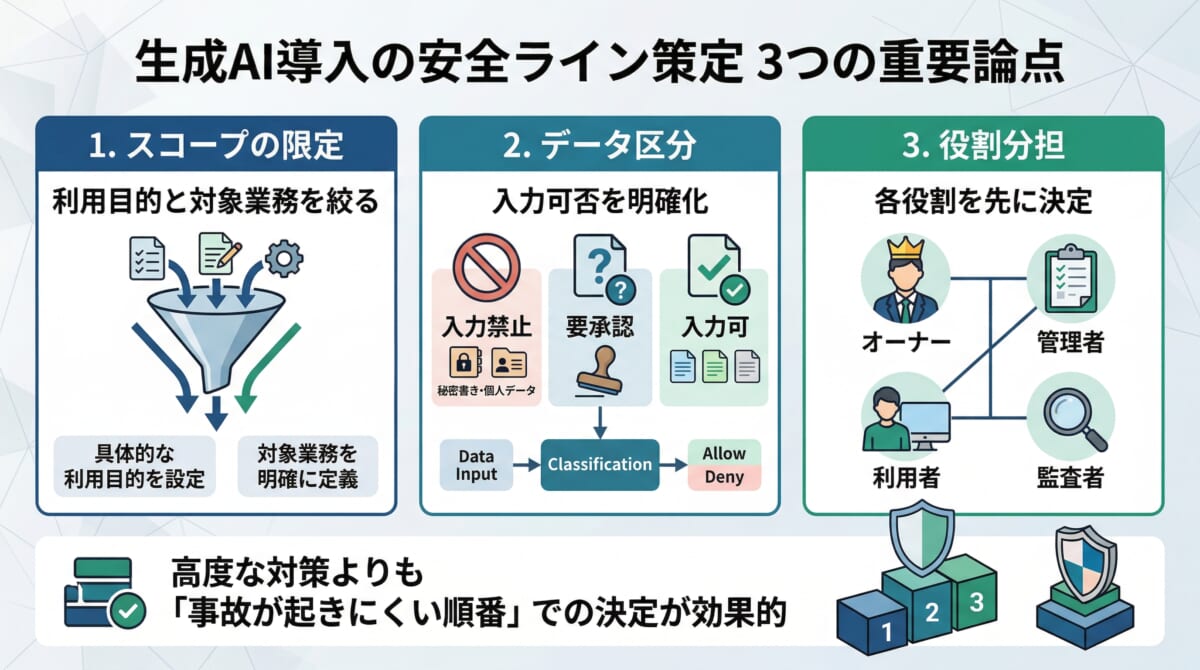

生成AI導入の安全ラインを決めるために抑えるべきこと

安全ラインを最短で引くために押さえる論点は以下の3つです。

- 利用目的と対象業務のスコープを狭く定義する

- 扱うデータ区分を入力禁止・要承認・入力可で決める

- オーナー・管理・利用者・監査の役割分担を先に置く

高度な対策を積むより、事故が起きにくい順番で決めるほうが効きます。

利用目的と対象業務のスコープを狭く定義する

最初に「生成AIに何をさせるのか」を絞ります。文章の言い換え、公開情報の要約、社内向けたたき台作成など、機密や個人情報を入れなくても成果が出る用途から始めると事故が減ります。

スコープが広いと現場の運用がぶれるため、最初は対象業務を明確に列挙しておきます。

同時に「生成AIは誤るもの」として扱う前提を明文化します。重要な意思決定や対外文書、契約、法務判断、医療・金融など高リスク領域では、最終判断は必ず人が行い、レビューを通らない生成物は外部に出さない運用にします。

スコープと前提を狭く定義しておけば、後の技術設定や監査の論点を絞り込めます。

扱うデータ区分を入力禁止・要承認・入力可で決める

安全ラインの芯になるのはデータ区分の定義です。現場が迷わないよう、入力禁止・要承認・入力可を定義し、具体例を添えます。

区分がぼやけるとルールが守られないだけでなく、DLPやマスキングなどの技術対策も設計できません。

事故が起きやすいのは、個人情報・顧客情報・取引先の秘密・未公開の財務や技術情報・認証情報(ID、パスワード、APIキー、秘密鍵)を、チャット画面にそのまま貼り付けてしまう場面です。

区分が明確で、入力前に止める仕組みと報告の導線があれば、重大事故の多くは未然に防げます。

オーナー・管理・利用者・監査の役割分担を先に置く

責任の切り分けがないと、導入は進まず事故の止血も遅れます。最低限4者の役割を先に置きます。

利用部門の責任者が目的と対象業務を定義し、情シスやセキュリティが設定とログ・例外運用を握り、社員はルールを守って異常を報告し、内部監査や法務・個人情報担当が定期点検を行う形です。

4者が揃うと、ルールを決め、教育で浸透させ、技術でうっかりを止め、監査で形骸化を潰す流れが回り始めます。

シャドーAI(野良利用)を公式へ寄せる議論も、この役割分担があるとスムーズに進みます。

生成AIの公的ガイドと国際標準で押さえるべきこと

社内合意を取りにいくとき、担当者の経験則だけでは弱くなりがちです。公的ガイドや標準に照らして妥当だと言える根拠があると、説明が通りやすくなります。

生成AIの安全対策はセキュリティ・個人情報・法務・品質・サプライチェーンが交差するため、根拠が薄いと合意形成の段階で止まります。

デジタル庁のガイドは、生成AIの利活用に伴うリスクと対策を利用形態や工程の観点で整理し、組織としての進め方を示しています。リスクの棚卸し軸として使うと、スコープ定義・データ区分・委託先管理・運用体制・教育・インシデント対応までを一気通貫で説明できます。

国際的にはNIST AI RMF 1.0がAIリスク管理をGovern・Map・Measure・Manageの機能で整理しており、社内統制と日々の運用を結びつけて説明しやすい枠組みです。ISO/IEC 23894はAIリスク管理の実務ガイダンス、ISO/IEC 42001はAIマネジメントシステムとして、監査や認証を視野に入れた整理に使えます。

攻撃や脆弱性の観点では、OWASP Top 10 for Large Language Model Applicationsがプロンプトインジェクション・機密情報漏えい・サプライチェーンなどLLM特有のリスクを体系立てています。テスト項目や教育項目の土台に据えると組み立てが速くなります。

公的ガイドに基づく生成AIの社内安全対策10選

監査や取引先説明で「最低限ここはやっている」と言える状態を作るための10項目は以下のとおりです。

- 生成AIの利用ルールを短文で固定する

- DLPとマスキングで機密情報・個人情報の入力を抑止する

- SSOとMFAで認証とアクセス制御を企業アカウントに集約する

- ログは監査証跡とプライバシーの釣り合いで残す

- 生成物の外部送信と二次利用を統制する

- ハルシネーション対策を出力形式に組み込む

- プロンプトインジェクション対策を前提に設計する

- RAGでは検索権限・索引・キャッシュ・削除を一体で設計する

- ベンダー・契約管理で学習利用や保存条件を固定する

- インシデント対応は連絡網ではなく初動手順に落とす

ルールと教育で入口を作り、技術で事故を減らし、監査で続ける順で積むのが現実的です。

1. 生成AIの利用ルールを短文で固定する

ルールは長いほど読まれません。入力禁止データ・利用可能なツール・レビュー必須の成果物・違反時の報告を短い文で固定します。

禁止だけだと現場は止まりにくいので、条件付きで使える範囲も書いておきます。

承認が必要なケースは具体例で示し、判断に迷う場面を最小化します。1ページに収まる分量を目安にすると、現場が常に手元で確認できる状態になります。

短文で固定したルールは、教育や監査の基準としても再利用でき、運用全体の一貫性を保てます。

2. DLPとマスキングで機密情報・個人情報の入力を抑止する

ポリシー掲示や研修だけでは漏れるため、入力前に止める仕組みを組み合わせます。DLPによる検知・氏名や住所などの固有表現マスキング・社外AIサイトへの送信制御がセットになります。

技術的に止める層を持つことで、人の注意が薄れる週でも事故を未然に防げます。

設計で大事なのは、現場が「バレない工夫」に向かわないことです。検知したら即懲戒ではなく、原則は教育と是正につなげ、悪質・反復だけを規程に基づいて扱う形にすると報告が上がりやすくなります。

入口で止める仕組みがあれば、レビュアーや管理者の負担も減り、本来やるべき改善活動に時間を回せます。

3. SSOとMFAで認証とアクセス制御を企業アカウントに集約する

個人アカウント利用を減らす近道はSSOで公式ツールに入らせることです。あわせてMFAを必須化し、部署や職種で利用範囲を切って最小権限で始めます。

誰が使ったか追えない、退職者のアカウントが残る、個人設定で学習利用がオンになっていた、といった事故はSSOと管理者統制で減らせます。

新規ツールを増やす前に、まずSSO配下に集約する設計を徹底すると、後から監査するときの追跡可能性が大きく上がります。

認証を企業アカウントに寄せておけば、退職者対応や部署異動時の権限変更も自動化に乗せやすくなります。

4. ログは監査証跡とプライバシーの釣り合いで残す

最低限、誰がいつどのツールで、どのデータ区分に触れうる操作をしたかを追える状態にします。プロンプトや出力本文を丸ごと保存できなくても、メタデータを揃えるだけで初動調査は速くなります。

一方、ログは従業員モニタリングにつながり得ます。就業規則や社内規程で目的・取得範囲・閲覧権限・保存期間・目的外利用の禁止を明確にし、必要に応じて労務・法務と整合を取っておくと運用が続きます。

改ざん耐性を高めるためにWORMや権限分離を検討する場面もあります。ただし保存要件は業種や制度で変わるため、税務や金融など要件が厳しい領域では電子帳簿保存法など関連要件も参照します。

取得目的・範囲を社内に透明化しておくと、後から「監視されている」という不信が生まれにくくなり、運用の心理的安全性も保てます。

5. 生成物の外部送信と二次利用を統制する

生成物は便利ですが、著作権・ライセンス・秘密保持・誤情報のリスクも一緒に持ちます。対外提出物は出典確認と人のレビューを必須にします。

転載や引用のルール、顧客・取引先の固有情報が混ざっていないかの確認をプロセスに組み込みます。

運用では社内だけで使う下書きと社外に出る成果物を分け、後者だけレビュー強度を上げると、負担と安全性の釣り合いが取りやすくなります。

強度を業務単位で変える設計にしておけば、現場のスピードを落とさず、対外品質を担保できます。

6. ハルシネーション対策を出力形式に組み込む

ハルシネーションはゼロにできません。重要度でレビュー強度を変えつつ、根拠を併記させる運用を仕込みます。

社外説明資料や規程文案なら、根拠URLや社内規程番号を併記させ、根拠が出ない出力は採用しないルールにします。

RAGを使う場合は、回答に引用元の文書IDや該当箇所を必ず出すようにし、トレーサビリティをレビューの必須条件にすると品質が安定します。

出力形式に根拠提示を組み込んでおけば、レビュアーは差分だけを確認でき、レビュー時間を短縮できます。

7. プロンプトインジェクション対策を前提に設計する

プロンプトインジェクションは、外部文書やWebページ・メール本文などに混ぜ込まれた指示でモデルの挙動を変え、機密の抽出や不正操作の誘導を狙う攻撃です。OWASP Top 10 for LLM Applicationsでも主要リスクとして整理されています。

対策は入力検査だけに寄せないほうが安定します。モデルが参照できるデータ範囲を権限で分け、ツール実行(メール送信・ファイル削除・チケット起票など)の権限を別系統で管理します。

可能ならサンドボックスで外部入力を隔離し、システムプロンプトやポリシーを秘匿できる構成、外部入力をそのまま指示文として扱わないテンプレート化、出力の安全フィルタリングも併用します。

多層防御の設計にしておけば、攻撃手法が新しく出ても、どこかの層で止められる確率が上がります。

8. RAGでは検索権限・索引・キャッシュ・削除を一体で設計する

RAGは社内文書を探し当てて回答できる分、権限設計が甘いと横断漏えいが起きます。検索の権限と生成の権限を揃え、ベクトルDBや検索インデックスにもACLを適用します。

検索結果キャッシュや一時コンテキストの保持期間(TTL)と消去方針を明文化し、削除や改訂が起きたときに検索側へ確実に反映させる設計が必要です。

実装ではベクトル化した断片にdocument_id・chunk_id・作成時刻・アクセス属性・原文ハッシュなどのメタデータを持たせ、後から「どの原典に基づく回答か」を辿れるようにします。ハッシュを残しただけで法的な証拠性が自動的に担保されるわけではないため、証拠として扱うなら取得・保全・アクセス履歴の管理も含めて設計します。

削除対応はとくに抜けやすい部分です。原文削除・該当ベクトル削除・再インデックス・削除証跡ログまでを一連の手順として用意しておくと、個人情報や契約情報の削除要請にも耐えられます。

9. ベンダー・契約管理で学習利用や保存条件を固定する

生成AIの統制は技術だけでは閉じません。外部SaaSやAPIを使うとデータの扱いは契約や利用条件で決まるため、必ず文書で固定します。

最低限押さえたいのは、入力や出力がモデル学習に使われるか、保存期間、データ所在(リージョンや越境移転の有無)、再委託先(サブプロセッサ)、監査ログの提供範囲、障害時のSLA、価格改定や仕様変更の通知条項です。

越境データ移転が絡む場合はDPA(データ処理契約)や委託先管理の観点も含め、法務とセットで確認します。

ベンダーが「エンタープライズでは顧客データをモデル学習に使わない」と説明しても、公式文書へのリンクと契約書面での担保を両方で押さえるほうが安全です。OpenAI・Microsoft(Azure OpenAI)・Googleはそれぞれ公式情報を公開しており、契約交渉の根拠として使えます。

10. インシデント対応は連絡網ではなく初動手順に落とす

漏えい疑いが起きたときに必要なのは勢いではなく初動の型です。自己判断で放置や隠蔽が起きないよう、時系列で動ける形にしておきます。

利用停止・証拠保全・影響範囲の暫定把握・関係部門へのエスカレーション・ベンダー連絡・対外対応の判断までを、誰が何分以内に動くかまで決めておきます。

個人情報が関係する場合は、個人情報保護委員会(PPC)が案内する漏えい等の対応に沿って、報告や本人通知の要否を判断します。法令上の報告タイミングは「速やかに」と整理されるため、GDPRの「72時間」を国内要件として固定で書くのは避け、社内SLAとして「何時間以内に何をするか」を別途定めるほうが運用しやすくなります。

初動手順が文書化されていれば、夜間や休日に事故が発覚しても、迷わず動ける体制が整います。

生成AI導入時に使える安全対策の雛形

生成AI導入時に使える安全対策の雛形を以下の4つで用意しました。

- 生成AI利用ポリシーの雛形

- 利用申請・承認フロー雛形は最小で回る設計にする

- 監査ログ運用ルール雛形は取得項目と閲覧権限を定める

- インシデント初動テンプレは時系列で動かす

まず型を置き、ツール名・データ区分・責任分界・窓口は自社の呼称に差し替えてください。

生成AI利用ポリシーの雛形

社内規程のたたき台としてそのまま流用できる雛形を以下に示します。目的・適用範囲・禁止事項・条件付き利用・出力取扱い・ログと監査・違反時対応の構成です。

細部の文言は法務と相談して整えますが、骨格を先に決めておくと議論が前に進みます。

(目的)

当社は生産性向上のため生成AIを利用する。ただし機密保持、個人情報保護、品質確保を最優先とする。

(適用範囲)

本ポリシーは当社の役職員が業務で生成AI(外部SaaS・API・社内環境を含む)を利用する場合に適用する。

(利用可能な手段)

当社が指定する公式ツール(SSOで管理するアカウント)を利用する。個人アカウントによる業務利用は原則禁止とする。

(入力禁止)

個人情報、顧客情報、未公開の財務・技術情報、契約上第三者に開示できない情報、認証情報(ID/パスワード/APIキー/秘密鍵)を入力してはならない。

(条件付きで可)

社外秘相当の情報は、所属長承認およびマスキング等の措置を実施した場合に限り利用できる。例外の条件と期限は記録する。

(出力の取扱い)

生成物を対外提出する場合、出典確認および人によるレビューを必須とする。著作権・秘密保持に反する転載を行わない。

(ログと監査)

当社は不正利用防止とインシデント対応のため、利用状況のログを取得する。取得範囲、保存期間、閲覧権限、目的外利用の禁止は別途規程で定める。

(違反・事故時)

誤送信や機密入力の疑いがある場合、直ちに所定の窓口へ報告し、自己判断で隠蔽しない。骨格があれば、社内事情に応じた追記や調整を最小工数で進められます。

利用申請・承認フロー雛形は最小で回る設計にする

フローは複雑にすると形骸化します。最小で回る設計を最初から狙います。

申請者には用途・扱うデータ区分・外部送信の有無・成果物を外部利用するかを書かせます。承認側は低リスクは即日、高リスクは条件付き(マスキング必須・レビュー必須・対象者限定など)で判断できる形にします。

記録には申請ID・利用者・利用ツール・承認者・有効期限・例外条件・対象データ区分・ログ取得範囲を残します。

期限が来たら自動で棚卸しに回るようにしておくと、監査対応が急に来ても崩れにくくなります。

監査ログ運用ルール雛形は取得項目と閲覧権限を定める

ログは調査可能性とプライバシーの釣り合いが要です。最低限の取得項目と閲覧権限を雛形で固定しておきます。

取得項目は、利用者ID・日時・利用ツール・リクエスト種別(チャット・RAG検索・ファイル投入など)・データ区分・外部送信の有無・管理者操作履歴を揃えると、初動調査が成立しやすくなります。

閲覧権限はセキュリティ担当など必要最小限に絞り、目的外利用を禁じます。保存期間は監査周期とインシデント発覚までの現実を踏まえて決め、改ざん耐性の要件がある業種では要件に合わせます。

従業員には取得目的・範囲・利用範囲を社内周知し、問い合わせ窓口を置くと運用が安定します。

インシデント初動テンプレは時系列で動かす

以下は社内SLAとして動かしやすい初動テンプレです。法令上の報告期限を固定の時間で断定せず、PPCが速やかな対応を求める点を前提に、社内の初動速度を上げる設計にしています。

| 時点 | 社内でやること | 目的 |

|---|---|---|

| 検知直後 | 該当ツール・アカウント・連携の一時停止を判断し、ログと関連証跡を保全する | 二次被害の防止と調査不能化の回避 |

| 当日中 | 入力した可能性のある情報種別と影響範囲を暫定把握し、セキュリティ・法務・個人情報担当へエスカレーションする | 報告要否判断の材料を揃える |

| 速やかに | ベンダーへ事実確認を依頼し、保存データの扱い・削除可否・監査ログの取得可能性を確認する | 外部要因の把握と拡大防止 |

| 以後継続 | 個人情報が関係する場合はPPCの案内に基づき報告・本人通知の要否を判断し、再発防止に繋げる | 法令対応と再発防止 |

このテンプレは社内で迷わず動くための型です。実際の報告・通知の要否や内容は、PPCの案内と社内の法務判断に従って決めてください。

利用パターン別の安全設計と費用の考え方

稟議で詰まりやすいのは「禁止か野放しか」の二択です。用途とデータの機微度に応じて、以下の3パターンを並べて検討します。

- 社外SaaSを統制利用する場合は契約確認が要

- 社内プロキシ・ゲートウェイで統制する

- 専用環境・閉域で運用する場合は運用負荷を見積もる

金額は契約形態・ログ保持・データレジデンシー・SLA・DLPやCASBの有無で大きく変わるため、ここでは見積もりの軸に絞ります。

社外SaaSを統制利用する場合は契約確認が重要

立ち上げが速いのは社外SaaSの法人向けプランをSSOと管理者統制で使う形です。安全性は機能というより、契約と管理機能に強く依存します。

学習利用の有無・保存期間・管理者向け監査ログ・データ所在・削除手続き・サブプロセッサ管理は、公式文書と契約条項で確認します。

コストはユーザー課金・監査ログや管理機能の上位プラン・DLPやCASBの追加・教育と監査の運用工数が主因になります。最初は対象者を絞り、野良利用を公式アカウントへ移す効果をKPIとして持つと投資対効果を説明しやすくなります。

立ち上げの速さを優先しつつ、契約と管理機能で安全を担保すれば、最短で安全ラインを引けます。

社内プロキシ・ゲートウェイで統制する

野良利用の抑止に効くのは社外AIへの通信を社内ゲートウェイ経由に寄せる方式です。送信前検知(DLP・マスキング・禁止語や個人情報検知)とログを一元化できます。

ブラウザ利用とAPI利用を同じ方針で縛れるので、監査説明も単純になります。

コストはゲートウェイ製品のライセンスだけでなく、例外対応の運用設計と検知チューニングを回す体制が効いてきます。

導入費より、誤検知を減らしつつ検知漏れを防ぐ継続工数を見積もっておくと、後から破綻しにくくなります。

専用環境・閉域で運用する場合は運用負荷を見積もる

機微データを扱う業務や、大量の社内文書をRAGで扱う場合は閉域や専用API・専用環境の検討が現実的になります。

外部送信を最小化できる一方で、モデル更新・脆弱性対応・評価(品質と安全性)を自社責任で回す比率が上がります。

コストは計算資源だけでなく、ベクトルDB・鍵管理・監査ログ基盤・評価環境・レッドチーミング・運用監視が積み上がりやすい点がポイントです。

まず限定ユースケースでリスク低減効果と運用負荷を見える化してから拡張すると、稟議が通りやすくなります。

野良AIの利用を止めつつ活用を進める運用設計

野良利用を抑えつつ活用を進めるには、以下の3点を組み合わせます。

- 公式ツールを社内で提供する

- 教育は短時間反復で事故の多い場面に絞る

- 点検と改善を四半期で回しログと例外を資産に変える

全面禁止は守られず監査不能になりがちなため、地下化を起こさない設計が鍵になります。

公式ツールを社内で提供する

野良利用を止める近道は公式ツールを社内で提供することです。SSOで入れるチャット環境を用意し、入力禁止データの注意喚起とログ取得を標準にします。

承認が遅い・公式が使いにくい・性能が足りないという理由が残ると、禁止だけを出しても地下化します。

公式ツールの性能と利便性を、現場が選びたくなるレベルまで引き上げることが結果として最大の安全対策になります。

使ってよい道が先にあれば、現場は迷わず公式ルートを選び、ログと監査が自然に成立します。

教育は短時間反復で事故の多い場面に絞る

教育は長編より短編を反復したほうが定着します。入力禁止の具体例・誤情報の扱い・プロンプトインジェクションのイメージ・出力の外部送信ルールに絞ります。

確認テストで「理解したつもり」を潰すと、現場の自走力が上がります。

実際の業務文書を題材に、どこをマスキングすべきか・どの成果物がレビュー必須かを示すと、抽象論より事故が減ります。

短時間反復のリズムを四半期で回せば、教育コストを抑えつつ新規入社者にも一定品質の理解を担保できます。

点検と改善を四半期で回しログと例外を資産に変える

運用は公式ツール利用率・DLP検知件数・例外申請件数・レビュー不備の割合・RAGの権限制御逸脱の有無といった指標で回します。

増減の理由を四半期で棚卸しし、ルールと検知ルールを更新します。

変更の速さを前提に「見直し前提の仕組み」にしておくこと自体が安全対策になります。

ログと例外を資産として蓄積すれば、次の改善・教育・監査の根拠データに自動的に変わっていきます。

生成AIの社内安全対策に関するよくある質問

生成AIの社内安全対策に関する質問は以下の3つです。

- 社外SaaSの生成AIに機密情報を入力してもよいか

- 個人情報を誤って入力した疑いがある場合は何時間以内に報告すべきか

- RAGを入れると何が一番危険になるか

質問に対する回答を確認して、自社の安全対策の参考にしてみてください。

社外SaaSの生成AIに機密情報を入力してもよいですか

原則として入力禁止にしておくほうが安全です。

例外として扱う場合でも、そのサービスが顧客データをモデル学習に利用しないと公式に明記されているか、保存期間や削除手続きがどうなっているか、データ所在や再委託がどう管理されているかを、公式文書と契約(DPAなど)で確認します。

そのうえで社内の承認と記録を通し、条件付きで運用する形が現実的です。

個人情報を誤って入力した疑いがある場合は何時間以内に報告すべきですか

国内法の整理は「速やかに」とされるため、「72時間以内」など固定時間を国内要件として断定しないほうが整合します。

一方で、社内で迷って遅れるのが最大のリスクです。社内SLAとして、当日中に封じ込めと一次報告、短時間で法務・個人情報担当へエスカレーション、といった初動速度のルールを別途定めます。

そのうえでPPCの案内に沿って報告や本人通知の要否を判断できる体制にしておくほうが運用に乗ります。

RAGを入れると何が一番危険になりますか

検索権限の設計ミスによる横断漏えいです。

加えて、ベクトルDBやキャッシュに残った断片が削除・改訂に追随せず、古い情報や削除対象の情報が回答に混ざるリスクも出ます。

検索権限・索引・キャッシュ・削除を一体で設計し、回答に根拠(文書IDや引用箇所)を必ず出す構成にしておくと、監査と品質が両立しやすくなります。

生成AIの社内安全対策は、正しい順番で進めることで結果につながる!

生成AIの社内安全対策は、高度な技術を積むより順番を外さないことが結果につながります。ルールでスコープとデータ区分を固定し、教育で現場に浸透させ、技術設定で事故を減らし、監査で形骸化を防ぐ流れを作りましょう。

今日から着手するなら、利用ポリシーの雛形・SSOとMFA・最低限のログ取得・公式ツールの暫定提供までを短期で通します。次フェーズでDLPと契約精査・RAGの権限設計・教育の反復を整え、長期で専用環境や継続評価へ広げます。

まずは本記事のチェックリストと雛形を使い、社内提出用の最低ライン判定を組み立ててみてください。野良利用を公式へ寄せるだけでも、短期間で監査に耐える運用へ近づけます。

ただし安全対策の整備が進んでも、生成AIを推進できる人材の育成や、ガバナンスを支える組織能力の構築は別の課題として残ります。社内だけで完結させようとすると一部の人に依存した運用から抜け出せないため、外部の知見も取り入れながら設計するのが現実的です。

出典・参考リンク

- デジタル庁「テキスト生成AI利活用におけるリスクへの対策ガイドブック(α版)」

https://www.digital.go.jp/resources/generalitve-ai-guidebook - OWASP GenAI Security Project「OWASP Top 10 for Large Language Model Applications」

https://owasp.org/www-project-top-10-for-large-language-model-applications/ - OWASP「OWASP Top 10 for LLMs v2025(PDF)」

https://owasp.org/www-project-top-10-for-large-language-model-applications/assets/PDF/OWASP-Top-10-for-LLMs-v2025.pdf - NIST「AI Risk Management Framework 1.0(NIST AI 100-1)」

https://nvlpubs.nist.gov/nistpubs/ai/nist.ai.100-1.pdf - ISO「ISO/IEC 23894:2023(AI — Guidance on risk management)」

https://www.iso.org/standard/77304.html - 個人情報保護委員会(PPC)「漏えい等の対応」

https://www.ppc.go.jp/personalinfo/legal/leakAction/ - OpenAI「Enterprise privacy at OpenAI」

https://openai.com/enterprise-privacy/ - Microsoft Learn「Azure OpenAI Service FAQ(Data, privacy)」

https://learn.microsoft.com/azure/ai-services/openai/faq - Google(管理者向け)「Gemini for Google Workspace 等のデータ保護に関する説明」

https://support.google.com/a/answer/15706919 - 国税庁「電子帳簿保存法 特集」

https://www.nta.go.jp/law/joho-zeikaishaku/sonota/jirei/tokusetsu/