「AIを入れたら自分の仕事はどうなるのか」という不安にどう向き合えばよいか、悩んでいる方は多いのではないでしょうか。

この記事では、現場の反発を最小限に抑える説明の順番と、顧客対応でAIから人に切り替える基準の作り方を解説します。

AI導入で現場から警戒の声が上がったとき、最もやってはいけないのは「とにかく慣れてください」と押し切ることです。

不安の正体を分解し、正しい順番で説明すれば、反発を抑えながら合意形成を進められます。

目次

AI導入で現場の不安が生まれる背景

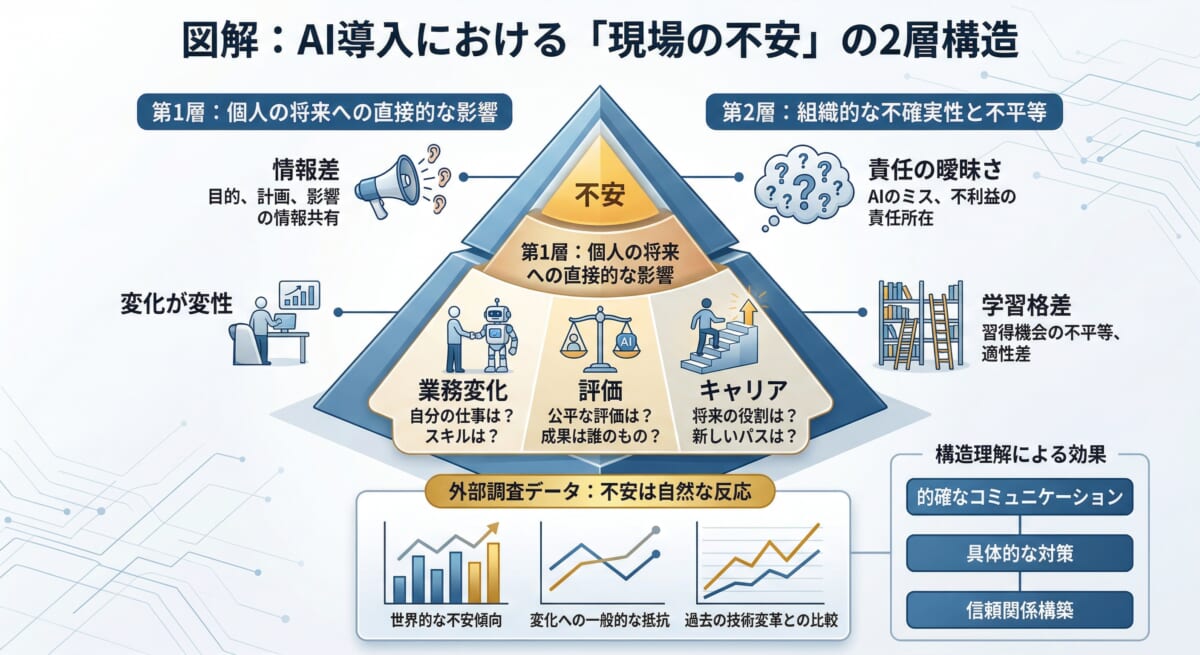

現場の不安は、業務変化・評価・キャリアと、情報差・責任・学習格差の2層で構成されています。

- 業務変化・評価・キャリアの3軸で不安が起こりやすい

- 情報差・責任の曖昧さ・学習格差が不安を広げる

- 外部調査データで「不安は自然に出る」と示せる

構造を先に押さえておくと、説明設計の精度が上がります。

業務変化・評価・キャリアの3軸で不安が起こりやすい

現場の抵抗は「AIが嫌い」という感情ではなく、3つの具体的な心配から生まれます。1つ目は日常業務がどう変わるのかという不透明感、2つ目はAIを使いこなせる人だけが評価されるのではという公平性の懸念、3つ目は自分のキャリアの行き先が見えないという将来不安です。

この3つは独立しているようで連動しています。業務の変わり方がわからなければ評価基準も見えず、評価が読めなければキャリアの方向も定まりません。

たとえば顧客対応の現場では、AIが一次回答を受け持つほど「自分の存在意義が薄れる」と感じやすくなります。チャットボットの導入後にオペレーターの離職率が上がる事例は珍しくありません。

3軸に分けて把握しておくと、説明会の場で「何について答えればいいか」が明確になり、的外れな回答で不信感を増やすリスクを減らせます。

情報差・責任の曖昧さ・学習格差が不安を広げる

不安がさらに膨らむのは、組織の構造に原因があるケースです。典型的なのは、経営層がゴールを示さないまま「まず使ってみて」と現場に降ろすパターンです。

目的が曖昧だと、現場には失敗のコストばかりが見え、成功の条件が見えません。さらにAIの誤回答が出たとき誰が責任を取るのか決まっていないと、真面目な人ほどツールに触れなくなります。

その結果、積極的に使う人と距離を置く人の間に学習格差が生まれます。格差が広がるとチーム内の心理的安全性が下がり、改善提案より沈黙が選ばれるようになります。

情報差・責任・学習格差の3つを先に潰す設計にしておけば、不安の増幅を初期段階で食い止められます。

外部調査データで「不安は自然に出る」と示せる

社内説明の場で「不安を持つのは普通のこと」と伝えるには、第三者の調査データが説得力を持ちます。BCGの「AI at Work 2024」では、仕事喪失への不安を持つ回答者が2023年の36%から2024年は42%へ増加しました(出典:[1])。

さらにリーダー層がGenAIに自信を示す割合が約50%であるのに対し、現場は33%にとどまっています。立場による温度差は構造的に起きやすいものです。

McKinseyの調査でも従業員3,613名とC-level 238名で期待と不安にずれがあることが報告されています(出典:[2])。米国中心の調査ですが、傾向は日本企業でも共通して見られます。

「うちの会社だけが不安を抱えているわけではない」と数字で見せるだけで、議論の出発点を感情論から構造の話へ切り替えられます。

AIを導入する際に先に合意すべき3つの論点

不安の構造を把握したら、説明の前に合意を取るべき論点が3つあります。

- 不安が出ること自体を前提として共有する

- 対象範囲と成功の定義を先に絞る

- 責任の所在と評価の扱いを明文化する

ここを飛ばすと、説明会のたびに議論が振り出しに戻ります。

論点1:不安が出ること自体を前提として共有する

まず握るべきは「導入時に不安が出るのは想定内である」という共通認識です。先述のBCG調査を引きながら、どの企業でも一定割合の不安が出ることを経営層にも認識してもらいます。

「うちの現場は抵抗が強い」と嘆く前に、それは統計的に当たり前の反応だと全員が理解している状態を作ることが出発点です。

社内ヒアリングは「賛成か反対か」の二択ではなく、「どのリスクが心配か」「何が決まれば試してもいいか」を自由記述で集める形がおすすめです。

回答結果がそのまま次のステップの説明設計に使えるため、ヒアリングの手間が二度手間になりません。

論点2:対象範囲と成功の定義を先に絞る

2つ目は「どこまでやるか」のスコープです。全部門・全業務にAIを入れる話では、不安の総量が大きくなりすぎます。

範囲を絞る理由は、現場が頭の中で業務を想像できるサイズにする必要があるからです。抽象度が高いほど不安は膨らみます。

たとえば「問い合わせカテゴリAの一次回答だけ」「FAQ更新の下書きだけ」のように具体化します。あわせて「何をもって成功とするか」の基準も決めておきましょう。

範囲と成功基準が先に固まっていると、後の評価フェーズで「そもそも何を目指していたのか」で揉める事態を防げます。

論点3:責任の所在と評価の扱いを明文化する

3つ目は責任と評価のルールです。「AIが間違えたら誰の責任か」「ツールを使わないと評価が下がるのか」が宙に浮いたままだと、慎重派はツールに触れなくなります。

積極派だけが先行して学習格差が広がるのは、この2つの疑問が放置されたときに起きる典型パターンです。

「顧客に送る文面の最終責任は人が持つ」「導入初期のミスは個人評価に反映せず改善材料として扱う」といったルールを文書で残しておくのが効果的です。

文書にしておけば、後から入ったメンバーやチーム異動者にも同じ基準を示せるため、説明コストが下がります。

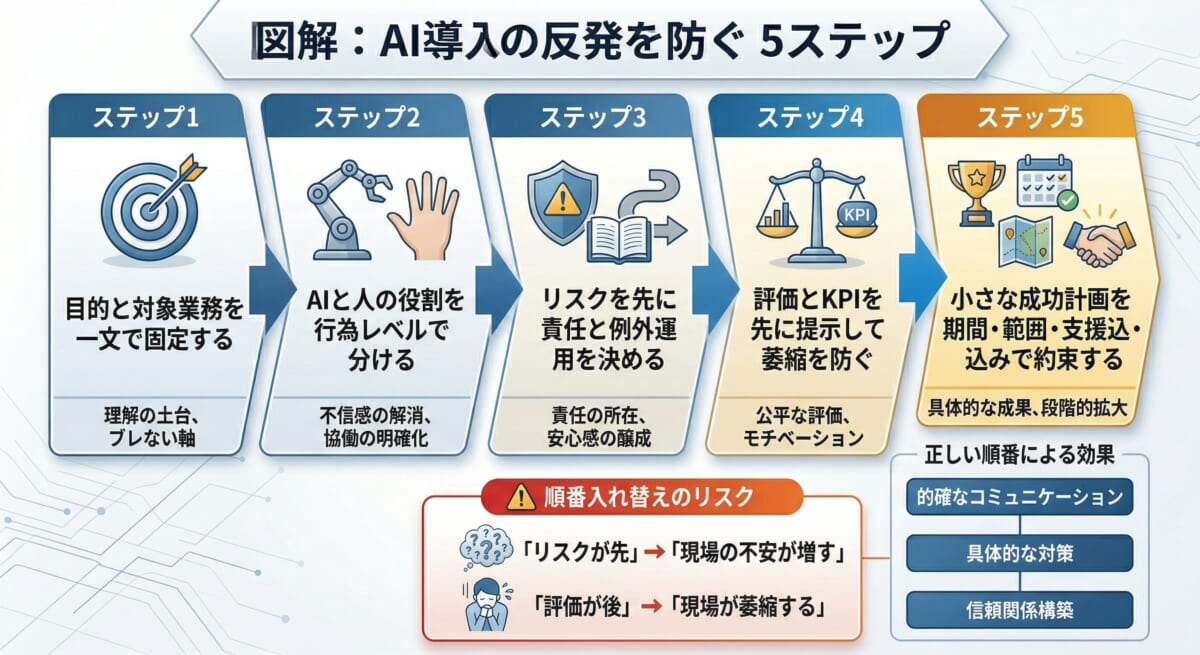

AI導入の反発を防ぐための5ステップ

現場への説明は、話す中身だけでなく出す順番が納得感を左右します。以下の5ステップをこの順番どおりに提示すると、途中で合意が崩れにくくなります。

- 目的と対象業務を一文で固定する

- AIと人の役割を行為レベルで分ける

- リスクを先に出し責任と例外運用を決める

- 評価とKPIを先に提示して萎縮を防ぐ

- 小さな成功計画を期間・範囲・支援込みで約束する

順番を入れ替えると「リスクの話が先に来て不安が増す」「評価が曖昧なまま進んで萎縮する」といった問題が起きます。

ステップ1:目的と対象業務を一文で固定する

最初のスライドで見せるのは「何のために、どの業務でAIを使うか」の一文です。成果の方向までセットで示すと、聞き手の認識がぶれません。

一文に絞る理由は、情報量が多いほど「自分に関係あるのか」の判断が遅れ、警戒が先に立つからです。

たとえば「問い合わせカテゴリAの一次回答下書きを自動化し、浮いた時間を品質チェックに回す」のようにまとめます。対象は全部門ではなく、現場が具体的に想像できる範囲に限定しましょう。

「まずはここだけ」と言い切るだけで聞く側の警戒度は下がり、次のステップへスムーズに進めます。

ステップ2:AIと人の役割を行為レベルで分ける

2番目に出すのは役割分担です。ありがちな失敗は「AIが下書き、人が監督」のように抽象度の高い表現で止めてしまうことです。

抽象的な分担では現場は何をすればいいかわかりません。結果として「責任だけ増える」という印象が残ります。

「顧客への送付文面は人が最終確認する」「規約の解釈が絡む案件は人が判断する」「返金や補償の決裁は人が行う」のように、実際に手を動かす場面を列挙してください。

行為として見える形にすると、「仕事が消える」ではなく「仕事の中身が変わる」という認識に切り替わり、不安が前向きな関心に変わります。

ステップ3:リスクを先に出し責任と例外運用を決める

3番目はあえてリスクの話を先に出すパートです。怖い論点を隠すほど、後から発覚したときの不信感が大きくなります。

「生成AIはもっともらしい誤りを返すことがある」「個人情報や機密情報の入力は禁止する」「著作権や差別的表現にも注意が必要」といった論点を最初からテーブルに載せます。

その場で責任の所在も決めてしまいましょう。「外部送信する文面の最終責任は担当部署」「高リスクカテゴリはAI単独で返さない」「切替時は理由をログに記録する」と言い切ると、かえって安心感が生まれます。総務省・経産省のAI事業者ガイドラインが掲げる透明性・人間の関与・説明責任の考え方も、この段階で運用に組み込むとスムーズです(出典:[3])。

リスクを先に出して責任まで決め切ることで、「何かあっても対処できる」という信頼が生まれ、利用開始のハードルを下げられます。

ステップ4:評価とKPIを先に提示して萎縮を防ぐ

4番目は評価への不安をつぶすパートです。「AIを使わなければ評価が下がるのか」「AIのミスで成績に傷がつくのか」が曖昧だと、現場は守りに入ります。

守りに入った状態ではツールの利用が進まず、導入効果の検証自体ができなくなります。

導入初期は利用を強制しないこと、品質を最優先にすること、失敗は個人の責任ではなくプロセスの改善材料にすることを明言しましょう。あわせて成果KPI(処理時間・一次解決率など)と運用KPI(利用率・エスカレーション率・監査ログ整備率など)をセットで定義します。

「成功とは何か」を数字で合意しておくだけで、不安は目に見えて和らぎ、チャレンジできる空気が生まれます。

ステップ5:小さな成功計画を期間・範囲・支援込みで約束する

最後に示すのは短期パイロットの計画です。「いつまでに」「どの範囲で」「何が達成できれば成功か」をセットで約束します。

期間を決める理由は、ゴールのない試行は不安を長引かせるだけだからです。区切りがあるほうが集中力も上がります。

期間は2〜4週間が一般的ですが、データ整備や外部連携が必要な場合は8〜12週間を見込んだほうが安全です。計画と同時に、相談窓口の設置・テンプレやプロンプト集の配布・週1回の振り返りミーティング・エスカレーション先の明示も提示してください。

支援体制が見えると「試して放置される」不安が消え、現場の利用が定着しやすくなります。

AI導入の社内周知を円滑に進める伝え方のポイント

5ステップの中身が固まっても、伝え方を間違えると台無しになります。経営・管理職・現場はそれぞれ気にするポイントが異なります。

- 経営層には対象・効果・統制を端的に伝える

- 管理職には運用と評価の設計を先に見せる

- 現場には不安の肯定から入り切替の仕組みで安心させる

相手に合わせてメッセージを調整しないと、不要な誤解が広がります。

経営層には対象・効果・統制を端的に伝える

経営層が知りたいのは「投資に見合うか」「リスクは管理できるか」の2点です。夢や可能性より、具体的な数字と統制の話が刺さります。

プレゼンの分量が増えるほど判断が遅れるため、ワンスライドに収めるのが鉄則です。

「対象はカテゴリAの顧客対応、狙いは処理時間の短縮と品質の底上げ、統制はAI事業者ガイドラインに準拠したルールと監査ログで担保」とまとめます。BCGの調査で示されたリーダー層と現場の認識差(出典:[1])も添えると説得力が増します。

ツール購入だけで終わらせず研修・ガバナンス・運用設計へ投資する根拠として使えるため、予算確保にも直結します。

管理職には運用と評価の設計を先に見せる

管理職が不安に感じるのは「自分のチームで問題が起きたらどうするか」です。抽象的な方針ではなく、運用が回る状態を具体的に見せましょう。

管理職は現場と経営の板挟みになりやすく、両方に説明できる材料を求めています。

AIの出力はあくまで参考にとどめ顧客向け文面は人が承認する、誤りが出たら原因をタグで記録しナレッジを更新する、高リスク案件は最初から人が対応する。ここまで言い切ると管理職は安心できます。

評価についても「導入初期は安全に回せたか・学びを共有できたかを軸にする」と伝えると、成果だけで詰められる不安がなくなり、チーム運営がしやすくなります。

現場には不安の肯定から入り切替の仕組みで安心させる

現場への説明は最初の30秒で空気が決まります。冒頭は「不安に感じるのは自然なことです。だからこそ先にルールと支援体制を整えました」と入りましょう。

最初に否定から入ると、残りの説明がすべてフィルター越しに聞かれてしまうためです。

次にAIでは対応できないことを先に伝えます。顧客の背景理解、イレギュラーな判断、法務に関わる解釈、最終的な責任の引き受けは引き続き人の仕事です。AIは下書きと検索補助に限定する、と役割を言い直します。

最後に「所定の条件に当てはまれば、いつでもAIから人に切り替えられる仕組みがある」と締めくくると、「やらされる」から「試してみてもいい」へ気持ちが動きやすくなります。

AI導入の研修を短期間で成果につなげる設計方法

研修を「実施した」という実績で終わらせると、現場はかえって身構えます。日々の業務に直結する内容で設計し、成果をKPIで追える形にすることが大切です。

- 全員・推進者・専門担当の3層で内容を分ける

- 概論より自分の業務でそのまま使える型を教える

- 時間・費用の目安を示しKPIで投資対効果を測る

この3点を揃えないと、研修が「イベント」で終わり現場に残りません。

全員・推進者・専門担当の3層で内容を分ける

全社員に高度な技術知識は不要ですが、共通言語として揃えるべき4つの項目があります。AIに入力してはいけない情報、出力が誤るパターンの代表例、最終判断は人が持つ前提、困ったときの切替基準です。

4項目に絞る理由は、情報量が増えるほど「自分に関係ある部分」が見えなくなるからです。全員向けはシンプルにするほど浸透します。

推進者にはこれに加え、現場への伴走スキルと改善提案の方法を教えます。専門担当にはガバナンス設計、監査ログの運用、権限設定、ツール選定といった技術寄りの内容を割り当てます。

3層に分けておくと、各自が「自分はどこまで知っていればいいか」を判断でき、学習の負荷が適正化されます。

概論より自分の業務でそのまま使える型を教える

座学で「生成AIとは」と始めても、翌日の業務には活きません。業務にそのまま入る型を中心に組み立てるのが短期で効かせるコツです。

概論に時間を使うほど「で、結局どう使うの」という不満が残り、研修後の利用率が上がりません。

顧客対応チームなら、問い合わせメールの要約、一次回答の下書き、文面のトーン調整、ナレッジ候補の提示、確認すべき質問の提案を、実際の問い合わせデータに近い題材で手を動かしながら練習します。ガバナンス面も実技と一体にし、個人情報の扱い方・操作ログの残し方・誤回答を見つけたときの報告フロー・人への切替判断までセットで教えましょう。BCGもAI upskillingを業務と結びつける重要性を提言しています。

「ルールがわからないから怖い」という壁を研修の中でつぶせると、研修直後から利用率が上がりやすくなります。

時間・費用の目安を示しKPIで投資対効果を測る

研修にかける時間の目安は、経営層が半日程度、管理職が8〜16時間、現場担当が16〜40時間です。現場はロールプレイまで含めるため最も長くなります。

費用は教材外注・講師費・eラーニング・稼働損失まで含め、1人あたり3万〜15万円程度のレンジが一つの参考です。

ただし金額の大小より、研修後に何が変わったかを追えるかどうかが重要です。修了テストの合格率、実務でのAI利用率、一次解決率の変化、誤回答の流出率、CSATの推移を導入前後で同じ定義のまま計測します。

KPIで効果を可視化すると、次年度以降の研修予算の確保根拠にもなり、継続的な人材育成の土台ができます。

日本のAI導入で押さえるべきガバナンスと法令対応

どれだけ高性能なツールを入れても、「何かあったとき守れる仕組みがある」と見えなければ現場は使えません。日本で運用するうえで参照すべき法令・ガイドラインと、最低限整えるべき運用要件を整理します。

まず法令の柱になるのは個人情報保護法です。取得・利用目的の特定、第三者提供の制限、安全管理措置、委託先管理の各要件を運用フローに組み込みます。生成AIにテキストを入力する行為が外部送信や第三者提供に該当するかどうかは、利用ツールの仕様や契約条件で結論が変わるため、導入前に法務・情報セキュリティ部門と一緒に確認してください。

事業者としての行動指針には、総務省・経済産業省のAI事業者ガイドラインが使えます。透明性の確保、説明責任、人間が関与する仕組み、リスクに応じた管理の4本柱を自社の運用ルールに読み替える作業が必要です。

運用レベルで最低限そろえるべきは以下の5つです。

- 監査ログ:問い合わせID・利用チャネル・モデルIDと版・プロンプトと版・参照ナレッジの版・AI出力・承認者・エスカレーション履歴・最終送信文面を記録します。立ち上げ期は週次、安定後は月次〜四半期でサンプル監査を回すのが現実的です。

- 権限管理:閲覧・編集・承認の3段階を最小権限の原則で設計します。個人情報を扱う場合は匿名化・仮名加工の処理を組み込みます。

- データ保持ポリシー:保持期間は業種・契約・規制で異なるため法務と合意して決めます

- 版管理:プロンプトとナレッジベースの「いつ・誰が・何を変えたか」を追跡できる状態にします

- フォールバック経路:AI側の障害や品質低下が起きたときに人の対応へ切り戻す手順と責任範囲をあらかじめ決めておきます。

5つが揃っていると、「ルールがあるから安心して使える」状態を作れます。とくに版管理がないと誤回答の原因が追えず、現場の不安がぶり返すため優先度は高めです。

▶関連記事|世界と日本のAI規制・ガイドライン動向を一望する>>

AI導入の成果を測るKPI定義式と測定方法

「効果が出ているのかわからない」という状態は、現場のモチベーションを下げる大きな原因です。比較できる形でKPIを定義し、導入前と同じ物差しで追い続けることがポイントになります。

最も基本的な成果指標は一次解決率(FCR)です。算出式は「一次対応で解決した件数÷全対応件数×100」で、チャネルごとに集計します。自己申告だけでは精度が出ないため、一定期間内に同一顧客からの再問い合わせがあったかをシステムログで確認し、アンケート結果と突き合わせる運用が有効です。

ツールの浸透度を見るにはAI利用率を使います。「対象ユーザーのうち週1回以上AIツールを業務で使った人数÷対象ユーザー総数×100」のように、頻度の条件まで定義に含めてください。フェーズの途中で定義を変えると前後比較ができなくなるため、計測開始時に固定するのが鉄則です。

品質面のリスクを可視化するのが誤回答流出率です。「顧客に公開した後に訂正・撤回が必要になった回答数÷公開回答総数×100」で算出します。公開済みの回答にはモデル名・プロンプト版・承認者・公開日時をタグとして付与しておくと、定期サンプル監査で原因を特定しやすくなります。

顧客満足度はCSATとNPSの併用が一般的です。CSATは「満足と回答した件数÷有効回答数×100」、NPSは「推奨者の割合−批判者の割合」で求めます。設問の文言と集計条件を固定し、導入前後で同じ基準のまま比較できる状態を保ってください。

運用が設計どおりに回っているかを確認するには、エスカレーション率(人へ切り替えた件数÷全対応件数×100)と監査ログ整備率(必須フィールドが埋まったログ件数÷全ログ件数×100)が役立ちます。

顧客対応でAIから人へ切り替える判断基準とSLA設計

顧客対応の品質は、AIの性能よりも「どこで人に渡すか」の運用設計で決まります。切替の判断に迷いが出ない仕組みを作るため、3つの観点を押さえましょう。

- 感情・重要度・難易度の3軸で切替トリガーを設定する

- 属性・履歴・状況を判断に使いつつ公平性を担保する

- SLA・責任分界点・引き継ぎ品質で体験悪化を防ぐ

この3点が曖昧だと、担当者ごとに判断がばらつき顧客体験が不安定になります。

感情・重要度・難易度の3軸で切替トリガーを設定する

切替条件は感情・重要度・難易度の3つの軸で整理すると漏れが出にくくなります。1軸だけでは判断しきれないケースも、複合で見ると結論が出ます。

感情軸は、顧客が明らかに怒っている場合や不安を訴えている場合、人間による説明や謝罪を求めている場合が該当します。感情解析スコアを使うなら、しきい値を仮で設定してA/Bテストで最適値を探っていくのが実務的です。

重要度軸は、解約・返金・補償・法的リスク・安全に関わるカテゴリ、または個人情報を含む可能性が高い案件です。初期は高リスクカテゴリを一律で人に回すルールにしたほうが、炎上リスクを確実に抑えられます。

難易度軸は、追加のやり取りが重なっても解決に至らない場合や、複数システムの参照・規約の解釈が必要な場合です。「追加質問が2往復を超えて解決しなければ人へ」という基準がシンプルで機能します。3軸を組み合わせることで、属人的な判断に頼らず安定した品質を維持できます。

属性・履歴・状況を判断に使いつつ公平性を担保する

切替判断の精度を上げるには、会話の中身だけでなく顧客の属性情報や対応履歴も加味するのが効果的です。背景情報があるほど、適切なタイミングで人へ渡せます。

たとえば高額プランの契約者、過去に未解決の問い合わせ履歴がある顧客、納期や締切を抱えている案件は、早めにエスカレーションするほうが体験を損ないません。

ただし属性だけに基づく過度な振り分けは差別につながるリスクがあります。切替ルールは「顧客体験とリスク低減を目的とした運用基準である」と明文化し、例外が発生した場合は必ず記録して定期レビューに回すことで公正性を担保します(出典:[3])。

記録と改善の仕組みがあれば、属性情報を活用しつつ公平なサービスを両立できます。

SLA・責任分界点・引き継ぎ品質で体験悪化を防ぐ

適切なタイミングで人に切り替えても、引き継ぎの質が低ければ顧客に同じ説明を繰り返させることになります。切替の成否は渡す情報の精度で決まります。

AIから人へ渡す際のパッケージとして、会話の要約・確認済み事項・未確認の論点・次に聞くべき質問の案・切替理由のタグを揃えておきましょう。

SLAはチャネルと営業時間を前提に設定します。たとえば高リスク案件は5分以内に人が着手、通常案件は30分以内に着手といった形です。未達が続く場合は担当者を責めるのではなく、切替条件が厳しすぎないか、受け皿の人員は足りているかを見直すのが正しい対処です。責任分界点は「最終承認者は誰か」「監査ログのオーナーは誰か」をRACIの考え方で文書化するだけでも効果があります。

引き継ぎ品質・SLA・責任分界点の3つが揃うと、切替のたびに体験が劣化する悪循環を断ち切れます。

以下は現場で使える切替基準のチェック用テーブルです。しきい値は自社の業務特性に合わせて調整してください。

| 観点 | 切替基準の目安 |

|---|---|

| 感情 | ネガティブ感情がしきい値を超えた場合、または顧客が説明・納得を明確に求めている場合 |

| 重要度 | 解約・返金・補償・法的論点・安全に関わるカテゴリ、または機密性の高い情報を含む場合 |

| 難易度 | 追加質問が所定の往復数を超えて未解決の場合、または専門的な判断・解釈が必要な場合 |

| 反復 | 同じ趣旨の回答が繰り返され、顧客の状態が前進していない場合 |

| 信頼度 | モデル信頼度スコアが所定のしきい値未満の場合、または回答根拠を提示できない場合 |

運用が回り始めたら、切替理由をタグで蓄積し週次で上位の理由をレビューします。ナレッジ不足による切替が多ければFAQを拡充し、感情トリガーが目立つなら初期の案内文面や導線を改善し、難易度の高い問い合わせが集中するなら該当カテゴリを最初から人対応に戻す判断も取れます。

この改善ループが機能すると、AI導入は現場の負荷を増やす施策ではなく、改善サイクルを加速させる仕組みとして受け入れられるようになります。

企業のAI導入に関するよくある質問

AI導入の対策に関する質問は以下の3つです。

- AI導入で現場の不安を数値化するにはどうすればよいか

- AIを使わない人が損をする空気を避けるにはどうすればよいか

- 監査ログはどこまで残すべきか

質問に対する回答を確認して、自社のAI導入計画の参考にしてみてください。

AI導入で現場の不安を数値化するにはどうすればよいか

主観面と実態面の2軸で計測するのがおすすめです。主観面は社内アンケートで業務変化・評価・キャリアへの不安を種類別に定点観測します。

実態面はAI利用率・エスカレーション率・誤回答流出率・監査ログ整備率を運用ログから追います。

BCGのグローバル調査データを添えて「どの企業でも同じ傾向が出ている」と示すと、不安を口にすること自体へのハードルが下がります。主観と実態を並べて見ることで、施策の優先順位が明確になります。

AIを使わない人が損をする空気を避けるにはどうすればよいか

導入初期の評価軸を「ツールの利用回数」ではなく「安全に運用できたか」「チームとして学びを共有できたか」に設定するのが効果的です。

あわせてミスを責めず改善に回す運用ルールを明示します。推進者による伴走サポート、テンプレ・プロンプト集の配布、切替基準の公開を揃えましょう。

「使いこなせる人だけが得をする」空気は、情報と支援の非対称性から生まれます。全員に同じ環境を提供することで防げます。

監査ログはどこまで残すべきか

追跡可能性を確保するうえで最低限必要なのは8項目です。問い合わせID・使用モデルとそのバージョン・プロンプトのバージョン・参照ナレッジのバージョン・AIの出力内容・承認者名・エスカレーション履歴・顧客に送った最終文面です。

保持期間は業種や規制によって異なるため、法務部門と合意のうえ決定してください。

個人情報が含まれる場合は個人情報保護法の安全管理措置や委託先管理の要件もあわせて設計する必要があります(出典:[5])。ログが残っていれば、問題発生時にも原因を追跡でき、現場の信頼を維持できます。

まとめ:説明の順番と運用設計で不安は解消できる

AI導入時の不安は感情論ではなく、目的の不透明さ・責任のあいまいさ・学習格差・切替設計の欠如という構造的な問題から発生します。伝える情報を増やすより、伝える順番を固定するほうが反発は小さくなります。

目的と対象→役割分担→リスクと責任→評価とKPI→小さな成功計画の5ステップで、社内の合意形成を進めてください。顧客対応では感情・重要度・難易度の3軸で切替トリガーを設計し、監査ログで改善サイクルを回すことで安全性と効率を両立できます。

まずは本記事の5ステップに沿って、次回の社内説明の資料を組み立ててみてください。順番を変えるだけで、現場の反応が変わるはずです。

出典・参考リンク

- [1] Boston Consulting Group (BCG), “AI at Work (2024)”(グローバル調査、n=13,102。2023年n=12,898の結果も併載。仕事喪失不安の割合やリーダー層と現場の認識差を含む)

https://web-assets.bcg.com/21/27/3909df0749fb97f19a98721d1eff/ai-at-work-2024-slideshow-2024-june.pdf - [2] McKinsey, “Superagency in the workplace: Empowering people to unlock AI’s full potential at work”(従業員3,613名+C-level 238名、2024年10〜11月、米国中心)

https://www.mckinsey.com/capabilities/mckinsey-digital/our-insights/superagency-in-the-workplace-empowering-people-to-unlock-ais-full-potential-at-work/ - [3] 総務省・経済産業省, 「AI事業者ガイドライン(第1.1版)」(2025-03-28)

https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/pdf/20250328_4.pdf - [4] NIST, “Artificial Intelligence Risk Management Framework (AI RMF 1.0)” (Jan 2023)

https://nvlpubs.nist.gov/nistpubs/ai/NIST.AI.100-1.pdf - [5] 個人情報保護委員会, 「個人情報保護法に関する解説・基本方針等」

https://www.ppc.go.jp/personalinfo/legal/fundamental_policy/ - [6] Boston Consulting Group (BCG), “Five Must-Haves for Effective AI Upskilling” (2024)

https://www.bcg.com/ja-jp/publications/2024/five-must-haves-for-ai-upskilling - [7] ISO, “ISO/IEC 23894: Artificial intelligence — Guidance on risk management”(規格概要ページ)

https://www.iso.org/standard/77304.html - [8] ICMI, “Contact Center Metrics & KPIs”(FCR等の定義の参考)

https://www.icmi.com/files/StudentResourcePage/CCF/CCMetricsKPIs.pdf